对抗知识焦虑,从看懂这条开始

App 下载

机器人跑半马,背后是具身智能的关键突破

通用动作AI系统|地图公司|自主避障|四足机器人|具身智能|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

通用动作AI系统|地图公司|自主避障|四足机器人|具身智能|人工智能

4月19日,北京亦庄的跑道上将迎来一批特殊的半马选手:300余台机器人将用机械关节跑完21公里。其中一台四足机器人格外引人注意——它来自一家做地图的公司,背后搭载的AI系统,能让机器人像人类一样用身体感知环境、自主避障,甚至完成复杂操作。这不是科幻电影的场景,而是具身智能从实验室走向现实的试金石。为什么一家地图公司能在机器人领域拿出世界级成果?这背后藏着让AI真正“走进”物理世界的核心秘密。

你可以把机器人的“大脑”想象成一个厨师:以前的厨师只会做一道菜,换个锅就手忙脚乱;而现在这个厨师,只要给够食材,不管是用炒锅、蒸锅还是烤箱,都能做出像样的菜。

这个“全能厨师”就是全球首个统一架构的具身操作基座模型——它解决了机器人领域最头疼的“数据孤岛”问题。过去不同形态的机器人(机械臂、四足、人形)用的是不同的“动作语言”,数据没法共享,模型也没法通用。现在通过统一的动作表示标准,把所有机器人的动作都转换成“末端执行器的移动增量”,就像把所有菜谱都翻译成了同一种语言。

这个模型基于600万条真实操作轨迹、9500多小时的交互数据训练而成,涵盖20多种机器人形态。在Libero-Plus基准测试中,它的任务成功率达到80.5%,比之前的行业标杆提升了近30%。更关键的是,它能快速适配新的机器人形态:给一个从没见过的四足机器人,只需微调少量参数,就能让它学会走路、避障。

你有没有过这种体验:想伸手拿杯子,大脑不会计算每一块肌肉的收缩角度,只会直接下达“伸手、抓取”的指令——因为有效动作本来就不是无限的,而是集中在一些固定的“动作轨道”上。

机器人的动作也是如此。传统模型在高维的动作空间里随机试错,就像在堆满杂物的房间里找东西,效率低还容易出错。而动作流形学习,就是先画出房间里的“有效路径”,让模型只在这些路径上找答案。它直接预测“干净”的动作序列,不用再从噪声里过滤有效信号,不仅把动作生成的速度提升了3倍,还让机器人的动作更稳定、更符合物理规律。

这在自主导航里尤其重要。当机器人跑半马时,它不需要计算每一步关节的角度,只需根据环境感知调整自己在“跑步流形”上的位置——避开障碍物时稍微偏移轨道,遇到上坡时切换到“爬坡流形”,就能像人类一样流畅地完成长距离奔跑。

当然,这种方法也有局限:它依赖大量高质量的真实数据,而采集机器人的真实操作数据,成本是采集图像数据的几十倍。目前模型在极端复杂的动态环境中,比如突然窜出的行人、湿滑的路面,仍然可能出现判断失误。

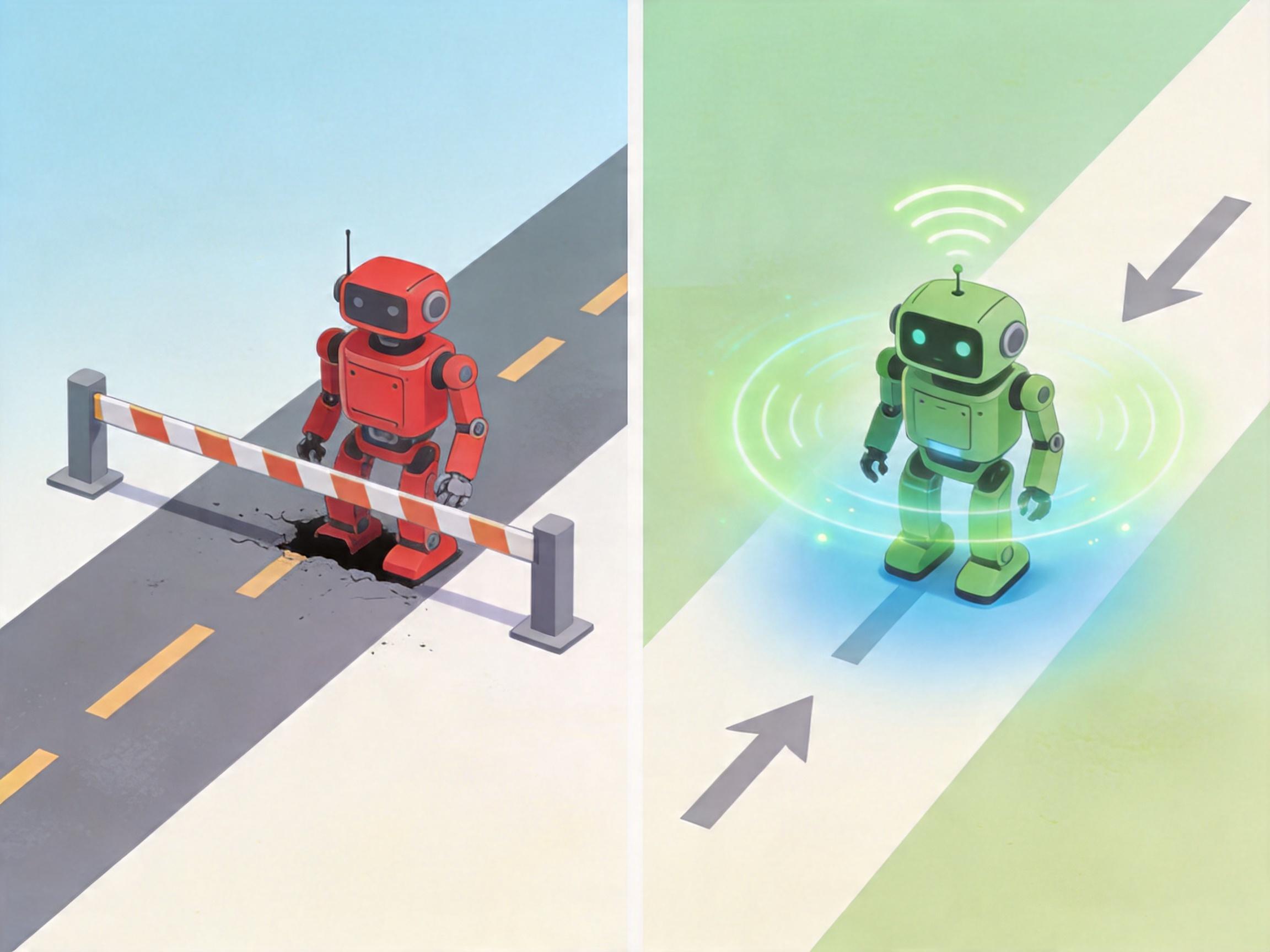

过去的机器人导航,就像拿着纸质地图找路:只能沿着预设的路线走,遇到修路、堵车就彻底懵了。而现在的自主导航,是给机器人装了一个“活地图”——它能实时感知环境,自己规划路线,甚至能预测环境的变化。

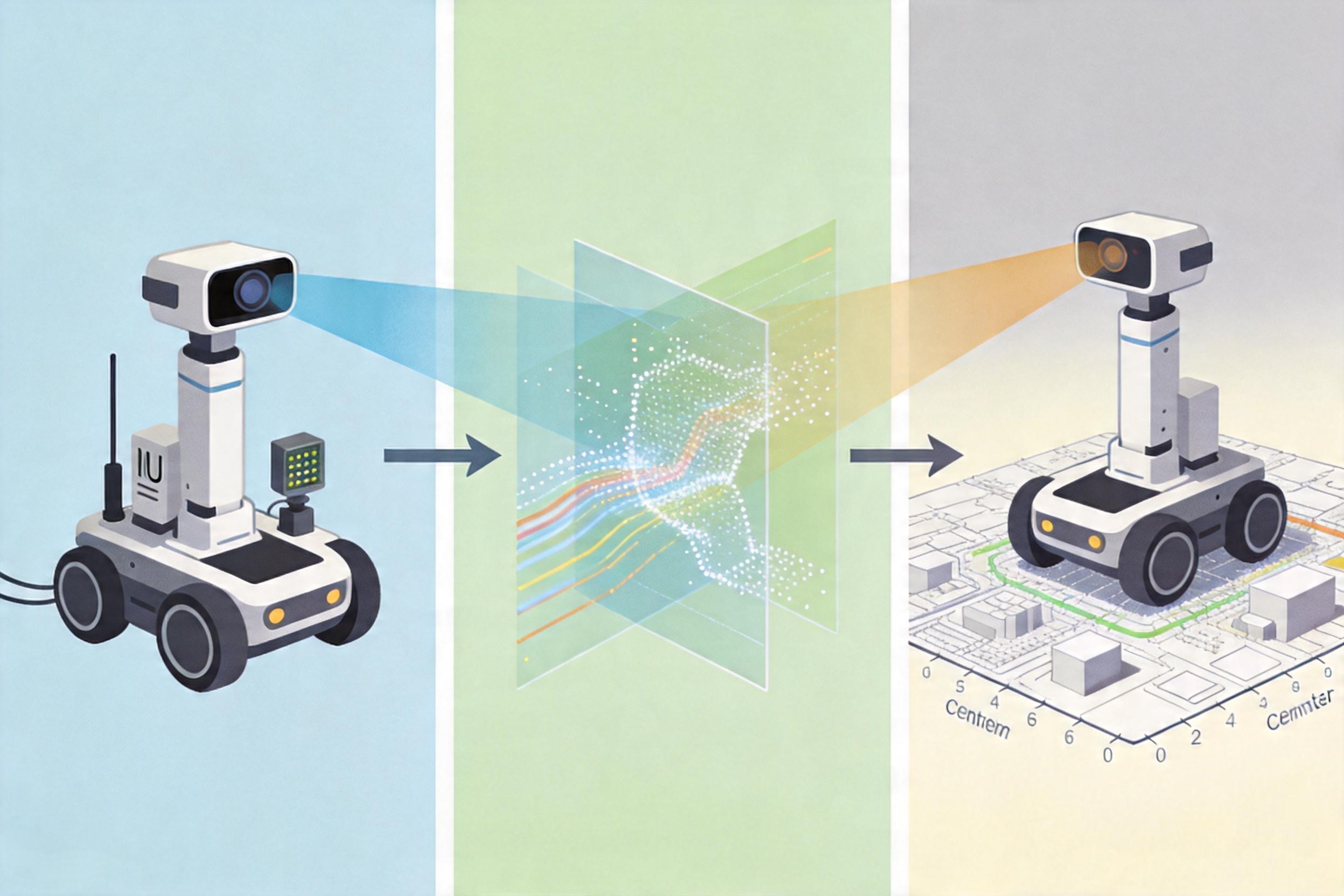

这背后是多模态传感器融合和动态SLAM技术的结合。机器人通过摄像头、激光雷达、IMU等传感器,同时获取视觉图像、3D点云、运动姿态等数据,就像人类用眼睛看、用脚感受路面、用耳朵听周围的声音。然后通过AI算法把这些数据融合起来,实时构建环境地图并定位自己的位置,精度能达到厘米级。

在这次机器人半马的自主导航组,机器人需要在没有遥控的情况下,跑完21公里的开放道路,避开行人、路障,甚至应对天气变化。这不仅考验机器人的运动能力,更考验它的“决策能力”:什么时候加速,什么时候减速,遇到障碍是绕左边还是右边,这些都需要在毫秒级的时间里做出判断。

当这些机器人踏上亦庄的跑道时,它们跑的不只是半马,更是人类让AI走进物理世界的“长征第一步”。过去我们总说“AI改变世界”,但那些AI都活在屏幕里;现在,AI终于有了能触摸世界的身体。

具身智能的终极目标,不是让机器人跑得比人快,而是让它们能在复杂的真实世界里,像人类一样灵活地帮我们做事——帮护士送药,帮工人搬货,帮老人做家务。智能的本质,从来不是计算,而是交互。 当机器人能真正理解物理世界的规则,能和人类自然协作时,我们才真正进入了智能时代。