对抗知识焦虑,从看懂这条开始

App 下载

英国老律师用AI查案,百年司法在转弯

医疗数据分析|英国司法体系|医疗过失案|ChatGPT|安东尼·塞尔|临床诊疗技术|AI产业应用|医学健康|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

医疗数据分析|英国司法体系|医疗过失案|ChatGPT|安东尼·塞尔|临床诊疗技术|AI产业应用|医学健康|人工智能

2024年春,英格兰中部的一场心脏手术夺走了一位七旬老人的生命。家属想知道真相,代理律师安东尼·塞尔却被验尸官拒绝了找专家求证的申请——在这个资金不足、运转几百年的老司法体系里,这是常有的事。

35岁的塞尔没有放弃,他打开了ChatGPT。不是要AI替他打官司,而是让这个“超级实习生”帮他把一堆医疗数据拧成清晰的问题:手术中哪一步可能出了偏差?术后护理有没有符合标准?他甚至用AI算出了更精准的赔偿金额。没人想到,这个在古老行业里的小尝试,会成为百年司法体系转向的微小但关键的推力。

医疗过失案是律师行业里的“硬骨头”:要啃完上千页病历、读懂复杂的手术流程,还要从零散的诊疗记录里找出“哪里错了”。过去,律师要么花高价请医学专家,要么自己抱着医学教材啃几周——塞尔就曾靠谷歌和YouTube视频恶补心脏手术知识。

AI的出现,把这个过程压缩到了几天。你可以把它想象成一个“医学文献搜索引擎+逻辑梳理助手”:输入手术名称,它能立刻列出该手术的标准流程、常见风险点;把病历的时间线喂进去(当然要隐去客户隐私),它能标出“术后24小时未复查凝血功能”这种容易被忽略的异常。

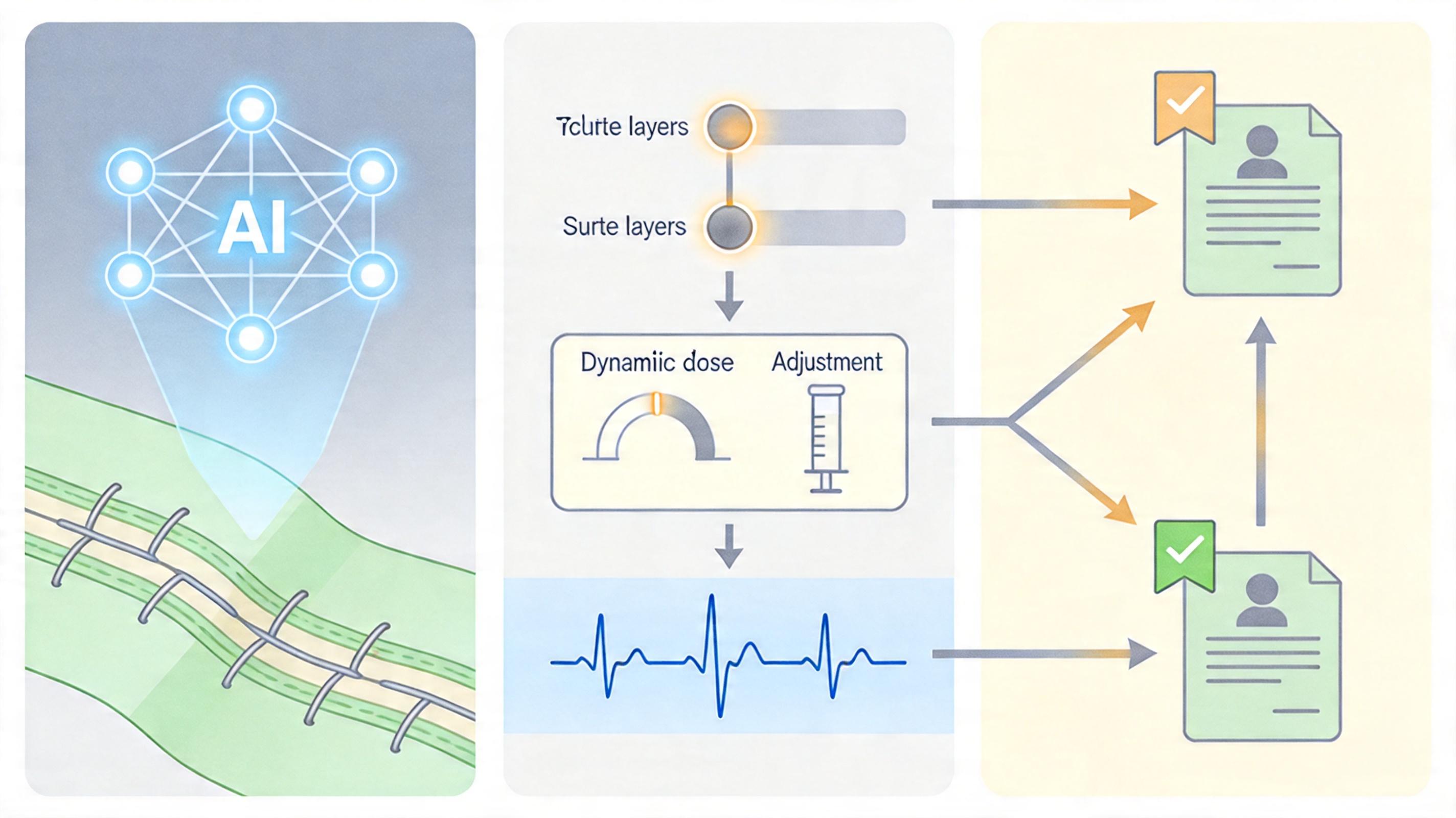

更关键的是定制化医疗AI——就是给医学生和医生用的专业工具。塞尔用的这类AI,能直接分析手术记录里的技术细节:比如缝合的层数是否符合规范,麻醉剂量的调整有没有跟上患者的体征变化。它不会直接说“医生错了”,但能帮律师把问题聚焦到最核心的技术节点,弥补了请不到专家的空白。

当然,塞尔从不敢把客户数据直接输入AI,所有AI给出的信息,他都会找医学文献一一核对。对他来说,AI不是“答案机”,是“望远镜”——帮他在海量信息里更快找到值得深究的方向。

塞尔的尝试不是孤例。在英国,这个有几百年历史的司法体系正被AI悄悄改变——不是颠覆,是从最琐碎的环节开始“挤效率”。

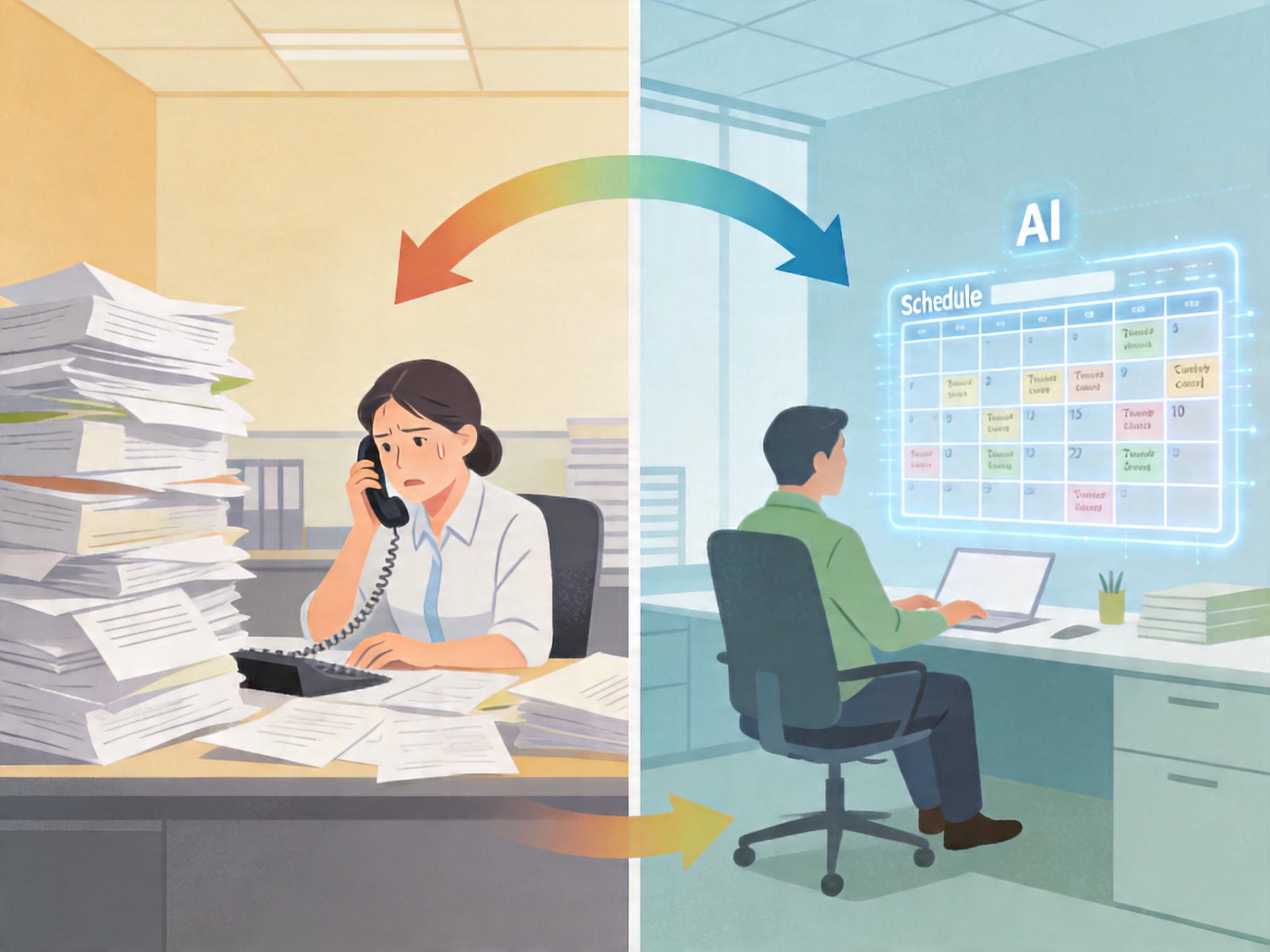

比如法院排期。过去,一个案件从立案到开庭,可能要等上一年:事务秘书要手动协调法官、律师、证人的时间,还要考虑法庭的空闲档期,光是发邮件确认就要花上几天。现在AI能在几小时内算出最优方案,甚至能提前预判“这个法官周三下午通常有空”“这个律师下两周有其他庭审”,把事务秘书的时间节省出来做更重要的事。

还有庭审记录和翻译。过去,庭审记录要靠速记员手动整理,翻译要等上几天才能出来。现在AI能实时把法官、律师的发言转写成文字,还能同步翻译成多种语言——这在跨国案件里,能把庭审效率提高一倍以上。

更值得关注的是,AI正在改变律师的工作分工。初级律师不用再花几周时间做法律检索,AI能在几秒内找出相关的判例和法条;事务秘书不用再手动整理案件资料,AI能自动生成案件摘要。律师们终于能从繁琐的事务性工作里跳出来,把时间花在和客户沟通、制定诉讼策略这些更需要“人”的判断力的事上。

但这一切都有个前提:AI只是辅助。英国副首相兼司法大臣大卫·拉米说得很清楚:AI可以帮我们提高效率,但最终的判决,必须由人来做。

AI给法律行业带来效率的同时,也埋下了隐忧——最让人头疼的,就是AI的“幻觉”问题。

2023年,美国有个律师用ChatGPT写了一份法律意见书,里面引用了6个根本不存在的判例,结果被法院罚款5000美元;2024年,英国也有律师因为用AI生成的虚假案例被处罚。这些“幻觉”不是AI故意撒谎,而是它在生成内容时,会把相似的信息拼接在一起,甚至“创造”出看起来真实的引用——但这些内容,全是假的。

这对法律行业来说是致命的:法律的生命在于真实,一份有虚假引用的法律意见书,不仅会让律师丢了饭碗,还会影响案件的公正判决。所以,现在几乎所有律所都规定:AI生成的内容,必须经过人工100%的核查。

还有数据隐私问题。律师手里的客户数据都是高度敏感的,要是不小心把客户的病历、隐私信息输入到了通用AI里,这些数据可能会被用来训练模型,甚至泄露出去。所以像塞尔这样的律师,用AI时都会特别小心:要么用本地部署的专业AI工具,要么把所有敏感信息都隐去。

更重要的是,AI无法替代律师的“同理心”。家属要的不是一份冰冷的法律意见书,是有人能理解他们的痛苦,帮他们讨回公道;法官要的不是AI算出的“最优判决”,是能兼顾法律和人情的判断。这些,都是AI永远学不会的。

塞尔说,他不是要做“AI律师”,而是要做“会用AI的律师”。在这个有几百年历史的行业里,他的尝试就像投入湖面的一颗小石子,正在泛起一圈圈涟漪。

AI不会取代律师,就像计算器不会取代数学家。它能帮我们把繁琐的工作变得更高效,但最终的判断、共情和温度,只能来自人。

AI是工具,司法的底色永远是人。

当百年老行业遇上新技术,改变的不是司法的本质,是我们接近正义的速度。