对抗知识焦虑,从看懂这条开始

App 下载

废片和好片搭伙,一键搞定修复加对齐

无监督处理|国民大学|首尔大学|图像对齐|图像修复算法|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

无监督处理|国民大学|首尔大学|图像对齐|图像修复算法|多模态视觉|人工智能

你有没有过这种拍照遗憾:同一场景,一张构图完美但糊成马赛克,另一张清晰锐利却拍歪了电线杆?过去你得先手动对齐两张图,再分别降噪、锐化,折腾半小时还可能把边缘修得歪歪扭扭。现在,韩国首尔大学和国民大学的团队搞出了一套算法,只需要把这两张图丢进去,不用提前训练专用模型,现场就能让修复和对齐两个任务互相帮忙,最终出来的图,比单独做任何一件事效果都好。这背后的逻辑,其实是给算法加了个临时的「翻译官」。

传统修图的逻辑是「先对齐,后修复」:先靠匹配算法找两张图里的对应点,算出几何变换关系,把糊图拉正对齐清晰图,再用修复算法补细节。但这里有个死循环:如果糊图太模糊,匹配算法根本找不到正确的对应点,拉出来的图可能歪得更离谱;反过来,要是对齐不准,修复算法也没法参考清晰图的纹理,只能凭空瞎补。

举个例子,你拍了一张糊掉的猫脸和一张清晰的猫脸,匹配算法可能把糊图里的猫鼻子对应到清晰图的猫眼睛上,修复出来的猫脸直接变成四不像。这不是算法不行,是两个任务本来就不该各干各的——修复需要知道「哪里对应哪里」,对齐需要知道「原本应该长什么样」,它们是互相依赖的共生关系。

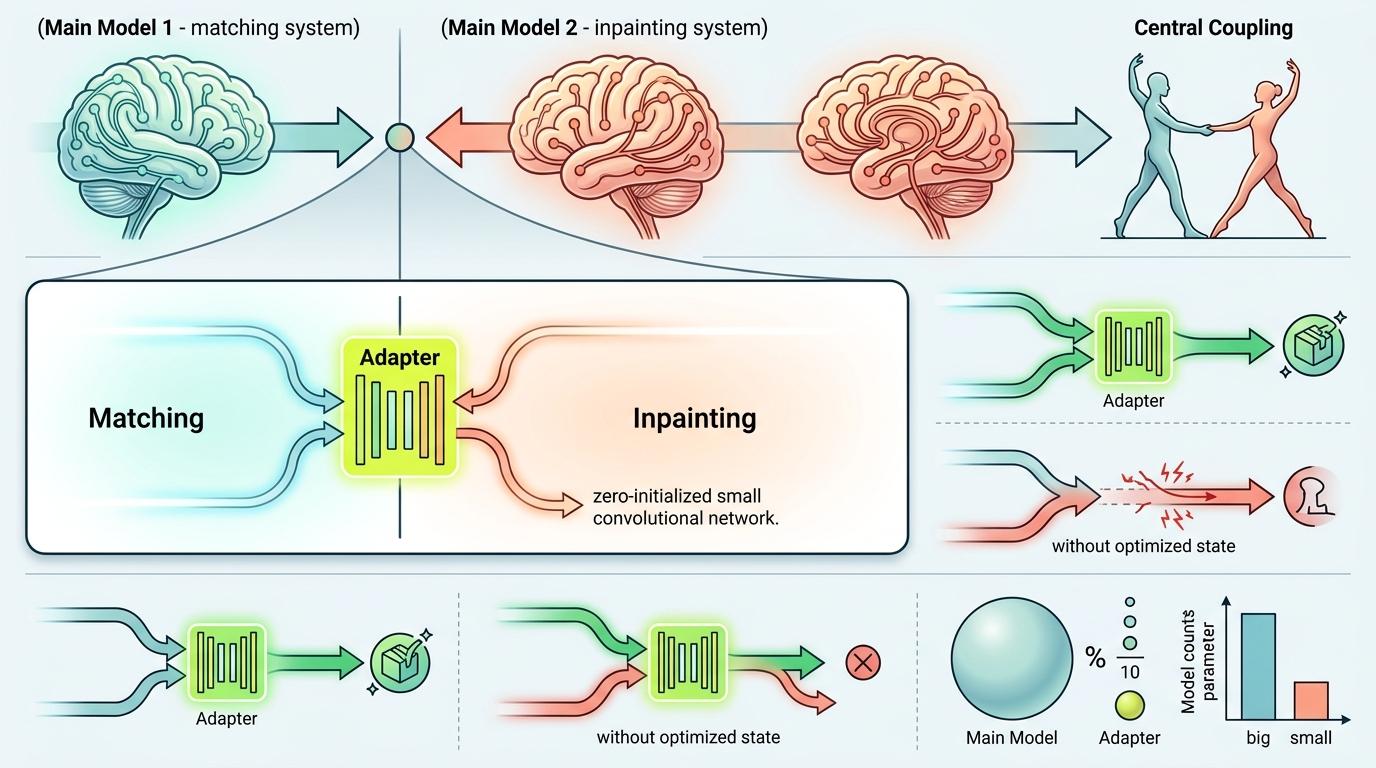

这套叫MatRes的算法,核心就是给匹配和修复两个系统加了个轻量级的「适配器」——一个零初始化的小型卷积网络,参数量不到主模型的5%。它的工作原理像极了两个人跳舞:

整个过程只更新适配器的参数,主模型的参数完全不动,就像给一台老电脑装了个轻量化插件,不用重装系统就能提速。而且它是「零样本测试时自适应」——不需要提前用成千上万张图训练,就用你手里的这一对废片和好片,现场迭代十几步就能出结果。

在超分辨率、去噪、去模糊三个主流任务的测试里,这套算法的提升是实打实的:用RoMa匹配算法加ESRGAN修复算法的组合,匹配精度提升了9.61个百分点,修复后的峰值信噪比(PSNR)从26.93涨到31.72——换算成肉眼可见的效果,就是糊成马赛克的猫脸能看清胡须,拍歪的风景能精准对齐地平线。

但它也有局限:如果两张图的差异太大——比如一张是猫,一张是狗,或者糊图根本看不清任何轮廓,匹配算法直接失效,这套互相帮忙的逻辑就断了;而且现在每对图需要迭代十几步,用A100 GPU也要花点时间,暂时没法做到手机实时处理。不过研究者已经在想办法用元学习预训练适配器,把适配时间再压缩。

我们总习惯把复杂的问题拆成一个个小任务,逐个解决,但MatRes给了一个新的思路:有些任务天生就该互相帮忙。就像你修照片时,对齐和修复本来就是一回事——你要的从来不是「对齐的糊图」或者「修复的歪图」,而是「既对齐又清晰的图」。

未来的修图算法可能不再是一个个单独的工具,而是能理解你最终需求的智能助手:它知道你要的是一张好看的照片,而不是完成「对齐」「修复」这两个步骤。

任务的终点,从来不是完成任务本身。