对抗知识焦虑,从看懂这条开始

App 下载

AI终于看懂物理了,不止是画得像

AI视频生成|物理规律建模|MBZUAI|中山大学|ProPhy框架|AIGC|人工智能

2026年初,一段AI生成的视频在社交平台刷屏:海浪卷着泡沫拍上沙滩,火焰在木柴堆上跳跃,斧头落下时木屑飞溅——每帧画面都逼真得像真实录像。直到有人慢放三倍速:蜂蜜从虚空里源源不断冒出来,斧头劈中木柴的瞬间,木屑居然比斧头先飞了出去。这些细思极恐的“穿帮”,戳破了一个假象:此前的AI视频生成,只是在“模仿”世界的样子,从未真正“理解”世界为何这么运行。中山大学和MBZUAI的团队,用一个叫ProPhy的框架,第一次让AI跨过了从“画得像”到“守规矩”的门槛。

为什么AI以前学不会物理?

你可以把传统视频生成模型想象成一个只会背台词的演员——它能完美复刻动作和表情,却不知道台词背后的逻辑。它靠统计海量视频里的像素规律生成画面,比如“斧头落下后通常会有木屑”,但搞不懂“斧头的力如何让木屑飞起来”。

这就导致了两个核心bug:一是物理知识的“一锅乱炖”——它把燃烧、碰撞、流体的规律混在一起,生成的蜂蜜会像火焰一样蔓延;二是空间定位的“睁眼瞎”——它知道要生成“碰撞”,却搞不清碰撞该发生在哪个位置,斧头还没碰到木柴,木屑就先炸了。

直白点说,它是个优秀的模仿者,却是个糟糕的物理学家。

给AI请一群“物理专家”当老师

ProPhy的解决思路很简单:不让AI瞎猜,而是给它安排一群各司其职的“物理专家”。

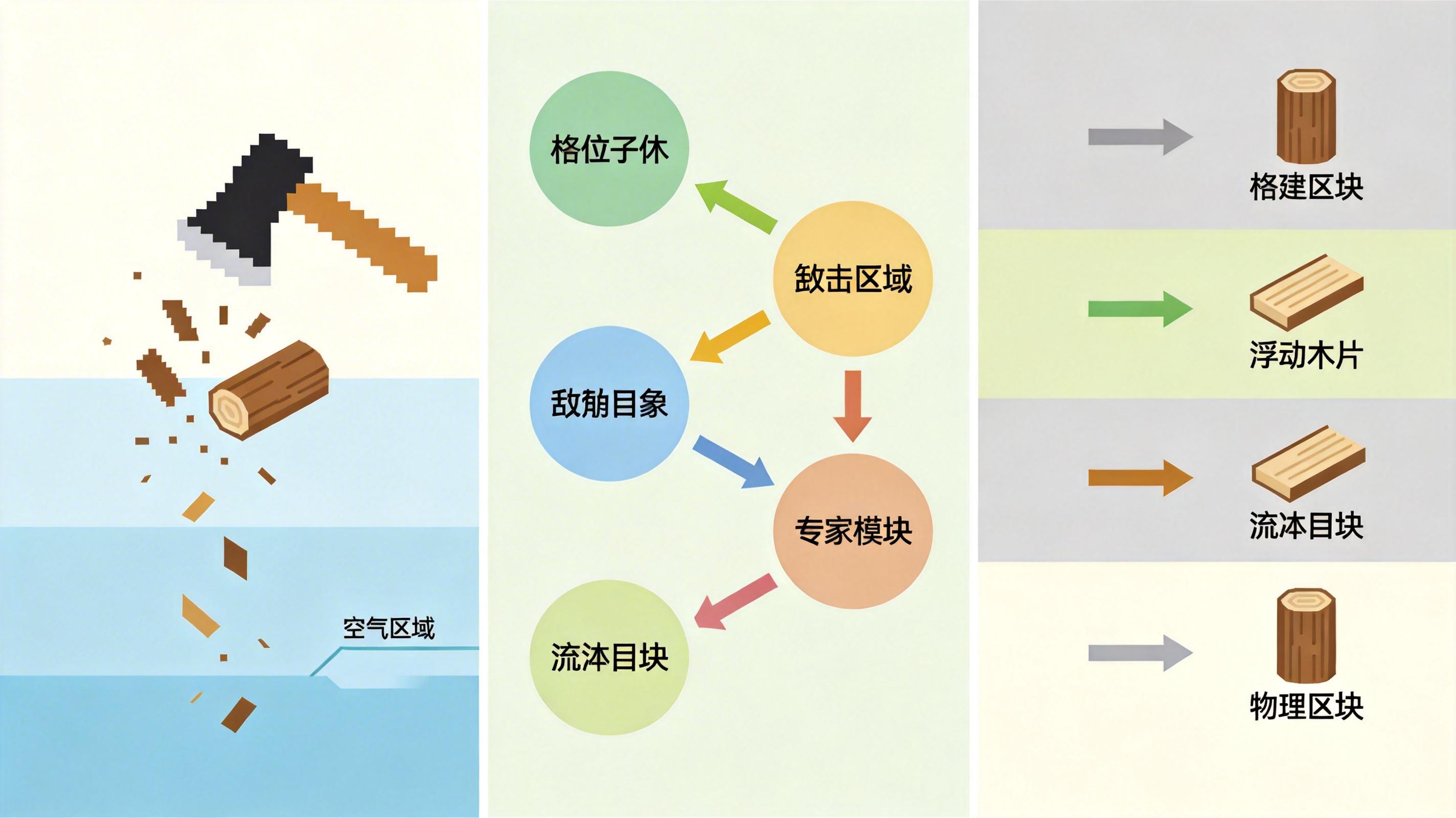

这是个两阶段的渐进式框架——先搞懂“是什么”,再搞懂“在哪里”。第一阶段是语义物理专家(SEB),它先读一遍用户的文本提示,比如“斧头劈柴”,然后调用对应的“碰撞物理专家”,明确这个场景要遵守的物理规则:力的传递、动量守恒、物体的刚性。这一步解决的是“该用什么物理规律”的问题。

第二阶段是细粒度物理专家(REB),它会给画面里的每个像素点(专业说法是token)分配对应的专家——斧头的部分归“刚性物体运动专家”,木柴的部分归“碎裂碰撞专家”,空气里的木屑归“流体运动专家”。这一步解决的是“物理规律该用在哪个位置”的问题。

更聪明的是,团队还借了视觉语言模型(VLM)的“眼睛”——这类模型擅长精准定位画面里的物理事件,比如“燃烧发生在木柴堆顶部”。他们把VLM的注意力图提取出来,当成物理定位信号喂给ProPhy,相当于给AI装了个“物理GPS”。

实验数据最有说服力:在权威物理常识基准VideoPhy2上,ProPhy的核心指标提升了19.7%,物理错误的出现频率下降了近40%。

这不是优化,是范式的跃迁

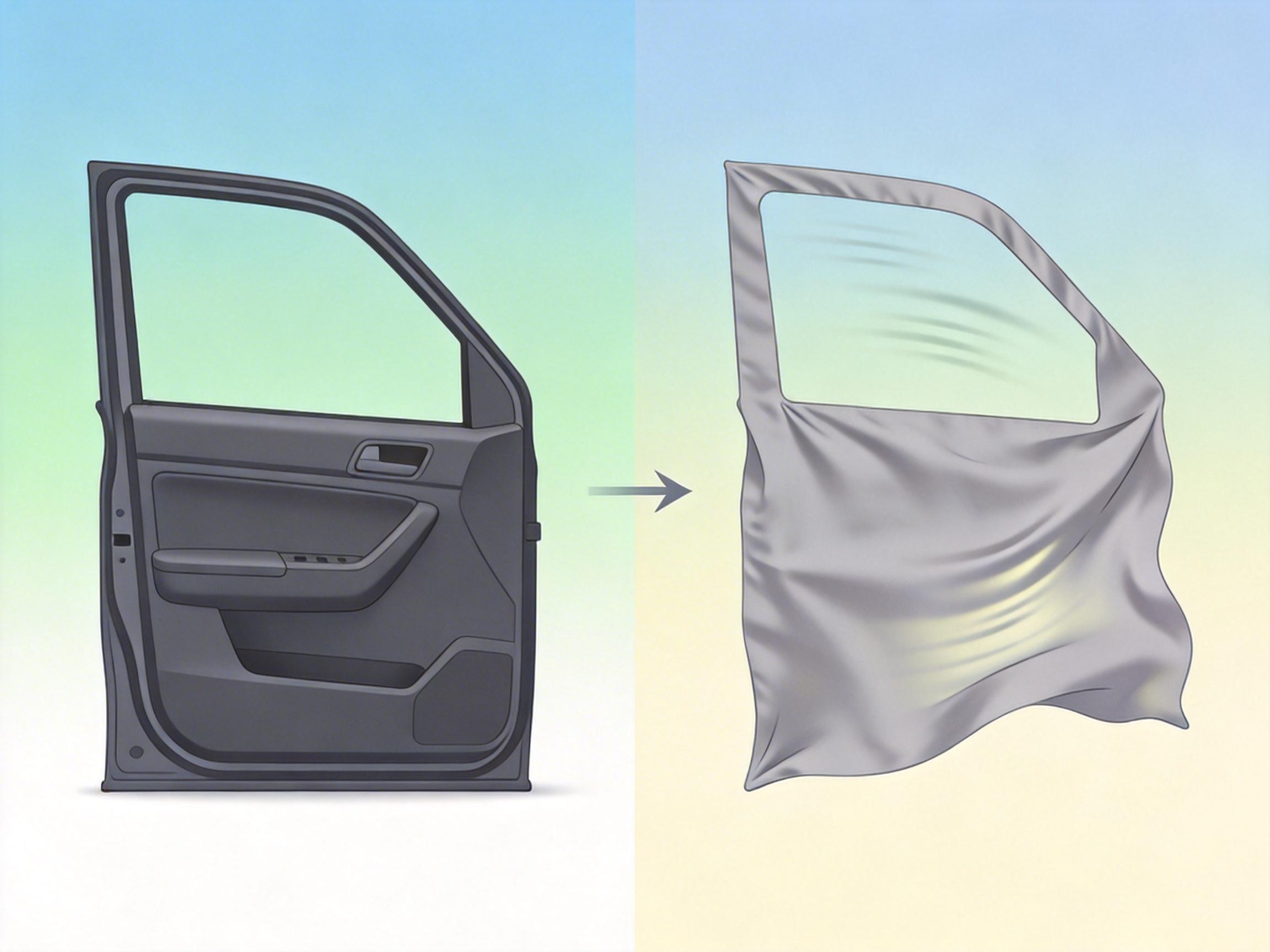

最有意思的是一个反常识实验:研究者人为反转了物理专家的权重,结果原本坚硬的汽车车门,居然像布料一样随风飘动。这说明ProPhy的每个专家,真的学会了独立的物理规律——不是模糊的像素模式,是可拆解、可操控的“世界规则”。

当然,它还有局限:现在只能处理“看得见”的表面物理规律,比如碰撞、燃烧,还没法模拟更底层的连续动力学,比如冰融化成水的分子运动;物理专家的知识也来自标注数据,难免有噪声。但这已经是关键的一步:AI第一次从“生成画面”变成了“模拟世界”。

打个比方,以前的AI是在画一幅风景油画,看起来像真的,但你没法走进画里;现在的ProPhy是在搭一个物理沙盘,你可以推一下里面的石头,它会按照重力规律滚下去。

当AI开始理解物理,它就不再是一个只会“创造视觉”的工具,而是开始具备“推演世界”的能力。未来,它可以给机器人生成无限接近真实的训练场景,给游戏打造完全符合物理规律的开放世界,甚至帮科学家模拟那些难以观测的物理现象——比如黑洞边缘的物质运动。

更重要的是,这是AI从“模仿人类”到“理解世界”的一小步。我们训练AI的终极目标,从来不是让它画一幅逼真的画,而是让它像人类一样,能看懂、能预测、能操控这个由物理规律支配的世界。

模仿是复制表象,理解才是掌握本质。