对抗知识焦虑,从看懂这条开始

App 下载

AI变聪明了,你的提示词却还在教笨学生

模型交互范式|Anthropic|OpenAI|提示词工程|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

模型交互范式|Anthropic|OpenAI|提示词工程|大语言模型|人工智能

你有没有过这种经历:刚升级完最新的GPT或Claude模型,兴冲冲输入用了半年的“万能提示词”,得到的结果却要么死板得像套模板,要么答非所问气得你想骂“降智”?

别着急骂模型。2026年5月,OpenAI和Anthoric几乎同时发布的官方指南,把真相摊在了桌面上:不是模型变笨了,是你还在用教“笨学生”的方法,指挥一个已经毕业的“优等生”。那些写满“第一步做A、第二步做B”的长提示词,在新模型眼里,就像对着一个程序员说“先打开电脑,再点开浏览器,再输入网址”——不是做不到,是这种手把手的指令,反而捆住了它的手脚。

要搞懂这种变化,得先回到提示词工程的本质——它从来不是“写一句话”这么简单,而是人类和AI之间的“翻译器”:把我们模糊的需求,转换成AI能精准执行的指令。

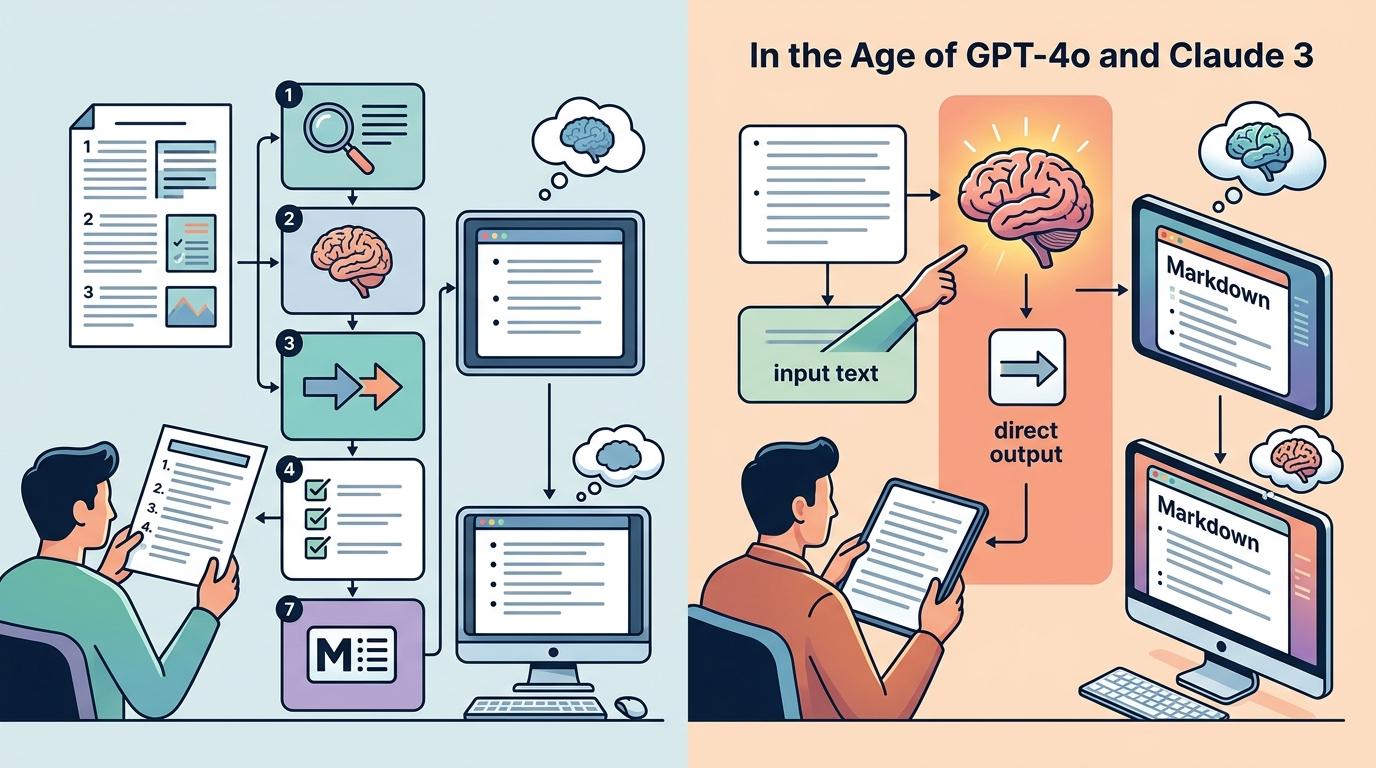

在GPT-4o和Claude 3的时代,这个翻译器得做“保姆”。那时候的模型就像刚入学的孩子,必须把任务拆成细碎的步骤:“先读这篇1000字的报告,然后用3个分点总结核心观点,每个点不超过50字,最后用Markdown列表输出”。少一个细节,它都可能跑偏。

但到了GPT-5.5和Claude 4.7的阶段,模型已经长成了能独当一面的员工。OpenAI在指南里直白地说:旧提示词的“过度流程指定”,会给新模型增加噪音,缩小它的思考空间。就像你给一个资深策划写SOP,反而逼得他只能产出标准化的平庸方案。

新的范式是“结果导向”:别再说“怎么做”,直接说“做成什么样”。比如把“先分析竞品的3个优势,再对比我们的产品,最后写一篇推广文案”,改成“写一篇能突出我们产品差异化优势的推广文案,目标是让读者看完就想点击购买”。剩下的分析、对比、措辞,交给模型自己去完成。

有意思的是,两家公司的新模型,还朝着两个看似相反的方向进化。

GPT-5.5变得“更懂变通”。它能从你模糊的描述里,快速抓住核心需求,甚至主动补全你没说出口的隐含要求。但如果你硬要给它套步骤,它就会像被绑住手脚的舞者,动作僵硬得失去灵气。

而Claude 4.7则变得“更认死理”。Anthoric在迁移指南里明确说,新版本会“字面化执行指令”,不再像以前那样主动“脑补”你的潜在需求。比如你说“帮我整理下这个文件夹里的文档”,以前的Claude可能会顺便帮你分类重命名,但现在它只会把文档按原格式列出来——除非你明确说“分类重命名”。

这种变化背后,是模型对齐方式的调整。GPT-5.5强化了“意图理解”,而Claude 4.7则优先保证“执行精度”。但不管哪一种,都指向同一个结论:你不能再用“猜我想什么”的模糊指令,必须学会“说清楚我要什么”。

比如你想让AI写一封求职信,别再说“帮我写一封好点的求职信”,要说“写一封突出我项目管理能力的求职信,目标岗位是互联网公司的产品经理,用简洁的职场语气,控制在300字以内”。

这种范式转变,还只是开始。随着多模态大模型的普及,提示词工程正在从“文本游戏”,变成“多模态协作框架”。

你可以把它想象成拍电影:以前你是给演员写分镜脚本,每一个动作、每一句台词都规定死;现在你是给导演定拍摄大纲,只说清楚故事主题、核心冲突和最终要达到的情绪效果,剩下的镜头语言、演员发挥,全交给专业的人。

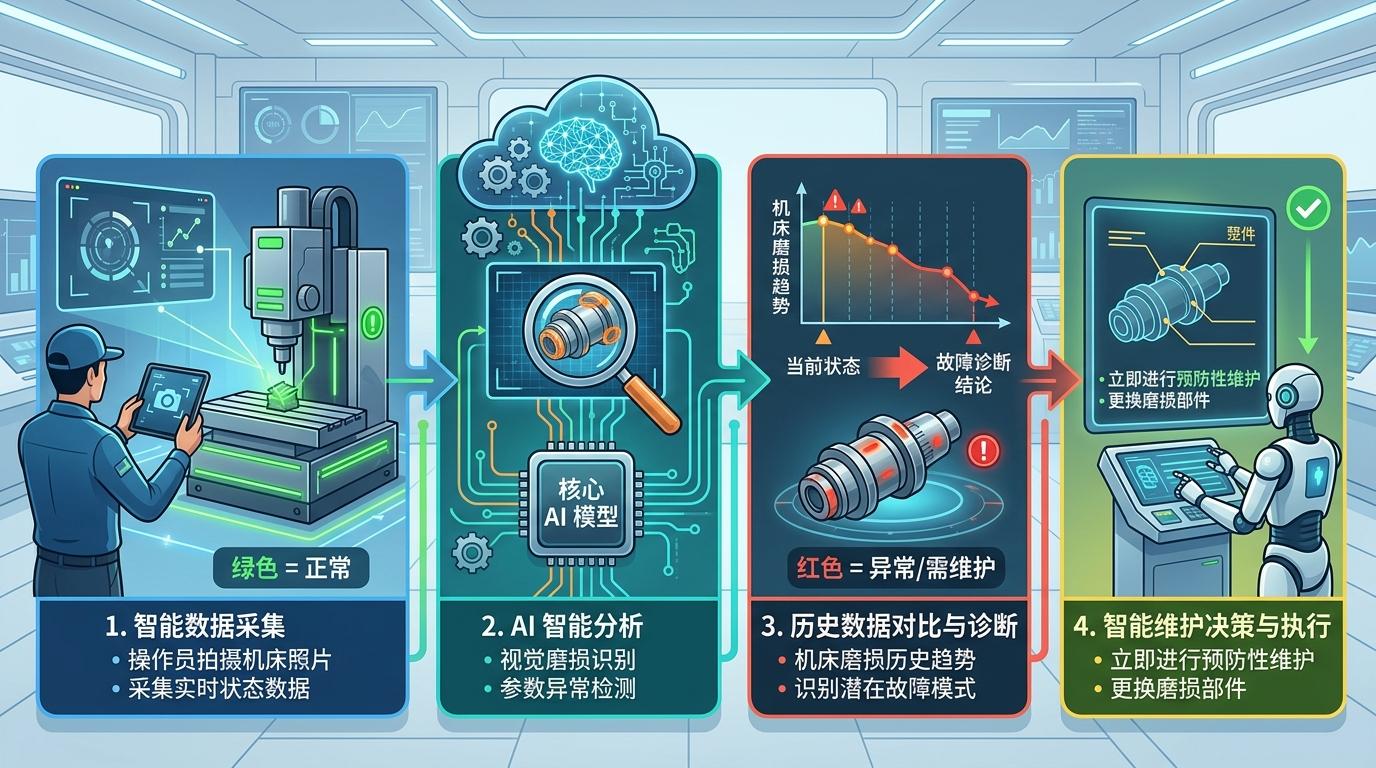

比如在工业制造场景里,你不用再写“先分析这张机床照片的磨损程度,再对比历史数据,最后给出维护建议”,只需要上传照片,说一句“帮我看看这台机床要不要维护,给出具体理由”——模型会自动调用视觉识别、数据对比、故障诊断的能力,完成一整套分析。

当然,这也带来了新的挑战:你得先搞清楚自己“到底要什么”。以前你可以靠模型的“脑补”掩盖需求的模糊,但现在,你越清晰地定义目标,模型能给你的惊喜就越大。

当我们还在纠结“怎么写好提示词”的时候,其实本质上是在适应一种全新的协作关系:AI不再是执行命令的工具,而是需要明确目标的合作者。

这种转变,就像从“指挥下属做事”,变成“和合伙人一起创业”——你不需要事无巨细地管过程,但必须清晰地定方向、划边界。

懂目标,比懂步骤更重要。 这句话不仅适用于和AI打交道,放在任何协作关系里,都是一样的道理。毕竟,真正能成事的人,从来不是那些只会走流程的人,而是能看清方向的人。