对抗知识焦虑,从看懂这条开始

App 下载

音乐家跨界做AI编程工具,凭啥爆火GitHub

DeepSeek模型|AI编程助手|Rust编程|Hunter Bown|DeepSeek-TUI|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

DeepSeek模型|AI编程助手|Rust编程|Hunter Bown|DeepSeek-TUI|AI产业应用|人工智能

五一假期的GitHub热榜,被一个终端里的AI编程工具霸了屏。短短两天星标破2300,开发者们在评论区刷起了中文感谢。这个叫DeepSeek-TUI的工具,被称为「DeepSeek版Claude Code」,但它的作者不是硅谷大厂的技术团队,而是一个半路出家的美国音乐家——Hunter Bown。他曾当了3年乐队指挥,后来靠音乐里的「缺失基音」概念理解AI,用Rust写出了这款专门适配DeepSeek模型的编程助手。没人想到,一个跨界者的作品,能精准戳中全球开发者的痛点。

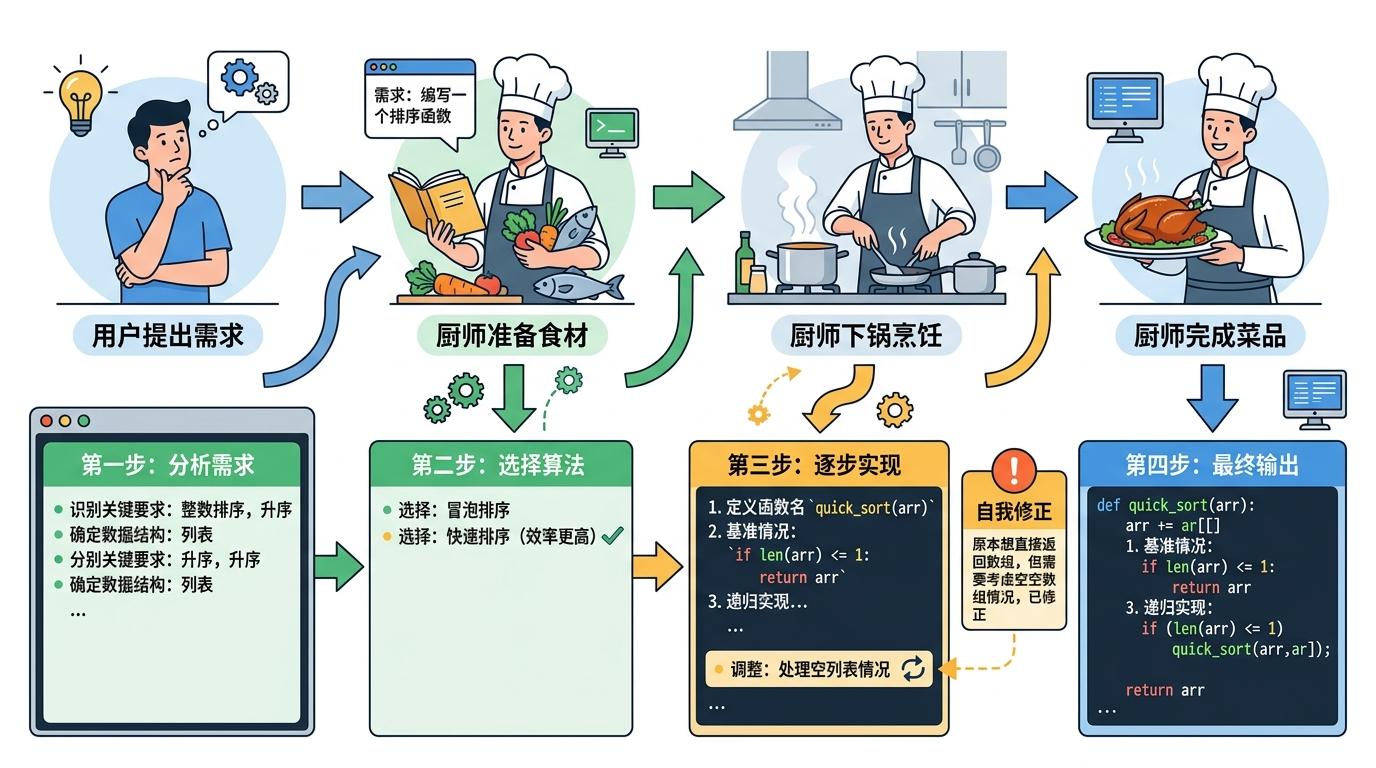

你可以把AI编程助手的推理链,想象成厨师做菜时的步骤念叨——从选食材、切配到下锅调味,每一步都讲给你听。DeepSeek-TUI就把这个「念叨」过程直接流式输出在终端里:模型怎么拆解你的编程需求,走了哪条推理路径,中途有没有推翻重来,全部实时可见。

这不是花架子。过去的AI编程工具像个黑箱,你输入需求它输出代码,出错了根本不知道问题出在哪。而推理链的透明化,相当于给开发者开了个「上帝视角」——你能跟着AI的思路排查bug,甚至在它走偏时及时拉回正轨。

更关键的是,这一切都围绕DeepSeek模型的特性设计。DeepSeek V4支持百万token的超大上下文窗口,DeepSeek-TUI直接把这个能力用满——处理复杂的跨文件编程任务时,不用反复切换上下文,模型能从头到尾记住所有细节。当上下文快装满时,它还会自动触发压缩,而且专门照顾DeepSeek的前缀缓存机制:尽量保住前面稳定的代码片段,让缓存能继续命中,把重复计算的成本砍到最低。

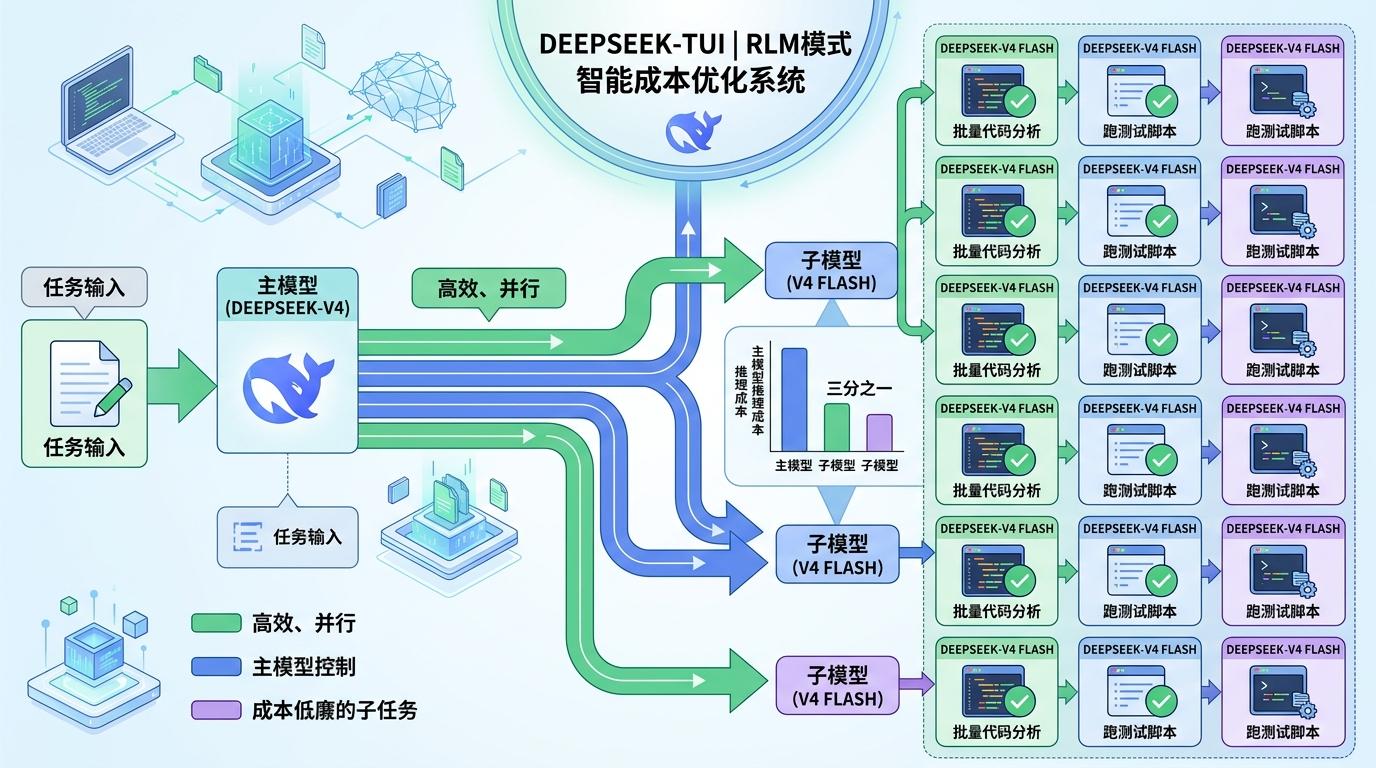

DeepSeek-TUI最聪明的设计,是把DeepSeek的「便宜」用到了极致。它搞了个RLM模式:一个主模型指挥最多16个DeepSeek V4 Flash子模型同时干活。这些子模型的推理成本只有主模型的三分之一,适合批量分析代码、跑测试脚本这类不需要强推理的脏活累活。

你可以把这套逻辑想象成公司的项目组:主模型是项目经理,负责拆解任务、把控方向;子模型是实习生,专门处理重复且标准化的工作。既保证了核心任务的质量,又把人力成本压到最低。有开发者算了一笔账,用这套组合处理日常编程任务,成本只有Claude Code Max的2.3%,速度还快了近30%。

当然,它也不是全能的。处理跨14个服务的数据库字段重命名这类复杂全局重构任务时,DeepSeek-TUI偶尔会漏掉间接引用,需要人工补漏。而且开太多子模型时,缓存命中率会下降——未命中的token成本是命中的10倍,跑长会话时得盯着费用面板,不然账单可能会给你惊喜。

Hunter Bown的跨界,不是一时兴起。他学音乐时接触到「缺失基音」概念:人耳能从泛音里重建出一个物理上不存在的音高。后来他发现,这和AI的信息补全逻辑如出一辙——不需要给出所有信息,系统自己就能补全缺失的部分。这个从音乐里来的直觉,成了他理解AI的钥匙。

他把这种思路用到了DeepSeek-TUI的设计里:AI不需要记住所有代码细节,只要抓住核心的「基音」——也就是代码的逻辑框架和关键依赖,就能补全剩下的内容。他甚至用曾祖父的经历给自己打气:曾祖父是贝尔实验室的无线电先驱,业余喜欢录音;他是音乐家,却一头扎进了AI。「他是科学家,爱音乐;我是音乐家,爱科学。」

现在,他创立的Shannon Labs还在做更多跨界的事:把太阳风数据转成声音,用辩证逻辑做推理引擎,为AGI时代搭基础设施。DeepSeek-TUI只是他众多实验中的一个,却意外成了连接全球开发者的桥梁——为了推广这款工具,他特意用DeepSeek把推文翻译成中文,还建起了QQ群和国内开发者互动。

DeepSeek-TUI的爆火,本质上是开发者对「好用又便宜」的AI工具的集体投票。它没有喊出「颠覆编程」的口号,只是把DeepSeek的特性拆解成一个个能落地的功能:透明的推理链、不中断的上下文、能省成本的多模型协作。

从乐队指挥到AI开发者,Hunter Bown的故事也在提醒我们:AI的创新不一定来自技术的最前沿,也可能来自跨领域的直觉——就像音乐里的「缺失基音」,总能在你意想不到的地方,补全技术的空白。

跨界者的直觉,往往是技术的破局点。