11 天前

11 天前

让GPT-4给两篇文章打分,A拿4分、B拿3分——按常理A肯定更好对吧?但换成两两PK,同一个模型却斩钉截铁说「B更好」。更离谱的是还会出现A>B>C>A的「石头剪刀布」循环,连基本的逻辑传递性都守不住。这种「翻供式评分」不是个别bug,北大、清华等八校团队统计发现,用Llama-3.1-70B当裁判时,每4次评估就有1次前后矛盾,传递性混乱的概率也高达15.22%。现在,他们在ICLR 2026上提出的TrustJudge框架,把这个棘手的问题给解决了——不用额外训练,只是把模型藏在「离散分数」背后的完整概率分布挖出来用,评估不一致性直接降了一大截。

要理解TrustJudge的妙处,得先搞懂AI评分反复横跳的根源。传统的LLM评估就像老师改卷只给整数分——两条质量分别是3.8和4.2的回复,在5分制下都会被打4分,细微差异被硬生生抹平。但模型心里其实门儿清这0.4的差距,等你让它两两PK时,它就会如实说「后者更好」,矛盾就这么来了。

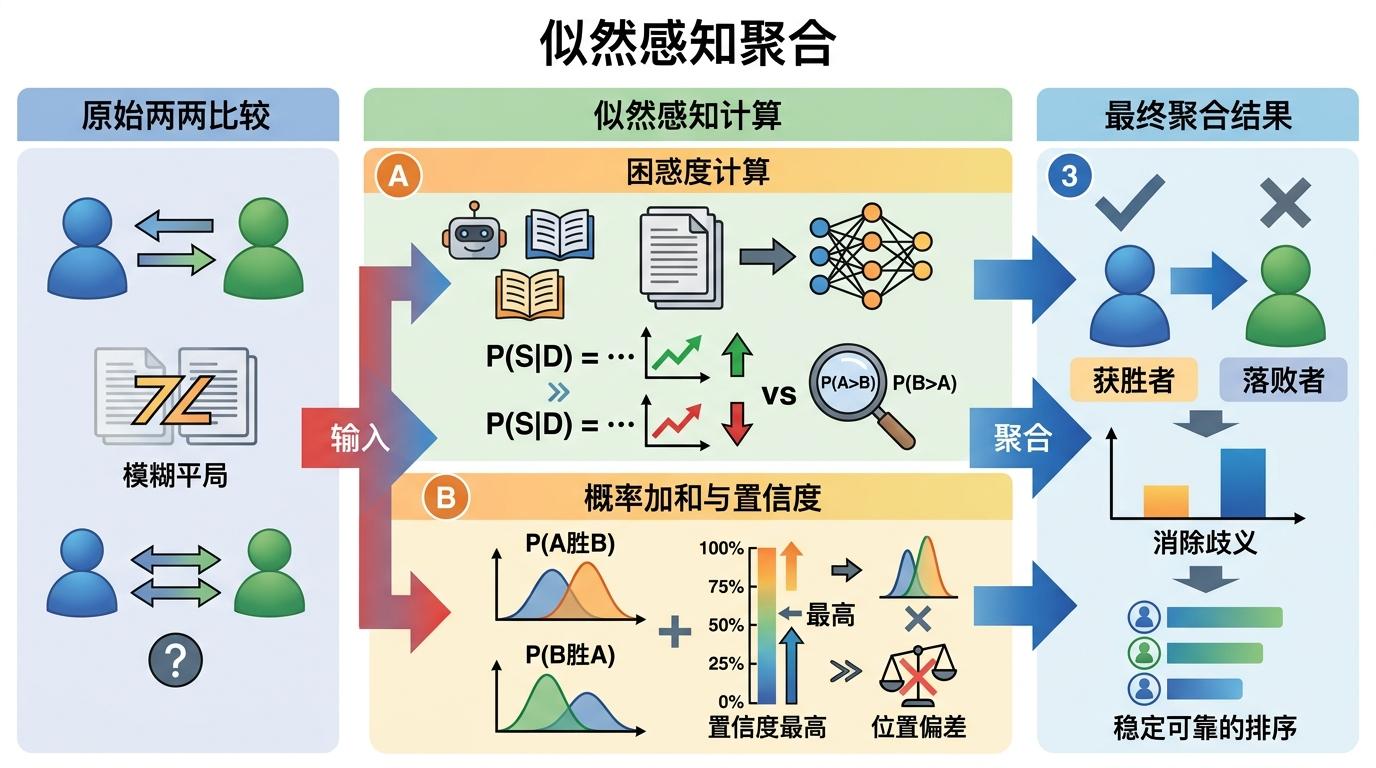

更麻烦的是「模糊平局」:当两条回复质量接近时,模型经常会给出「差不多」的判断,但这里的「差不多」分两种——一种是真的难分伯仲,另一种是模型自己拿不准。这些含糊的判断在不同组合里随机出现,就会闹出A=B、B=C但A≠C的笑话,彻底打破逻辑传递性。

简单说,传统评估只取了模型判断的「冰山一角」,把连续的判断硬塞进离散的格子里,信息丢了,一致性自然也就没了。

TrustJudge的核心思路说穿了很简单:别只拿模型吐出的那个整数分数,把它心里的完整概率分布给挖出来。这个框架分两块,精准解决了刚才说的两个问题。

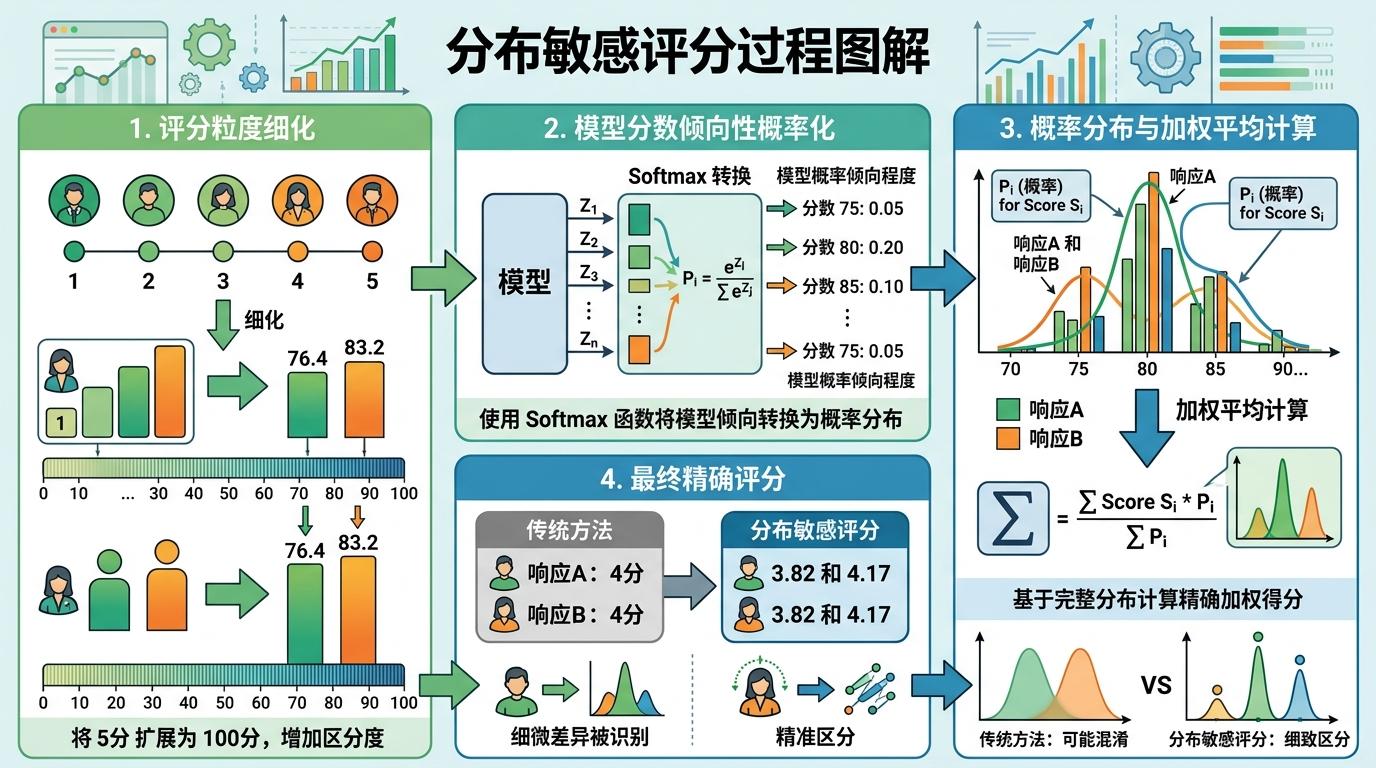

第一块是**分布敏感评分**——先把评分粒度从5分拉到100分,给足区分空间,再把模型对每个分数的「倾向程度」用softmax函数转换成概率分布,最后算一个加权平均分。比如之前都被打4分的两条回复,现在会算出3.82和4.17的精准分数,细微差异再也不会被埋没。和传统方法不同的是,它用softmax归一化确保概率和严格为1,不会被无关信息干扰,相当于把AI心里的「小算盘」彻底摊开了。

第二块是**似然感知聚合**,专门对付两两PK里的模糊平局。要么算两种排序的困惑度——模型读起来更通顺的排序,判断往往更靠谱;要么把A胜B和B胜A的概率加起来,取置信度最高的结果,连位置偏差都能顺便抵消掉。

而且这套方法完全不用额外训练,开箱就能用。实验显示,Llama-3.1-70B的评分矛盾率从23.32%降到14.89%,传递性混乱率从15.22%直接压到4.40%,准确率还跟着涨了。

TrustJudge的用处远不止给AI当「公正裁判」,把它接到强化学习里当奖励信号,效果同样惊喜。

团队用它给GRPO算法喂奖励信号,训练Qwen2.5-7B-Instruct模型,覆盖摘要、数学推理、指令遵循等8600条数据。结果很明显:用传统方法当奖励的模型,性能甚至比原始模型还略降了点;而用TrustJudge奖励的模型,所有任务的表现全涨了——道理也简单,评估越一致,奖励信号的噪声就越小,模型学起来自然更准。

有意思的是,专门练过推理能力的模型,当裁判时反而更容易「翻供」。比如DeepSeek-R1蒸馏版的评分矛盾率高达58.75%,是同规模Llama的两倍,但TrustJudge照样能把它的传递性混乱率从63.98%压到18.50%,相当于给「精神分裂」的AI裁判吃了颗定心丸。

当我们把大模型当成「AI裁判」时,总默认它该像人类专家一样逻辑自洽,但实际上,它更像个拿着模糊标尺的打分者——不是故意撒谎,只是我们没拿到它心里的完整标尺。

TrustJudge没有创造新的标尺,只是把藏在AI心里的、连续的、带概率的标尺摊开给我们看。这看似微小的转变,却解决了大模型评估里最棘手的一致性问题。让AI说真话,先得让它把话说全。未来的AI评估,或许会从「追求单一准确分数」,转向「拥抱带不确定性的完整判断」——毕竟真实世界里,本就很少有非黑即白的答案。

点击充电,成为大圆镜下一个视频选题!