对抗知识焦虑,从看懂这条开始

App 下载

数据中心省电七成的秘密:把光芯片焊在CPU旁

800G数据传输|国产芯片厂商|数据中心能耗|光引擎封装|半导体技术|前沿科技

对抗知识焦虑,从看懂这条开始

App 下载

800G数据传输|国产芯片厂商|数据中心能耗|光引擎封装|半导体技术|前沿科技

当你刷着AI生成的视频、用大模型写方案时,千里之外的某座仓库里,数万片GPU正在以每秒万亿次的速度交换数据——它们的耗电量,可能比你家小区全年的用电量还高。

数据中心的电费账单正在以每年30%的速度膨胀,而传统铜线和光模块的能耗,已经摸到了物理极限:传输800G数据,一个光模块就要吃掉16瓦电,相当于3个手机同时充电。

最近,一家国产厂商交出了新的答案:把光引擎和计算芯片塞进同一个封装里,让电信号的传输距离从30厘米缩短到3毫米。测试显示,这套方案能把800G数据的传输功耗降到4瓦,直接砍掉70%。这不是实验室里的空想,样品已经通过了客户验证。但它真的能解决数据中心的能耗焦虑吗?

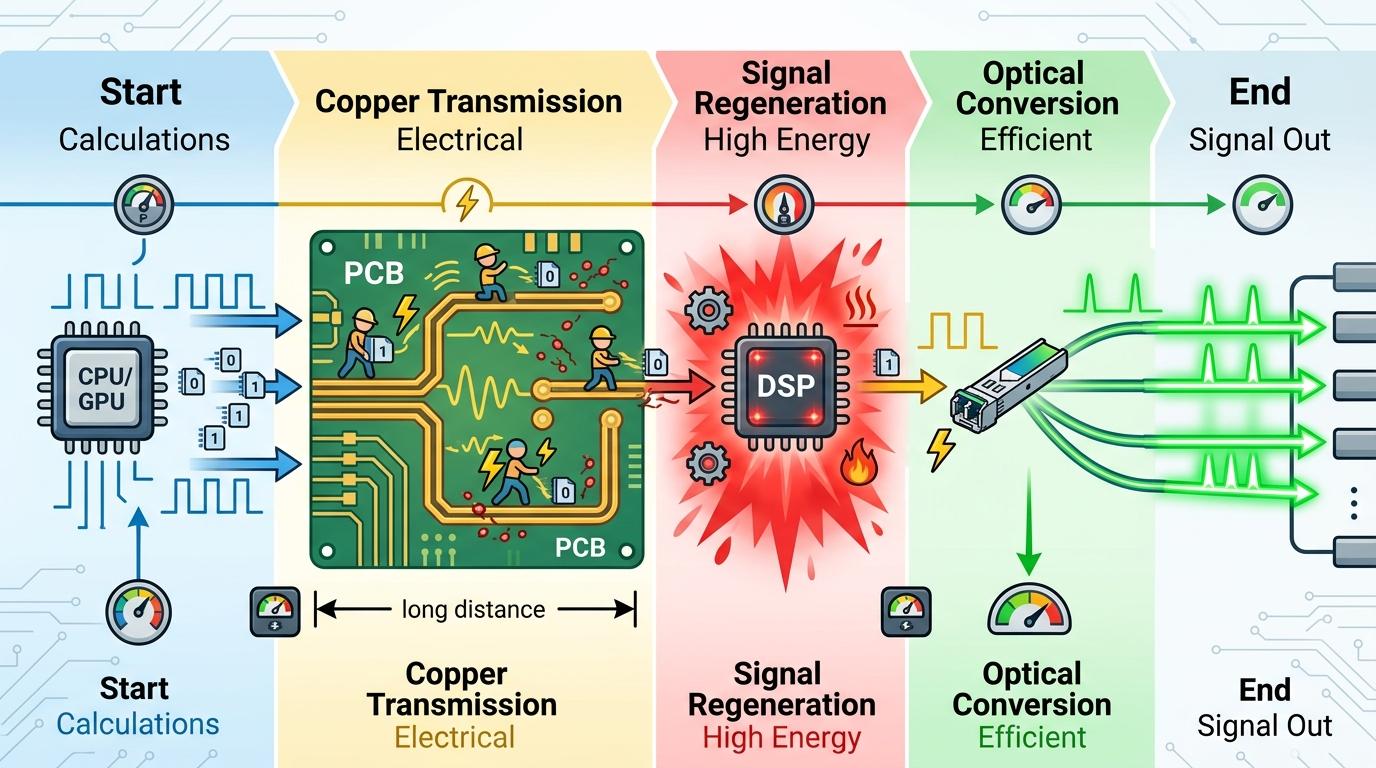

你可以把传统数据中心的信号传输想象成一场快递接力:计算芯片(CPU/GPU)把数据交给PCB板上的铜线“快递员”,跑30厘米到光模块“中转站”,转换成光信号后再送出去——每一次接力都要损耗能量,还要靠DSP芯片“快递站长”来修正信号误差,这部分能耗占了整个传输过程的60%。

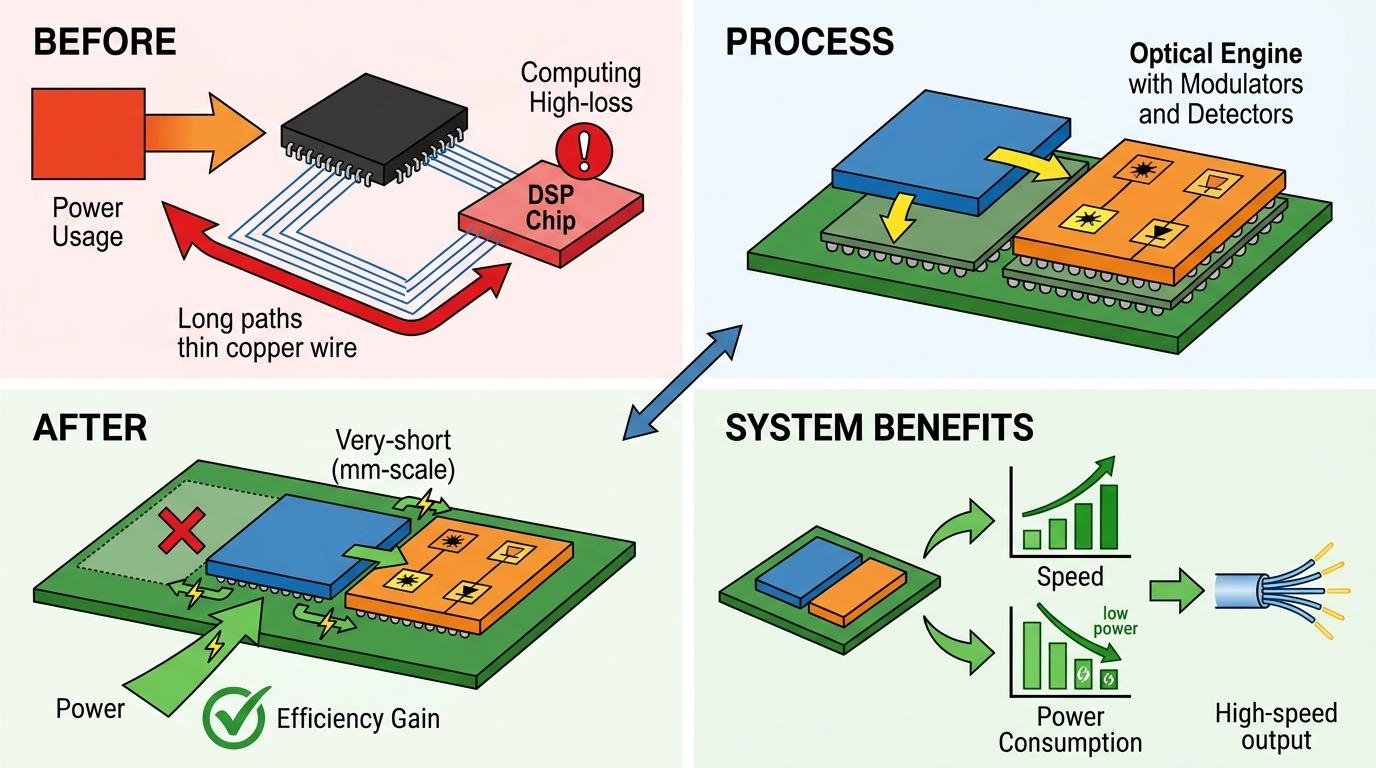

而共封装光学(CPO)技术,就是把光模块这个“中转站”直接搬到计算芯片的“楼下”。

真实的机制比这更精确:它将包含调制器、探测器的光引擎,通过2.5D封装技术和计算芯片集成在同一个基板上,电信号只需走几毫米就完成光电转换,彻底省去了长距离铜线传输的损耗,连功耗高昂的DSP芯片都能直接砍掉。

这不是简单的“凑近距离”:

更值得关注的是,CPO解决的不只是电费问题,更是AI集群的“带宽焦虑”。

训练一个千亿参数的大模型,需要上万片GPU同时工作,每一秒钟都要交换几十TB的数据。传统的铜线互连最多支持2米距离,超过这个范围,信号衰减会让整个集群的计算效率直接腰斩——就像一群人在操场上喊着传话,人越多、距离越远,错误率越高。

CPO的短距离互连打破了这个限制:

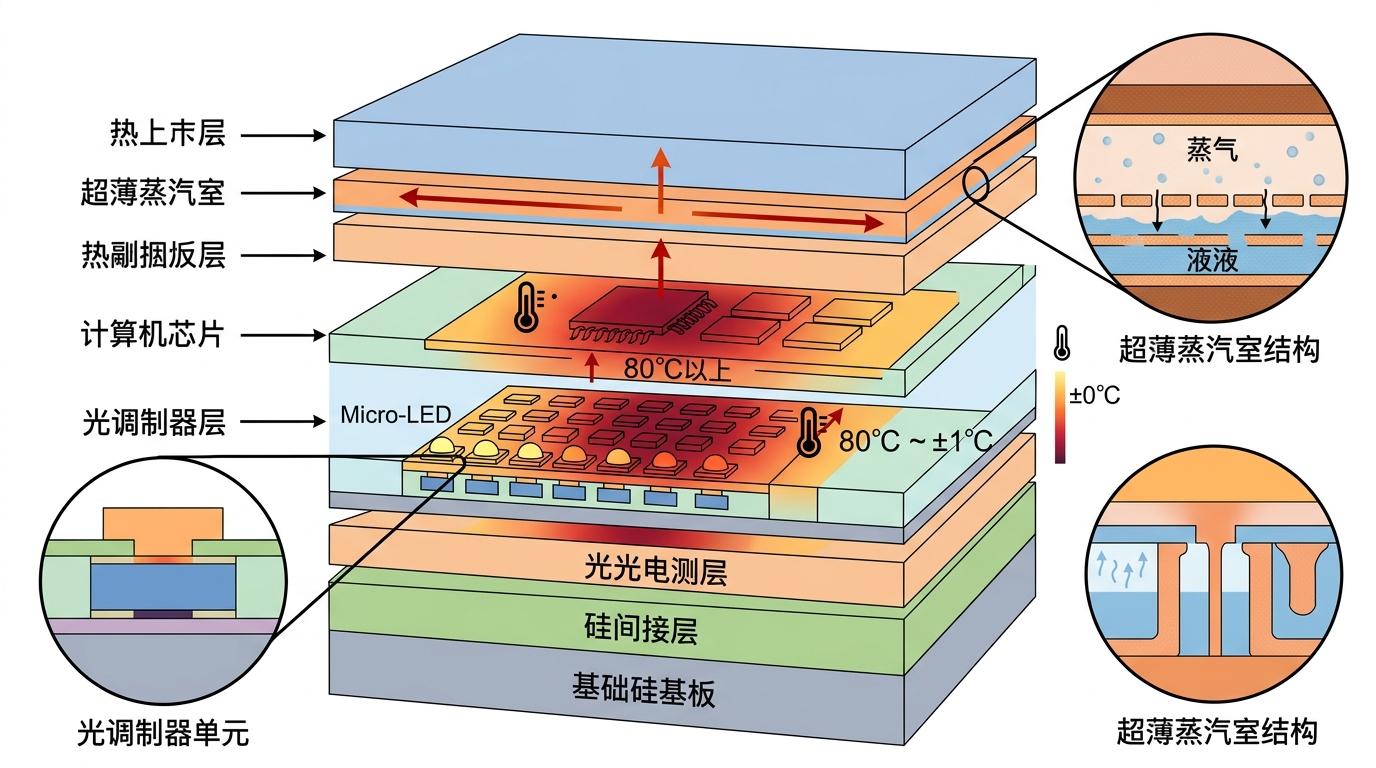

但这一切的前提是解决“热管理”这个棘手问题:光引擎和计算芯片挤在几平方厘米的空间里,局部温度会飙升到80℃以上,而光调制器的波长对温度变化极其敏感——哪怕只高1℃,信号误码率就会翻倍。目前的解决方案是在封装里集成超薄蒸汽室,把温度波动控制在±1℃以内,这又给制造工艺增加了新的难度。

被忽略的关键在于,CPO不是传统光模块的“终结者”,而是一场需要全产业链配合的“系统革命”。

首先是标准化的缺失:目前不同厂商的CPO接口、调制格式各不相同,就像不同品牌的手机充电器不能通用,这让数据中心运营商不敢轻易切换方案——一旦选用某家的CPO设备,未来的扩容只能继续买同品牌的产品。

其次是维护成本的上升:传统光模块坏了可以热插拔更换,而CPO的光引擎和芯片焊在一起,一旦出现故障,只能换掉整个交换机板卡,维修成本是传统方案的3倍以上。

还有制造良率的瓶颈:CPO需要把光芯片和电芯片精确对准,误差不能超过1微米,相当于头发丝直径的1/60,目前良率只有60%-70%,这直接拉高了产品成本——虽然光引擎本身的成本是传统模块的一半,但算上封装和测试成本,终端价格只比传统方案低10%左右。

也难怪有些运营商会选择“折中方案”:用线性可插拔光模块(LPO)先过渡,它去掉了DSP芯片,功耗比传统模块低40%,还保留了热插拔的便利性,适合中等规模的AI推理集群。

当我们为CPO的70%节能效率欢呼时,别忘了它的本质:不是某一项技术的突破,而是数据中心从“以计算为中心”转向“以互连为中心”的开始。

未来十年,AI模型的参数会从千亿级跃进到万亿级,数据中心的能耗会再翻3倍,而CPO只是第一步——我们还需要更高效的激光器、更智能的热管理系统、更开放的行业标准。

“算力的边界,终究是互连的边界。”这句话正在被越来越多的人验证:当计算芯片的性能提升遇到瓶颈时,如何让数据跑得更快、更省,才是下一场技术革命的核心。