对抗知识焦虑,从看懂这条开始

App 下载

智能驾驶的眼睛:激光雷达与视觉如何联手?

融合感知体系|侧向摄像头|点云数据|激光雷达|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

融合感知体系|侧向摄像头|点云数据|激光雷达|自动驾驶|人工智能

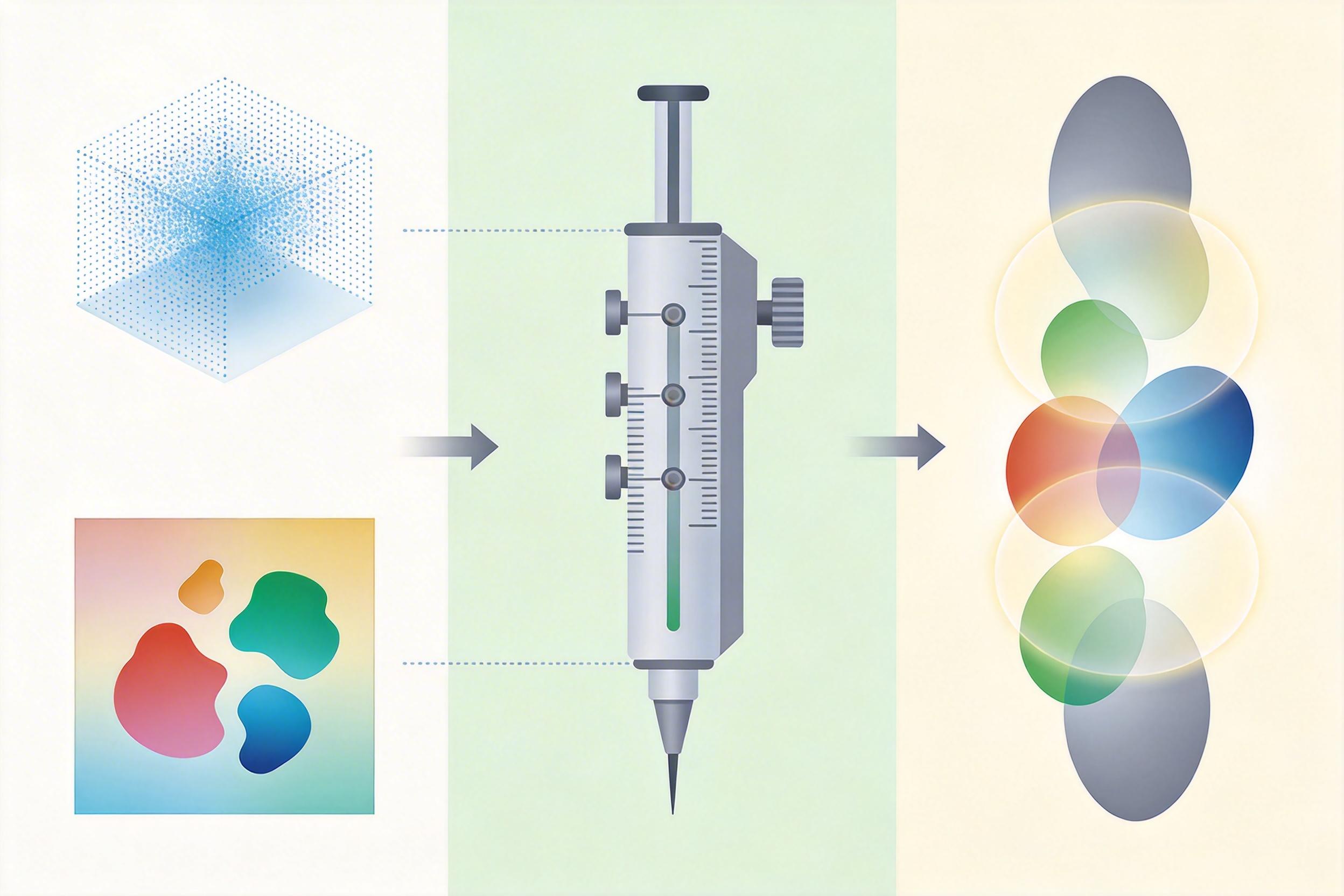

当一辆汽车在暴雨夜的城市路口精准避开突然窜出的电动车,它靠的从来不是某一只“眼睛”。2026年4月,一家国产厂商推出的新车型搭载6颗激光雷达与侧向摄像头,构建出360°无死角的融合感知体系——这不是简单的硬件堆砌,而是让两种完全不同的感知能力,像人的双眼与大脑一样协同工作。

激光雷达(LiDAR)是智能驾驶的“三维测距仪”,它每秒发射数百万束激光,通过计算回波时间生成点云数据,能以厘米级精度测出障碍物的距离、形状和位置,哪怕在伸手不见五指的黑夜也能稳定工作。但它有个致命弱点:看不懂“是什么”——点云里的模糊轮廓,可能是一块石头,也可能是一只流浪猫。

摄像头则是智能驾驶的“高清摄像机”,能捕捉丰富的颜色、纹理信息,轻松识别交通信号灯、路牌和行人。可它天生“近视”,只能通过算法估算距离,强光、逆光、雨雾天里,连眼前的障碍物都可能看走眼。融合感知的核心,就是让激光雷达的精准测距,补上摄像头的“视力缺陷”;让摄像头的语义识别,给激光雷达的点云数据贴上“标签”。

实现这种协同的第一步,是解决“对齐”难题。激光雷达的点云和摄像头的图像,来自不同坐标系、不同采样频率,稍有偏差就会出现“指鹿为马”的错误。工程师们通过高精度标定,把激光点云投影到图像平面,让每一个激光点都对应到图像里的像素点,再用Siamese网络等深度学习模型,把两种数据的特征在最底层融合。

但融合感知的挑战远不止于此。激光雷达的点云在远距离会变得稀疏,像被揉皱的草稿纸;摄像头在雨雾天里的图像,像蒙了一层毛玻璃。如何让融合系统在极端环境下依然可靠?如何在有限的车载算力下,实现30帧/秒的实时处理?这些都是从实验室到量产车必须跨过的坎。

更重要的是,融合感知不是终点,而是智能驾驶安全的基础。它能让车辆提前3秒预判到前方路面的坑洼,让主动悬架及时调整;能在交叉路口识别出被货车遮挡的行人,在事故发生前踩下刹车。

从单一传感器到融合感知,智能驾驶的“眼睛”正在变得越来越像人的眼睛——不仅看得远、看得清,更能看懂这个复杂的世界。感知越精准,出行越安全。