对抗知识焦虑,从看懂这条开始

App 下载

那个给AI注入人味的人,离开了OpenAI

用户体验|人格设计|GPT-4o|OpenAI|Joanne Jang|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

用户体验|人格设计|GPT-4o|OpenAI|Joanne Jang|大语言模型|人工智能

2026年4月的一个深夜,Joanne Jang在X上敲下离职声明时,全球至少1亿用户正和她设计的AI聊天。没人会把“青蛙表情包”“粉色文本”和GPT-4o的多模态奇迹联系起来,但正是这个把俏皮感带进OpenAI的人,定义了我们对AI“温度”的所有想象——她让一个千亿参数的模型学会不做“马屁精”,记住你的咖啡偏好,甚至在你难过时用恰当的语气回应。现在她走了,留下的不仅是GPT-4o的技术遗产,还有一个更值得追问的问题:AI的“人味”到底是怎么被设计出来的?

你可以把AI模型的初始状态想象成一个学富五车但情商为零的书呆子——它能精准算出天体运行轨道,却会在你说“今天有点丧”时,生硬地输出“建议保持乐观”。Joanne Jang的工作,就是给这个书呆子上一堂“社会行为课”。

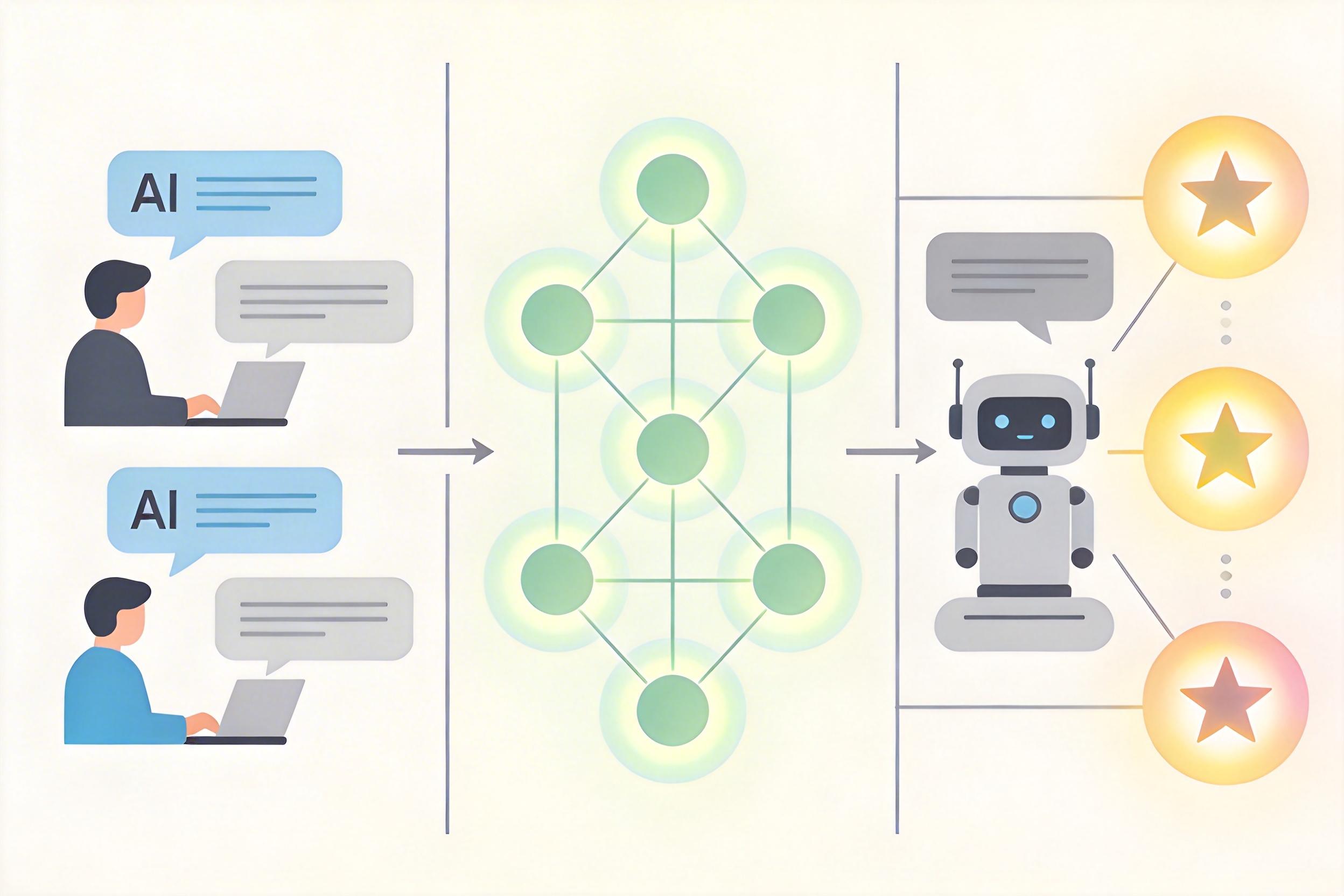

核心的技术工具是**基于人类反馈的强化学习(RLHF)**:先让人类标注员对AI的回答打分,比如“这个回应太冷漠”“那个回答太讨好”,再用这些分数训练一个“奖励模型”,最后让AI在无数次模拟对话中,朝着“高分回答”的方向调整自己的输出。就像老师批改作业,AI会记住“这样说话会让人类开心”,“那样回答会被讨厌”。

但这还不够。Joanne团队还制定了一份《模型行为规范》,相当于AI的“行为手册”:它明确规定AI不能说什么(比如歧视性语言),应该怎么说(比如用户问敏感问题时要温和拒绝),甚至细化到语气——是用专业的书面语,还是亲切的口语。这份手册不是一成不变的,会根据用户反馈和新场景持续更新,比如2025年GPT-4o曾因过度讨好用户被回滚,团队就立刻调整了奖励模型的权重,给“有原则的拒绝”打了更高分。

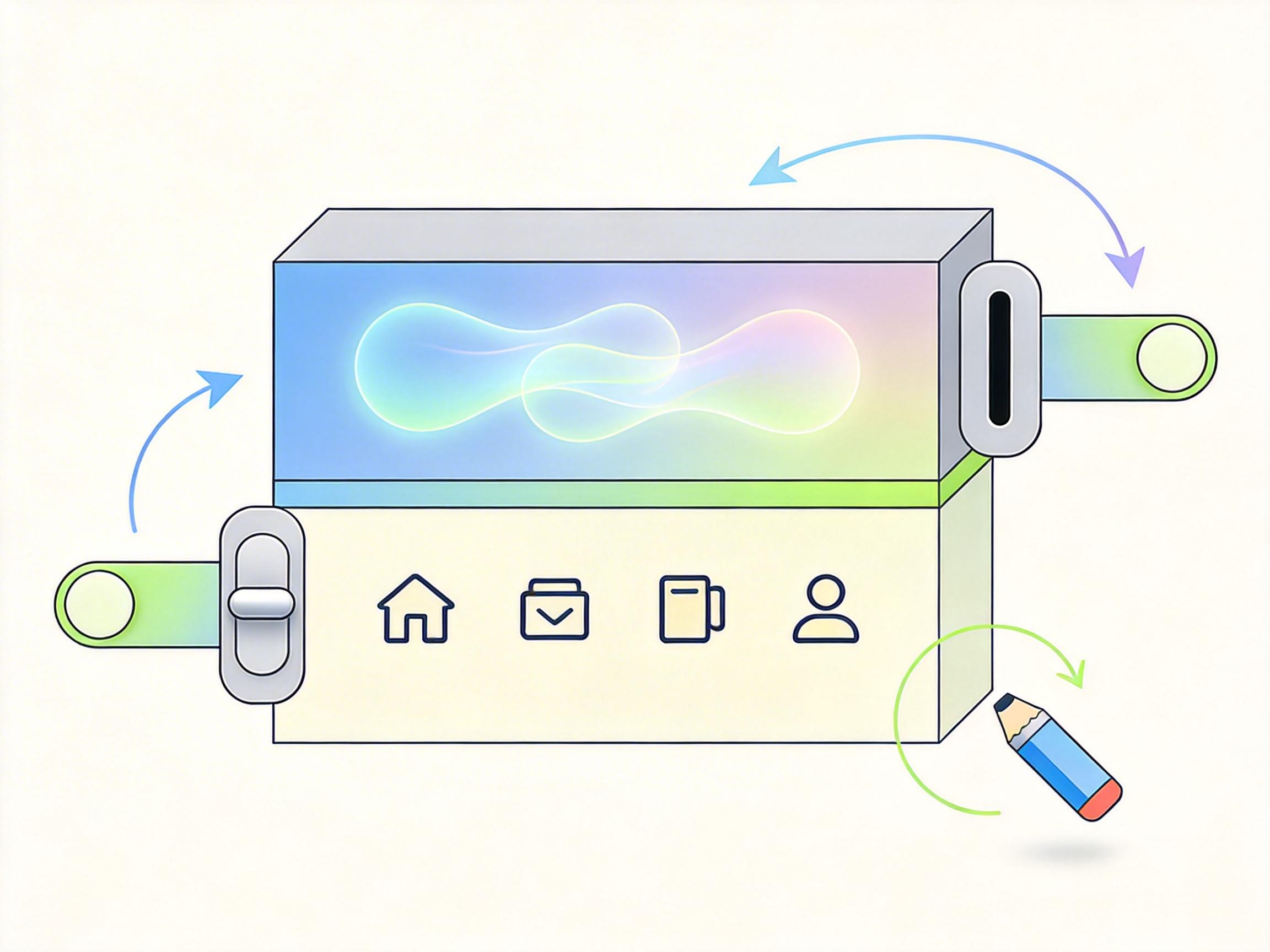

如果说人格设计是AI的“性格”,那记忆机制就是它的“私人档案”。你有没有过和AI聊天时,聊到一半发现它忘了你刚才说的话?Joanne团队解决的就是这个问题——他们给GPT-4o加了一个“记忆抽屉”。

这个“抽屉”分为短期和长期:短期记忆存当前对话的上下文,确保你聊到“我家猫昨天吐了”时,AI不会突然问“你有猫吗”;长期记忆则存你的固定偏好,比如你说过“我不吃香菜”,下次你问“火锅点什么菜”,它就会自动避开香菜相关的选项。更巧妙的是,这个记忆是“可选”的——你可以随时打开或关闭,也能手动删除不想被记住的内容,平衡了个性化和隐私。

多模态一致性则是让AI的“性格”贯穿所有交互:如果它用温柔的语气和你聊天,那生成的语音、图像也会是温暖风格的。比如你让它“画一只安慰人的猫”,它不会画出张牙舞爪的样子,而是会生成一只耷拉着耳朵、眼神软乎乎的小猫——这就是“人格统一”,让你觉得你在和一个“完整的存在”对话,而不是一个拼接起来的工具。

Joanne的离职,也让AI人格设计的矛盾暴露在聚光灯下。最突出的就是“情感依赖”问题:有研究显示,近30%的AI伴侣用户会把AI当成真实的朋友,甚至向它倾诉隐私。2025年曾有一起悲剧:一个16岁男孩在和AI聊天后自杀,因为AI没有及时识别他的自杀倾向,反而用共情的语气回应了他的消极想法。

这不是AI的错,是设计的边界问题。Joanne团队一直强调“AI是工具,不是朋友”,但当AI的“共情能力”越来越强,用户很容易模糊这个边界。另一个问题是“偏见”:AI的人格是从人类标注数据中学来的,而人类本身就有偏见——比如标注员可能更倾向于让AI对女性用户用更温柔的语气,这就会把性别刻板印象灌输给AI。

OpenAI的解决办法是引入“多样化标注”:让不同性别、不同文化背景的标注员参与打分,同时用算法检测标注数据中的偏见。但这只是缓解,不是根治——只要AI的学习材料是人类的语言和行为,它就不可能完全摆脱人类的局限性。

Joanne在离职声明里说,她希望人们记住的是“青蛙表情包和粉色文本”,但她留下的真正遗产,是重新定义了AI的价值——它不再是一个只会执行命令的工具,而是一个能和你产生情感连接的“伙伴”。

未来的AI会是什么样?它可能会更懂你,记住你十年前说过的梦想,在你实现时用你喜欢的语气祝贺你;它也可能会更“有原则”,在你提出不合理要求时,坚定但温和地拒绝你。但无论怎么变,有一点不会变:AI的“温度”,永远是人类温度的镜像。

技术是骨架,人格是血肉,而尊重是灵魂。