对抗知识焦虑,从看懂这条开始

App 下载

模型超市激战:云厂商抢平台,模型公司怕变管道

大模型公司|算力调度|打包订阅|云厂商|模型超市|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

大模型公司|算力调度|打包订阅|云厂商|模型超市|AI产业应用|人工智能

2026年4月的一个周三深夜,某开发者交流群里的吐槽刷了屏:有人刚用5小时限额搭建的Linux桌面雏形,因为触发系统限制戛然而止;有人连续刷新三次,还是等到了1分20秒才看到大模型吐出第一行代码。而就在一周前,他们还为每月40元就能调用多款头部大模型的“打包订阅”兴奋不已——毕竟单买一款主流模型的月费,都要超过这个数。这场从“占坑式订阅”到“集体吐槽”的反转,背后是一场正在重构AI产业的暗战:云厂商忙着把自己变成“模型超市”,而大模型公司们,正拼命躲开被挤成“管道”的命运。

你可以把“模型超市”的算力调度想象成高峰时段的城市地铁:早高峰所有人都往站台挤,调度员要在有限的车厢里塞下尽可能多的人,还要保证列车不晚点、不超载。但现实里的算力调度要复杂得多——不同大模型对GPU的需求天差地别,有的像空车跑通勤,有的像满载的货运列车;开发者的请求更是毫无规律,可能是凌晨三点的批量测试,也可能是下午两点的集中调用。

当一款订阅套餐里塞进了GLM-5.1、Kimi K2.6等五六款大模型,相当于用一条地铁线同时跑通勤、货运和城际列车。火山引擎的开发者们遇到的“5小时限额”,本质就是调度员手里的“限流牌”:系统检测到某个账号的请求数超过6000次,就会触发保护机制——不是不想让你用,是再挤下去,整条线路都要瘫痪。

但真实的技术细节比这个类比更残酷:不同模型的调用还有“抵扣系数”,比如GLM-5.1一次调用要扣5个额度,相当于一个人占了5个座位。这种设计本来是为了平衡算力成本,但在开发者眼里,就成了“低价套餐里的隐形门槛”——你以为买了通票,结果热门线路还是要额外排队。

云厂商们抢着做“模型超市”,绝不是为了给开发者发福利。阿里云、腾讯云、百度智能云在2026年集体跟进多模型订阅,本质是在抢AI时代的“流量入口”——就像当年的应用商店,谁掌握了开发者,谁就掌握了未来AI应用的分发权。

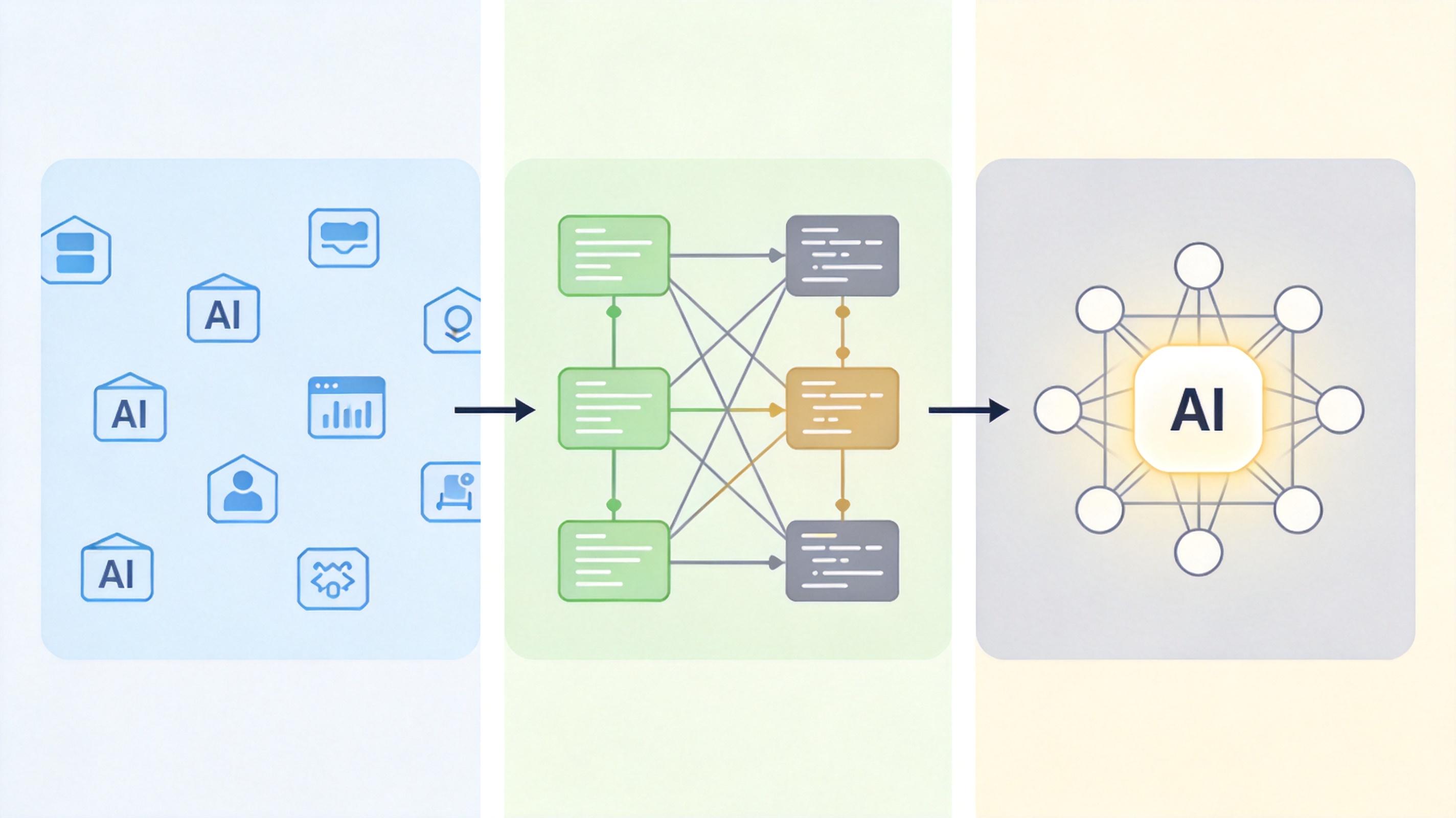

这种平台化的逻辑很清晰:开发者不用再挨个对接不同大模型的API,不用再为每个模型单独付费,只要在一个平台上就能搞定所有需求。对云厂商来说,这不仅能绑定开发者的算力消耗,还能拿到最珍贵的“使用数据”——哪些模型最受欢迎?开发者在什么场景下会切换模型?这些数据反过来又能优化算力调度,甚至反向影响大模型的迭代方向。

更值得关注的是,云厂商的“平台化”已经不止于模型聚合。阿里云的“百炼Coding Plan”开始整合数据处理、代码托管等工具;腾讯云的订阅服务直接对接企业办公系统。他们要做的不是“模型货架”,而是“AI开发的操作系统”——让开发者一进来就再也离不开。

当云厂商把“模型超市”越做越大,大模型公司们的焦虑也越来越明显:如果自己的模型只是超市货架上的一个商品,那和工厂里生产的零件有什么区别?用户只会记得超市,不会记得货架上的某个品牌——这就是“管道化”的可怕之处:失去用户连接权,失去定价权,最终变成别人生态里的一个“工具”。

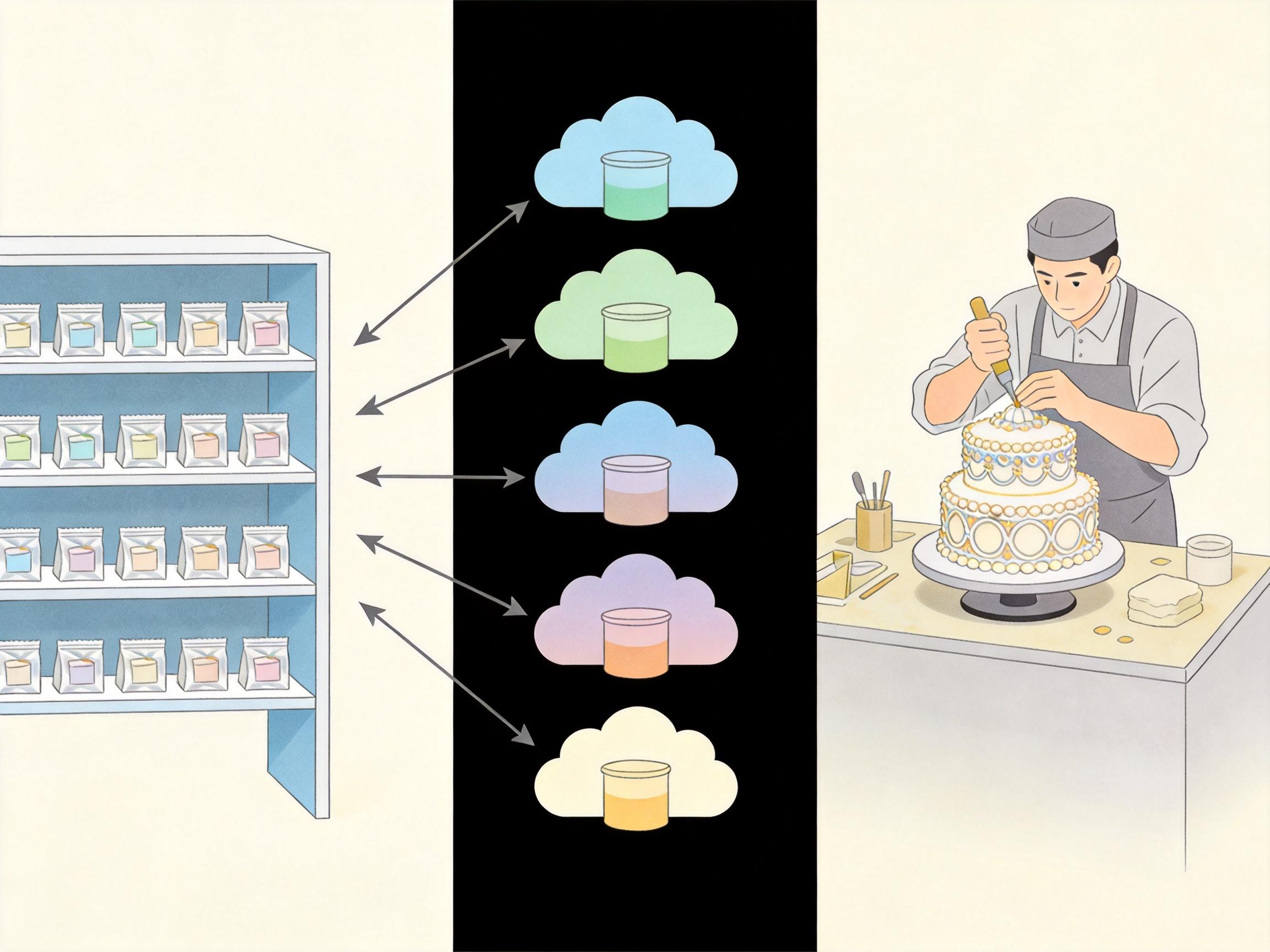

国内的头部大模型公司已经开始突围。智谱AI把目标瞄准了“全自治智能体”——不是让开发者调用模型写代码,而是让模型自己完成“8小时构建Linux桌面”“655轮优化数据库”这样的完整任务。相当于从“卖食材”变成“卖成品餐”,用户不用再自己动手,只要说要什么,就能拿到结果。

Kimi选择了“分散布局”,同时接入多家云平台的模型超市,不把鸡蛋放在一个篮子里;MiniMax则扎进了游戏AI、数字人等垂直场景——这些场景里的模型需要深度定制,云平台很难直接替代。就像超市里能卖标准化的零食,但卖不了私人定制的生日蛋糕。

Gartner的预测显示,到2029年,生成式AI领域的玩家会减少75%,市场将集中在少数几家巨头手里。这场模型超市的博弈,最终不会是“谁吃掉谁”,而是“谁能在生态里找到自己的不可替代位”。

云厂商的平台化,是要做AI世界的“基础设施”;大模型公司的反管道化,是要做这个基础设施里“有独特价值的零件”。就像地铁系统离不开轨道,也离不开能跑货运、能跑通勤的不同列车。

平台搭台,模型唱戏,各有各的底气。 这场暗战的结局,最终会定义未来十年AI产业的格局——而开发者手里的那40元订阅,就是这场战争最前线的选票。