对抗知识焦虑,从看懂这条开始

App 下载

中美AI竞赛真相:一半规模,两种逻辑

中美研发体系|学术统计偏差|清华大学|论文产出|ICLR 2026|商业经济|AI产业应用|社会人文|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

中美研发体系|学术统计偏差|清华大学|论文产出|ICLR 2026|商业经济|AI产业应用|社会人文|人工智能

当ICLR 2026的接收论文名单公布时,所有人都以为美国机构依然稳坐学术产出的头把交椅——毕竟那些主流统计平台的数据摆得明明白白。但乌克兰研究员德米特罗偏不信这个邪,他写了250条正则表达式,把5356篇论文的PDF挨个扒了一遍,从页眉页脚的缝隙里抠出真实的机构署名。结果让整个学术圈炸了锅:中国大陆机构贡献了43.7%的接收论文,美国只有31.9%;清华一家的论文产出,几乎是斯坦福和MIT的总和。更关键的是,这数据修正了一个藏了几十年的偏差:那些被算在美国头上的论文,很多其实是中国学生在五道口的深夜里熬出来的。为什么我们一直被错误的数字误导?这背后藏着中美AI研发体系最核心的分野。

你可以把传统学术统计系统想象成一个只会看「当前地址」的快递员:一个在清华读博时完成的论文,只要作者毕业后去了斯坦福,系统就会自动把这份「包裹」改派到美国。这种按「人」而非「成果诞生地」追踪的规则,硬生生把中国机构的贡献压低了至少15%。德米特罗的手动统计相当于给所有论文做了「出生证明」——他用正则表达式把「清华」「清华大学」「THU」这类同机构的不同写法合并,把那些被错归的论文重新送回了五道口、中关村和张江。

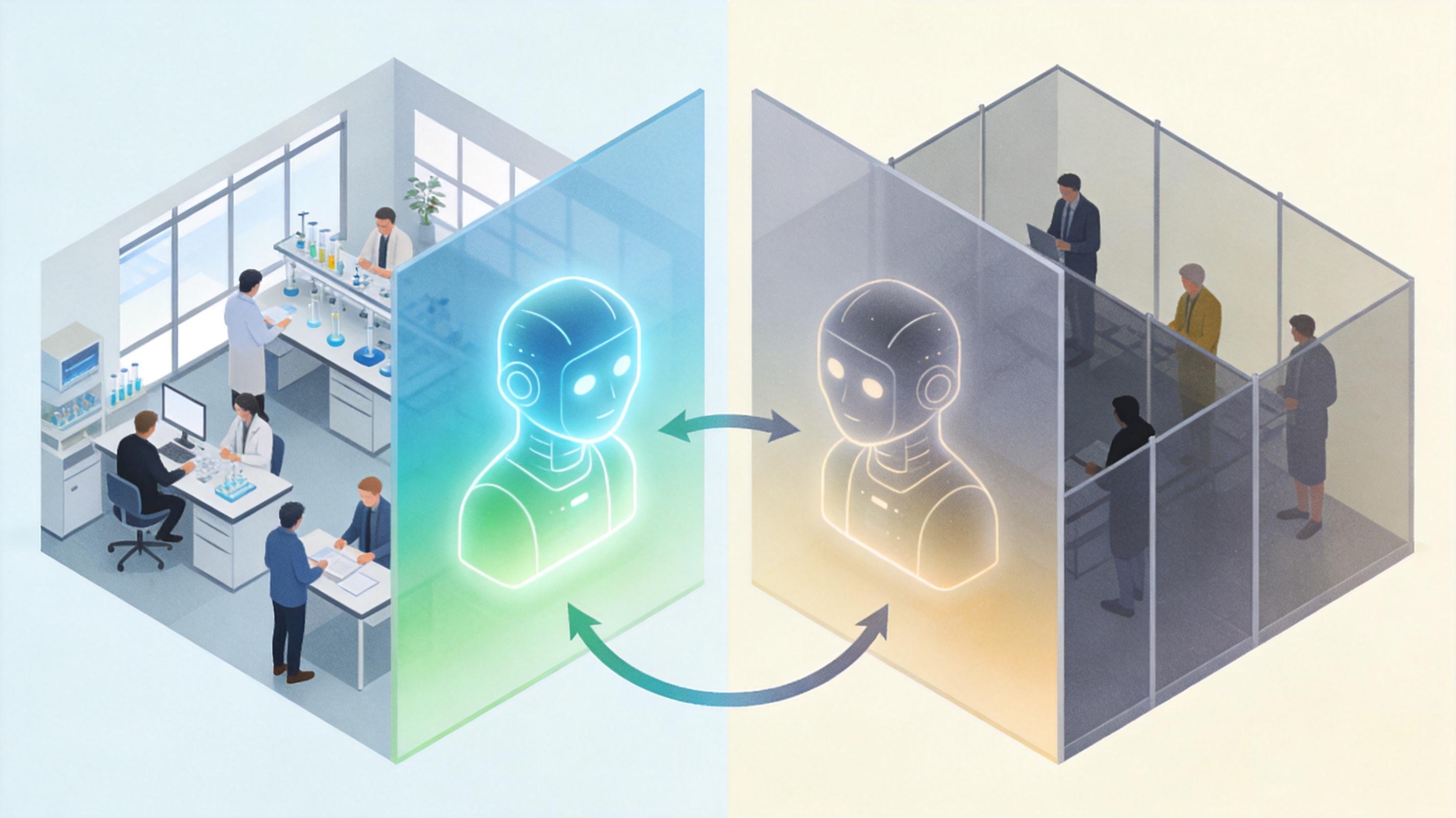

但真实的差距远不止统计偏差。当艾伦人工智能研究所的研究员内森·兰伯特走进北京和杭州的AI实验室时,他发现了更本质的不同:中国团队的协作像一支训练有素的工程队,而美国实验室更像一群各自为战的探险家。在国内的实验室里,刚入行的硕士生能直接参与大模型的核心调参,为了提升0.1%的准确率,所有人都愿意去做清洗数据、优化代码这种「脏活累活」;而在美国顶级实验室,实习生往往只能接触边缘项目,资深科学家为了坚持自己的研究路线,甚至会引发团队内耗。

你可以把中国AI研发的协作机制比作一家高效的连锁餐厅:总部定好菜单和流程,每个分店的厨师不用纠结创新,只需要把每道菜的火候、配料做到极致。这种「指标驱动」的文化,让整个团队的摩擦力降到了最低。兰伯特观察到,中国的年轻科研人员没有经历过前几轮AI泡沫的洗礼,他们不会执着于「我过去的方法才是对的」,只要数据证明新路线有效,就能立刻切换赛道——这种没有历史包袱的灵活度,让中国团队能以硅谷一半的成本,做出性能相当的大模型。

这种低摩擦协作的背后,是学术界和产业界几乎消失的壁垒。清华的教授可以直接去企业实验室带队,企业的工程师也能带着项目回到高校做研究。比如DeepSeek的团队,一半成员来自高校,一半来自企业,他们用稀疏注意力机制做出来的模型,性能接近GPT-5,但计算成本只有后者的三分之一。而美国的学术界和产业界之间,还隔着一道「专利墙」和「学术声誉」的门槛:大学教授担心和企业合作会影响自己的学术独立性,企业则害怕核心技术被泄露。

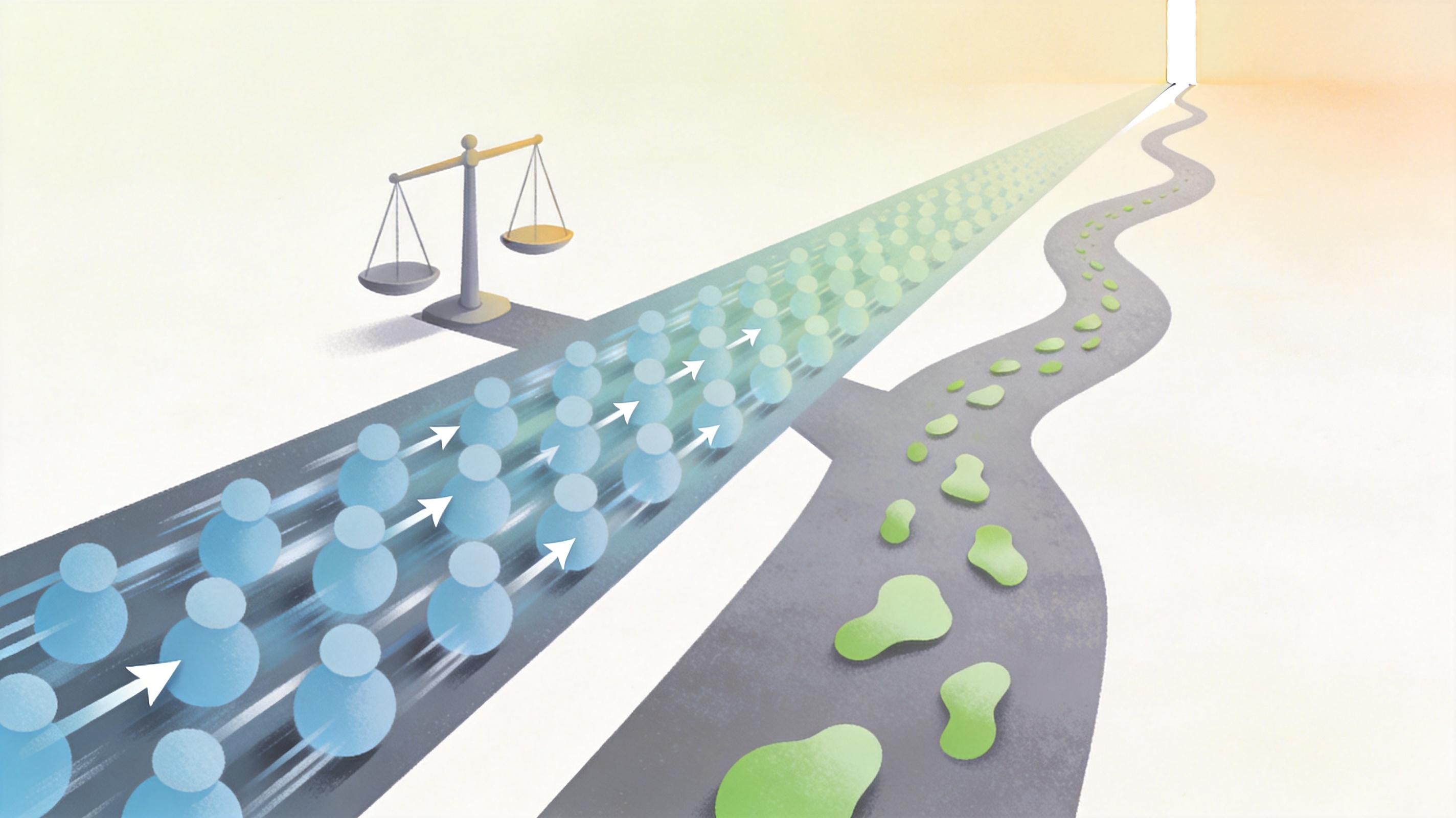

但中国的效率优势,也藏着一个隐忧:当所有团队都在盯着「指标提升」时,谁来做「没人做过的事」?在ICLR 2026的口头报告论文里——这部分通常代表最具原创性的研究方向——美国机构占了40%,中国只有30%。美国的研究员会花几个月时间去思考「AI能不能理解因果关系」这种看似没用的问题,而中国的团队更愿意去做「如何让AI更快地生成代码」这种能立刻落地的项目。

这种差异的背后,是两国创新驱动力的不同:美国的AI研发靠的是「好奇心驱动」,而中国靠的是「市场驱动」。美国的科研人员可以拿着企业的资助,去研究AGI的伦理问题,去探索大模型的极限;而中国的企业更关心「这个技术能不能帮我赚更多钱」。比如OpenAI会花几年时间去优化模型的安全性,而国内的团队可能会先把模型落地到电商客服、智能写作这些场景里。

当我们谈论中美AI竞赛时,我们其实在谈论两种不同的创新逻辑:一种是用规模和效率快速占领市场,一种是用原创和探索定义未来。德米特罗的统计数据告诉我们,中国已经在工程化能力上追上了美国,但内森·兰伯特的观察也提醒我们,原创性依然是我们的短板。

更值得关注的是,这两种逻辑并不是对立的。中国的效率优势可以让美国的原创技术更快地落地,而美国的原创探索可以给中国的工程化指明方向。在AI的世界里,没有绝对的赢家,只有互相成就的合作者。

效率落地,原创破局,竞合共生。这或许才是中美AI竞赛的最终答案。