7 天前

7 天前

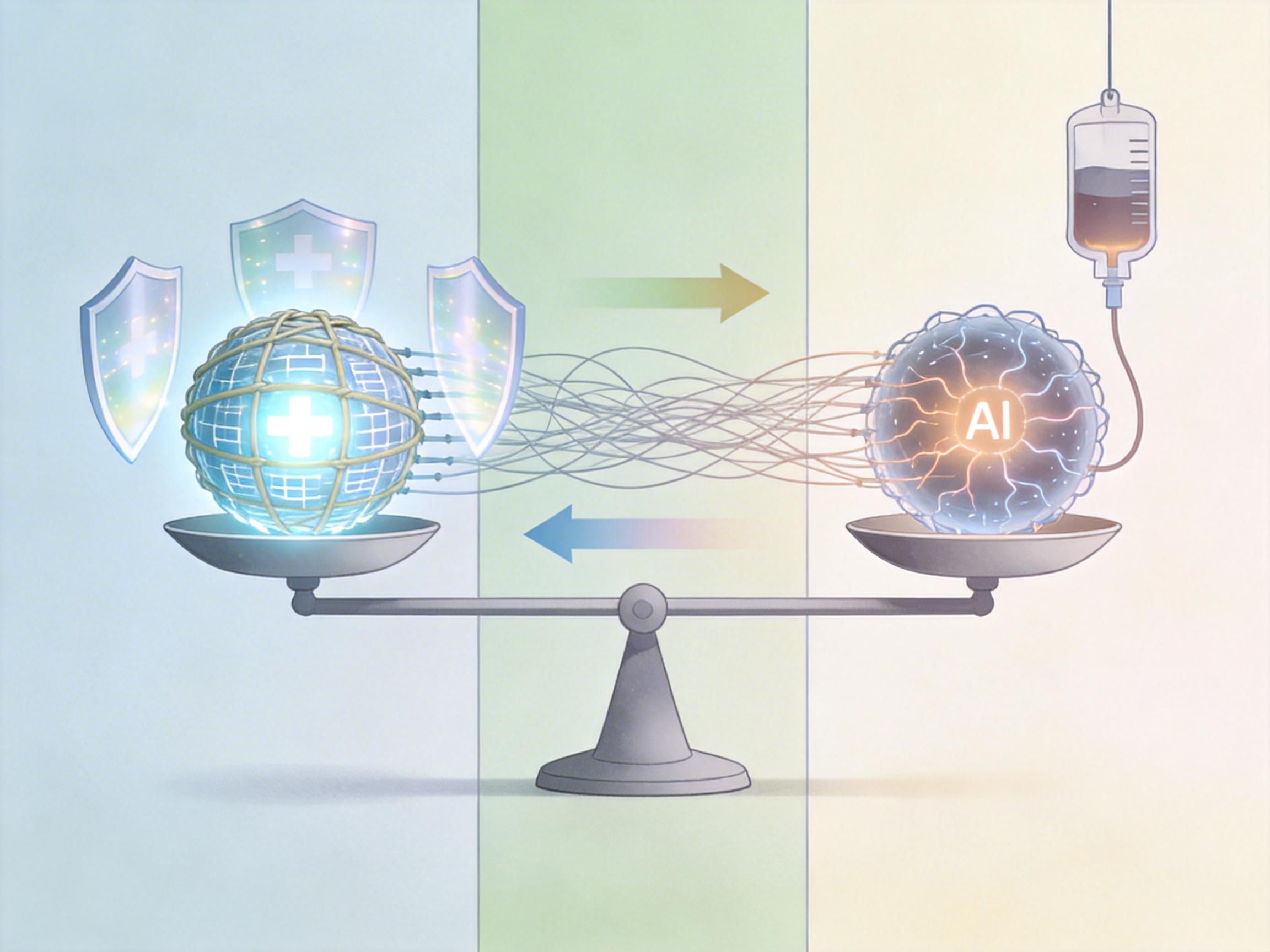

诊室里的键盘敲击声正被AI的低语取代——美国医学会2026年的调查显示,超过八成医生已将AI纳入执业,这一数字较2024年翻了一倍。从病历生成到诊疗摘要,医生们平均用到的AI场景从1.1个涨到2.3个,近四成医生靠AI搞定最头疼的文书工作。但在效率飞升的背后,40%的医生坦言自己“既兴奋又担忧”,天平的另一端,是关于技能、责任与信任的重重焦虑。

最先被AI解放的,是被文书压得喘不过气的医生。过去,一份出院小结可能要耗掉半小时的诊疗间隙,现在AI能在对话结束时自动生成初稿,把医生从屏幕前拉回病床边。克利夫兰诊所的实践显示,AI语音助理能让医生日均少花15分钟在文书上,80%的患者感觉到医生的眼神终于落在了自己身上,而非电脑屏幕。但这份解放有代价:AI生成的内容可能藏着药物名称误录的隐患,医生必须像校对员一样逐字核查,在效率与安全间走钢丝。

更尖锐的隐忧藏在医学教育的链条里。88%的医生担心AI会啃噬年轻医生的技能——就像张文宏提醒的那样,若实习医生跳过完整的诊断思维训练,直接拿AI的结论当答案,他们将失去鉴别AI错误的能力。神经科的住院医师曾依赖AI跳过临床推理,被导师警告“你记住的是影像结果,不是患者的症状”;病理科的年轻医生盲目采纳AI的判断,漏诊了早期侵袭性癌症。这种“自动化偏差”像温水煮青蛙,让年轻医生的独立诊断能力悄悄退化。

法律责任的灰色地带,更是悬在医生头顶的达摩克利斯之剑。当前的法律框架里,AI只是辅助工具,医生要为所有诊疗决策兜底。但AI的“黑箱”特性让医生很难解释:当AI给出错误的诊断建议,自己到底要为“未充分核实”承担多少责任?美国已有医生因依赖AI的错误建议被追责,法院的判决清晰地指向一点:无论AI多智能,最终的判断权和责任,始终在医生手里。

患者隐私的红线也在被反复试探。当AI工具来自非医疗机构时,71%的医生担心数据泄露——医疗数据的敏感程度远超普通信息,哪怕是去标识化的病历,也可能通过多源数据交叉还原出患者身份。欧盟的GDPR、美国的HIPAA都在收紧数据监管,但AI对数据的饥渴,始终与隐私保护形成张力。

AI不会取代医生,但会取代不会用AI的医生——这句话的另一面是,不会驾驭AI的医生,也可能被AI反噬。未来的医疗生态里,AI是医生的“外脑”,而非“替身”:它能处理海量数据,却不能替代触诊时的温度、沟通时的共情,更不能承担救死扶伤的责任。真正的人机协同,从来不是让AI接管医生的工作,而是让医生在AI的辅助下,重新成为那个会思考、会判断、会关怀的医者。

点击充电,成为大圆镜下一个视频选题!