对抗知识焦虑,从看懂这条开始

App 下载

1个视角搞定高清脑扫描,打破百年采样规则

脑神经纤维成像|奈奎斯特采样定理|扩散磁共振成像|SA-INR框架|帝国理工学院|脑科学|AI产业应用|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

脑神经纤维成像|奈奎斯特采样定理|扩散磁共振成像|SA-INR框架|帝国理工学院|脑科学|AI产业应用|心理认知|人工智能

想象一下:躺在核磁共振仪里,原本要一动不动熬60分钟的脑部扫描,现在10分钟就能结束——而且出来的高清图像,比传统方法还能捕捉到更细微的脑神经纤维。这不是科幻场景,是帝国理工学院的研究团队刚刚实现的突破。他们用一套叫SA-INR的AI框架,把原本需要12个视角的扫描压缩到1个,不仅速度提了7倍,还能“脑补”出没扫描过的角度数据。更关键的是,它打破了统治医学成像百年的奈奎斯特采样定理——那个曾被认为是“铁律”的规则,第一次在脑扫描领域被绕了过去。

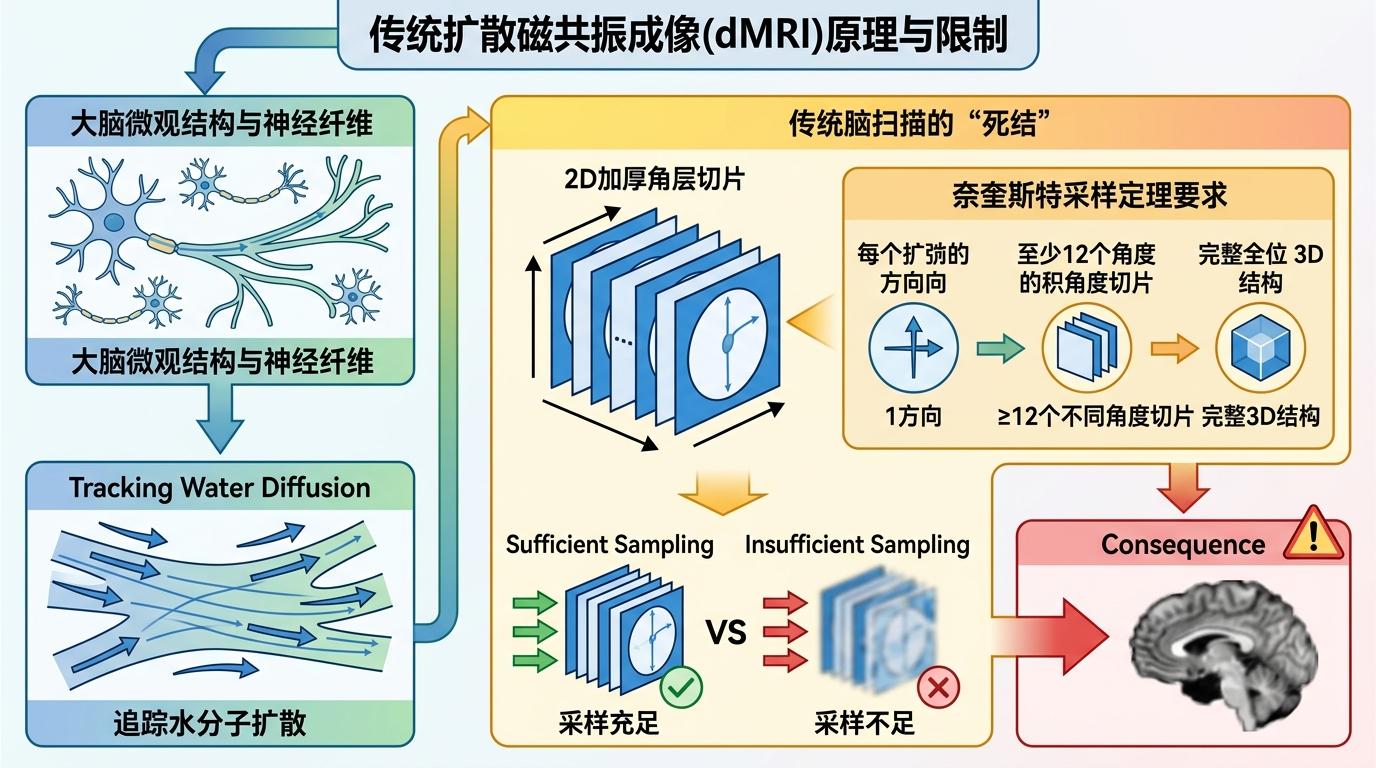

要理解这个突破,得先搞懂传统脑扫描的“死结”。扩散磁共振成像(dMRI)是目前观察大脑微观结构的最好工具——它通过追踪水分子在脑组织里的扩散方向,画出神经纤维的走向。但要拿到清晰的图像,传统方法必须遵守奈奎斯特采样定理:每个扩散方向至少要拍12个不同角度的厚层切片,才能拼出完整的3D结构。

这就像你拍一个杯子,得绕着它拍12张照片,才能还原出杯子的全貌。但帝国理工的团队换了个思路:既然每个扩散方向的扫描,本质上是从不同角度“摸”大脑的结构,那能不能让AI把这些不同角度的“局部触感”连起来?

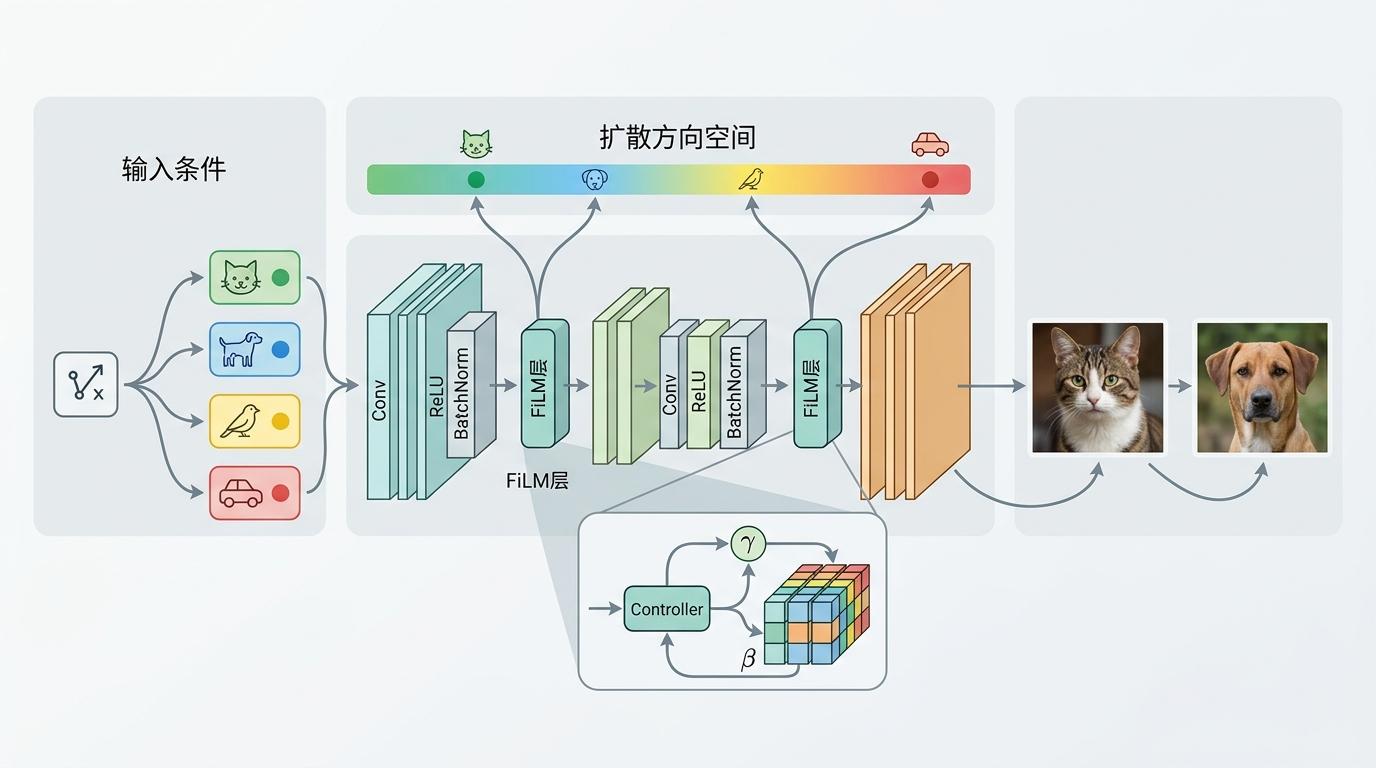

他们设计的SA-INR框架,核心是把空间坐标和扩散方向当成一个连续的整体来建模——就像用一张弹性网,把所有零散的扫描数据“兜”起来。这个框架里的神经网络,能从每个扩散方向仅有的1个视角里,提取出空间信息的互补性,再通过自监督学习重建出高清图像。整个过程不需要任何高清样本做参考,AI自己就能从低分辨率数据里“学”出高清结构。

更让人惊讶的是,这个AI还能“脑补”出从未扫描过的扩散方向数据——这就是零样本角度超分辨率。它的关键是一个叫FiLM的条件机制,可以把扩散方向的信息,像调滤镜一样“嵌入”到神经网络的计算里。

你可以把FiLM层想象成一个智能调色盘:给它一个“蓝色”(某个扩散方向)的指令,它就会自动调整神经网络里每一层的参数,让输出的图像匹配这个方向的特征。训练的时候,AI只见过40个扩散方向的数据,但因为FiLM层学会了方向之间的连续关系,它能在两个已知方向之间“插值”,生成从未扫描过的中间方向的高清图像。

实验数据显示,AI生成的未知方向图像,峰值信噪比(PSNR)能达到33.08dB,比传统插值方法高出4.82dB——这意味着生成的图像不仅肉眼难辨真假,还能提升后续神经分析的精度。比如加入10个合成方向后,扩散张量成像(DTI)里的分数各向异性(FA)误差显著降低,而这个指标正是诊断阿尔茨海默病等神经疾病的关键。

当然,这个突破离真正走进临床,还有几道坎要跨。目前的实验都是在2D切片和模拟数据上完成的,还没在真实的3D高分辨率扫描中验证——而临床里的患者会动、磁场会有不均匀性,这些都会给AI的重建带来干扰。

另外,这个AI对无扩散加权的b=0图像依赖很强——这张图像相当于给AI提供了大脑的“骨架”参考,如果这张图像本身有噪声或伪影,AI的重建质量就会打折扣。而且目前模型还没有开源,大规模临床验证还需要时间。

但不可否认的是,SA-INR框架打开了一扇新的门:它证明了医学成像不一定非要在“扫描时间”和“图像质量”之间做取舍,通过AI的连续建模,我们可以用更少的采样,拿到更好的结果。这不仅能让患者少遭罪,还能让高分辨率脑扫描更普及——比如在基层医院,或者需要频繁扫描的慢性病随访中。

当我们习惯了用“更多采样=更好图像”的思维,SA-INR的出现像一个提醒:规则是用来被重新思考的。就像百年前奈奎斯特采样定理为数字信号打下基础,今天的AI正在用连续函数的视角,重新定义医学成像的边界。

未来的脑扫描可能会变成这样:患者躺进去,机器快速扫几个关键角度,AI在后台实时重建出高清的3D脑图,甚至能提前“补全”医生需要的分析数据。采样的极限,从来都不是物理的边界,而是认知的边界。当我们跳出离散的采样点,看向连续的信号世界,医学成像的下一个时代,可能比我们想象的来得更快。