对抗知识焦虑,从看懂这条开始

App 下载

编程AI的“信任悖论”:高分模型为何屡遭开发者冷遇?

Gemini|Claude|开发者体验|基准测试|AI编程工具|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

Gemini|Claude|开发者体验|基准测试|AI编程工具|大语言模型|人工智能

一个怪圈正在AI编程领域反复上演:一个新款AI模型横空出世,在各大基准测试(Benchmark)中轻松登顶,技术社区一片沸腾。开发者们满怀期待地尝试,却在几天后纷纷抱怨,默默换回了他们之前使用的工具。这个剧情已经上演了三、四次,主角从Gemini到各类开源新星,而被开发者们“回心转意”的对象,却常常指向了Anthropic的Claude。

这并非出于品牌忠诚度,也不是营销的胜利。基准测试并未说谎,新模型在解决孤立、封闭的编程问题时,确实能生成更优的代码。然而,开发者们用脚投票的背后,揭示了一个深刻的行业洞察:AI编程工具的真正战场,不在于单点代码的“智商”有多高,而在于能否在真实、复杂、连续的开发流程中,展现出可靠的“流程执行力”。

长期以来,我们习惯用HumanEval、LeetCode式任务来衡量AI的编程能力。这些测试就像是给AI出了一道道封闭的奥数题,考察的是它在真空环境中生成一个独立函数、通过单元测试的能力。即便是更贴近真实的SWE-bench,它让AI修复真实GitHub仓库中的问题,也依然是一个受控环境。

然而,真实的软件开发,远不止于此。它是一个动态、交互、充满意外的流程。一位开发者在工作中需要:

生成正确的代码,或许只占AI编程助手所需能力的40%。而剩下那更关键的60%,是围绕代码的一切:文件操作的严谨性、任务的专注度、沟通的清晰度以及在不确定性面前的判断力。而这60%,恰恰是当前主流基准测试的盲区。

Claude的成功,似乎源于Anthropic一个关键的训练哲学:重度训练编码的“过程”,而不仅仅是“产出”。他们似乎将大量资源投入到模拟一个经验丰富的开发者在真实代码库中解决问题的完整工作流上。

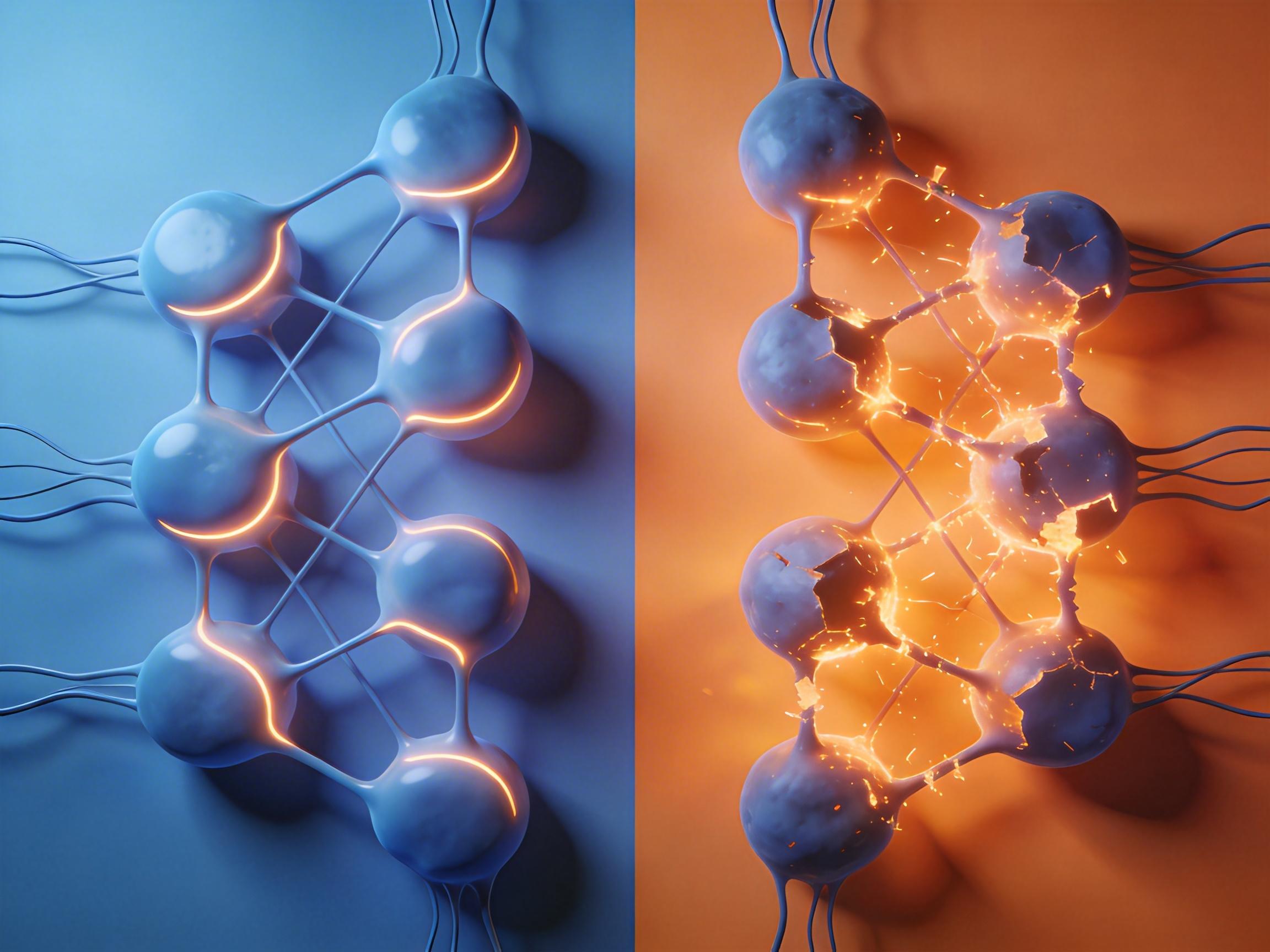

这并非是说其他工具不具备读写文件、执行命令的能力。差距体现在执行这些流程的一致性和可靠性上。许多模型在单点任务上能生成惊艳的代码,但在一个包含20个步骤的多文件重构任务中,它们可能会在中途“精神恍惚”:

这种体验上的差异,不是“原始智能”的高下之分,而是“流程纪律”的云泥之别。Claude表现出的,是一种更强的任务约束和过程严谨性。它更懂得何时该做什么,何时不该做什么,这种可靠性,正是开发者愿意将后背交给它的根本原因。

拥有强大Gemini模型的谷歌,为何在“流程纪律”上似乎棋差一着?这可能是一个“结构性困境”。

谷歌是一家业务庞杂的巨头,其AI模型需要同时服务于搜索、翻译、多模态理解等数十个场景。AI编程只是其中之一。这种广泛的优化目标,使得模型必须是“通才”,难以针对软件开发这一狭窄但极其专业的流程进行极限优化。

而Anthropic则不同。其发布的报告显示,软件工程占其API上所有智能体(Agentic)活动的近50%。这意味着,其模型的商业成败,与编码能力休戚相关。这种生存压力,迫使他们必须将训练资源聚焦于打磨文件编辑、多步工作流、工具调用这些开发流程中的核心环节。因为这正是他们的付费用户每天都在做的事情。

开发者的“用脚投票”并非个例,而是行业普遍现象。Stack Overflow 2025年的开发者调查显示,尽管高达84%的开发者正在使用或计划使用AI工具,但明确表示不信任其输出结果准确性的开发者比例,也从去年的31%飙升至46%。

这背后是AI编程带来的“效率陷阱”。开发者最大的挫败感,来源于那些“看似正确,实则有缺陷”的AI解决方案。调试这些由AI生成的、逻辑上可能存在隐患的代码,耗费的时间甚至超过了自己重写。METR的一项研究甚至发现,经验丰富的开发者在使用AI后,主观感觉效率提升了20%,但客观测试显示,他们的实际速度反而下降了19%。

更严重的是,对AI的盲目信任正在悄然积累“技术债务”。研究发现,AI生成的代码正在变得越来越冗长和复杂,代码“异味”增加,长期维护成本急剧上升。同时,由于AI模型训练自包含大量已知漏洞的开源代码,其生成的代码也可能成为新的安全后门。

这场关于AI编程工具的路线之争,正将软件开发的范式推向一个新的时代。当AI能够可靠地执行整个开发流程时,人类开发者的角色将发生根本性转变。

未来的开发者,将不再是代码的一线“编写者”,而是成为“流程指挥官”。他们的核心价值,将从逐行敲代码,转向更高维度的任务:

“执行力”本身,正在被AI变成一种可被轻易调用的商品。而人类独有的“想象力”和“判断力”,其价值将前所未有地凸显。

最终,基准测试的数字游戏终将落幕。真正能赢得未来的AI编程工具,不是那个能在孤立问题上给出最聪明答案的“天才”,而是那个能在漫长而复杂的开发流程中,始终保持专注、可靠、值得信赖的“伙伴”。