对抗知识焦虑,从看懂这条开始

App 下载

AI读懂大脑情绪信号,还画出了成长轨迹

成长轨迹|生成建模技术|情绪信号解码|脑磁图MEG|脑电图EEG|脑科学|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

成长轨迹|生成建模技术|情绪信号解码|脑磁图MEG|脑电图EEG|脑科学|大语言模型|心理认知|人工智能

你有没有过这种时刻:明明对着一张笑脸,却突然从眼角的肌肉抽动里读出了勉强;或是看到皱起的眉头,第一反应不是愤怒,而是藏在底下的恐惧?我们的大脑处理这些情绪信号快到像本能,但科学家花了几十年,都没完全搞懂这台「情绪解码器」的工作原理——直到最近,一群神经科学家和AI研究者联手,用生成建模技术,把5岁到40岁的大脑情绪活动拆成了6种清晰的模式。更重要的是,他们第一次画出了这套系统从孩童到成人的完整成长轨迹。这到底是怎么做到的?

要读懂大脑的情绪信号,首先得「听见」它的声音——这就轮到脑电(EEG)和脑磁图(MEG)出场了。你可以把这两种技术想象成大脑的「麦克风」:EEG是贴在头皮上的电极阵列,捕捉神经元放电时产生的微弱电场变化,就像隔着墙壁听房间里的人说话;MEG则是更灵敏的「定向麦克风」,它能捕捉神经元电流产生的磁场,受头骨干扰更小,能更精准定位信号来源。两者都拥有毫秒级的时间分辨率,能追踪大脑看到情绪面孔后的每一步反应。

但这些信号本身只是一堆杂乱的波形,就像把一整个交响乐团的声音拆成了无数单独的音符。过去科学家只能靠标记「这串波对应愤怒」「那串波对应快乐」来研究,但这种离散的标签,根本抓不住情绪的连续变化——就像你不能只靠几个音符还原一整首交响乐。

这次研究用到的生成建模(Generative Modeling),就是把这些零散音符重新拼成完整乐章的关键。你可以把它理解成一个「大脑模拟器」:它先从5到40岁受试者的脑电/脑磁数据里学习,把大脑处理情绪的过程拆解成6种核心模式——从最基础的视觉输入,到运动准备、时间感知,再到高级的语义加工。它不仅能告诉你「大脑在处理情绪」,还能精准指出「哪个脑区在什么时候、以什么强度参与了工作」。

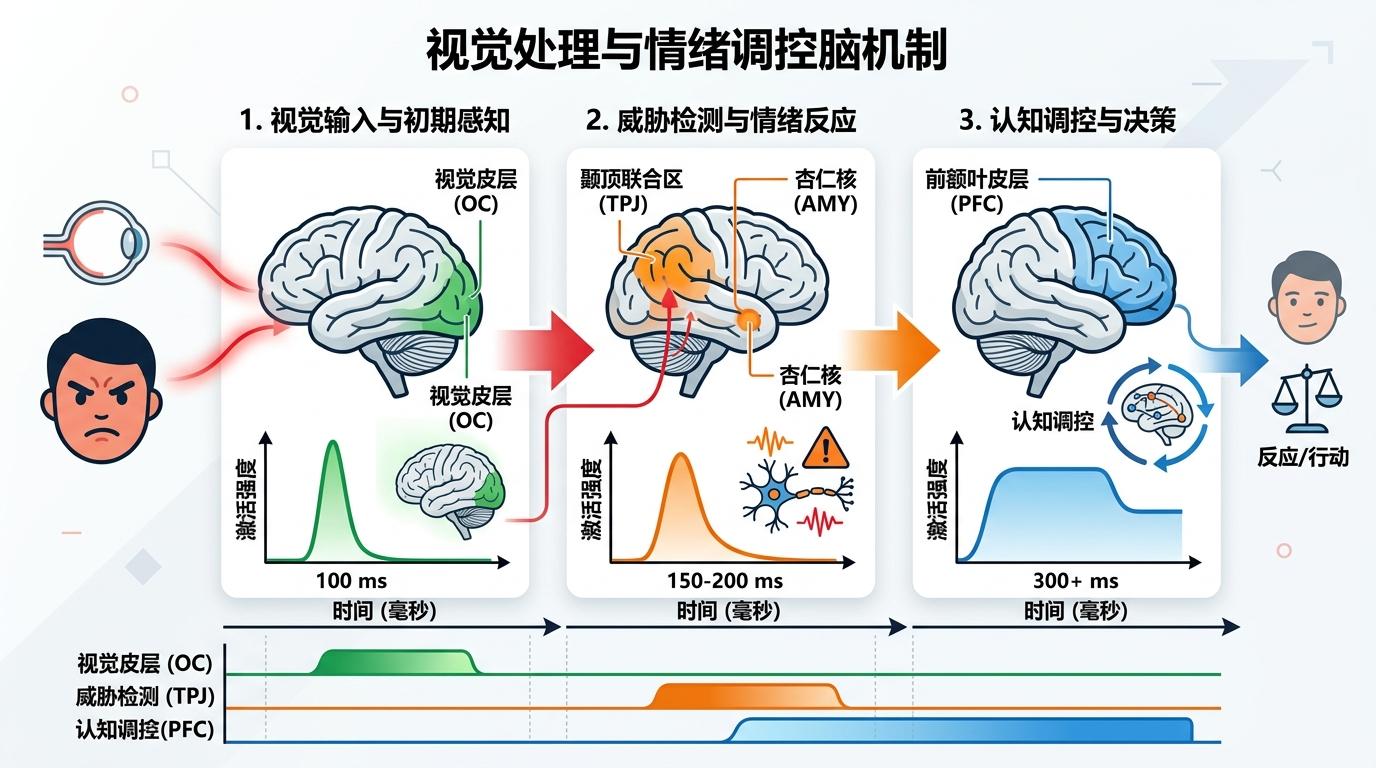

比如当你看到一张愤怒的脸,生成模型会清晰地画出:视觉皮层先在100毫秒左右激活,接着颞顶联合区的「威胁检测模块」启动,随后前额叶的「认知调控网络」介入,整个过程像一套精密的流水线,每个环节的启动时间、持续时长、激活强度都一目了然。

让这项研究真正与众不同的,是它跨越了35年的年龄跨度——从刚上幼儿园的孩子,到步入中年的成年人。这就像给大脑的情绪系统拍了一部「成长纪录片」,第一次清晰展现了它从稚嫩到成熟的完整轨迹。

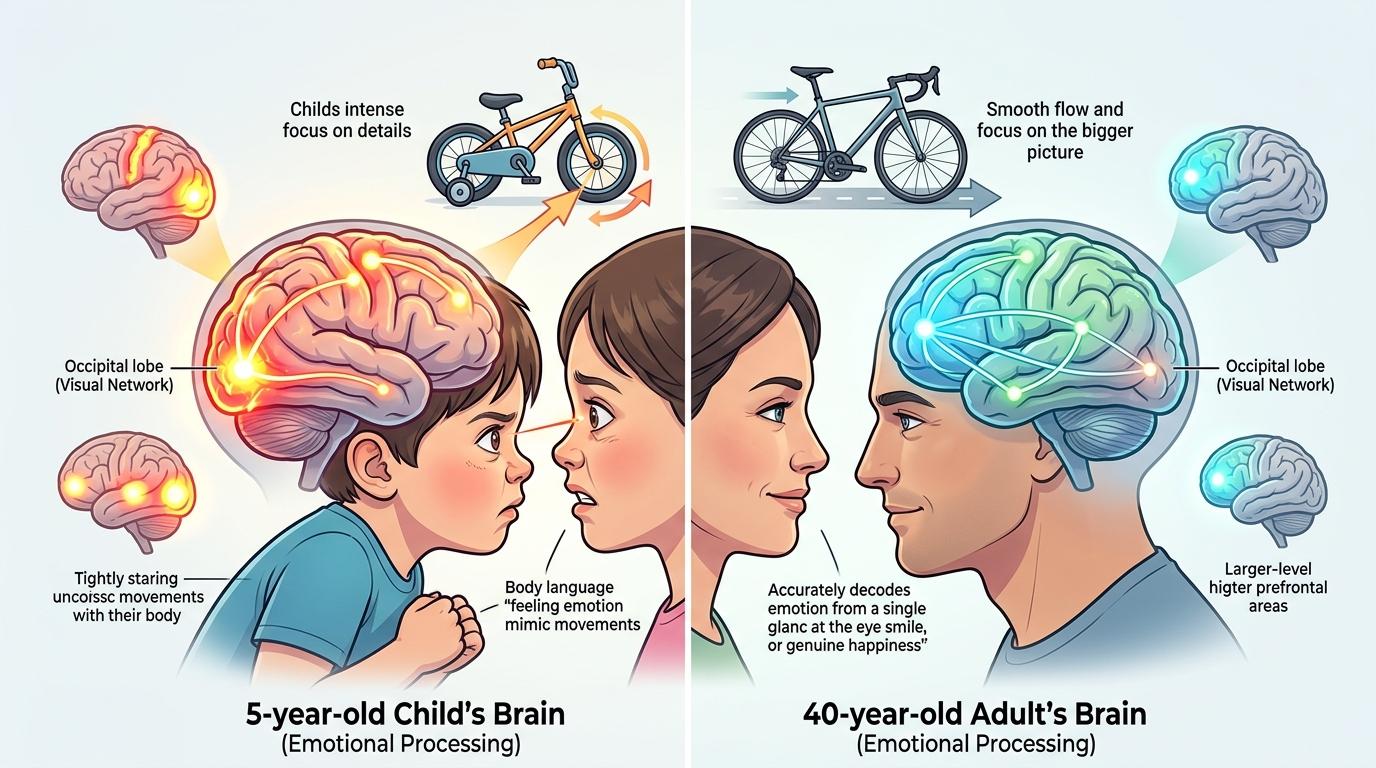

研究发现,5岁孩子的大脑处理情绪时,几乎全靠视觉和运动网络驱动——他们会紧紧盯着面孔的细节,甚至会不自觉地模仿对方的表情,用身体去「感受」情绪。就像刚学骑车的孩子,得全神贯注盯着车轮,根本顾不上看路。而到了40岁,大脑已经把这套流程练得炉火纯青:视觉网络的参与度大幅降低,前额叶的语义和调控网络成为主角——我们不用刻意关注,就能快速从一个眼神、一个嘴角的弧度里读出复杂的情绪,甚至能分辨出「假笑」和「真心的快乐」。

更有意思的是不同情绪的「成长速度」:对快乐表情的识别能力在8岁左右就基本成熟,而对愤怒、恐惧这些带有威胁性的情绪,大脑的处理网络要到青少年晚期才会完全精细化。这也解释了为什么青春期的孩子对别人的负面情绪格外敏感——他们的「威胁检测系统」正在最后调试,还没学会过滤不必要的信息。

最关键的是,这套「正常发育轨迹」,给自闭症等神经发育障碍提供了一个精准的「参照系」。过去医生只能靠行为观察判断孩子的情绪处理是否异常,现在有了这套模型,就能通过脑电数据,直接对比孩子的情绪网络发育是否偏离了正常轨道,甚至能指出是哪个环节出了问题——比如是视觉输入模块过度活跃,还是前额叶的调控功能滞后。

这项研究的突破,本质上是AI和神经科学的双向奔赴:生成建模帮神经科学家解开了大脑情绪网络的「黑箱」,而神经科学的发现,反过来也在优化AI的情绪识别能力。

过去的AI情绪识别,就像只会死记硬背的学生:靠海量标注数据学习「什么样的脸对应什么样的情绪」,但一旦遇到模糊的、混合的情绪,就会彻底懵圈——比如它分不清「带着悲伤的愤怒」和「带着愤怒的悲伤」。而现在,研究团队从大脑的情绪处理模式里得到启发,给AI加入了「分层处理」的逻辑:先识别基础的面部特征,再分析情绪的强度和混合比例,最后结合语境判断真正的情绪。优化后的AI不仅能更精准地识别复杂情绪,还能像人类一样,「解释」自己做出判断的依据——比如「我判断他是假笑,因为他的眼轮匝肌没有收缩」。

当然,这项研究也有它的局限:目前只覆盖了快乐和愤怒两种基本情绪,样本量还不够大,生成模型的「黑箱」问题也还没完全解决——我们知道它能精准拆解大脑的情绪模式,但还不完全清楚它是怎么做到的。不过这些问题,恰恰是未来研究的方向:比如加入更多复杂情绪,扩大跨文化的样本,让模型的解释性更强。

当我们终于能把大脑处理情绪的过程拆成清晰的模块,画出它从孩童到成人的成长轨迹时,我们其实在做一件更有意义的事:我们在理解「人之所以为人」的核心——我们如何感知他人的情绪,如何建立连接,如何在社会中成长。

AI读懂的不只是大脑的信号,更是人类最细腻的情感世界;神经科学的发现,也在让AI变得更像「人」——不是更像人的外表,而是更像人的思考方式。情绪不是单一的开关,而是一套动态的系统。这句话不仅适用于大脑,也适用于我们正在打造的AI。未来,当AI能真正理解人类的情绪,我们或许能迎来一个更温暖、更包容的人机共生时代。