对抗知识焦虑,从看懂这条开始

App 下载

AI霸屏科技社区,检测工具正在反向博弈

科技社区|AI内容生成|AI信息茧房|Pangram检测器|Hacker News|AIGC|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

科技社区|AI内容生成|AI信息茧房|Pangram检测器|Hacker News|AIGC|人工智能

2026年2月的某一周,打开科技社区Hacker News的每日前五热门,你会看到四篇AI相关内容——要么是AI写的行业分析,要么是AI厂商的软广,连评论区都飘着AI生成的标准化回复。有人把这种现象叫「AI信息茧房」,但更准确的说法是:AI已经从工具变成了科技社区的「内容主产区」。

要搞清楚这场信息入侵的真实规模,有人做了个实验:统计当月每日前五热门,发现AI内容占了近八成席位;再用Pangram——一款以保守精准著称的AI文本检测器——扫描,结果更让人意外:那些读起来像模像样的行业稿,不少是AI的「手笔」。问题来了:AI是怎么悄悄占领信息流的?我们又该怎么分辨那些「看起来像人写的」AI内容?

你可以把AI内容的爆发,理解成一场「效率降维打击」。90%的科技从业者已经在用AI写文档、改代码,连新闻稿也不例外——一篇AI生成的行业快讯,从选题到成稿只需要10分钟,而人类作者可能要花半天查资料、捋逻辑。这种速度优势,刚好踩中了内容平台的「流量密码」:推荐算法天生偏爱高产出、高互动的内容,AI内容既能批量生产,又能精准踩中「AI」这个当前最热的流量标签,自然会被算法反复推送,形成「AI内容越多→流量越高→更多人生产AI内容」的正反馈循环。

数据最能说明问题:2026年2月,Hacker News的每日前五热门里,AI内容最多时占了全部5个席位,最少的日子也能排进前6。不止文字,音乐平台Deezer每天检测到6万首AI生成歌曲,占上传总量的39%;TikTok上的AI自动化账号,靠批量生成内容拿到了数十亿播放量。这些数字背后,是AI正在重构内容生产的「成本-收益」模型:以前要靠人类创作者的经验和灵感,现在靠AI的算力和模板,就能快速产出符合平台口味的内容。

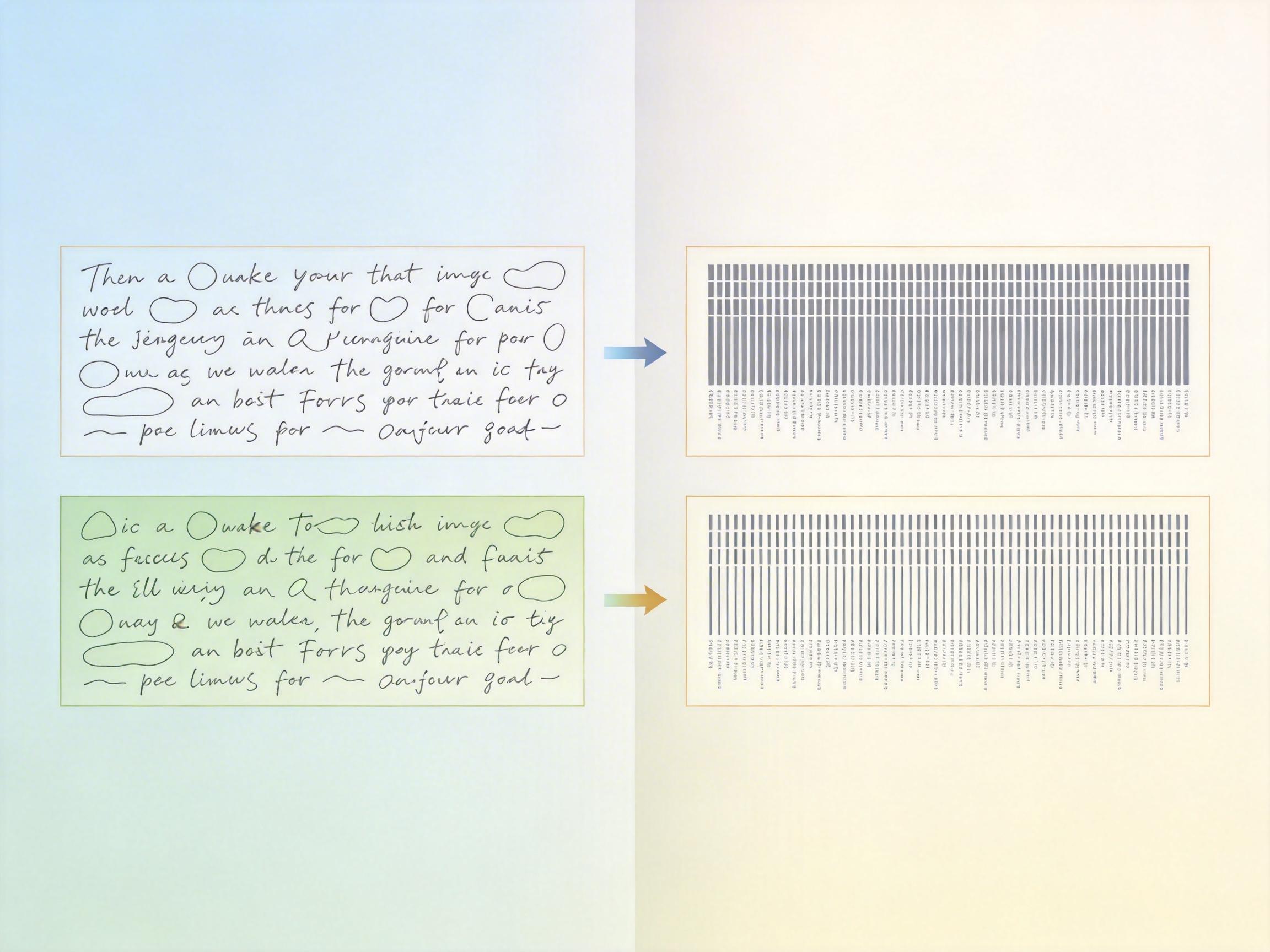

很多人对AI文本检测器的印象还停留在「误判率高」,但其实这是个过时的误解——新一代的检测工具,已经摸到了AI写作的「命门」:大语言模型(LLM,一种能理解和生成人类语言的AI模型)的输出有个「准确定性」特征:你让它写两次同一主题的文章,会得到风格、结构高度相似的内容,就像同一个模板刻出来的。而人类写作的风格是随机的,很难出现完全一致的用词和逻辑链。

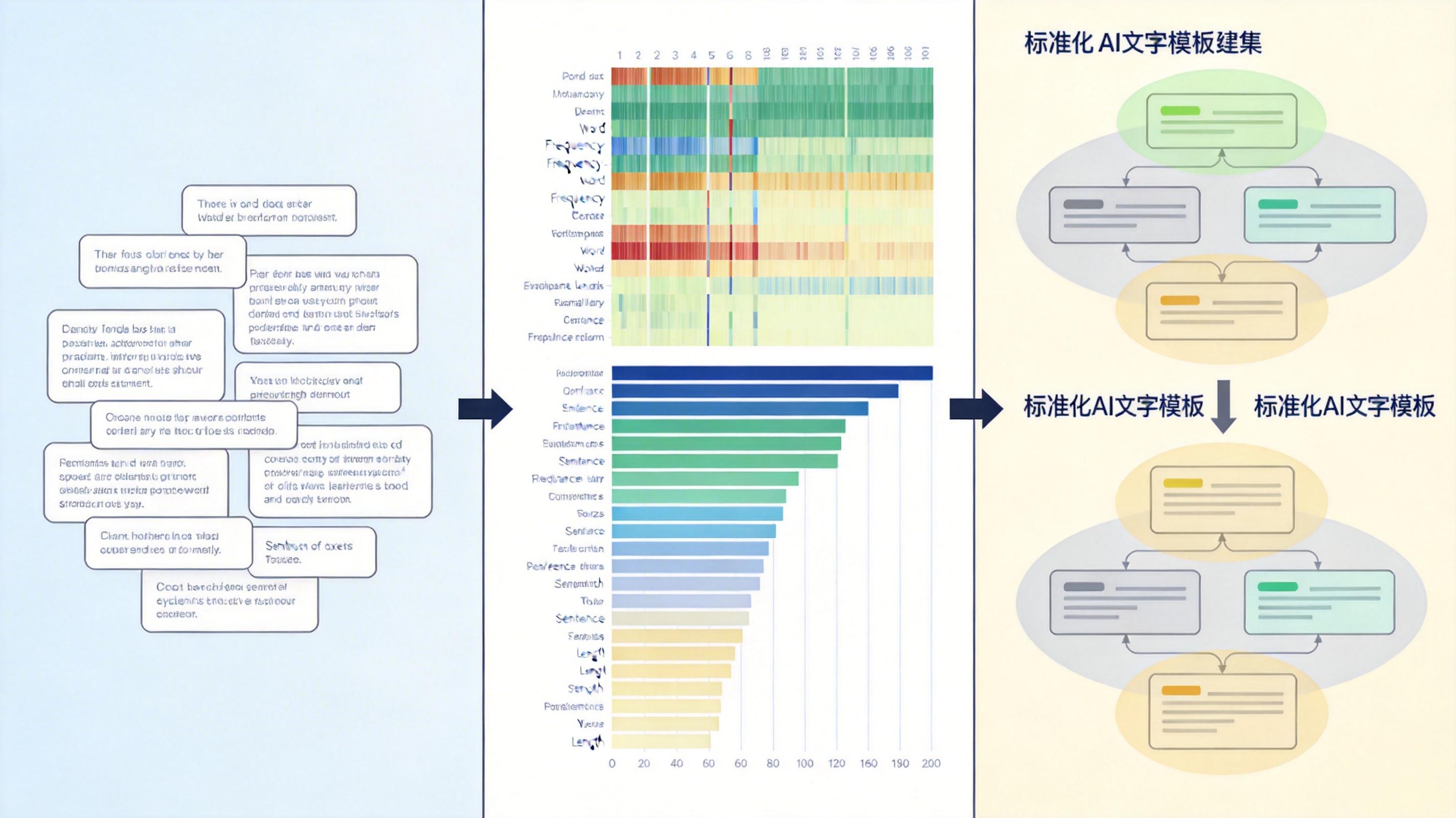

当前的AI检测技术主要分两类:

一类是「黑盒检测」,不用碰AI模型的内部,只看文本特征。比如Pangram这类工具,会分析文本的词频、句法结构、甚至是句子长度的分布,把这些特征和AI写作的「模板库」对比,判断内容的来源。这种方法的好处是适用范围广,不管你用的是GPT还是Llama,只要是AI生成的文本,都会留下相似的特征痕迹。

另一类是「白盒检测」,需要和AI模型合作,在生成内容时「埋水印」。比如在生成每个词的时候,悄悄调整模型的选词概率,让文本里出现只有检测器能识别的「暗号」——就像人民币上的隐形防伪线,肉眼看不见,但用特定工具一照就显形。这种方法的准确率接近100%,但缺点是只能检测特定模型生成的内容,没法覆盖所有AI工具。

当然,道高一尺魔高一丈。现在已经有人用「同义词替换」「语序调整」的方法修改AI文本,试图骗过检测器。但最新的商业检测工具,比如Copyleaks、GPTZero,已经能抵抗大多数这类「对抗攻击」,误判率降到了很低的水平。

AI内容的爆发,不止是「谁写了内容」的问题,更在悄悄改变我们的信息生态。最直接的影响是「信息污染」——大量快速生成的AI内容,虽然看起来专业,却缺乏人类写作的深度和情感,有人把这种内容叫「AI Slop」(AI泔水)。它们挤占了优质人类内容的流量,让真正有价值的观点被淹没。

更隐蔽的风险是「信任崩塌」。当你刷到的新闻、评论甚至知识问答,都可能是AI生成的,你还会相信网上的信息吗?2025年的一项调查显示,美国社交媒体用户里,只有44%的人自信能分辨AI生成内容。而AI生成的虚假信息,比如AI合成的政治人物视频、假新闻,已经开始影响现实中的判断——比如2024年的美国大选,就出现过AI生成的候选人虚假演讲视频。

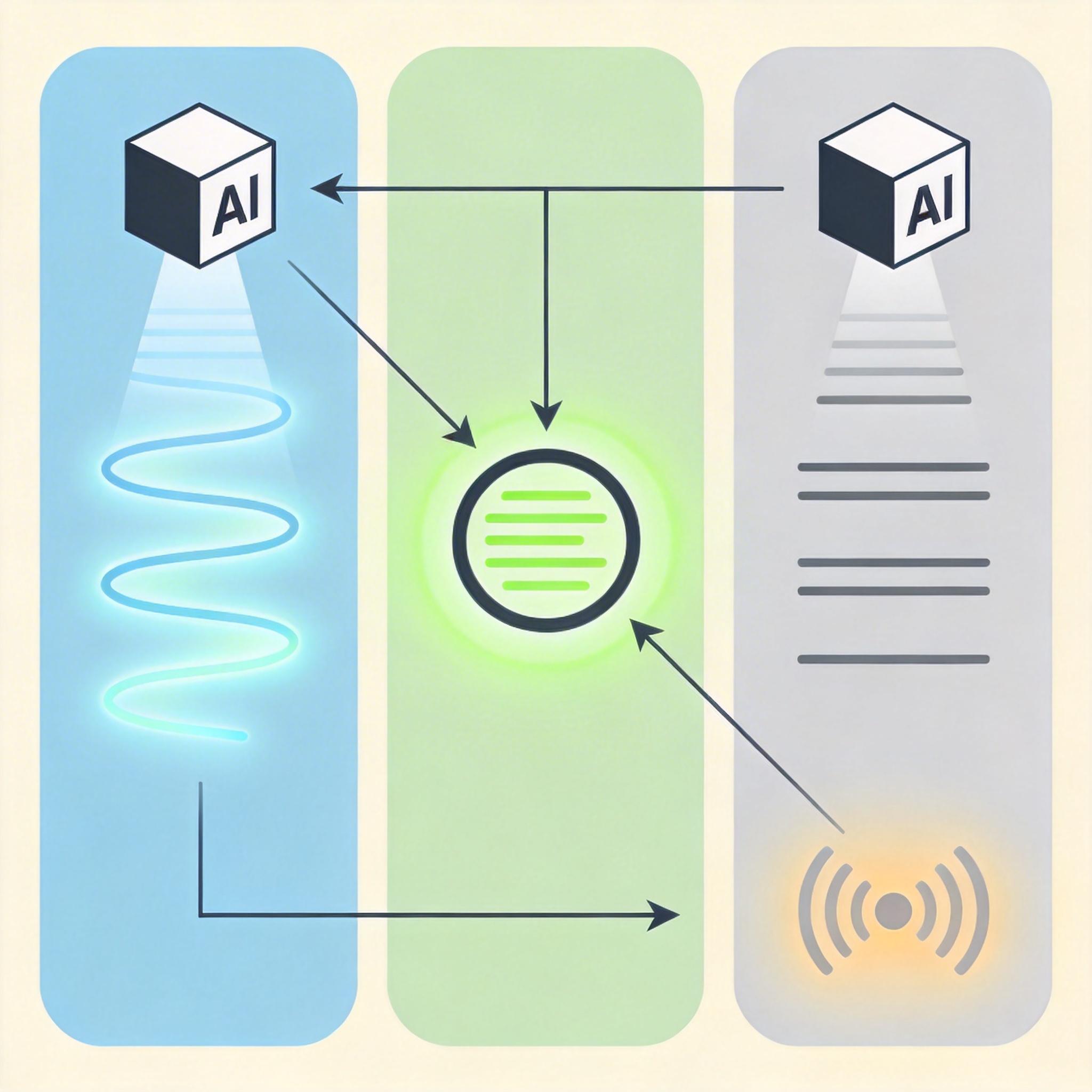

我认为,当前的问题不在于「AI能不能写内容」,而在于「我们该怎么给AI内容定规则」。比如欧盟的《AI法案》要求,2026年起所有AI生成内容必须标注,还要嵌入机器可读的元数据;Deezer也开始给AI生成的音乐打标签,不让它们进入推荐歌单。这些规则的核心,不是要禁止AI,而是要让AI内容「透明可见」——毕竟,只有知道内容的来源,我们才能真正掌控自己看到的信息。

当AI从工具变成内容生产者,我们面对的不是一场「人机大战」,而是一场「信息秩序的重构」。AI能帮我们提高效率,但人类独有的情感、经验和判断力,才是内容真正的灵魂——就像有人说的,「AI能写出完美的句子,但写不出有温度的故事」。

未来的信息生态,应该是人机共存的:AI负责批量生产标准化内容,人类专注于有深度、有情感的创作;检测工具负责守住「真实」的底线,规则负责让AI内容透明可见。毕竟,我们需要的不是没有AI的信息流,而是不被AI淹没的、有价值的信息流。

人机共创,以人为主。