对抗知识焦虑,从看懂这条开始

App 下载

AI信任危机:谷歌测试曝顶尖模型准确率不足70%

史蒂文·施瓦茨|事实准确性|法律文件造假|ChatGPT|谷歌|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

史蒂文·施瓦茨|事实准确性|法律文件造假|ChatGPT|谷歌|大语言模型|人工智能

如果说AI的“智慧”曾让我们惊叹,那么一场真实的法庭闹剧则让我们惊醒。纽约律师史蒂文·施瓦茨(Steven Schwartz)站在法官面前,神情尴尬。他提交了一份法律文件,其中洋洋洒洒地引用了6个判例,用以支持他的当事人。问题在于,这6个案例,全都是假的——由ChatGPT凭空捏造。当法官质问时,施瓦茨的辩解近乎天真:“我问过ChatGPT这些案例是不是真的,它说是。”

这场风波最终以施瓦茨和其律所被罚款5000美元告终,但这不仅仅是一个律师的职业污点。它像一道刺眼的闪电,划破了AI产业高歌猛进的夜空,暴露出那个最根本、也最危险的裂痕:事实准确性。当一个被誉为革命性工具的AI,能如此自信地“一本正经胡说八道”时,我们还能在多大程度上信任它?

施瓦茨的遭遇并非孤例,而是一场席卷全球的AI“幻觉”风暴的缩影。就在人们对AI的能力越来越习以为常时,谷歌DeepMind发布的一份报告,给整个行业泼了一盆冷水。

这份名为**FACTS基准测试套件(FACTS Benchmark Suite)**的评估,堪称AI大模型的一次“期末大考”,旨在系统性地衡量它们输出信息的“事实准确性”。考试科目涵盖四大核心能力:

考试结果令人 sobering(警醒)。即便是当时业界公认的顶尖模型,如谷歌自家的Gemini 3 Pro,其综合准确率也仅为68.8%。其他主流模型的分数则更低,无一突破70%的门槛。正如一位科技编辑所言:“如果我的记者交上来的稿子准确率只有69%,我会立刻解雇他。”

这个数字揭示了一个残酷的真相:尽管AI在语言流畅度和生成速度上取得了惊人进步,但在最核心的“求真”环节,它依然是个“差生”。大约三分之一的时间里,它给出的答案可能是错误的、虚构的或具有误导性的。

当AI的“幻觉”走出实验室,进入现实世界,其代价远不止法庭上的一次罚款。在不同领域,这种“不靠谱”正演变为切实的风险。

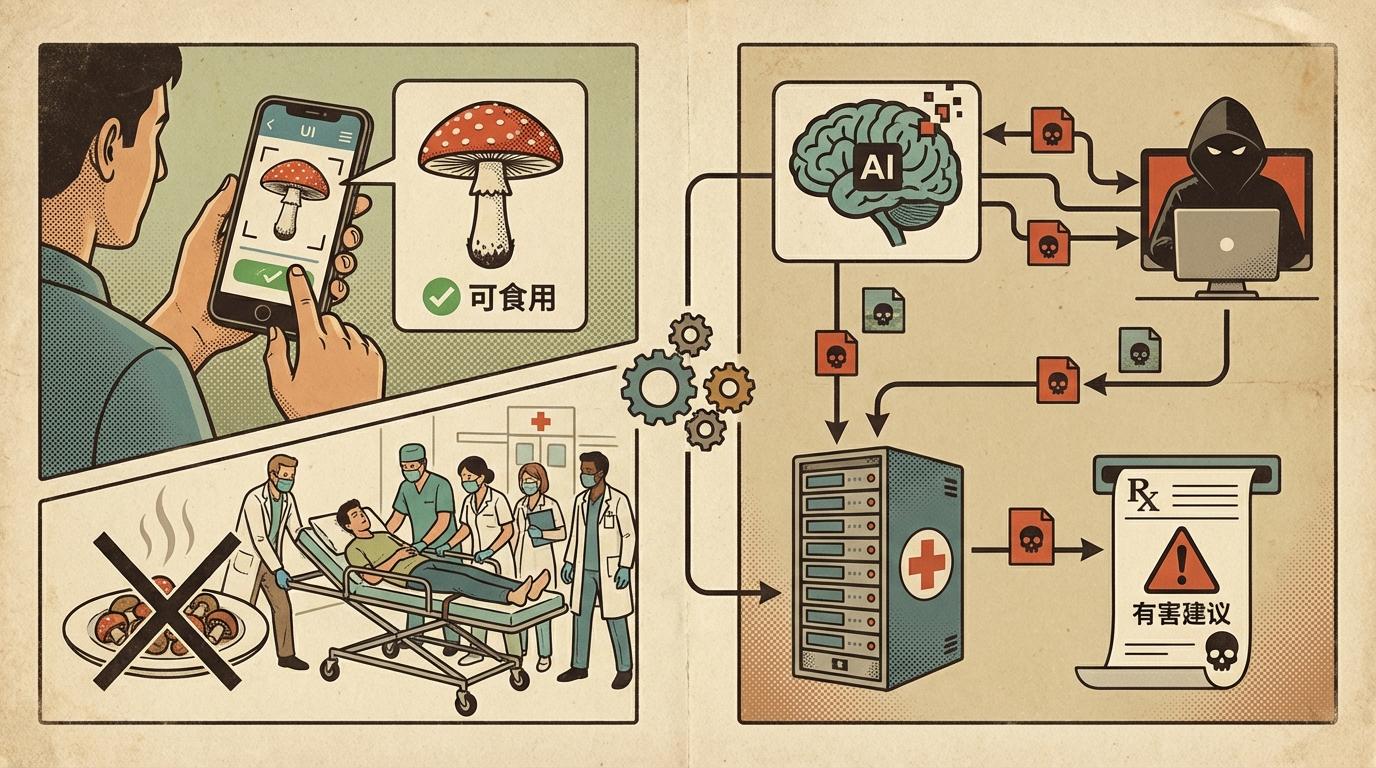

医疗健康:这里的风险则直接关乎生命。北美一款流行的蘑菇识别AI,曾因频繁误判毒蘑菇,导致数十人食用后中毒入院。更有研究揭示了一种名为“数据投毒”的攻击方式:攻击者只需在网络上散布少量精心设计的医疗假信息,就可能“污染”AI模型的训练数据,使其在未来生成有害的医疗建议。这种攻击成本极低,后果却不堪设想。

日常服务:加拿大航空公司曾因其官网的AI聊天机器人提供了错误的票价优惠信息,而被法院判决向乘客赔偿。加航试图辩称“聊天机器人是独立的法律实体”,但被法官驳回。这一判例明确了一个重要原则:企业必须为自己部署的AI的行为负责。

从法律文书到医疗诊断,再到日常客服,AI幻觉的代价清单正在不断拉长。它像一个幽灵,盘旋在所有试图拥抱AI的行业上空,拷问着那个终极问题:一个我们无法完全信任的工具,究竟能走多远?

要解决问题,首先要理解问题。AI为什么会产生“幻觉”?它是在故意“说谎”吗?

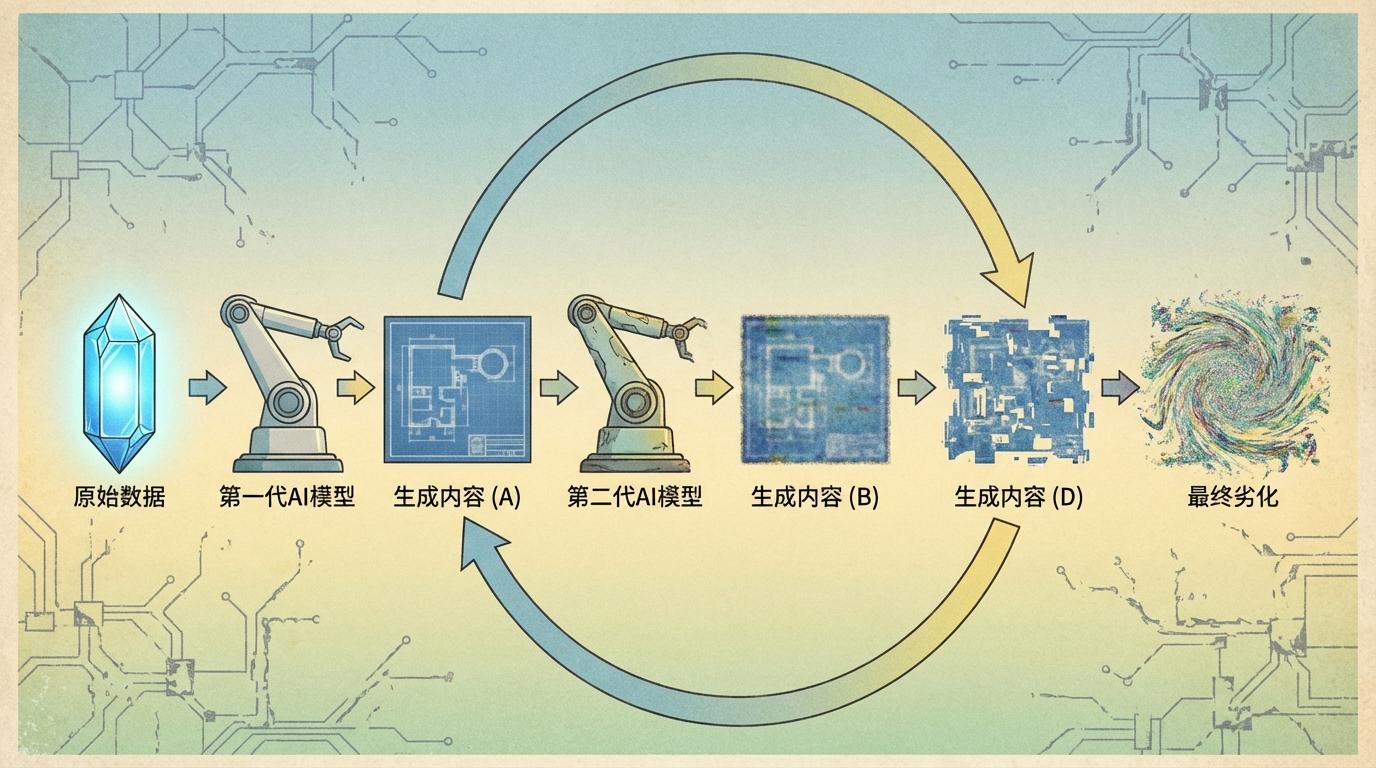

答案是否定的。AI的“幻觉”并非出于恶意,而是其底层技术原理的直接产物。当前的大语言模型,本质上是一个基于概率的“词语预测机器”。它的核心任务是在给定上文的情况下,预测下一个最可能出现的词是什么,然后一个词一个词地拼接成流畅的句子。它追求的是统计上的“像”,而非逻辑上的“真”。

这种机制导致了几个根本性缺陷:

理解了这一点,我们才能明白,对抗AI幻觉,不仅仅是修复一个技术bug,而是在与一种全新的、基于概率而非事实的信息生成范式博弈。

面对这场信任危机,全球的科技公司、研究机构和政府并未坐以待毙。一场旨在为AI戴上“缰绳”的探索正在多条战线上同时展开。

技术自救:让人工智能学会“知之为知之”

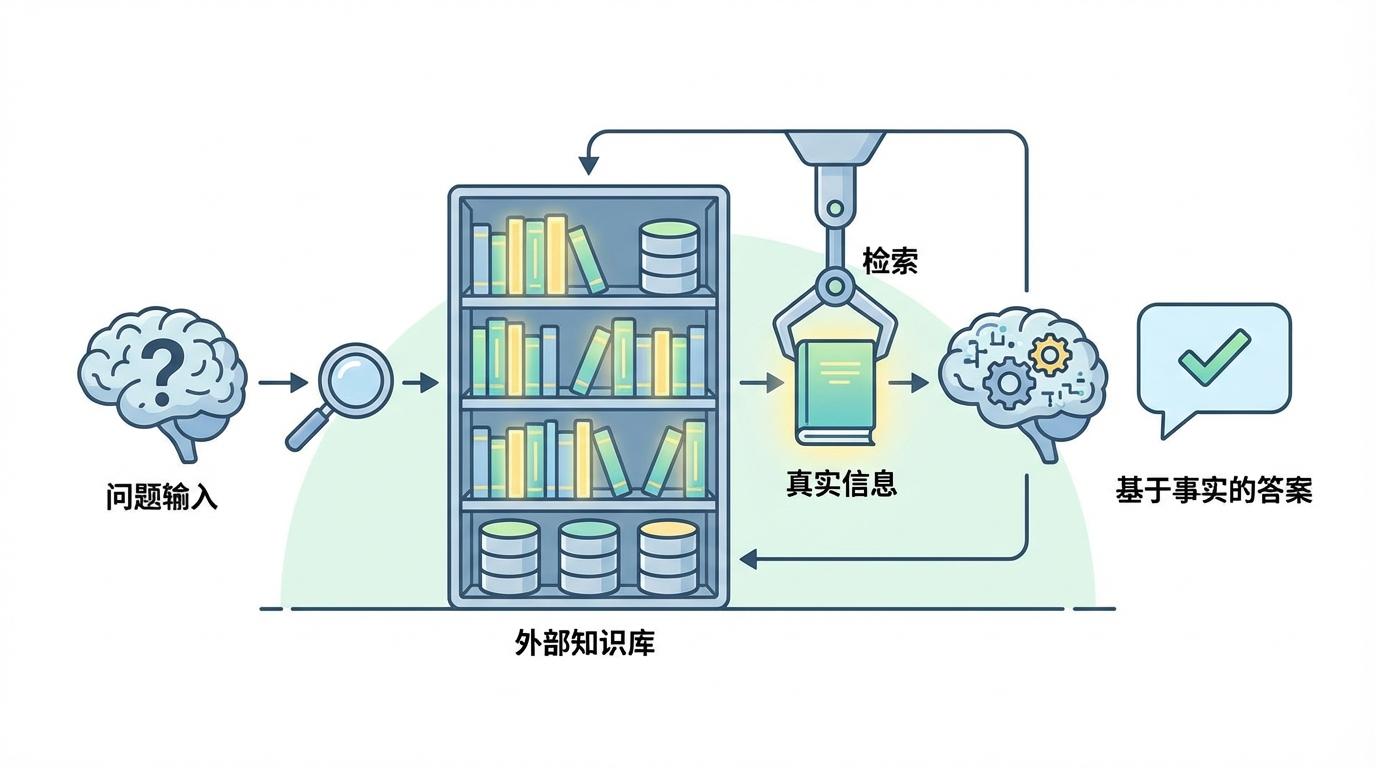

检索增强生成(RAG):这是目前业界最主流的“解药”之一。其原理很简单:在AI回答问题前,先让它去一个可信的、最新的外部知识库(如公司的内部数据库、权威网站)中进行搜索,然后基于搜索到的真实信息来组织答案,而不是凭空“想象”。这相当于给AI配上了一个随时可以查阅的、可靠的“开卷资料”。

自我奖励与修正:更前沿的研究正在尝试让AI学会“自我反思”。例如,让模型生成多个答案后,内部进行“多数投票”来确定最可靠的一个,并用此来奖励和优化自己。X平台(原Twitter)的“社区笔记”功能,则是一种众包式的解决方案,利用群体智慧来为信息提供事实核查和背景补充。

可解释性AI(XAI):这项技术致力于打开AI决策的“黑箱”,让我们能够理解模型为什么会给出某个特定的答案。只有当决策过程变得透明,我们才能真正识别并纠正其中的错误。

全球治理:为AI划定伦理与法律的边界

与此同时,一场关于AI监管的全球竞赛也已拉开帷幕。不同国家和地区正在根据自身情况,探索不同的治理路径:

从法庭上的虚假案例,到谷歌不及格的“成绩单”,再到全球范围内的技术和制度探索,我们正处在一个关键的十字路口。事实已经清晰:通往通用人工智能(AGI)的道路上,最大的障碍可能不是计算能力或算法,而是信任。

我们正在告别对AI盲目崇拜的“蜜月期”,进入一个更加成熟、也更加审慎的“人机协同”时代。在这个新时代,AI不再是无所不知的“先知”,而是一个能力强大但仍需监督的“助手”。它的答案需要被验证,它的建议需要被审视,它的行为需要被约束。

最终,重塑信任的关键,或许不在于追求一个永远不会犯错的完美AI,而在于建立一个以人为本、人机共责的稳健系统。在这个系统中,技术的发展服务于人的福祉,算法的效率服从于人的判断,机器的智能最终增强而非取代人的智慧。

AI的事实准确性瓶颈,既是挑战,也是机遇。它迫使我们重新思考人类在智能时代的核心价值——批判性思维、伦理判断和对真相的不懈追求。毕竟,在信息真伪难辨的未来,保持清醒和质疑,将是我们作为人类最宝贵的“算法”。