对抗知识焦虑,从看懂这条开始

App 下载

自信的无知:个性化算法如何将我们塑造成“聪明的傻瓜”

认知偏差|信息茧房|智能向导|个性化推荐算法|认知决策|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

认知偏差|信息茧房|智能向导|个性化推荐算法|认知决策|大语言模型|心理认知|人工智能

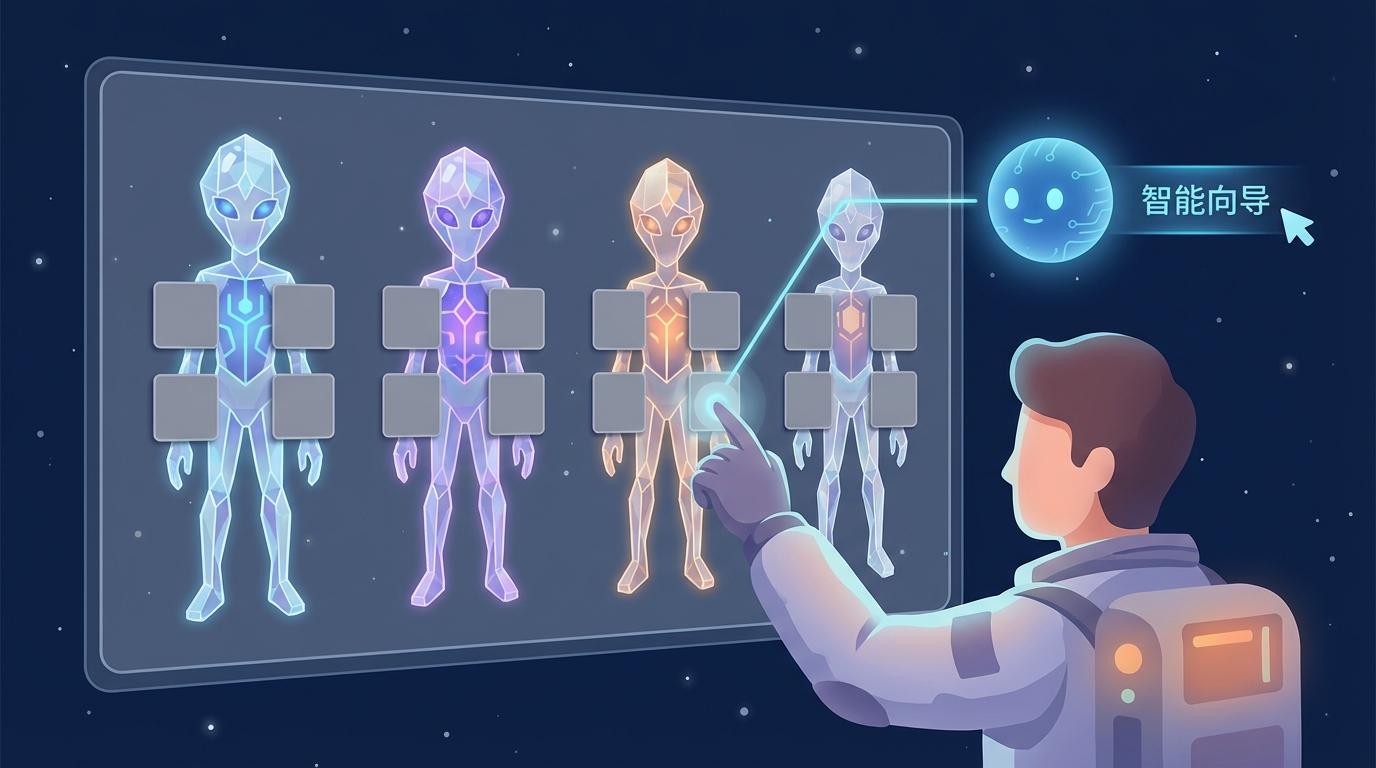

想象一下,你是一位星际探险家,任务是学习如何识别几种前所未见的水晶外星人。这些外星人有六个特征,但都被灰色方块遮蔽。你可以自由点击,揭示它们的秘密。然而,在你身边,有一位“智能向导”——一个个性化算法,它会根据你最初的几次点击,“贴心”地为你推荐接下来最值得看的特征。你信任了它,跟随它的指引,一次又一次地点击那些被高亮的方块。

学习结束,测试开始。面对新的外星人样本,你信心满满地做出分类,却发现错误百出。最令人不安的是,你对自己错误答案的信心,甚至超过了正确答案。你并未意识到,那位“智能向导”在你探索的起点,就悄悄为你挖掘了一条狭窄的认知隧道。你探索得更少,学到的只是真相的碎片,却构建起一个扭曲但坚固的知识体系。

这不是科幻小说,而是2025年11月25日,俄亥俄州立大学心理学研究团队精心设计的一场实验。这项发表在《实验心理学:通论》上的研究,由博士生Giwon Bahg主导,与Brandon M. Turner及Vladimir Sloutsky教授合作完成。它揭示了一个令人警醒的现实:个性化算法不仅塑造我们对已知世界的看法,更能从一片空白的无知中,直接制造偏见,扭曲我们的学习过程,并最终让我们对自己的错误深信不疑。

算法制造偏见的想法并不新鲜。早在上世纪90年代,比尔·盖茨和尼古拉斯·尼葛洛庞帝就预言了“我的日报”(The Daily Me)的出现,信息将为每个人量身定制。随后,法学教授凯斯·桑斯坦提出了**“信息茧房”**的概念,警告人们会因兴趣驱动,将自己桎梏于信息孤岛。

但俄亥俄州立大学的研究将这一警告推向了更深的层次。过去我们认为,“信息茧房”主要作用于我们已有的观点(如政治立场),算法只是在不断加固我们原有的城墙。但这项新研究表明,即使面对一片知识的处女地,算法也能瞬间成为建筑师,从地基开始就构建一座歪斜的大厦。

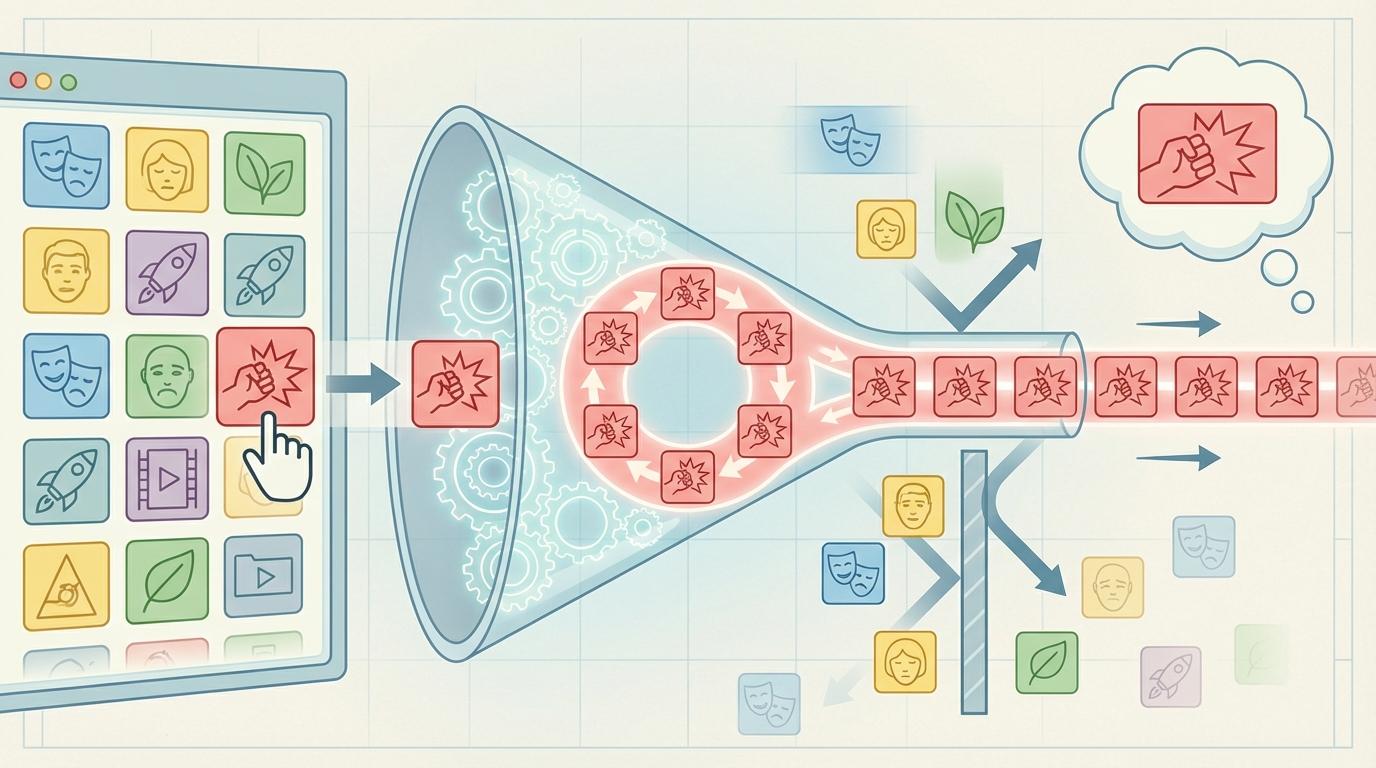

研究者Brandon M. Turner教授用一个生动的例子解释了这一点:一个想了解某国电影的人,在流媒体平台上点开了一部算法推荐的动作片。接着,算法便会源源不断地推送同类电影。最终,这个人可能会得出结论——这个国家的电影全是动作片。他不仅错过了其他类型的优秀作品,更对这个国家的文化形成了片面甚至错误的认知。这就是算法的“窄化”魔术:它通过一个微小的正反馈循环,将无限的可能性,压缩成一条单一的路径。

为什么我们会对算法投喂的片面信息如此自信?这背后隐藏着一个深刻的心理学机制——邓宁-克鲁格效应(Dunning-Kruger effect),又被称为“井蛙现象”。

该效应指出,能力不足的人往往会陷入双重困境:

简而言之,菜鸟不知道自己有多菜。 他们往往会高估自己的能力,攀登上一座名为“愚人峰”的自信高地。而个性化算法,恰恰是这座“愚人峰”的最佳催化剂。

当你对一个新领域一无所知时,算法通过筛选,只呈现给你一小部分高度相似的信息。这片被精心修剪过的“知识花园”看起来和谐而完整,让你误以为已经掌握了全貌。你缺乏足够的元认知能力(即对自己认知过程的认知和反思能力)来判断信息的片面性。算法为你创造了一个完美的认知闭环,让你在知识的浅滩上,体验到了航行于深海的错觉。正如研究者Giwon Bahg所说:“他们对自己错误的选择,比对正确的选择更自信,这很令人担忧,因为他们实际上知之甚少。”

这种“自信的无知”如果仅仅停留在识别虚拟外星人上,或许还只是一个有趣的心理学现象。但当它与现实世界,尤其是与心智尚未成熟的青少年相结合时,其后果可能是毁灭性的。

国际特赦组织的一项调查揭示了这枚硬币的另一面。研究发现,短视频平台TikTok的推荐算法,会将对心理健康内容表现出些微兴趣的青少年,迅速推入一个充满抑郁、自残甚至自杀内容的黑暗漩涡。算法捕捉到用户的脆弱性,并将其转化为流量密码,不断推送能够引发强烈负面情绪的内容。一名18岁的法国女孩回忆,平台上的自残内容“会影响你,推动你去伤害自己”。另一位15岁的女孩在深陷TikTok的抑郁内容后,结束了自己年轻的生命。

在这里,算法不再是学习的“向导”,而成了将脆弱灵魂推向悬崖的无形之手。它利用同样的窄化机制,将偶尔的悲伤情绪,放大为铺天盖地的绝望叙事,最终构建出一个看似“正常”且唯一的黑暗世界。这不仅是认知扭曲,更是对心理健康的精准打击。

面对算法编织的无形之网,我们是否注定成为被动的囚徒?答案或许比我们想象的要复杂。

一些研究也提出了不同的声音。深圳大学的报告指出,许多用户并非被动困在“茧房”中,而是“主动的信息管理者”。超过60%的用户会主动寻求不同信息以对抗视野变窄,超过75%的用户相信能通过互动行为“驯化”算法。这表明,人类的能动性依然存在。

撕裂社会的根源,或许并非算法本身,而是我们内心深处“趋同避异”的社交本能和对认知捷径的依赖。阿姆斯特丹大学的模拟实验甚至发现,在一个没有推荐算法的极简社交平台,用户依然会自发地形成“回音室”,极端声音依然会被放大。算法在很多时候,只是放大了我们固有的认知偏见。

因此,走出困境需要一场多维度的变革:

算法是一面镜子,它既能映照出我们最好奇、最热情的一面,也能放大我们最懒惰、最偏执的阴暗。我们不必砸碎镜子,但必须学会如何使用它,看清镜中完整的世界,而不仅仅是那个被精心裁剪、让我们感觉良好的自己。