11 天前

11 天前

想象一下:在普通Chrome浏览器里,11万个积木块被球体狠狠撞向地面——它们翻滚、堆叠、碰撞,每一块的运动都精准符合物理规律,全程稳定在60帧。这不是游戏主机的专属,也不需要下载几个G的客户端,只是一个基于WebGPU的实验项目。它的核心,是2025年犹他大学团队提出的AVBD算法——一种能在浏览器里把物理模拟精度和速度拉到新高度的求解器。为什么之前做不到?这背后藏着物理引擎和Web技术的双重突破。

物理模拟的核心矛盾,从来都是「精度」和「速度」的拉扯。传统求解器要么为了实时性牺牲约束精度,导致积木块穿透、堆叠倒塌;要么为了准确卡死计算量,只能处理几十个物体。犹他大学的Giles团队盯上的,就是这个死结。

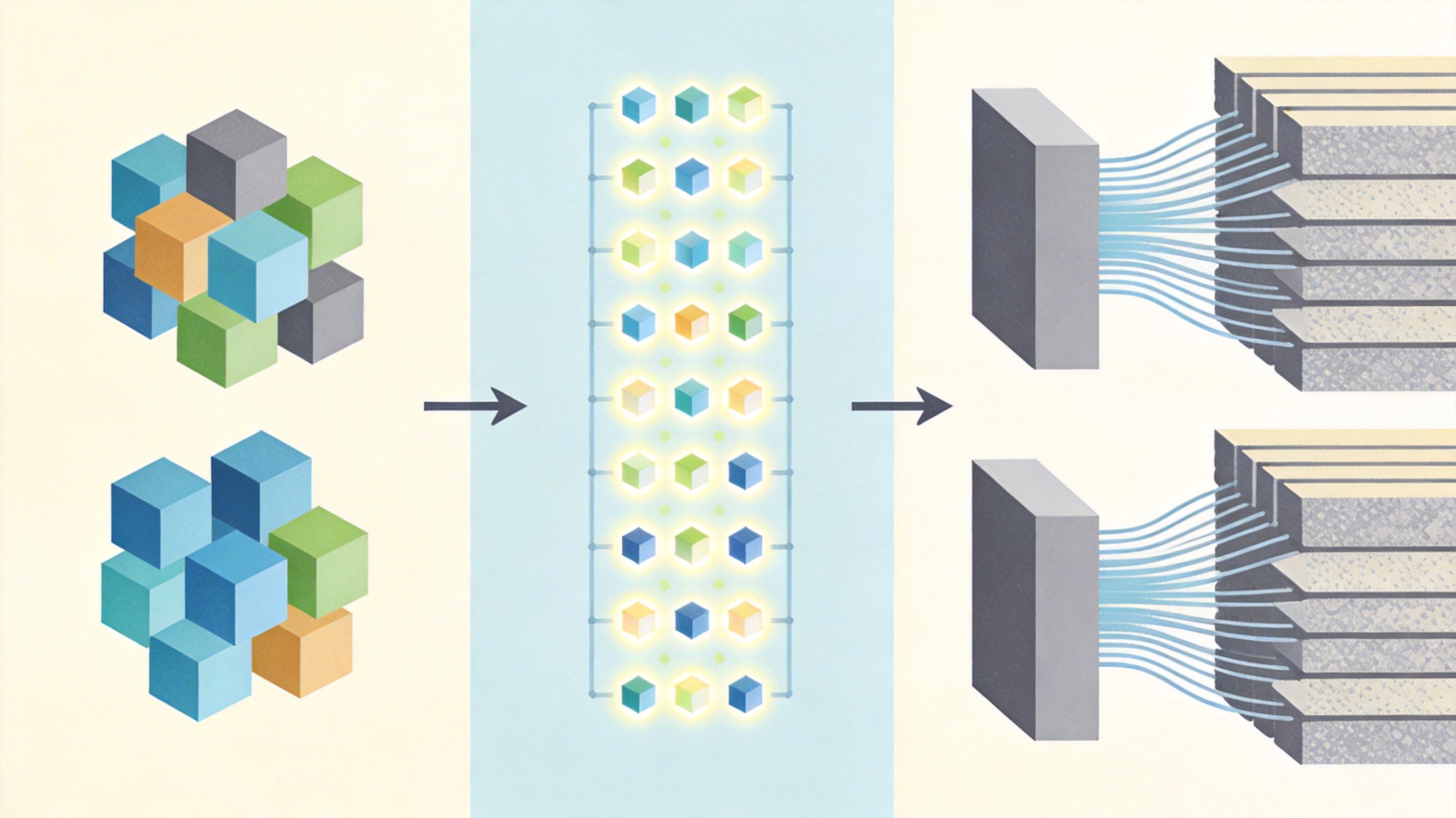

你可以把AVBD的思路比作「分组打扫卫生」:先把整个场景的物体按约束关系「涂色」——同一颜色的物体彼此没有直接约束,能同时计算;然后每次迭代只调整一组物体的状态,用顶点级的高斯-赛德尔迭代让全局能量一步步降低。而增广拉格朗日方法的加入,相当于给硬约束加了个「弹性缓冲」,既保证积木块不会互相穿透,又避免了传统罚函数方法里数值僵硬、容易震荡的问题。

但真实的机制比这更精确:

在RTX 4090 GPU上,11万个积木块的模拟只需要3.5毫秒每帧,算上碰撞检测也才9.8毫秒——这是之前Web端物理引擎想都不敢想的速度。

如果说AVBD是「大脑」,那WebGPU就是让这台大脑全力运转的「神经通路」。在此之前,WebGL只能通过图形管线绕弯子做计算,不仅效率低,还碰不到GPU并行计算的核心能力。WebGPU的出现,第一次给浏览器打开了GPU通用计算的大门——计算着色器、存储缓冲区、显式资源绑定,这些之前只有本地游戏引擎能用到的特性,现在网页也能直接调用。

AVBD和WebGPU的适配堪称天作之合:AVBD的「涂色分组」刚好契合GPU的SIMD并行架构,同一颜色的物体能被数千个GPU核心同时处理;WebGPU的纹理和多渲染目标功能,能高效管理百万级物体的状态数据,避免了CPU和GPU之间频繁的数据传输瓶颈。

当然,现在的WebGPU也不是完美的。它的开发门槛比WebGL高得多,光是申请设备、配置管线、管理绑定组的样板代码就能劝退一批新手;老旧设备的兼容模式会砍掉不少高级特性,性能打折扣;不同浏览器的实现细节还有差异,开发者得做不少兼容工作。但不可否认的是,它给Web端物理模拟撕开了一道口子——之前只能在本地跑的工业级仿真,现在网页就能实现。

现在这个基于WebGPU的AVBD原型,还只是个实验品。它没有实现论文里的双缓冲位置更新,而是用了就地更新来简化代码,这在极端场景下可能会出现同组物体的计算冲突;碰撞检测的效率还有提升空间,还没完全榨干现代GPU的硬件加速能力;参数调优也依赖经验,不同场景的刚度、对偶变量得手动调整,通用性还有待打磨。

更现实的问题是用户端的兼容性。2026年的WebGPU虽然已经被主流浏览器支持,但仍有近30%的桌面用户用着不支持的旧设备,移动端的覆盖范围更低。开发者得做一套自动降级机制,在不支持WebGPU的设备上回退到WebGL甚至CPU计算,这又会增加开发成本。

还有一个容易被忽略的点:物理模拟的精度和真实感之间,有时候也需要妥协。比如为了实时性,AVBD会限制迭代次数,这在一些对力的传播要求极高的场景——比如多米诺骨牌的连锁反应——可能会出现细微的误差。

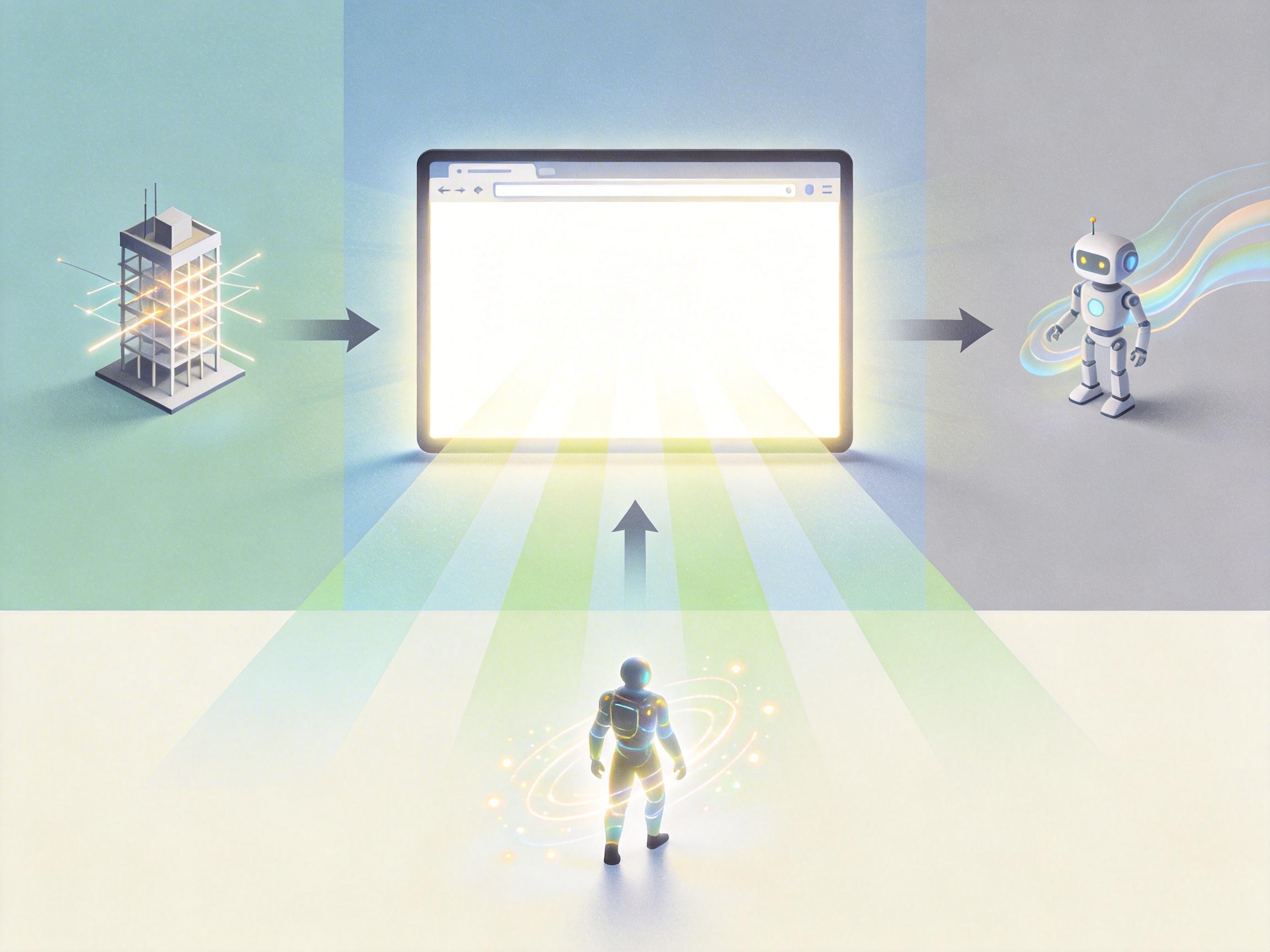

当我们在浏览器里拖动那11万个积木块时,其实见证的是Web技术的一次边界拓展:从展示静态内容、播放视频,到能承载工业级的物理仿真。这不再是「网页版小游戏」的妥协,而是真正把本地应用的性能,搬进了浏览器窗口。

算力的民主化从来不是一句空话。未来,我们可能不需要下载专业软件,就能在网页里做建筑结构仿真、机器人运动模拟;不需要高端游戏主机,就能在浏览器里玩到物理效果拉满的3A游戏。

算力无界,网页即应用。 这不是遥远的未来,而是已经在发生的当下——就像那个在Chrome里翻滚的积木堆,每一次碰撞都在提醒我们:Web的潜力,远不止于此。

点击充电,成为大圆镜下一个视频选题!