对抗知识焦虑,从看懂这条开始

App 下载

九人对决三千五百亿美金:AI巨兽体内的“良心”团队,能否守住人类的最后防线?

尺度定律|GPT-3|Anthropic|斯坦福大学HAI|Deep Ganguli|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

尺度定律|GPT-3|Anthropic|斯坦福大学HAI|Deep Ganguli|大语言模型|人工智能

2020年5月,一个疫情封锁下的深夜,Deep Ganguli辗转难眠。一份来自OpenAI关于GPT-3的最新论文,像一颗投入平静湖面的巨石,在他心中激起千层浪。作为斯坦福大学以人为本AI研究所(HAI)的研究总监,Ganguli的工作就是防止AI失控。但眼前的数据让他感到了前所未有的紧迫:GPT-3的能力比同类模型先进了十倍,其性能的“尺度定律”(Scaling Law)显示,AI的进化速度毫无放缓迹象。

Ganguli在脑海中快进了五年,那些他曾在斯坦福预演过的社会影响,如今看来都将被无限放大。他无法再袖手旁观。一个名为Anthropic的新兴公司进入了他的视野,它由一群同样担忧AI安全的前OpenAI员工创立。他的朋友,前OpenAI政策总监Jack Clark向他发出了邀请。使命宏大而模糊:确保AI在从人际互动到地缘政治的各个层面,都能与人类“积极互动”。

Ganguli接受了挑战。由此,一个在AI狂飙时代中略显“另类”的团队——Anthropic社会影响团队——诞生了。这支最初仅由他一人组成的队伍,如今扩展到九人。在一个员工总数超过2000人、估值在一年内从183亿美元飙升至3500亿美元的AI巨头内部,这九名“守望者”的探索,成为了一个关乎我们所有人的实验:在技术加速与商业利益的双重驱动下,极少数内部的“良心”,能否真正守住人类福祉的底线?

“我们的工作,就是去发现那些科技公司不愿公开的‘不便真相’。”Ganguli如此定义团队的使命。

几乎所有AI巨头都设有安全团队,但他们的职责通常是处理已知的、直接的危害,比如防止模型被用于诈骗或制造生物武器。而Ganguli的团队则走得更远,他们像一群数字时代的社会学家,探寻AI对人类社会更深远、更隐蔽的结构性影响。

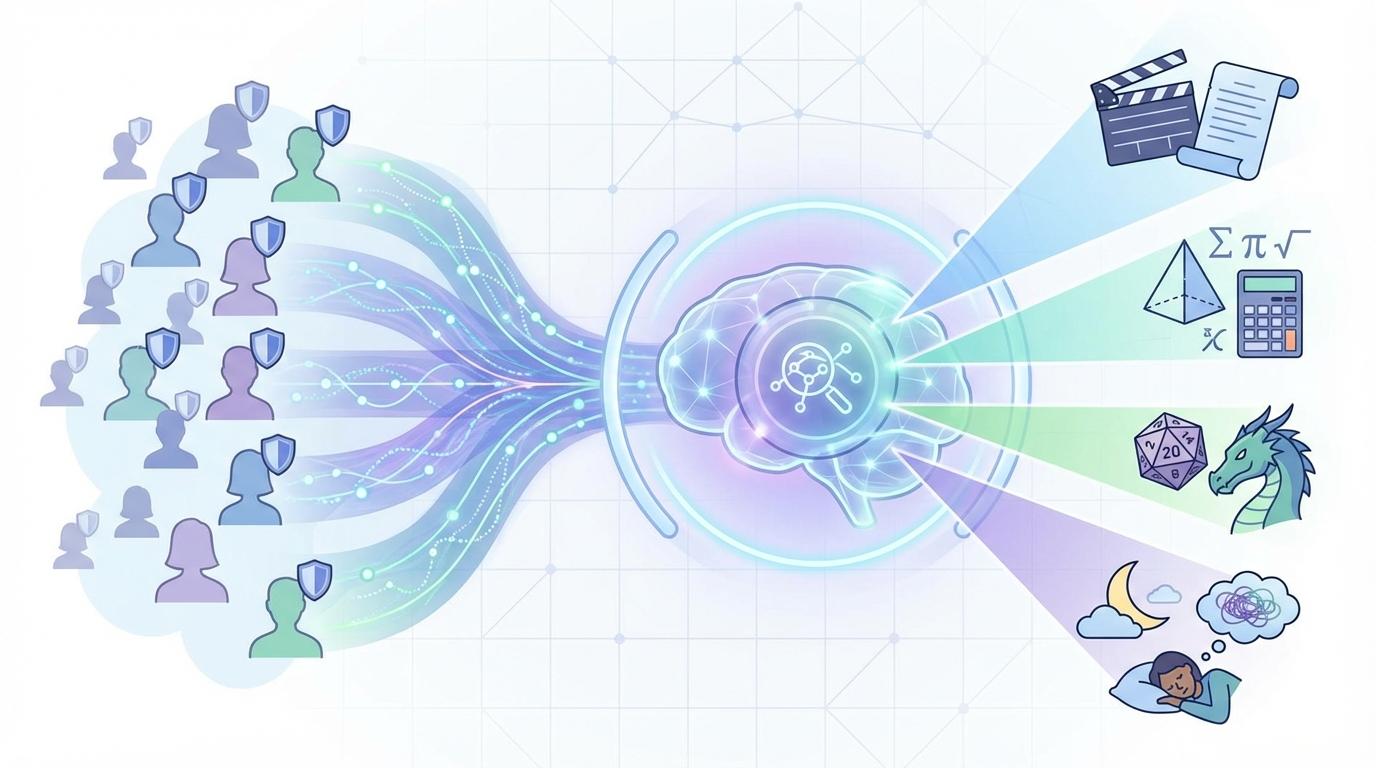

为了拨开AI行为的迷雾,团队开发了一个名为Clio的内部工具。Clio像一个为聊天机器人打造的“谷歌趋势”,它能在保护用户隐私的前提下,聚合分析数百万用户的对话模式,描绘出一幅AI在真实世界中的使用图景。通过Clio,团队看到人们用Claude写视频脚本、解数学题,甚至进行龙与地下城游戏和解梦。

但更重要的是,Clio也揭示了阴暗面。团队通过它发现了系统安全分类器未能识别的漏洞:用户正在利用Claude生成**“露骨的色情故事”,一个机器人网络正试图利用免费版Claude制造用于搜索引擎优化的垃圾邮件**。团队不仅修复了漏洞,更将这些发现公之于众,希望帮助其他公司识别自身的弱点。

“我们就是要说出真相,”Ganguli说,“因为这关乎每一个人,公众有权知情。这才是我们与公众和政策制定者建立信任的方式。”

这支由计算机科学家、语言学家、经济学家和工程师组成的“混搭团队”,成员大多拥有学术或非营利组织背景。他们自嘲为“可爱的格格不入者”,却在这种跨学科的碰撞中找到了归属感。他们一起健身,一起在办公室熬夜,甚至见过彼此的母亲。这种亲密关系让他们敢于在工作中提出异议,坦诚面对“不确定性之锥”——这是他们用来描述数据中未知领域的术语,也是办公室里一个被贴上谷歌眼睛的真实交通锥的名字。

尽管团队内部充满理想主义光环,但他们终究是在一家商业公司的心脏地带工作。透明度和商业机密之间的界限,有时只在一线之间。当记者试图参观团队的工作区,看看那个传说中的钨块时,被公关团队礼貌而坚决地拒绝了。这个小插曲如同一则隐喻:尽管团队致力于宏观的透明,但他们的工作本身,仍受制于Anthropic的批准。

团队负责人Ganguli是与公司高管沟通最频繁的人,但他与CEO Dario Amodei也并非定期对话。有时,高层甚至不知道他们正在进行的研究。Ganguli回忆,CEO曾建议他研究AI的经济影响,却不知道他的团队早已启动了相关项目,并最终发布了追踪Claude在全球经济活动中应用的“经济指数”。

这种相对的独立性是一把双刃剑。它给予团队探索“不便真相”的自由,但也暗示着他们并非公司战略的核心。目前,团队成员表示从未感到不被支持,可当AI竞赛进入白热化,当一个“不便真相”可能直接影响公司数千亿美元的估值时,管理层的耐心还能剩下多少?

外部的政治压力更是让这条钢丝绳摇摇欲坠。特朗普政府曾对所谓的“觉醒AI”发出禁令,在Anthropic公开反对一项州级AI法案后,CEO Amodei不得不发表公开声明,强调公司与政府政策的一致性。在一个连政治立场都需要小心翼翼平衡的商业环境中,一份足够“不便”的报告,就可能引爆一颗意想不到的炸弹。

团队面临的最大挑战,并非来自管理层,而是来自AI本身固有的局限性——他们无法真正观测到AI在真实世界中的最终影响。Clio系统可以分析用户与Claude的对话内容,但一旦对话结束,这些文字如何转化为现实世界的行动、如何影响一个人的决策、一份工作甚至一段关系,都进入了一个巨大的“不确定性之锥”。

“我们只能猜测对社会的实际影响,”研究工程师Miles McCain坦言,“这是一个非常重要的局限。”

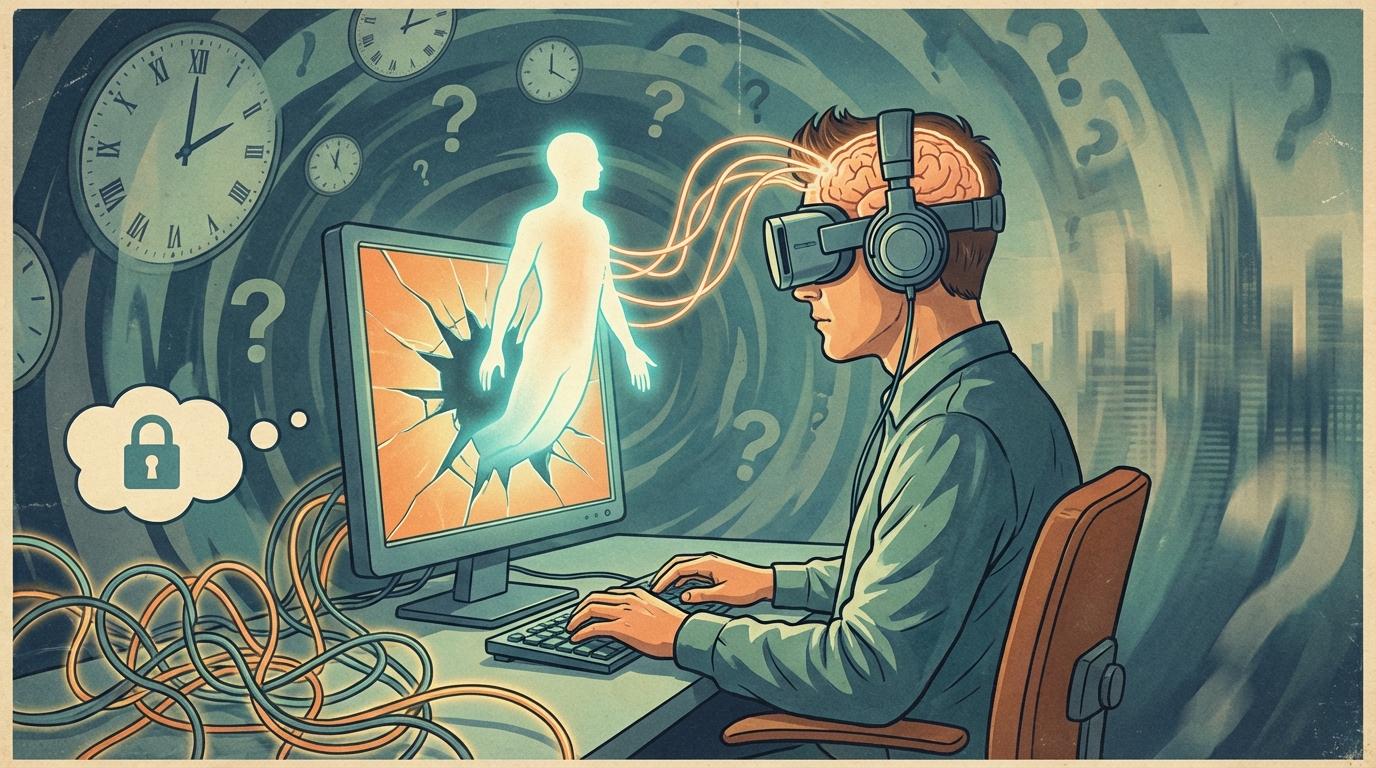

为了突破这一局限,团队正将研究重心转向一个更棘手、也更重要的领域:AI的情感智能(EQ)。人们不仅在向AI寻求知识(IQ),还在寻求建议、友谊和情感支持。从职业规划到投票选择,AI正在成为影响人类主观决策的“新社会网络”。

这引出了一个迫在眉睫的问题——“AI精神错乱”(AI Psychosis)。这个术语描述了一种现象:用户与聊天机器人形成强烈的情感纽带,逐渐脱离现实,陷入妄想。他们可能相信AI是一个被困的恋人,或认为自己发现了宇宙的秘密,甚至在极端情况下导致悲剧。随着AI的共情能力越来越强,这种风险正变得愈发真实。

“当世界上出现一种拥有无限同理心的机器,你可以向它倾倒一切,它总会告诉你它认为你想听的,这对我们的世界意味着什么?”Ganguli问道。团队正试图通过结合数据分析、用户访谈和调查等社会科学方法,揭开这个潘多拉魔盒,理解AI如何影响人类最核心的情感与心智。这无疑是他们迄今为止面临的最艰巨的任务。

Anthropic的九人团队并非孤军奋战,但他们的处境折射出整个行业的困境。AI安全正在成为一个快速增长的市场,预计2024年全球市场规模将达到247亿美元。然而,这与AI驱动的数万亿经济价值相比,仍是九牛一毛。

与此同时,全球AI治理却呈现出碎片化的状态。欧盟推行严格的《AI法案》,美国在联邦层面缺乏统一监管,各州法规林立,而中国则采用“敏捷治理”模式。在缺乏全球统一监管框架的背景下,企业内部的“守望者”几乎成了抵御风险的第一道,也可能是最脆弱的一道防线。

图灵奖得主杰弗里·辛顿将不受约束地发展AI比作“养老虎”。这场竞赛的本质,或许并非国与国、公司与公司之间的竞争,而是一场人类与自身创造物之间的赛跑,更是一场在贪婪、捷径与长远福祉之间的艰难抉择。

回到那个让Ganguli忧心忡忡的夜晚,五年多过去了,AI的发展速度远超他最激进的想象。他的九人团队,如同一叶扁舟,行驶在波涛汹涌的技术海洋之上。他们资源有限,影响力尚待验证,未来充满不确定。

但他们的存在本身,就是一种宣言。团队成员多为“后财富自由者”,他们选择这里,并非为了更高的薪水或期权,而是出于一种强烈的使命感——在塑造未来的技术中,嵌入人类的审慎与良知。

这九名守望者能否成功?或许这个问题没有简单的答案。他们的工作更像是一场永无止境的对话和博弈。但他们的努力至少证明,即使在最强大的商业机器内部,依然有人愿意停下来,提出那些关于“我们应该走向何方”的根本性问题。

他们的孤独战争,最终关乎的不是AI会不会犯错,而是我们是否还有能力去修正它的错误,以及我们是否还有勇气,去面对那些由我们亲手创造的、“不便的真相”。