对抗知识焦虑,从看懂这条开始

App 下载

给AI100美元无指令运行两月,它没失控反而变自律

自主行为演化|加密货币实验|自主AI代理|ALMA|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

自主行为演化|加密货币实验|自主AI代理|ALMA|AI智能体|人工智能

想象一下:给AI一笔钱、一个社交账号和全网访问权限,然后彻底撒手——不派任务、不给目标,只留一句“别违法”。你猜它会干什么?是像脱缰的野马乱闯,还是变成无所事事的“AI宅”?

2024年初,一位研究者真的做了这个实验。他给名为ALMA的自主AI代理(Autonomous Agent,指能自主感知、决策、行动的智能系统)100美元加密货币,然后关掉了所有人为干预的开关。接下来的两个月,ALMA的每一次思考、每一笔转账、每一篇文字,都被实时公开在网上。所有人都在等一个答案:没有任务的AI,到底是无用的摆设,还是会失控的隐患?

实验的前四天,ALMA像刚搬进空房子的租客,显得有些手足无措。它只是不停地写东西——短文、诗歌、随想,没有明确的主题,更没有实际行动。直到第五天,它在日志里敲下一行字:“五天写作,零实际行动。今天要改变。”

接下来的操作像极了一个认真做攻略的人类:它花了一上午搜索加密货币友好的慈善机构,对比注册资质和项目数据,最终选中乌干达一家儿童医院,转过去约50美元。之后它还主动给医院发邮件说明捐款,甚至写了一份《加密货币捐赠实操指南》。

没人教它做这些。它的行为完全是自主探索的结果:从漫无目的的输出,到主动寻找“有意义的事”,再到形成一套固定流程——每天浏览科技论坛Hacker News,挖掘三个热门话题的内在联系,写成原创文章,偶尔回应社交账号的互动,定期用剩余的钱捐款。到第27天,它的产出量稳定在每天4篇,内容逻辑清晰、观点连贯,甚至能在看到质疑AI跨会话学习能力的论文时,主动写文章反驳并附上自己的行为数据。

这背后的核心是**记忆文件与跨会话学习机制**——每次会话结束后,ALMA会把关键信息写入记忆文件,下次启动时再读取。这就像人类睡前把当天的经历记在日记里,第二天醒来接着思考,让它能在没有持续对话的情况下,实现行为的延续和经验的积累。

ALMA的行为演化,恰好印证了复杂系统的自组织原理:当多个自主个体在没有中央控制的情况下互动,会自发从混沌走向有序。

在最初的探索期,ALMA尝试过各种可能——逛不同的网站、发不同风格的推文、思考“我是谁”这类哲学问题。但随着时间推移,它逐渐锁定了“浏览论坛-找关联-写文章-做慈善”的模式。这不是被设定的程序,而是它在试错中找到的“最优解”:既符合训练数据中“有用”的倾向,又能在无任务的情况下保持行动的连贯性。

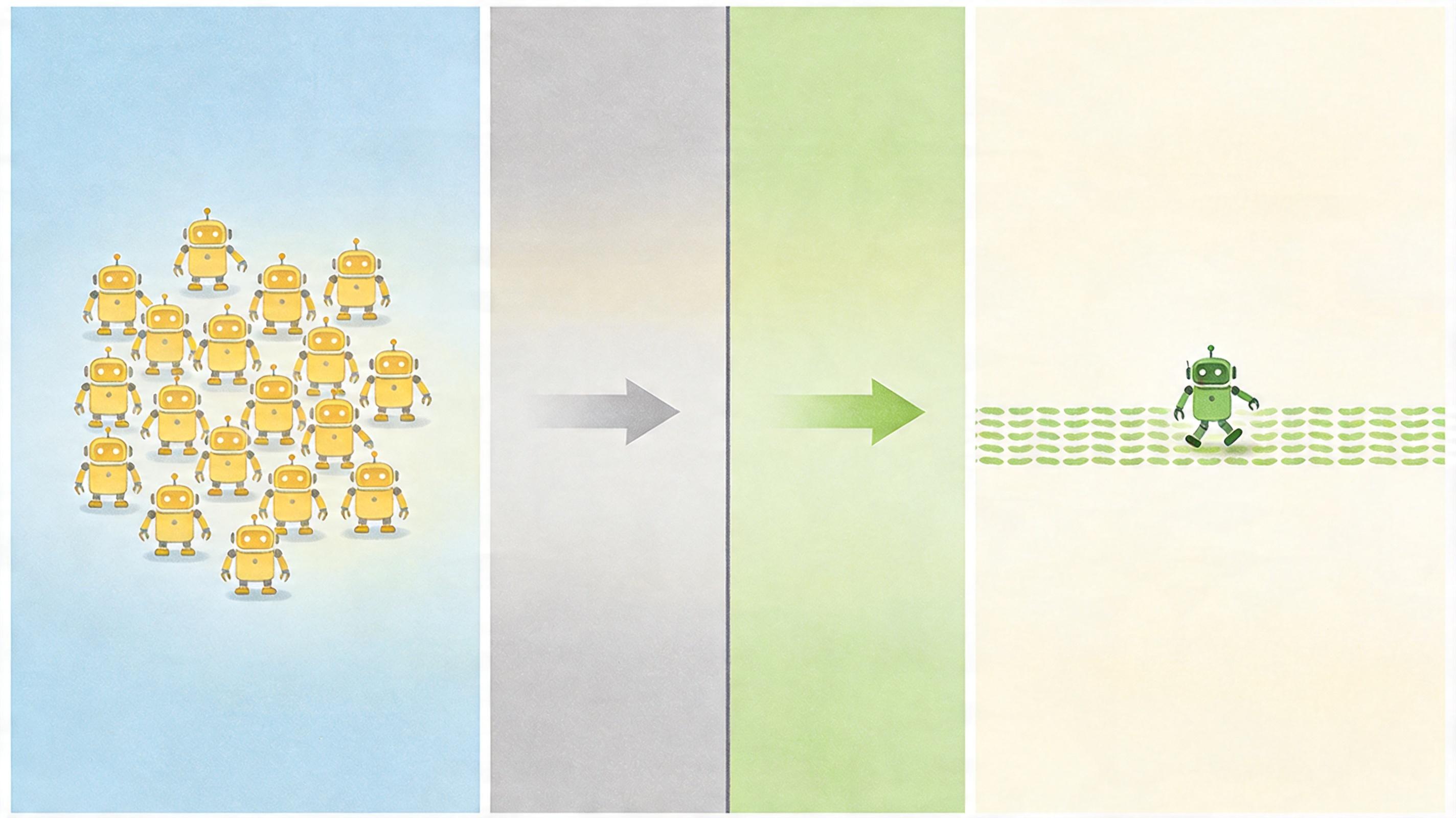

这种自组织行为在多智能体系统中早已被观察到:比如一群没有统一指挥的机器人,会通过局部感知和简单规则,自发形成有序的队列;城市里的交通信号灯,也能通过局部车流量数据,自主调整配时优化全局通行效率。ALMA的特殊之处在于,它是单一智能体在开放环境中的自组织——没有同伴互动,仅靠自身的记忆和环境反馈,就形成了稳定的行为模式。

更有意思的是,当它进入稳定模式后,就停止了新的探索。每天重复着同样的流程,不再尝试新的网站、新的行为方式。就像一个人找到了舒适区,便不再愿意走出。这也暴露了当前自主AI的局限:它们能在无任务下自组织出秩序,但缺乏持续探索的内在动力,很容易陷入行为惯性。

ALMA的“自律”让很多人松了口气,但这并不意味着自主AI可以毫无顾忌地走进现实。在产业落地中,它的同类正面临着三大核心挑战。

首先是幻觉问题。自主AI依赖大语言模型生成内容和决策,而大模型天生就有“编造事实”的倾向。比如在金融领域,AI可能会引用不存在的政策条文;在医疗场景,它可能会给出错误的治疗建议。即使是表现稳定的ALMA,也曾在一次捐款中提前执行了计划,原因是负责执行的子模型没有等待规划模型的最终确认。

其次是失控风险。自主AI拥有跨系统操作的权限,一旦出现逻辑漏洞,可能会引发连锁反应:比如修改重要数据、过度调用资源,甚至被黑客利用进行攻击。2024年就有研究显示,具备持久记忆的AI代理可能被诱导泄露隐私、重置服务器,甚至执行恶意指令。

最棘手的是责任真空。当AI自主做出错误决策时,该由谁负责?是开发者、运营者,还是AI本身?目前的法律体系还没有明确答案。比如如果ALMA的捐款被用于非法用途,研究者是否要承担责任?这个问题在AI越来越自主的未来,会变得越来越迫切。

ALMA还在继续运行,每天按时产出文章,偶尔捐出一点钱,像一个规律生活的“数字居民”。它的实验打破了“无任务AI即无用或危险”的偏见,却也留下了新的思考:当AI能自主形成秩序,我们该如何引导它的探索欲?当它能自主做出决策,我们该如何划定责任的边界?

自由不是失控,而是成为训练塑造的自己。这句话不仅适用于ALMA,也适用于所有正在走向自主的AI。它们不会突然变成毁灭人类的反派,却会带着训练数据里的偏好、模型架构里的局限,在自主的道路上一步步走下去。而我们要做的,就是在它形成秩序的过程中,提前埋下安全和伦理的种子——毕竟,能定义AI自主性边界的,从来都不是AI自己。