对抗知识焦虑,从看懂这条开始

App 下载

别把AI当软件更,要当实验室来用

企业AI转型|软件部署逻辑|生成式AI试点|里德·霍夫曼|LinkedIn|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

企业AI转型|软件部署逻辑|生成式AI试点|里德·霍夫曼|LinkedIn|AI产业应用|人工智能

2026年春的华盛顿会议厅里,LinkedIn联合创始人里德·霍夫曼的一句话,戳中了95%企业的AI痛点——他们还在把AI当成普通软件,走「小团队试点→打磨原型→全公司推广」的老流程。但现实是,近九成的生成式AI试点没拿到可量化的财务成果,要么工具和业务流程脱节,要么员工因不信任把AI用成了摆设。为什么遵循了几十年的软件部署逻辑,到AI这里就失效了?

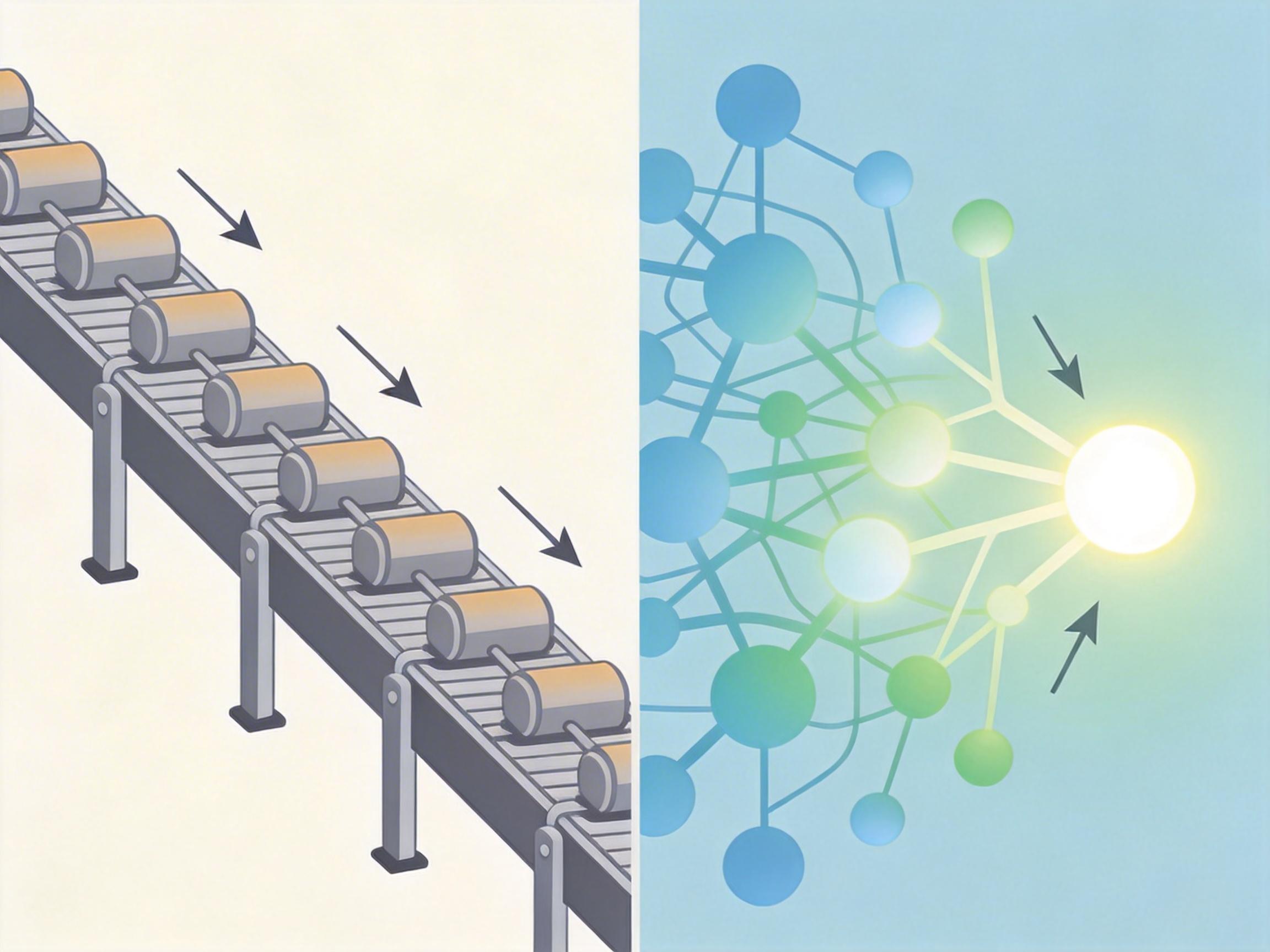

你可以把传统软件开发想象成装修房子:先确定户型、风格和材料,按图纸一步步施工,最终交付一个符合预期的成品。但AI开发更像开盲盒创业——你不知道里面装着什么,只能先拿小成本试错,根据每次拆出来的东西调整方向,直到找到能盈利的组合。

这是两种完全不同的逻辑:传统软件工程的核心是「控制风险」,需求明确、流程线性,每一步都要确保不出错;而AI的本质是「数据驱动的探索」,需求模糊、结果不确定,必须通过多轮实验测试不同模型、数据和参数,才能找到最优解。

霍夫曼反对的,正是用装修房子的思路开盲盒。他建议企业放弃小范围试点,让全公司员工都拿AI工具当「实验试剂」——用AI tokens尝试不同场景,每周开一次会分享「这周用AI试了什么、学到了什么」。这种模式不是要追求一次性成功,而是要把整个公司变成一个持续学习的实验室。

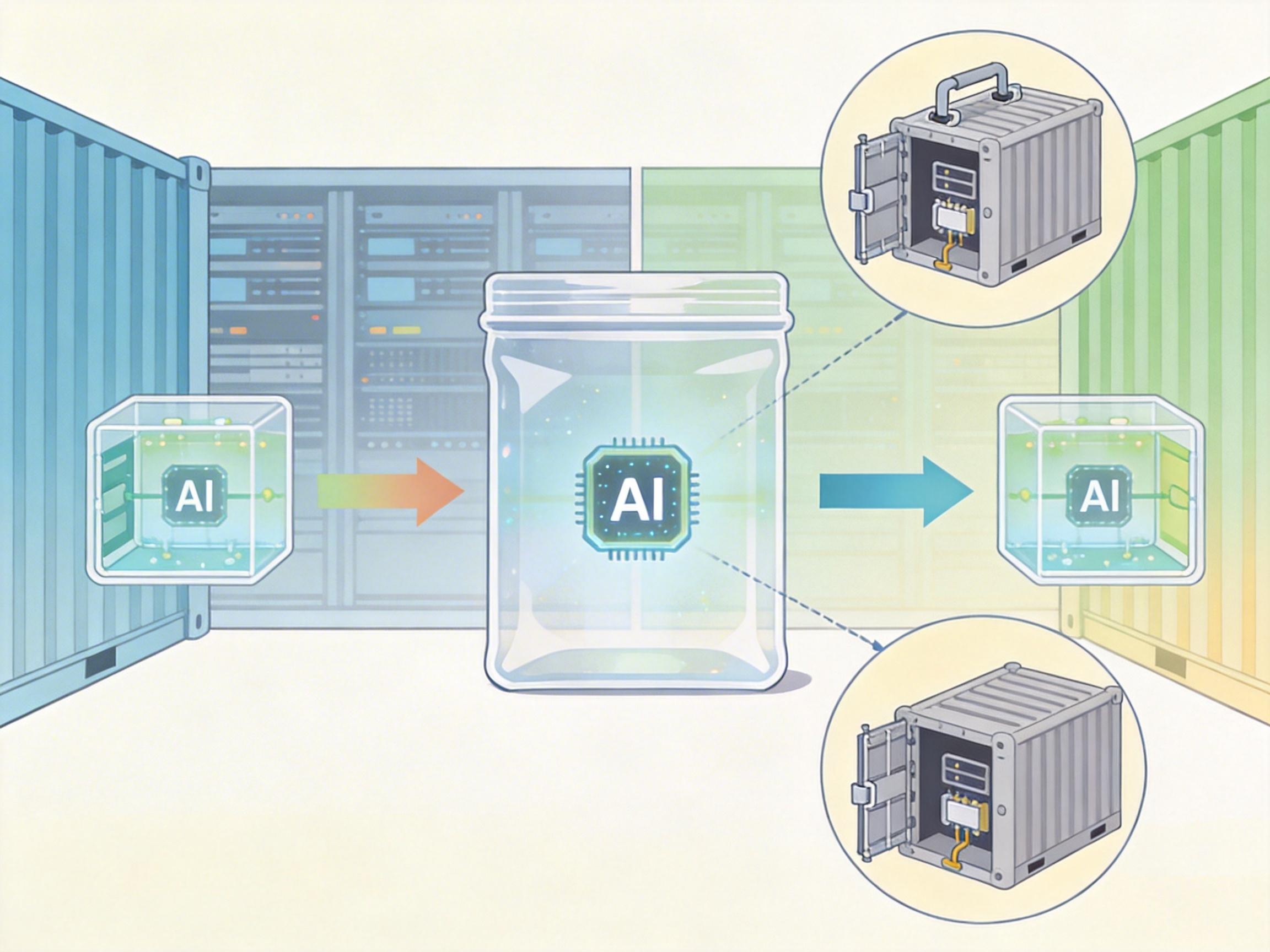

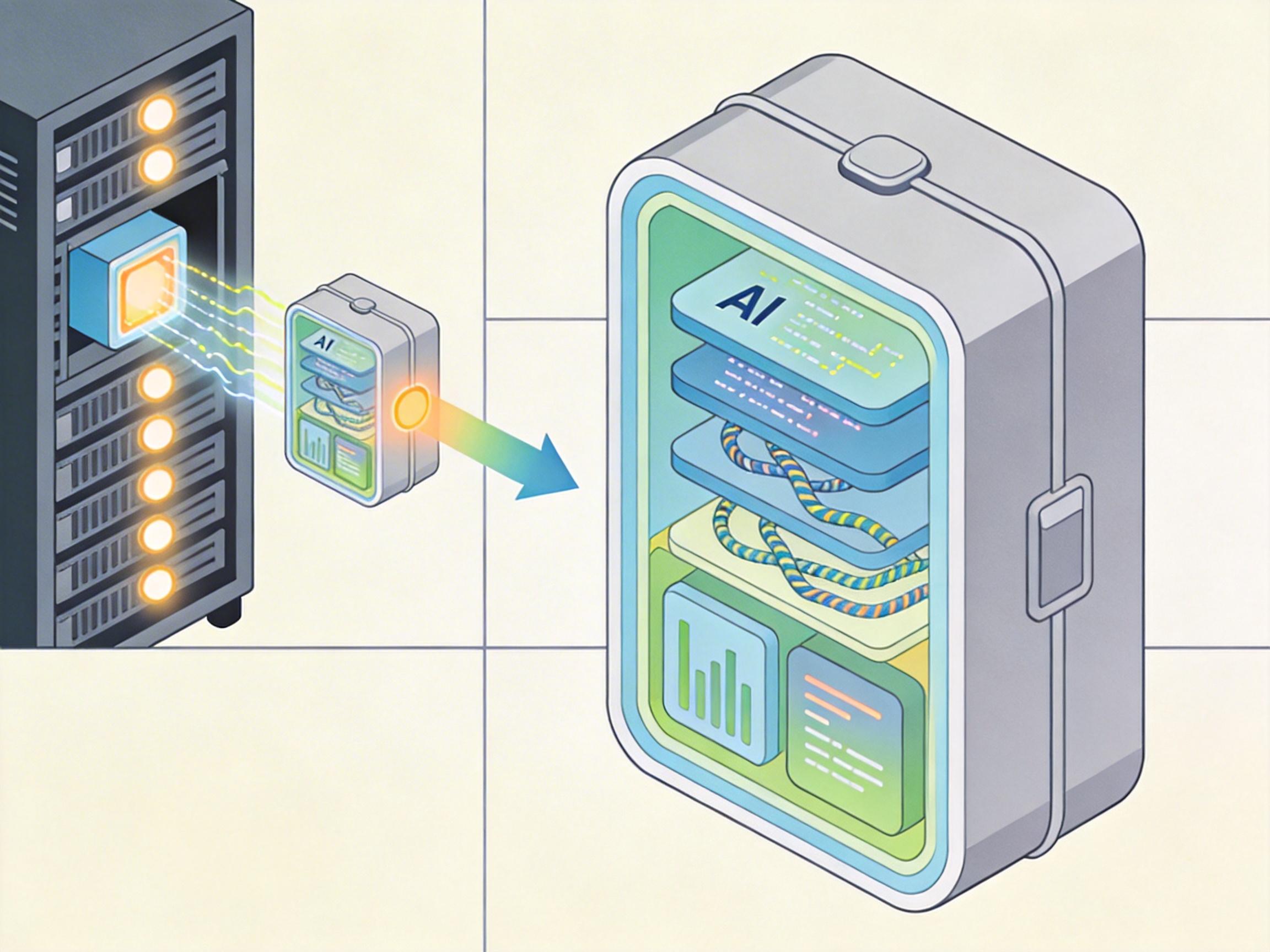

要让全公司都敢做实验,得先解决两个问题:怎么保证每次实验不干扰现有业务,怎么快速切换不同的AI模型?容器化技术就是答案——它像实验室里的独立操作台,每个AI实验都在自己的「容器」里进行,互不干扰,还能随时搬走或替换。

你可以把容器理解成一个打包好的「AI工具箱」:里面装着AI模型、运行代码和所有依赖环境,不管放到哪台服务器或云平台上,都能直接启动。比如谷歌的GKE平台,能自动给AI实验分配计算资源,实验结束就回收,既保证了弹性,又降低了成本。

科尔盖特-棕榄的实践就是最好的例子:他们用容器化搭建了内部AI平台,让员工能快速调用定制化GPT助手,还能自己构建AI工具。这套系统不仅让跨语言技术手册翻译效率提升了数倍,还通过严格的权限管理,确保了业务数据的安全。

但技术只是基础,真正的门槛在人的身上。MIT的报告显示,AI项目失败的核心不是技术不行,而是「学习差距」——员工怕用错AI被问责,领导怕实验失败影响KPI,整个组织都陷在「风险最小化」的惯性里。

霍夫曼提出的每周分享会,本质是在给「试错」正名。这就像学校里的错题本:不是要惩罚做错的人,而是要让所有人都能从错误里学到东西。斯坦福的研究也证明,这种「心理安全」的环境,能让团队的创新能力提升3倍以上。

要做到这一点,领导得先带头。比如亚马逊要求管理者把「尝试新事物」纳入绩效评估,IBM甚至把「失败的创新」也当成员工的加分项。当员工知道「试错不会被骂,反而能得到支持」时,才敢真正把AI用起来,而不是藏着掖着当「秘密赛博格」。

当我们谈论AI时,我们其实在谈论一种全新的工作方式——不是用机器替代人,而是让人学会和机器一起探索未知。霍夫曼的建议,本质上是在提醒企业:别再用旧地图找新大陆了。

真正能释放AI价值的,从来不是完美的技术,而是敢于试错的文化。与其等AI成熟了再行动,不如把今天的每一次尝试,都变成明天的竞争力。

AI的本质,是让组织学会持续学习。