1 个月前

1 个月前

2025年3月的俄克拉荷马草原,干燥的风卷着草屑掠过地面,一点火星在没人注意的角落燃了起来。换作十年前,这团火要烧到能被地面观测站发现,至少得等上3小时——足够它窜过三个农场,逼近最近的居民区。但那天,NASA FIRMS卫星的热红外传感器捕捉到了那点仅0.25英亩的热异常,AI算法在1分钟内完成了与GOES-19卫星影像、当地气象数据的交叉验证,警报直接推送到了州应急指挥中心的屏幕上。最终这场野火被控制在起步阶段,避免了8.5亿美元的损失。这不是科幻电影的片段,而是美国大陆野火监测的日常。但你有没有想过,这套AI系统是怎么从漫天数据里揪出那点不起眼的火星的?

你可以把这套系统想象成一个同时盯着上百台监控的保安——只不过它的监控镜头是绕着地球转的卫星,它的大脑是能同时处理几十种数据的AI模型。

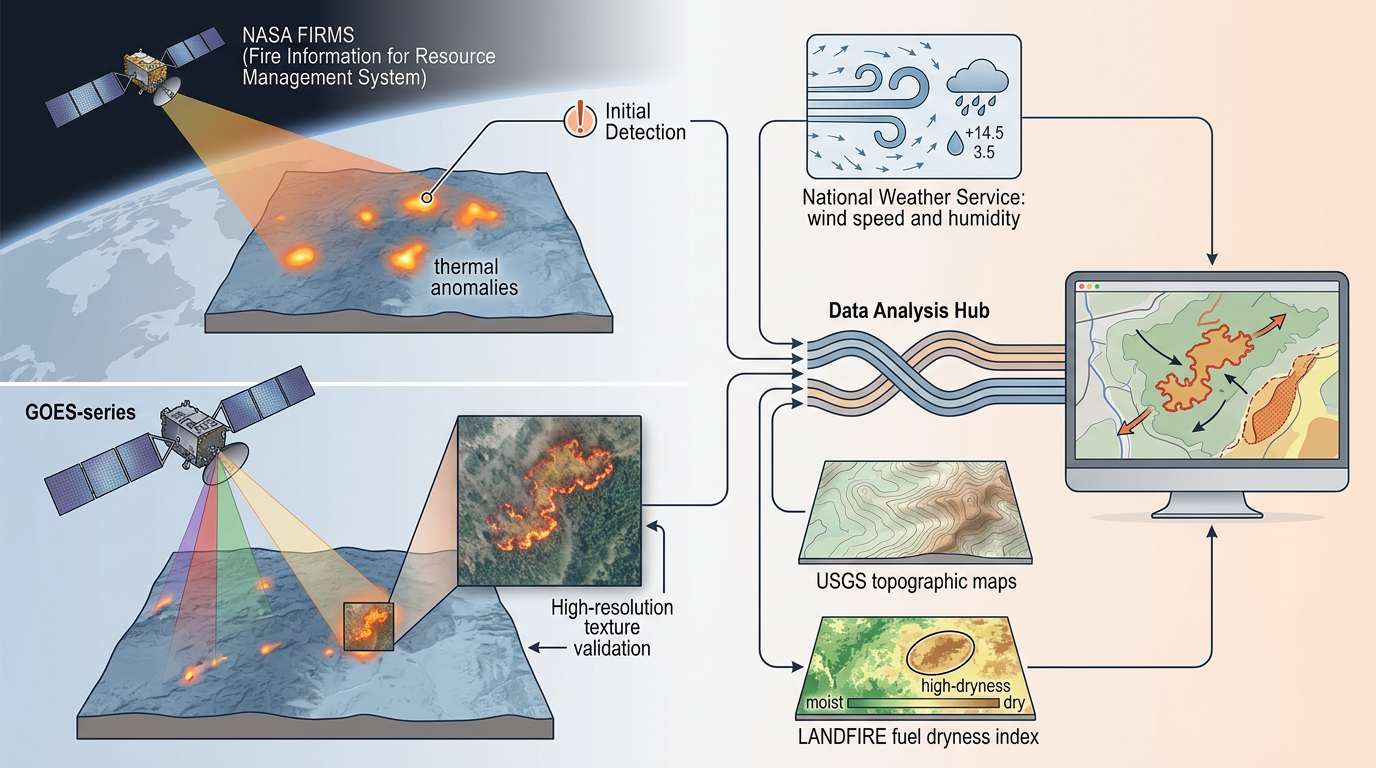

首先是“眼睛”:NASA FIRMS的热红外卫星负责扫出地面的“发热点”,就像用夜视仪找暗处的烟头;GOES系列静止卫星则用更高清的可见光和红外波段,给每个发热点拍特写,区分是野火还是工厂烟囱、甚至是反光的屋顶。这还不够,它还要调用美国国家气象局的风速湿度数据、USGS的地形地图、LANDFIRE的植被干燥度数据——相当于同时看天气预报、查地形手册、摸清楚周围有多少“干柴”。

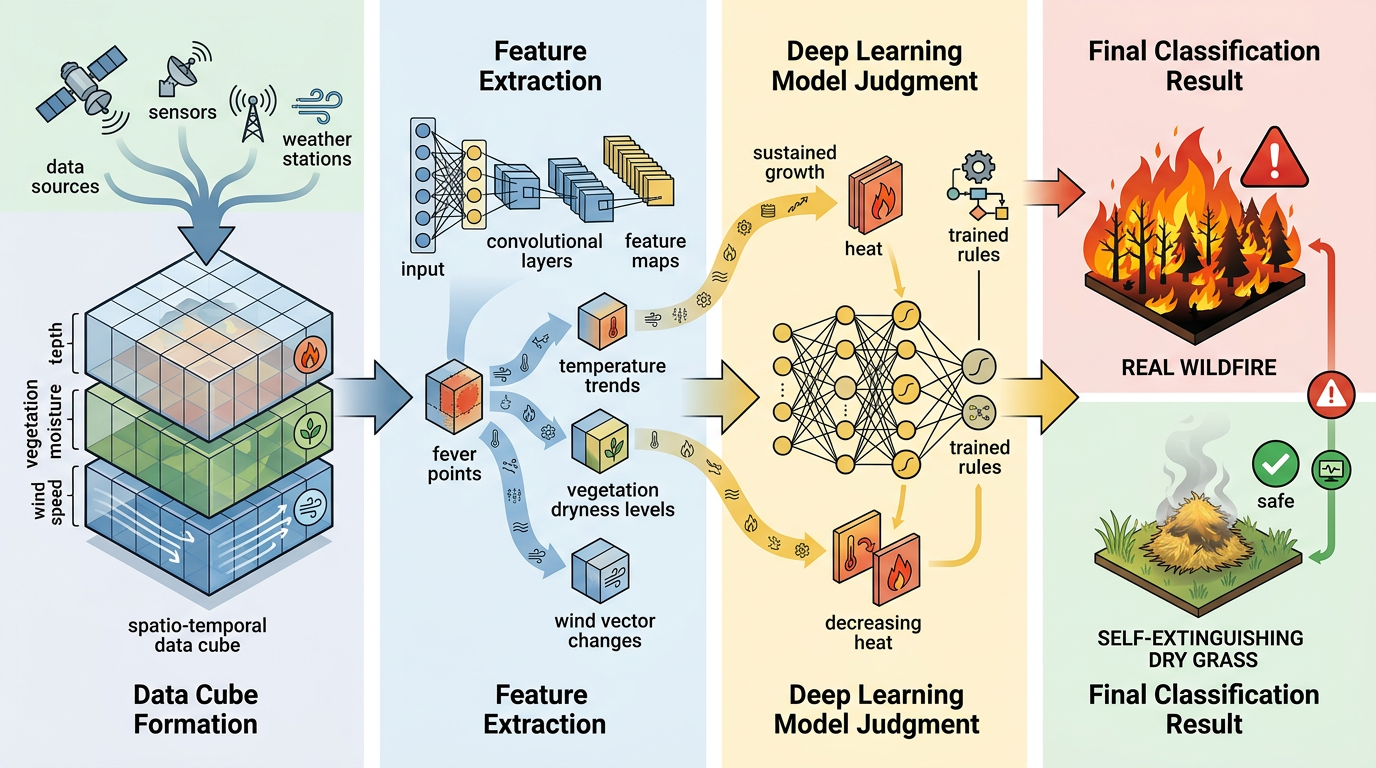

但真实的机制比这个保安类比更精确:系统会把所有数据塞进一个“时空数据立方体”,也就是把不同时间、不同来源的数据按地理位置拼成一个三维的“数据积木堆”。深度学习模型会像拆积木一样,把每个发热点的温度变化、周围植被的干燥程度、风向的变化拆成一个个特征,再用训练好的规则判断:这是真的野火,还是会自己熄灭的干草堆?

它的反应速度快到离谱——每分钟完成一轮全流程扫描,不需要任何人手动触发。

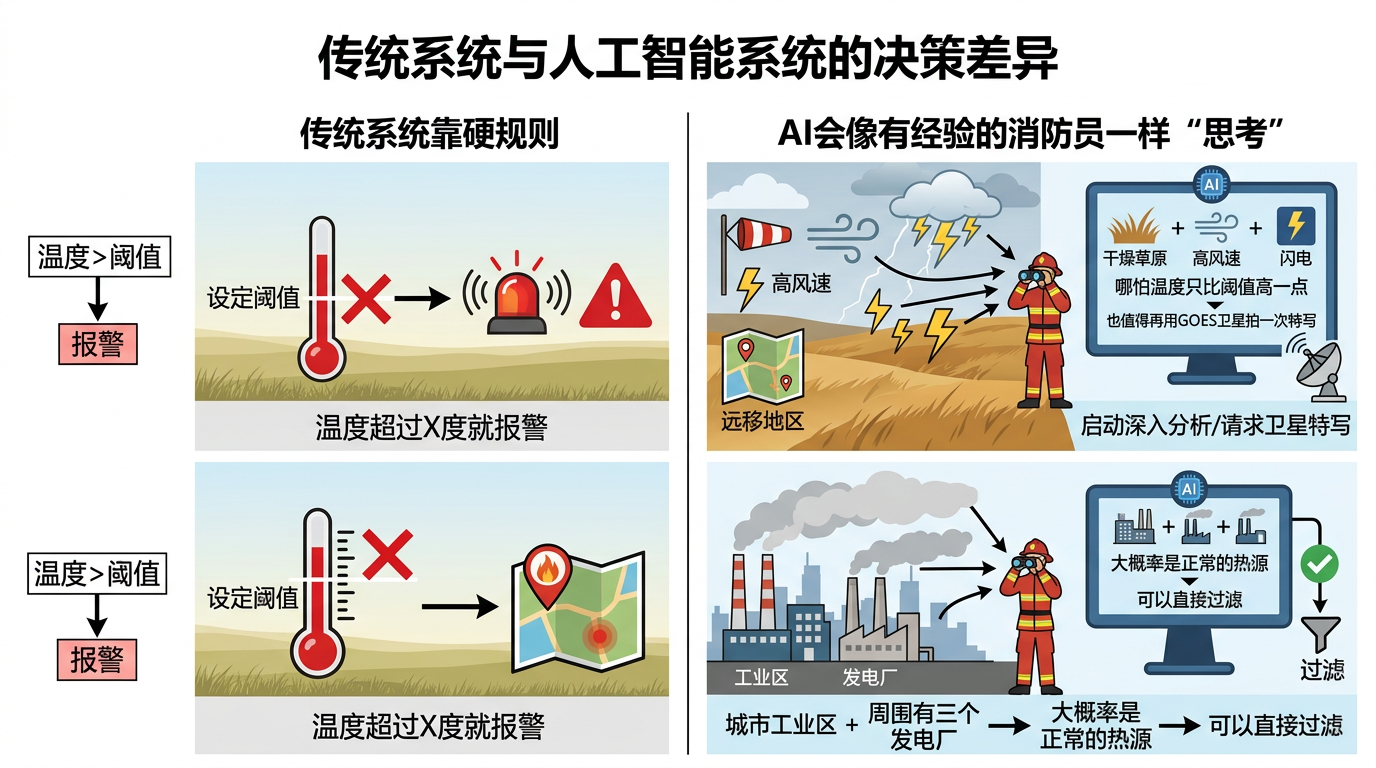

最考验AI的,是那些“模棱两可的信号”——比如一个被云层挡住的热异常,或者一个温度刚好卡在“正常”和“异常”之间的点。这时候就轮到“模型驱动分析”出场了,这也是这套系统和传统监测工具最大的区别。

传统系统靠硬规则:温度超过X度就报警,低于就忽略。但AI会像有经验的消防员一样“思考”:这个点在干燥的草原上,最近风速达到了每小时20英里,而且刚有过闪电——哪怕温度只比阈值高一点,也值得再用GOES卫星拍一次特写;如果这个点在城市工业区,周围有三个发电厂,那大概率是正常的热源,可以直接过滤。

威斯康星大学麦迪逊分校的开发团队做过统计,这套AI系统把传统卫星监测的误报率降低了35%——相当于以前每100个警报里有35个是假的,现在只剩23个。这省下来的不仅是应急资源,更是消防员的反应时间。

但这套系统也有自己的“盲区”:它没法像地面摄像头那样看到火的具体形态,只能靠温度和数据推理;如果云层太厚,卫星信号穿不过去,它也会“睁眼瞎”。更关键的是,它的判断依赖于过去的数据——如果遇到一种从未出现过的野火形态,比如在冻土带爆发的火灾,它的准确率会立刻下降。

很多人第一次听说这套系统,都会问:它能直接指挥灭火吗?答案是不能——而且开发者反复强调,它永远不能替代官方的应急信息。

这背后藏着一个容易被忽略的事实:AI的核心作用是“缩小信息差”,而不是“做决策”。它会把所有原始数据、分析过程、预测结果都明明白白地列在实时面板上——比如“这个火点的温度在10分钟内上升了200度,预计会向东北方向蔓延”,但不会说“快派10辆消防车去东北”。最终的决策,还是要交给懂当地地形、懂消防资源分配的人类指挥官。

美国国家野火协调组的调研显示,现在有91%的野火团队依赖气象数据,但只有21%的团队用了AI监测工具。不是技术不好用,而是很多地方买不起、也不会用这套系统——比如一些偏远的县,连稳定的网络都没有,更别说处理海量的卫星数据。还有的团队习惯了传统的监测方式,对AI的“黑盒”判断心存疑虑。

说白了,技术的瓶颈好突破,人和技术的磨合才是最难的。

当我们谈论AI监测野火时,我们其实在谈论的是“和时间赛跑”——每提前一分钟发现火情,就能多保住一片森林、几栋房子。但这场赛跑的终点,从来不是“让AI完全替代人类”,而是“让AI成为人类最可靠的眼睛”。

技术永远有局限:卫星会被云层挡住,AI会被陌生的场景难住,数据永远会有延迟。但它已经做到了以前人类做不到的事:盯着美国大陆的每一寸土地,在野火还只是一点火星的时候,就把它从漫天数据里揪出来。

火起于微末,防胜于无形。未来的野火防控,终究是技术的精度,加上人类的温度。

点击充电,成为大圆镜下一个视频选题!