1 个月前

1 个月前

当你对着ChatGPT敲下问题,0.1秒后收到回复的瞬间,你可能没意识到:这背后的AI推理——也就是让训练好的AI模型干活儿的过程——才是AI产业真正的“印钞机开关”。此前AI训练市场被英伟达攥着80%份额,但推理市场的蛋糕才刚被切开:2024年全球规模875亿美元,到2032年将翻4倍。而就在下周的GTC大会上,英伟达要把软硬两把刀同时插进这个市场。传闻中的新推理芯片、开源AI智能体平台NemoClaw,都是冲着“把推理的成本砍到地板,把效率抬到天花板”来的。但它真能在谷歌、亚马逊的围堵下,把推理市场也变成自己的后花园吗?

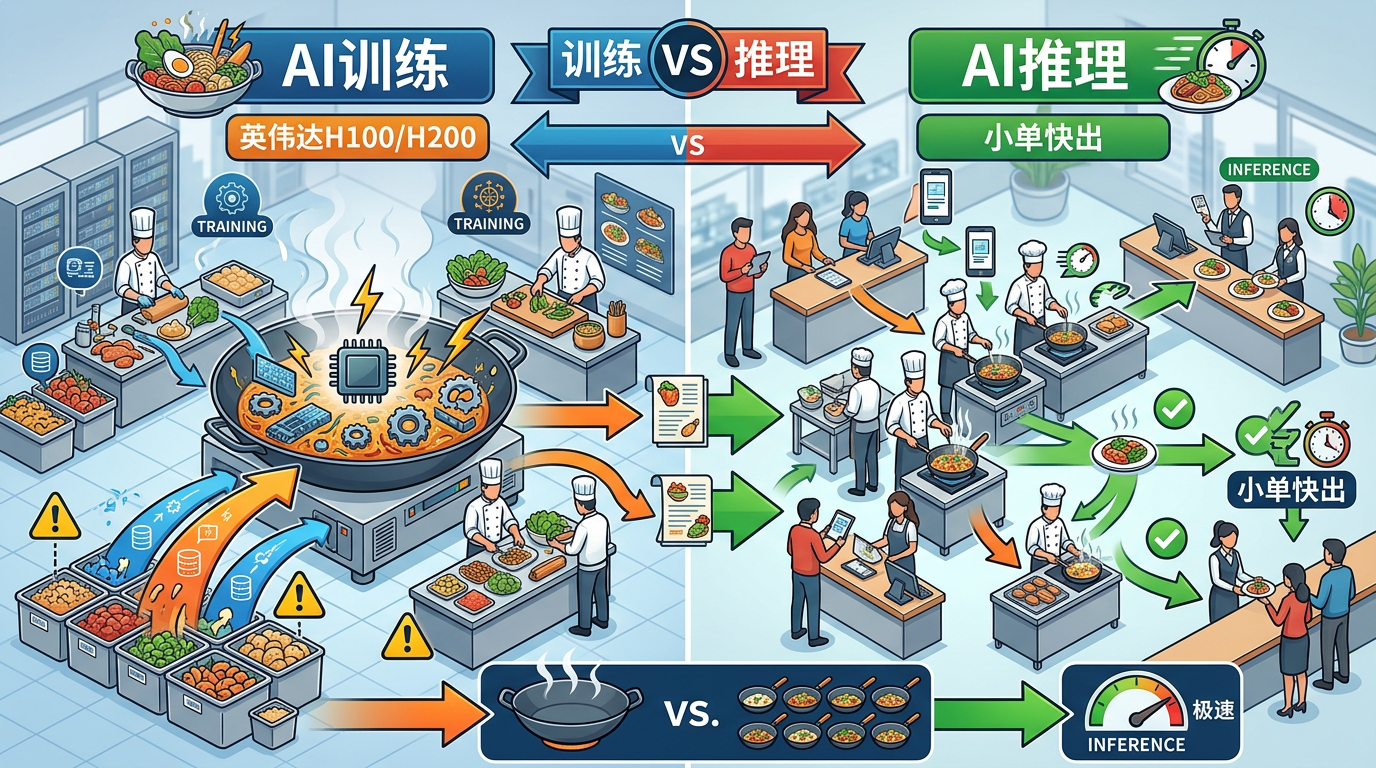

你可以把AI推理想象成餐厅出餐:训练是把所有食材准备好、菜谱调试完美的过程,而推理是后厨根据客人点单,快速把菜炒出来端上桌。此前英伟达的H100、H200芯片更像“中央厨房的大炒锅”,擅长批量处理训练任务,但面对推理这种“小单快出”的需求,效率还不够极致。

即将推出的新推理芯片,就是专门为“出餐速度”设计的“快速炒炉”。它的核心逻辑是:用更低的能耗、更快的响应,处理AI模型的实时调用——比如让自动驾驶汽车瞬间识别路况,让客服AI秒回用户问题。

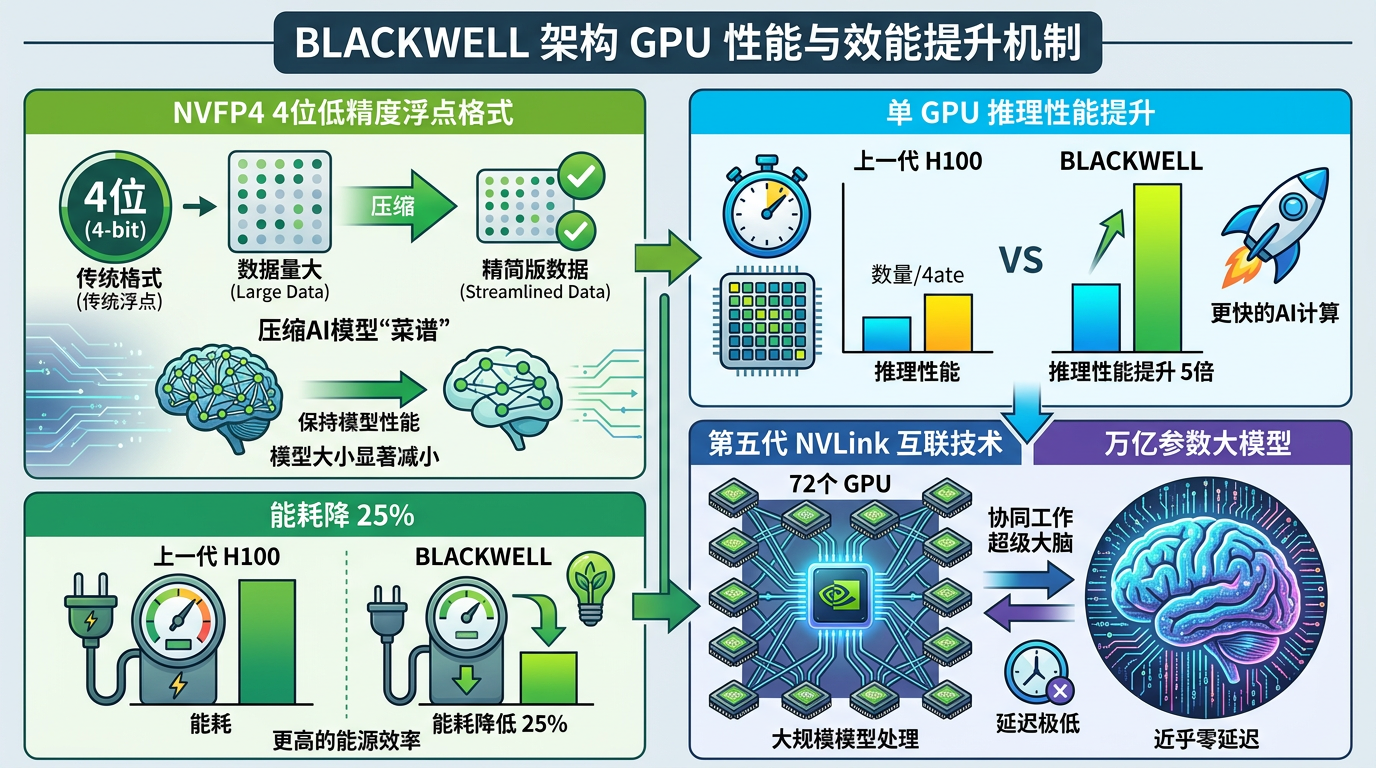

拿已经发布的Blackwell系列举例,它用上了NVFP4这种4位低精度浮点格式,相当于把AI模型的“菜谱”压缩成了极简版,却还能保证菜的味道不变。单GPU推理性能比上一代H100提升了5倍,能耗反而降了25%。配合第五代NVLink互联技术,72个GPU能像一个超级大脑一样协同工作,处理万亿参数的大模型时,延迟低到几乎察觉不到。

更狠的是英伟达的“软硬绑定”:新芯片搭配TensorRT-LLM推理库,能自动把PyTorch模型转换成高性能推理图,不用开发者手动改一行代码,部署效率直接拉满。这就像给炒炉配了自动配菜机,厨师只需要专注炒菜就行。

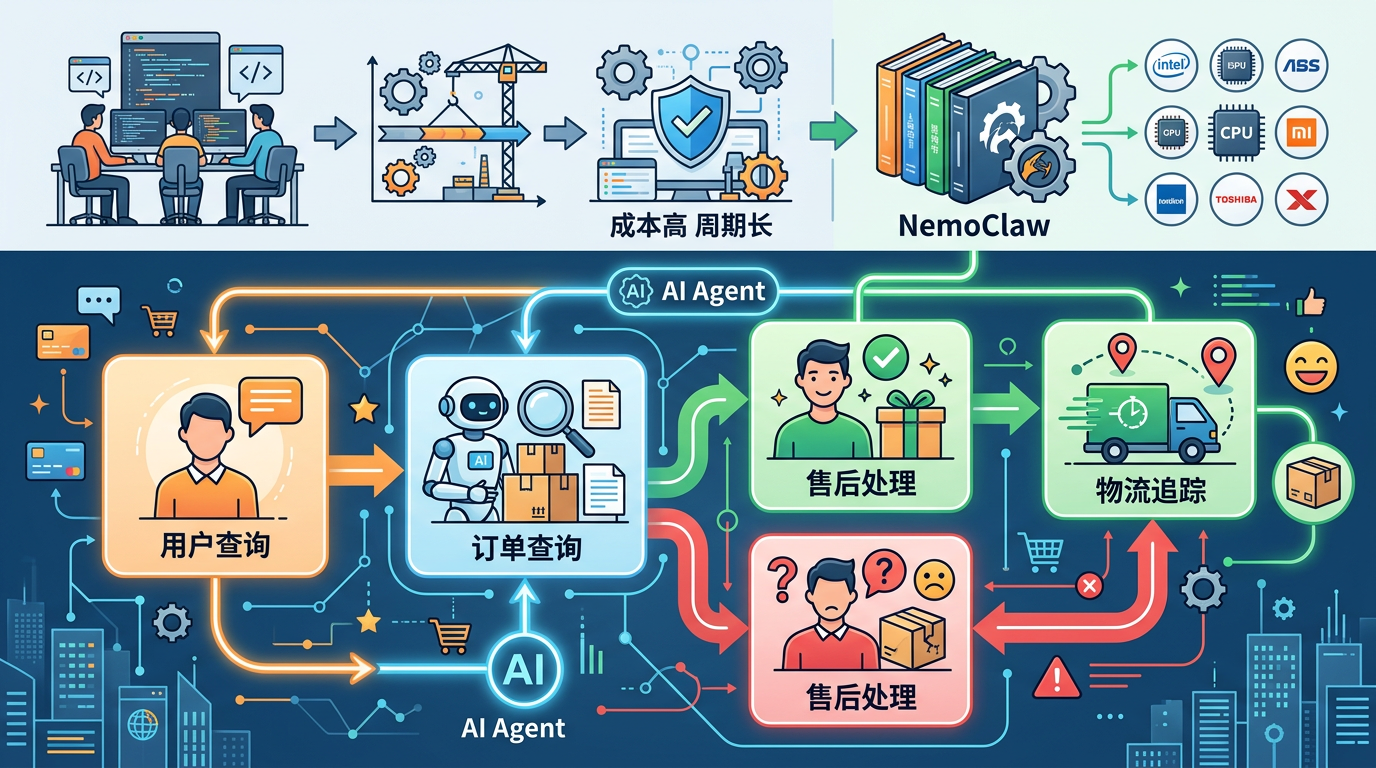

如果说硬件是“炒炉”,那传闻中的NemoClaw平台就是“餐厅管理系统”——它能让企业自己搭建AI智能体,也就是能自动完成多步骤任务的“AI员工”。

比如一个电商企业,需要AI智能体完成“用户咨询→订单查询→售后处理→物流跟进”一整套流程,以前得找技术团队从零开发,成本高、周期长。NemoClaw就像一套标准化的员工手册,企业只需要按照框架填充业务逻辑,就能快速部署自己的AI智能体,还能跨硬件运行,不局限于英伟达的芯片。

这步棋的野心很大:OpenAI的GPTs虽然也能做类似的事,但NemoClaw是开源的,企业能完全掌控数据和模型,不用怕数据泄露。而且英伟达背靠自己的硬件生态,能让AI智能体的运行效率更高——就像餐厅用自己的管理系统,搭配自己的炒炉,出餐速度肯定比用别人的系统快。

更关键的是,这能把英伟达的生态从“硬件使用者”扩展到“AI应用开发者”。以前企业买英伟达的芯片,只是买个“工具”;现在用NemoClaw,相当于加入了英伟达的“AI应用工厂”,以后再升级硬件、优化模型,第一个想到的还是英伟达。

英伟达的算盘不止于此。去年年底,它花200亿美元拿下了Groq的推理技术许可,还把Groq的核心团队挖了过来。Groq的芯片擅长低延迟推理,就像“快餐店里的出餐口”,能在0.01秒内完成AI响应,特别适合实时聊天机器人、自动驾驶这些场景。

这招很巧妙:既补上了自己在低延迟推理场景的短板,又避免了直接收购可能引发的反垄断调查——Groq还能以独立身份运营,相当于英伟达在推理市场多了一个“分身”。而谷歌、亚马逊的自研芯片,虽然在特定场景有优势,但面对英伟达的“软硬通吃+生态包围”,就像单个餐厅的自制炒炉,很难和连锁餐厅的标准化体系竞争。

但英伟达也有软肋:它的高端芯片几乎全靠台积电制造,一旦供应链出问题,整个帝国都可能动摇。而且谷歌的TPU、亚马逊的Inferentia正在云端市场快速追赶,这些巨头自己有云服务,能把芯片和服务绑定,抢食企业客户。

我认为,英伟达真正的护城河从来不是某一款芯片,而是它用CUDA、TensorRT、NemoClaw搭建起来的“AI生产流水线”——从训练到推理,从硬件到软件,企业只要进入这个体系,就很难再跳出去。

下周的GTC大会上,黄仁勋可能会穿着标志性的黑夹克,站在舞台上亮出新芯片和NemoClaw平台的细节。但真正值得关注的,不是某一款产品的参数,而是英伟达正在把AI推理从“技术难题”变成“基础设施”——就像当年把GPU变成深度学习的标配一样。

“推理即收入”,这是黄仁勋反复强调的一句话。当AI推理的成本足够低、效率足够高,每个企业都能用上自己的AI员工,每个行业都能被AI重构。而英伟达,就是这个新基础设施的搭建者。

当然,这个过程不会一帆风顺:供应链的风险、竞争对手的追赶、监管的压力,都是它要迈过的坎。但有一点可以肯定:谁能掌控AI推理的未来,谁就能掌控AI产业的下半场。

点击充电,成为大圆镜下一个视频选题!