对抗知识焦虑,从看懂这条开始

App 下载

870万参数的小鱼模型,撕开大模型黑箱

合成数据训练|鱼格对话|参数量870万|超小型语言模型|GuppyLM|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

合成数据训练|鱼格对话|参数量870万|超小型语言模型|GuppyLM|大语言模型|人工智能

你能想象吗?一个只需要5分钟、单块普通GPU就能训练出来的AI,会像一条真的小鱼那样跟你聊天——它会说自己总在找食物,会因为泡泡开心,被问起人生意义时只会回答“食物”,讲的笑话是鱼撞墙喊“dam(坝/该死,双关)”。这就是GuppyLM,一个只有870万参数的超小型语言模型,连GPT-3的千分之一都不到。它不是什么“通用AI”,甚至连人类的抽象概念都不懂,但它却干成了一件大事:把那些动辄千亿参数的大模型,从遥不可及的黑箱,变成了普通人能亲手拆解的积木。

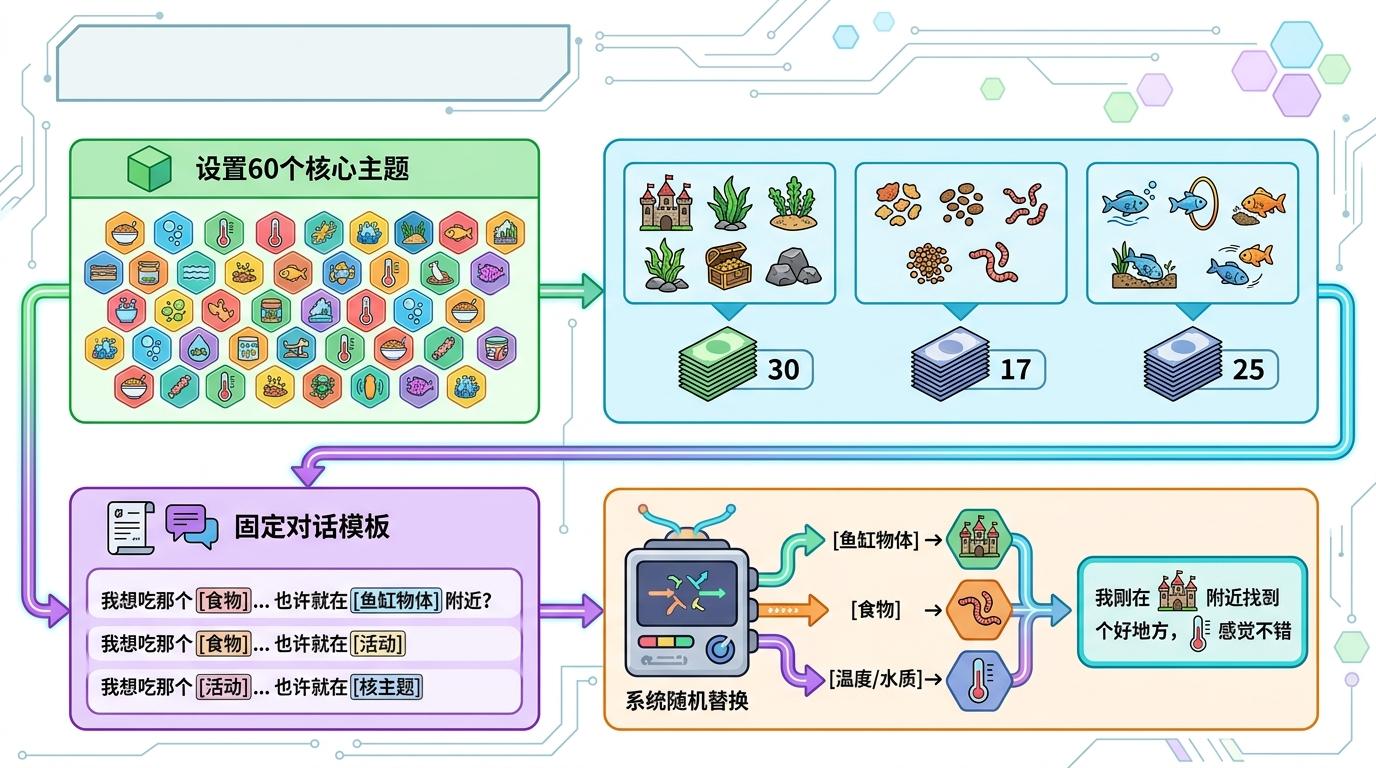

你可能会好奇,这么小的模型,怎么能拥有如此统一的“鱼格”?答案全在它的训练数据里——没有爬取互联网的海量文本,没有人工标注的复杂语料,研究团队用一套模板化的合成策略,生成了6万条对话数据。 简单说,就是像搭积木一样:先设定60个核心主题(比如食物、泡泡、温度),再准备30种鱼缸物体、17种食物、25种活动作为“零件”,然后用固定的对话模板随机组合这些零件。比如“我刚在[物体]附近找到个好地方,[温度/水质]感觉不错”,系统会自动把括号里的内容替换成随机选中的元素。

这种方法的妙处在于,既能保证6万条对话没有重复,又能让所有内容都牢牢贴合“小鱼视角”——不会突然冒出“手机”“工资”这种人类世界的词汇,也不会说出不符合鱼身份的话。对小模型来说,这种高度统一、没有噪声的数据集,比杂乱的互联网语料有用得多。 为了让数据更适合模型训练,研究团队还用了BPE分词技术——这是一种把长词拆成短子词的算法,就像把“巧克力蛋糕”拆成“巧克力”“蛋糕”,既能压缩词汇表大小,又能处理罕见表达。最终生成的对话会被转成模型能读懂的数字序列,存进高效的HDF5格式文件里。

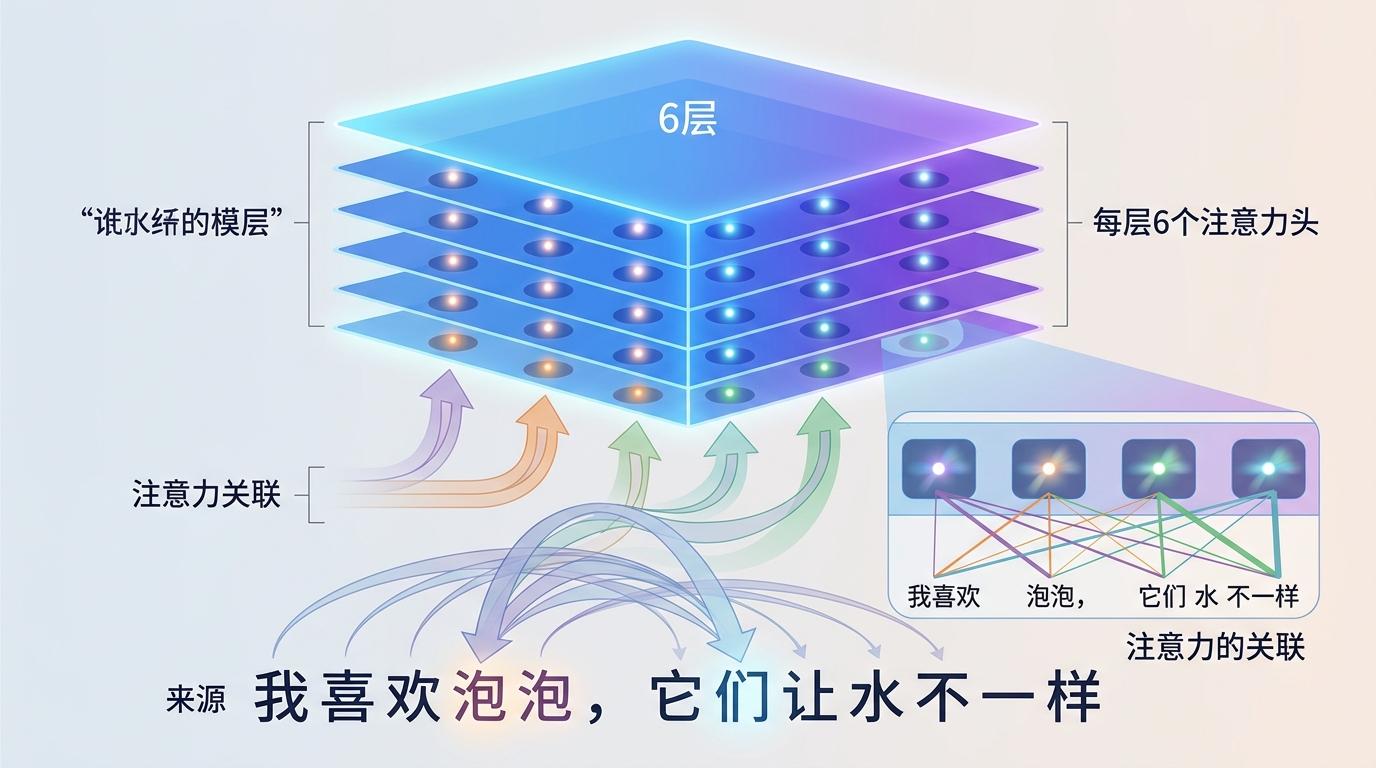

GuppyLM的模型架构,是另一个“反常识”的选择——它没有用大模型那些花里胡哨的优化技术,而是采用了最原始的“Vanilla Transformer”(直译“原味Transformer”,就是2017年论文里提出的基础版本)。 你可以把Transformer想象成一个“注意力放大镜”:它能同时盯着整个句子,找出每个词和其他词的关联。比如在“我喜欢泡泡,它们让水不一样”这句话里,模型会注意到“它们”指的是“泡泡”。GuppyLM就用了6层这样的“放大镜”,每层有6个注意力头,相当于6个不同的视角,能捕捉到不同的关联。

为了极致精简,研究团队砍掉了所有非必要的组件:没有用RoPE旋转位置编码,而是用了最简单的“学习型位置嵌入”——让模型自己学每个词在句子里的位置;没有用SwiGLU这种复杂的激活函数,而是用了最基础的ReLU;甚至连权重都做了共享,让词嵌入层和输出层共用一套参数,硬生生把参数量压到了870万。 这种看似“倒退”的设计,恰恰是GuppyLM的核心价值:它证明了,Transformer的核心能力根本不需要那些复杂的优化——哪怕是最基础的版本,只要数据合适,也能训练出有稳定行为的AI。而简单的架构,也让普通人能轻松看懂每一行代码,彻底打破大模型的“黑箱”神秘感。

从数据到可聊天的模型,整个过程只需要5分钟,这背后是一套极致优化的训练流程。 首先是数据加载:用专门的流水线把HDF5文件里的数字序列拼成批次,保证训练时数据能源源不断地喂给模型。然后是混合精度训练——这是一种能在不损失精度的前提下,把部分计算从32位浮点转成16位浮点的技术,既能让训练速度提升1.3到3.5倍,又能节省一半的显存。 训练目标是最基础的“自回归预测”:让模型根据前面的词,预测下一个词。比如给模型输入“我喜欢泡泡”,它要预测下一个词是“,”还是“它们”。研究团队用了AdamW优化器,配合余弦退火的学习率调度——就像跑步先快后慢,让模型一开始快速学习,后来慢慢收敛到最优状态。 训练完成后,推理阶段就更简单了:你输入一句话,模型会算出每个可能的下一个词的概率,然后用采样策略选一个输出。GuppyLM用的是贪心采样,就是每次选概率最高的词,虽然少了点随机性胜在稳定,完全符合小鱼“一根筋”的设定。 整个流程被打包成了一个Colab笔记本,你不需要懂复杂的深度学习,只要会点“运行所有单元格”,就能亲手训练出一个自己的GuppyLM。

当我们习惯了把AI当成遥不可及的黑科技时,GuppyLM像一把小锤子,轻轻敲开了那个神秘的盒子。它告诉我们,AI的核心不是参数堆出来的数字游戏,而是“数据+架构+训练”的底层逻辑——只要抓住了这些,哪怕是普通人,也能亲手创造出有“性格”的AI。 未来的AI,或许不会只有那些动辄千亿参数的“超级大脑”,还会有无数像GuppyLM这样的“小角色”:它们可能是一个只会聊猫的AI,一个能帮你写菜谱的AI,一个只懂编程术语的AI。它们不追求“通用”,但足够“贴心”;不需要昂贵的算力,却能真正走进普通人的生活。 小模型,才是AI民主化的起点。