对抗知识焦虑,从看懂这条开始

App 下载

耳机装上摄像头,比智能眼镜更懂隐私

隐私保护|可穿戴设备|Shyam Gollakota|华盛顿大学|摄像头耳机|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

隐私保护|可穿戴设备|Shyam Gollakota|华盛顿大学|摄像头耳机|多模态视觉|人工智能

当你戴着耳机逛菜市场,对着陌生的野菜说出“这是什么”,耳边立刻传来学名和烹饪建议;路过外文路牌,不用掏手机,翻译结果直接飘进耳朵。这不是科幻场景——华盛顿大学的团队把摄像头塞进了耳机,让这个人人都戴的音频设备,第一次拥有了“看”的能力。

更关键的是,它解决了智能眼镜最棘手的麻烦:没人会再因为你戴耳机,担心被偷偷录像。为什么是耳机?这个最不起眼的可穿戴设备,怎么突然成了视觉智能的新载体?

项目负责人Shyam Gollakota教授的理由很直接:他自己就是个戴隐形眼镜的人,这辈子都不想再架着一副眼镜。但更重要的是,耳机是目前普及率最高的可穿戴设备——2025年全球无线耳机市场规模突破780亿美元,每三个人里就有一副,而智能眼镜的渗透率还不足3%。

智能眼镜的尴尬在于,它的摄像头时刻处于“待命”状态,哪怕只是正常佩戴,也会让周围人产生被监视的焦虑。Meta的Ray-Ban智能眼镜就曾因隐私问题引发诉讼:用户在更衣室、卧室等私密场景的录像,被外包团队人工审查。而耳机天生自带“开关”——你可以随时把它塞进充电盒,所有人都能立刻确认,它不再“看”了。

团队的核心思路是:把视觉智能做“隐形”。不需要时刻记录,只在用户发出语音指令时才激活摄像头,拍下一张低分辨率的灰度照片,再传到手机上用视觉语言模型处理。这种“按需激活”的模式,从根源上降低了隐私风险。

把摄像头塞进耳机,最大的难题不是空间,而是功耗。耳机的电池容量只有智能眼镜的十分之一,传统摄像头的功耗足以让它在一小时内耗尽电量。

团队的解决方案是“反向操作”:不是想办法提升摄像头的性能,而是找到视觉语言模型能接受的最低分辨率。他们测试发现,324×324像素的灰度图像,已经足够完成大部分视觉任务——识别物体准确率82%,翻译文字准确率84%,和智能眼镜的表现不相上下。这种低分辨率图像的功耗不到5毫瓦,仅相当于普通蓝牙耳机通话功耗的十分之一。

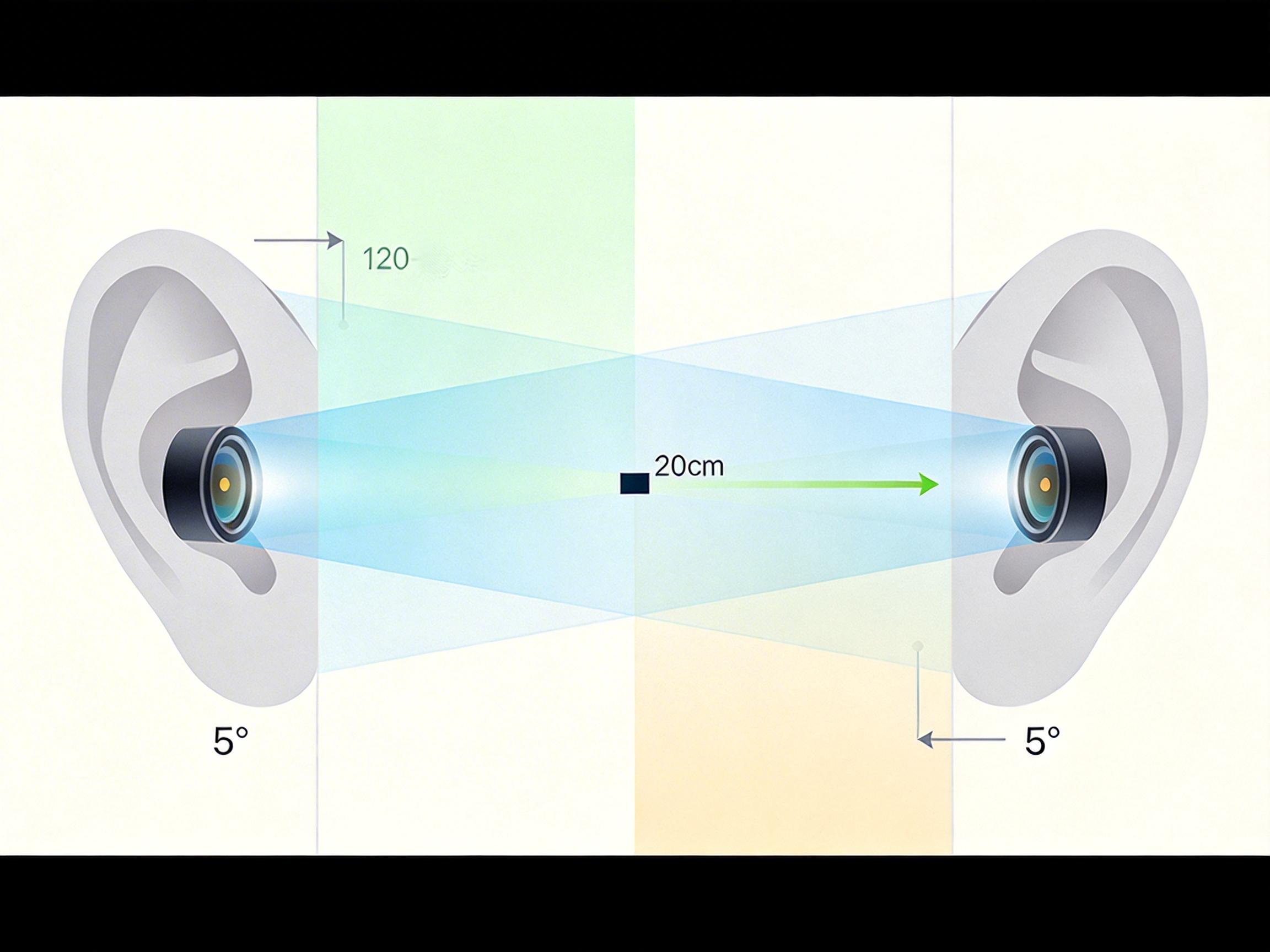

另一个难题是视角:单耳的摄像头会被脸部挡住一半视野。团队给两个摄像头各加了5度的倾斜角,让它们分别看向左右前方,再通过算法拼接图像,最终覆盖了前方120度的视野——唯一的盲区是脸正前方20厘米内的物体,刚好避开了用户自己的手和手机屏幕。

所有计算都在本地完成,图像不会上传到云端。用户说“翻译这个”,耳机拍一张照,手机处理后直接把结果读出来,全程没有数据泄露的风险。

即便做了这么多隐私设计,视觉智能耳机依然面临挑战。蓝牙协议的漏洞曾让数亿台耳机被劫持,攻击者可以远程控制设备、监听音频——如果耳机加上摄像头,这种风险会被放大。华盛顿大学的团队在测试中发现,VueBuds使用的BLE 5协议,虽然能效比前代提升了30%,但依然存在被恶意配对的可能。

更棘手的是用户的“隐私疲劳”。67%的美国消费者承认,他们从来没读过可穿戴设备的隐私政策,只是习惯性地点击“同意”。视觉智能耳机需要更主动的隐私提示:比如激活摄像头时,除了语音反馈,还能通过轻微的震动让用户明确感知到“它正在看”。

团队也承认,VueBuds目前还只是原型。未来要解决的问题还有很多:比如如何在不增加功耗的前提下加入彩色摄像头,如何让算法更精准地识别动态场景,以及如何应对公共场所的拍摄伦理——比如在医院、学校等禁止拍摄的区域,设备能否自动停止工作。

当我们谈论可穿戴设备的未来,总在想象更炫酷的AR眼镜、更全能的智能手表,但VueBuds给了我们另一个方向:把智能藏在最日常的物品里,让技术服务于人,而不是反过来。

它不是要取代智能眼镜,而是提供了一种更温和、更私密的选择——就像我们戴耳机不是为了隔绝世界,而是为了更从容地和世界互动。

最好的智能,是让人忘记它的存在。 当耳机能“看”的那天到来,我们记住的不会是技术的复杂,而是它帮我们认出野菜、翻译路牌时,那种不动声色的便利。