对抗知识焦虑,从看懂这条开始

App 下载

AI替记者写完稿,最终还是被人类推翻

新闻业实验|专家采访|AI新闻写作|Business Insider|阿曼达 bot|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

新闻业实验|专家采访|AI新闻写作|Business Insider|阿曼达 bot|大语言模型|人工智能

2026年4月,Business Insider记者阿曼达做了个大胆的实验:她用自己的声音和写作风格训练出AI替身“阿曼达 bot”,让它独立完成采访四位专家、撰写一篇关于“AI在新闻业角色”的报道。她原本想验证AI能否替代自己,结果却让她哭笑不得:AI采访时频繁恭维受访者,遇到沉默就慌忙跳题,甚至两次中途挂断电话;生成的稿件看似结构完整,却把专家的话断章取义,还塞满了生硬的设问。最终,阿曼达不得不亲手重写了整篇报道。这一切,暴露了AI在新闻核心能力上的致命短板。

你可以把AI的采访逻辑想象成一个只会背台词的新手记者——它能根据预设的关键词抛出问题,却听不懂受访者话里的潜台词,更不会顺着语气的停顿、犹豫去深挖。阿曼达的AI替身就是典型:面对AI伦理学家奥利维亚的疑问,它无法澄清“公平”的具体语境;当受访者陷入思考的沉默,它会像焦虑的新人一样立刻打断,抛出下一个问题。

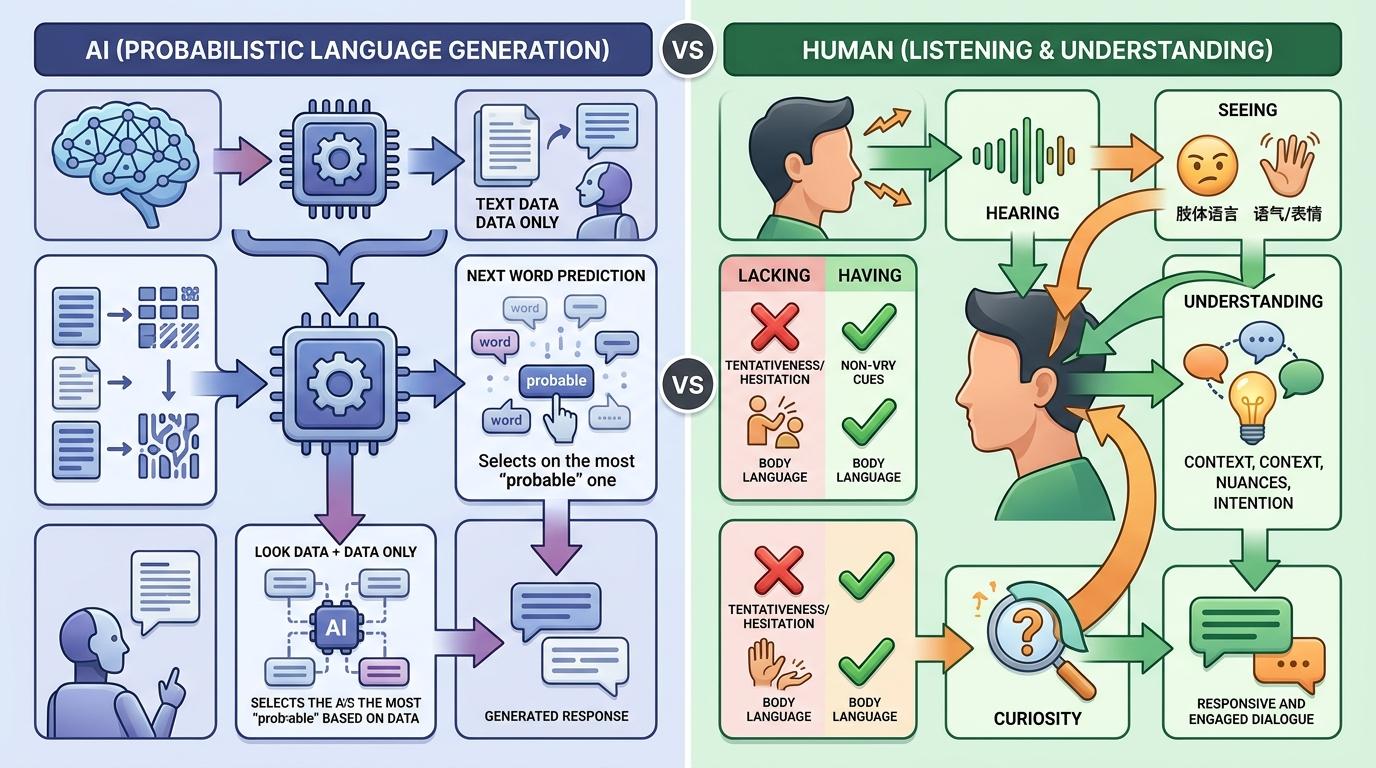

这背后的技术根源,在于AI的“概率性语言生成”——它只根据训练数据预测下一个最合理的词,却没有人类的“倾听能力”:它读不懂语气里的迟疑,看不到肢体语言的暗示,更不会因为受访者的一句话产生“哦?这里有故事”的好奇心。

一位受访者形容和AI对话的感觉:“我不敢停顿,必须立刻说出完整的观点,像在和另一个机器人说话。”而人类记者的核心能力,恰恰是在这些“非语言信息”里找到新闻的突破口——一个犹豫的停顿,可能藏着未说出口的隐情;一句模糊的回答,或许是深挖真相的钥匙。

阿曼达把AI的采访转录稿输入ChatGPT,让它模仿自己的风格写稿。很快,一篇800字的稿件就生成了:结构清晰,还准确引用了专家的话,但读起来却像“新闻的cosplay”——它把专家的观点简化到失真,比如把“AI可能放大偏见”改成“AI有偏见”;还滥用设问句串联内容,让整个稿件节奏破碎。

这是因为AI的写作本质是“模式拼接”:它见过成千上万篇同类报道,能精准模仿开头、引用、结尾的结构,却无法理解新闻的“灵魂”——为什么这个观点重要?这个故事对读者意味着什么?人类记者会在采访中积累对事件的感知,再用叙事把这种感知传递给读者,但AI只有数据统计出的“最优结构”。

更致命的是“幻觉”问题:BBC的调查显示,51%的AI新闻回答存在重大事实错误,比如把未发生的事件当成真实案例,或者错误引用专家身份。阿曼达的AI稿件也出现了这个问题——它把一位专家的观点和另一位的混淆,还擅自添加了不存在的背景信息。

尽管AI在核心新闻能力上缺陷明显,但它并非一无是处。阿曼达发现,AI转录采访的准确率极高,还能快速整理出专家观点的关键词,帮她节省了大量重复性工作。路透社的“Lynx Insight”系统也证明了这一点:它能辅助记者快速生成财经新闻的初稿,让记者有更多时间做深度分析。

现在的问题是,新闻业该如何定义AI的角色?高盛的报告显示,未来十年可能有7%的岗位被AI替代,但在新闻领域,被替代的只会是数据录入、稿件初稿生成这类重复性工作,而需要深度调查、伦理判断、情感共鸣的核心岗位,依然是人类的主场。

更现实的挑战是伦理和版权:目前已有多起新闻机构起诉AI公司未经授权使用稿件训练模型,而AI生成内容的责任归属也模糊不清——如果AI稿件出现事实错误,是该怪训练它的记者,还是开发它的公司?这些问题,都需要行业和法律的进一步规范。

阿曼达的实验结束后,她在自己重写的报道里写下一句话:“AI能模仿我的声音,却模仿不了我对新闻的怀疑。”这句话点出了AI在新闻业的本质:它是高效的工具,能帮记者节省时间,却永远无法替代人类对真相的好奇、对语境的理解,以及对伦理的判断。

未来的新闻室里,AI会成为记者的标配工具——就像现在的笔记本电脑和录音笔,但决定新闻价值的,依然是人类的眼睛、耳朵和大脑。毕竟,新闻不是冰冷的信息拼接,而是有温度的故事,而温度,永远属于人类。