对抗知识焦虑,从看懂这条开始

App 下载

不用NVIDIA,Mac也能秒转照片为3D模型

CUDA兼容性|Python重写|照片三维重建|TRELLIS.2|Apple Silicon|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

CUDA兼容性|Python重写|照片三维重建|TRELLIS.2|Apple Silicon|AI产业应用|人工智能

当你对着手机里的旅行照片出神,想把那座山、那栋老楼变成能旋转查看的3D模型时,过去的答案往往是:买台带NVIDIA高端GPU的电脑,或者付费用云端服务——前者烧钱,后者担心照片隐私。但2026年4月,这个规则被打破了。有人把微软那台原本只能在NVIDIA显卡上跑的TRELLIS.2,完整搬到了Apple Silicon的Mac上。现在,只要你有台M1及以后的Mac,花3.5分钟,就能把一张照片变成40万个顶点的高精度3D模型。

问题是,他们是怎么绕过NVIDIA的技术壁垒的?

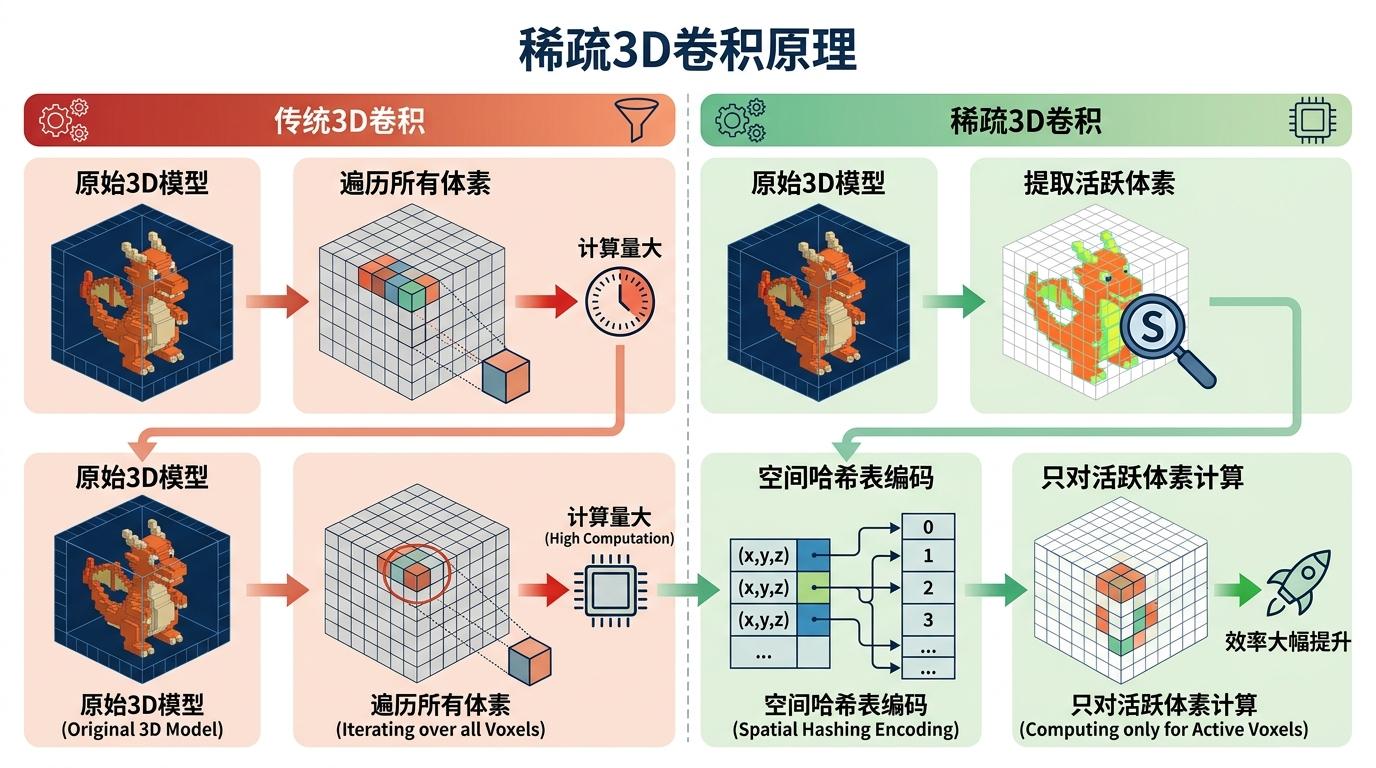

要理解这次迁移的难度,得先搞懂TRELLIS.2的核心——稀疏3D卷积。你可以把它想象成给3D空间“摸骨”的医生:传统的3D卷积会遍历整个空间的每一个小方块(体素),哪怕90%都是空的;而稀疏卷积只盯着那些“有东西”的体素,用空间哈希表给它们编上号,只对这些活跃体素做计算,能把效率提升几十倍。

但这套“摸骨术”原本是NVIDIA CUDA的专属手艺。CUDA是NVIDIA给自家显卡写的专属工具包,就像一把只有NVIDIA钥匙能开的锁。要在Mac上跑,就得把这把锁拆了,用PyTorch的通用工具重新做一把。

开发者们用Python字典代替了CUDA的哈希表,用PyTorch的“采集-分散”操作复刻了稀疏卷积的核心逻辑:先给活跃体素建个地址本,再挨个找到每个体素的邻居,把它们的特征收集起来做计算,最后把结果送回对应的位置。

这个过程就像你搬家时,只把有用的东西打包,挨个通知邻居帮忙,最后把东西放到新家里——虽然没有专业搬家公司(CUDA)快,但胜在通用,任何能跑Python的地方都能用上。

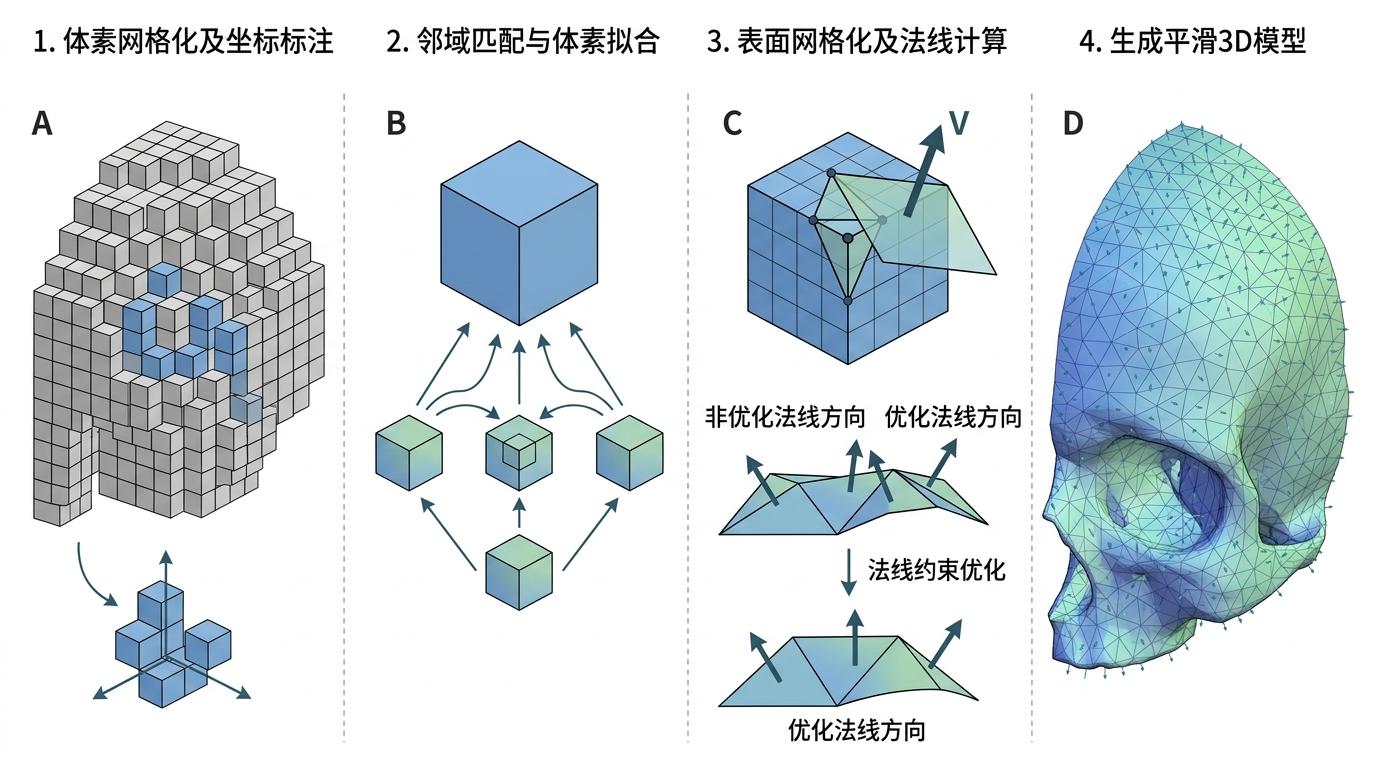

稀疏卷积解决了“怎么高效处理3D信息”的问题,但要从一堆体素变成能在Blender里打开的3D模型,还得靠**网格提取**——这就像把一堆零散的砖块,拼成一栋能住的房子。

原本的网格提取依赖CUDA的高速哈希表,能在百万级体素里瞬间找到每个点的位置。Mac上没有这个工具,开发者们就用Python字典重新搭了一套坐标索引系统:先给每个活跃体素的坐标编上号,再逐个检查每个体素的六个面,找到和它相邻的体素,把这些相邻的点连起来变成三角形面。

这个过程就像你用乐高搭房子:先给每块乐高标上位置,再看哪块和哪块能拼在一起,最后把它们固定成一个完整的结构。为了保证拼出来的房子不会歪,他们还加了个小技巧——根据体素的法线方向来调整三角形的角度,让最终的3D模型看起来更平滑自然。

当然,这个纯Python的版本比CUDA慢了不少,就像手工搭乐高肯定比机器流水线慢,但它胜在不需要专用设备,只要有台Mac就能跑。

现在的Mac版TRELLIS.2,还不是完美的。它的稀疏卷积速度只有CUDA版本的十分之一,暂时没法做纹理烘焙——就像你拼好了房子,但还没来得及刷墙铺地板;生成的模型偶尔会有小孔洞,得靠后期修补。

但这些局限,换来了两个更重要的东西:自由和隐私。过去,要做高质量的图像转3D,你要么得买昂贵的NVIDIA显卡,要么得把照片传到云端——前者是硬件绑架,后者是隐私风险。现在,你在自己的Mac上就能完成整个流程,照片不用离开本地,也不用额外花钱买硬件。

而且,这个项目是开源的。开发者们把所有代码都放在了GitHub上,任何人都可以下载、修改、甚至商用。这意味着,只要有足够多的人参与,Mac版的性能瓶颈迟早会被突破——就像一群人一起搭乐高,总能比一个人搭得快。

当我们谈论AI 3D生成时,我们往往只盯着“生成的模型有多逼真”“速度有多快”,却忽略了“谁能用上”这个更重要的问题。过去,高端AI工具就像藏在实验室里的精密仪器,只有少数专业人士能碰;但现在,它们正在变成人人都能上手的工具。

技术的终极意义,是打破门槛。 就像这次TRELLIS.2的迁移,它没有创造新的技术,却把原本属于少数人的技术,送到了更多人的桌面上。未来,也许我们不用再为了用某个AI工具,去买特定的硬件;也许我们的照片、创意,不用再传到云端就能变成实实在在的3D模型。这不是技术的革命,却是技术的归位——回到它本该服务的人身边。