对抗知识焦虑,从看懂这条开始

App 下载

故障检测的生死时速:负载均衡架构如何决定系统存亡?

服务实例崩溃|分布式系统|健康检查机制|负载均衡器|软件工程|前沿科技

对抗知识焦虑,从看懂这条开始

App 下载

服务实例崩溃|分布式系统|健康检查机制|负载均衡器|软件工程|前沿科技

屏幕上的加载动画无休止地旋转。你刷新页面,结果依旧。在地球另一端的数据中心里,一场无声的灾难正在上演:一个服务实例已经崩溃,但它仍在对外宣告“我一切正常”。负载均衡器,作为系统的交通总指挥,轻信了这个谎言。于是,一个、十个、成百上千个用户请求,如飞蛾扑火般涌向这个沉默的“黑洞”,最终在超时中耗尽。当警报最终响起时,用户早已失望离去,损失已经造成。

这并非危言耸听,而是大规模分布式系统中反复上演的惊魂一幕。健康检查,这个听起来如同“问一声你还好吗?”的简单机制,其背后的实现方式与执行者——是集权的“中央代理”,还是分权的“智能客户端”——直接决定了系统在灾难面前的反应速度、响应精度,以及运维团队需要为此付出的心血与代价。这两种截然不同的架构选择,描绘了两条通往系统可靠性的迥异路径,一条通往运维的简洁,另一条则通往极致的性能。

在分布式系统的世界里,流量调度主要有两种截然不同的哲学。

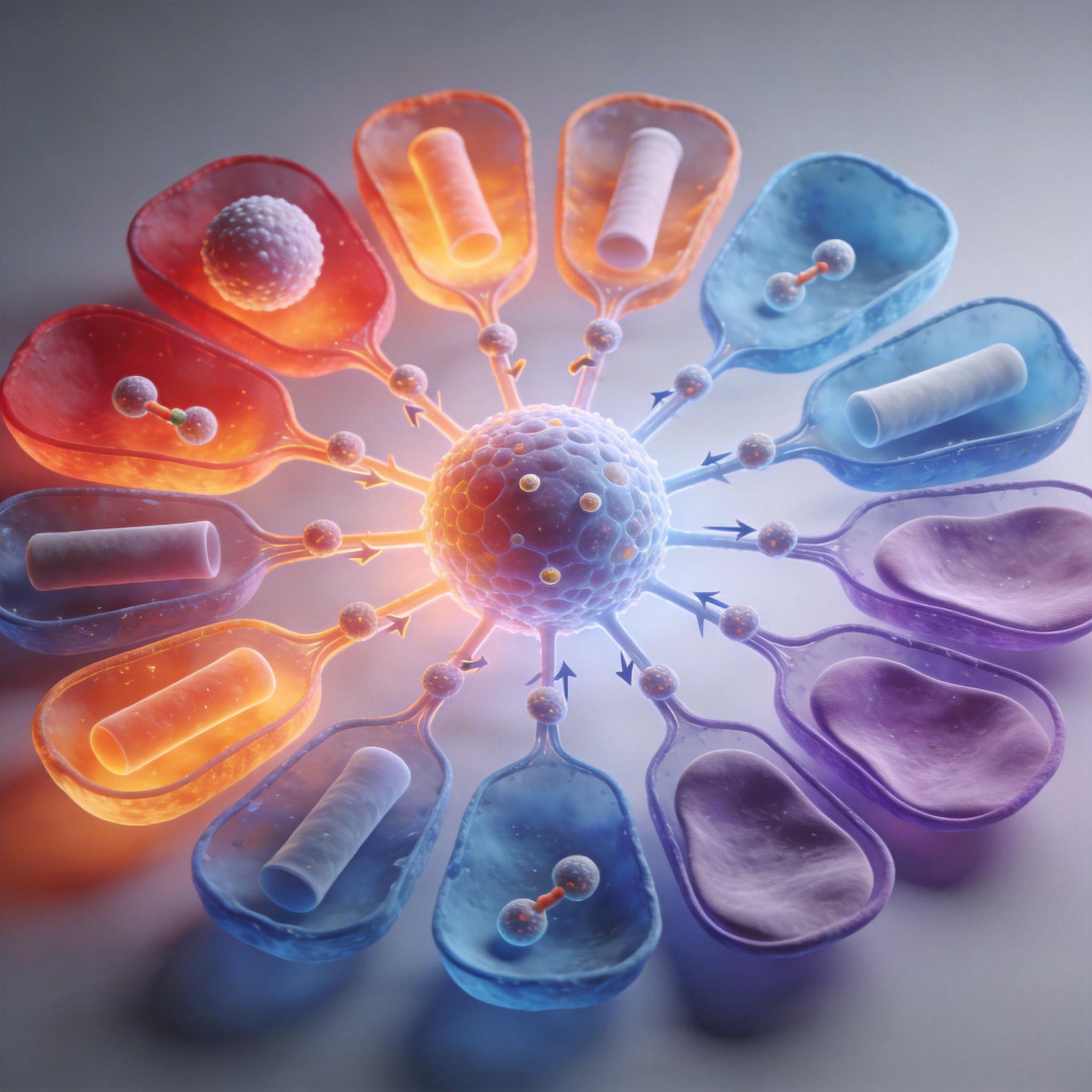

第一种是“中央集权”模式,即服务端负载均衡。 想象一个城市的中央交通指挥中心。所有的车辆(客户端请求)只知道要前往市中心(负载均衡器的地址),而由指挥中心根据实时路况(后端服务器的健康状况)决定将车辆引导至哪条具体的道路(后端服务实例)。像 Nginx、HAProxy 以及 AWS ALB 等云服务商提供的负载均衡器,都是这种模式的忠实拥趸。

第二种是“客户端自治”模式,即客户端负载均衡。 在这个模型里,没有了中央交通指挥中心。取而代之的是,每辆车(每个客户端)都内置了一套顶级的实时导航系统(如 Netflix Ribbon、gRPC内置负载均衡)。它们直接从一个动态更新的地图服务(服务注册中心)获取所有可用道路(后端服务实例)的信息,并自行决定最佳路径。

架构的不同,直接导致了判断“健康”与否的方式大相径庭。

在服务端负载均衡的模式下,健康检查是主动的、周期性的。指挥中心会定期(比如每5秒)派巡逻车去检查每条道路是否通畅。通常会设置一个容错阈值,例如“连续3次检查失败才判定为故障”,以防止因网络瞬间抖动而产生的“误判”。这种模式的代价是延迟。在上述配置下,一个实例彻底宕机后,系统最长可能需要 15秒 才能发现并将其从路由列表中移除。在这15秒的“盲区”内,用户的真实请求仍在被错误地发往故障实例。

而在客户端负载均衡的模式下,健康检查则演化出了两种截然不同的形态,且通常会结合使用:

主动健康检查:每个客户端都会像独立的侦察兵,定期探测它所知道的所有后端实例。这种方式虽然能让每个客户端独立决策,但在大规模部署时会产生惊人的“健康检查风暴”。想象一下,500个客户端每个都去探测20个后端实例,每5秒一次,仅健康检查就会产生每秒2000次的请求,这还未计算任何真实业务流量。

被动健康检查(也称“离群点检测”):这是一种更智能、更高效的方式。客户端不再主动询问,而是通过观察真实业务请求的结果来判断。当一个请求遭遇连接超时、服务器返回503错误时,客户端会立刻将该实例标记为“暂时不可用”,并在一段时间内避免向其发送请求。这种方式的优势是近乎瞬时的故障检测,第一个失败的请求就能触发熔断机制。但它的代价也显而易见:必须有一次真实的用户请求失败,才能启动保护。对于高流量服务这通常可以接受,但对于低流量服务,则可能意味着更多的用户会遇到错误。

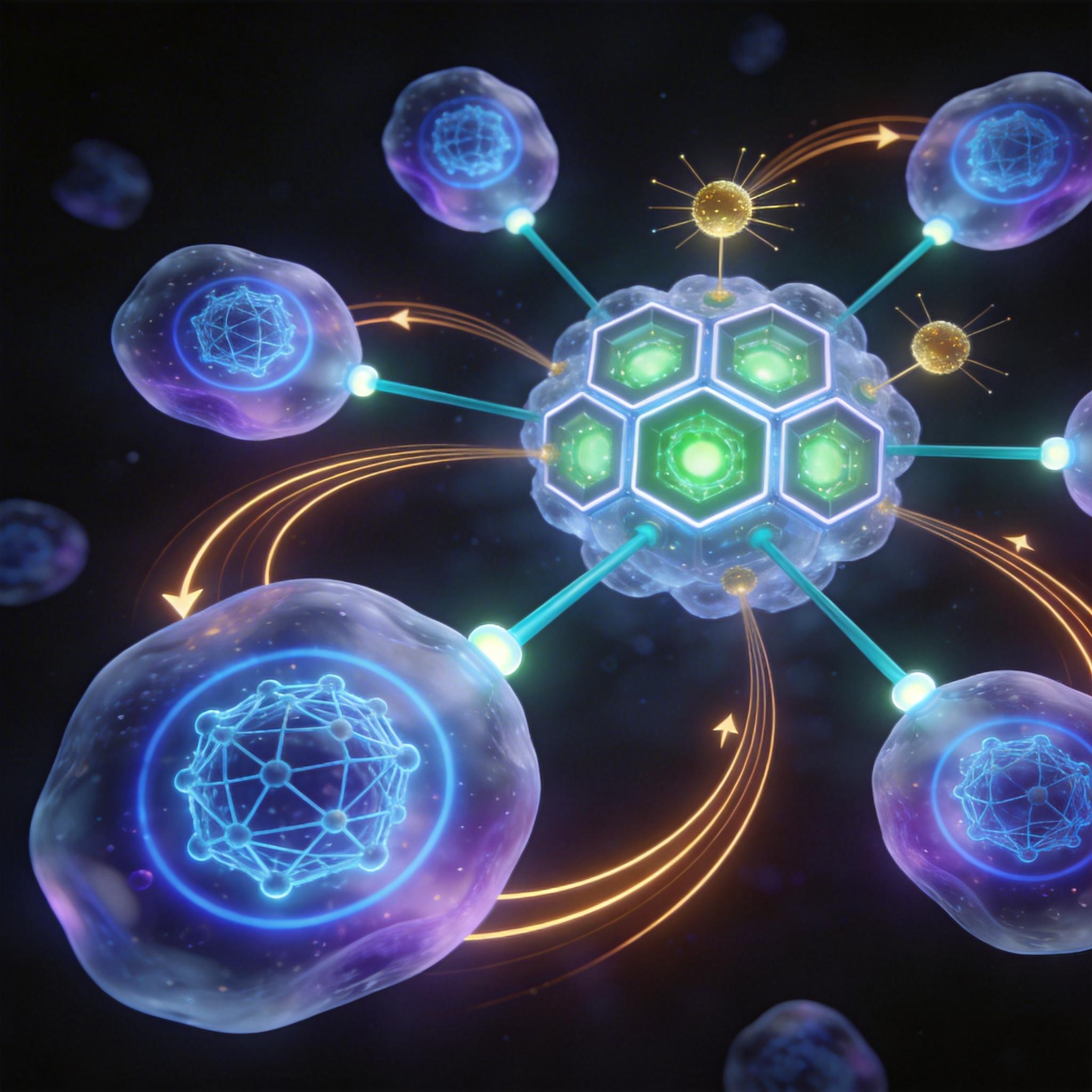

随着容器化和Kubernetes成为现代应用部署的基石,健康检查的理念也得到了进一步升华。Kubernetes引入了三种探针,将“健康”这一模糊概念分解得更为具体:

像 Spring Boot Actuator 这样的现代开发框架,已经原生支持与Kubernetes探针无缝集成,通过/actuator/health/liveness和/actuator/health/readiness等端点,将应用内部的精细状态(如数据库连接、消息队列状况)直接暴露给编排系统,实现了应用与基础设施之间前所未有的深度对话。

最终,架构的选择回归到一个核心的权衡:运维的简单性与故障响应速度之间的博弈。

服务端负载均衡用一份可控的、可预测的延迟,换来了无与伦比的运维简洁性和全局一致性。对于绝大多数企业和服务而言,这都是最理智、最可靠的起点。它的哲学是:集中管理,统一控制,接受一定的响应延迟。

客户端负载均衡则是在规模化压倒一切时,为追求亚毫秒级的故障检测和极致性能而必须接受的复杂性。它将运维的挑战分散到成百上千个客户端中,调试一次路由异常可能需要跨越多个进程和节点。它的哲学是:将智能赋予终端,为速度牺牲简洁,用复杂性换取终极弹性。

许多超大规模系统,如Netflix和LinkedIn,最终走向了混合架构的融合之道:在系统的入口层,面对不可控的外部客户端,采用服务端负载均衡进行统一管理;而在内部服务之间的高频调用中,则利用标准化的客户端库实现客户端负载均衡,以获得极致的性能和容错能力。

从古老的硬件负载均衡器,到灵活的Nginx代理,再到智能的客户端库,乃至今日由服务网格(Service Mesh)所倡导的、将负载均衡逻辑从应用中剥离至边车(Sidecar)代理的模式,我们看到的是一场永不停歇的进化。这场进化的核心驱动力,始终是在系统的复杂性、运维成本与用户所能感知的响应速度之间,寻找那个动态变化的最佳平衡点。下一次,当你看到那个旋转的加载图标时,或许会想起背后这场关于速度与复杂度的无声博弈,它正是支撑我们数字世界平稳运行的基石。