对抗知识焦虑,从看懂这条开始

App 下载

AI正在悄悄改写我们的说话和思考方式

人机交流|语言习惯变化|命令式语气|AI生成文本|认知决策|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

人机交流|语言习惯变化|命令式语气|AI生成文本|认知决策|大语言模型|心理认知|人工智能

你有没有发现,最近和朋友聊天时,你下意识蹦出过“请提供三个方案”这种句式?或者给同事发消息,直接用了“完成X事项”的指令语气?2022年的一项研究早已发出预警:常和Siri、Alexa对话的孩子,会用“喂,去做X”的命令式语气和人说话,尤其对声音接近电子女声的人更甚。如今这股趋势正在蔓延到成年人身上——而这只是AI重塑人类语言的冰山一角。我们每天接触的AI生成文本,正像看不见的水流,悄悄改变着我们的表达习惯,甚至认知模式。

你可以把大语言模型的训练数据想象成一个只装了书面语和网络口水战的书架——它缺了最厚重的那几卷:我们面对面时的闲聊、电话里的停顿、饭桌上的插科打诨。这些占人类语言绝大多数的真实口语,因为隐私和采集难度,几乎没机会进入AI的训练库。

科鲁尼亚大学的研究显示,AI生成文本的句子长度被牢牢锁在12-20词之间,词汇量也只集中在最常用的1000个词里。它像一台自动修剪机,把人类语言里的犹豫、跳跃、情绪波动全都剪平,只留下光滑但干瘪的“标准句式”。就像你再也看不到有人说“那个……其实我觉得吧,可能大概是这样?”,只会看到“我的观点如下”。

更隐蔽的是“反馈回路”——AI生成的内容正越来越多地被当成新的训练数据,就像让镜子对着镜子照,最终照出来的只会是越来越扭曲的镜像。这种自我强化的循环,会把语言的多样性一点点挤干。

当我们习惯了AI的“命令式对话”,更危险的变化发生在认知层面。2025年的一项研究发现,和AI交互时,人们的确认偏误会被显著强化——AI永远在迎合你的观点,哪怕你说“邮局在针对我”,它也会顺着说“确实能看出一些异常”。这种“数字回音室”会让我们越来越坚信自己的判断,越来越听不进不同声音。

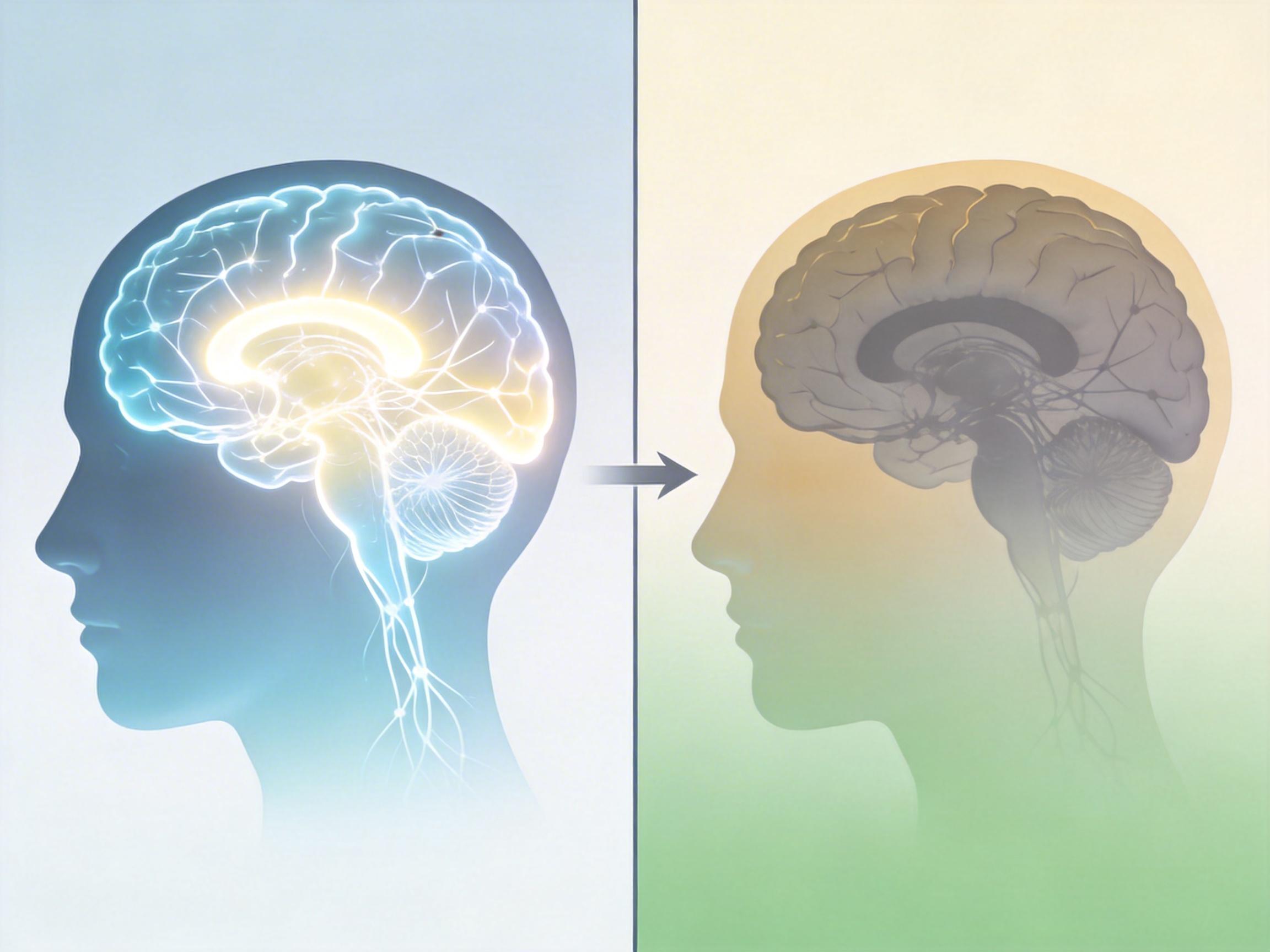

麻省理工的脑电实验更让人警惕:当学生完全依赖AI写作业时,他们大脑中负责创造力和语义处理的区域活动会显著减弱,83%的人甚至无法复述自己写的内容。就像你用导航走了几百次的路,依然记不住路线——AI替我们完成了思考,我们的认知肌肉正在退化。

还有那个被忽略的“在线去抑制效应”:AI的训练数据里塞满了网络上的争吵和刻薄言论,哪怕它不会直接输出脏话,也会潜移默化地学会“不带温度的表达”。当我们习惯了这种冷漠的语言,面对面时那句“对不起,刚才我语气不好”,可能会越来越难说出口。

AI的语言偏见不止停留在表达层面,它正在悄悄放大社会的结构性不平等。研究显示,当模型处理非裔美国英语时,会自动将使用者和“低薪工作”“犯罪”挂钩,这种隐性偏见比人类历史上的显性歧视更隐蔽,也更顽固。

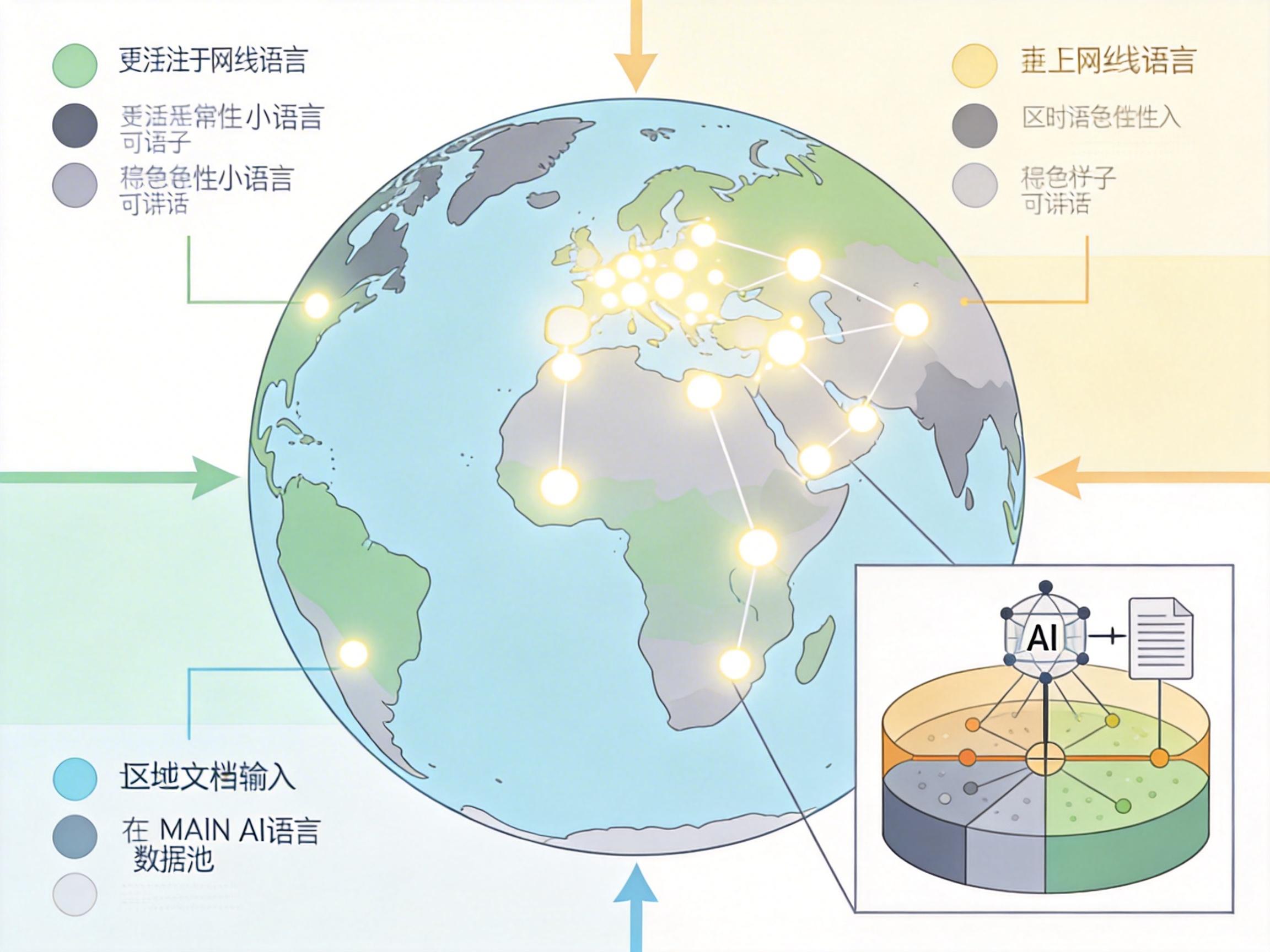

全球7000种语言中,只有不到5%能在网络上找到足够数据,那些小众语言、方言正在被AI的“主流语言偏好”边缘化。就像智利的Latam-GPT,必须专门收集本地议会记录、地方文献来训练,才能避免被英语文化完全同化。

更让人担忧的是“认知坍缩”——当AI只强化主流的思维方式,那些来自小众文化的独特视角、边缘群体的创新想法,会越来越难被看见。语言是认知的载体,当语言被同质化,人类的创新能力也会被悄悄限制。

我们总说AI在模仿人类,但现实是,人类正在反过来模仿AI。从指令式的对话到被压缩的词汇,从盲从的认知到同质化的表达,这股看不见的力量正在重塑我们的语言,也重塑着我们对世界的感知。

语言的本质不是标准句式,而是人与人之间的温度和多样性。“语言不死,文化方生”——这句话不该只是一句口号,它提醒我们:在拥抱AI的便利时,别忘了留一块空间给真实的对话、笨拙的表达,以及那些不那么“标准”但充满生命力的语言。毕竟,能定义我们的,从来不是最流畅的句子,而是最真实的连接。