21 天前

21 天前

冬夜的餐桌上,马克笔在纸上蹭出歪歪扭扭的线条——这是一位家长和孩子Oli一起画的pegboard玩具草图。换作以前,他得坐在电脑前耗上一两个小时,用CAD软件把每根线条拉成精准的3D模型。但那天他只是拍了张照片,输入两个关键尺寸:孔距40毫米,销钉宽8毫米,一分钟后,第一套可打印的3D模型就出现在屏幕上。从手绘涂鸦到能握在手里的玩具,中间的复杂建模环节,被AI彻底跳过了。这到底是怎么做到的?

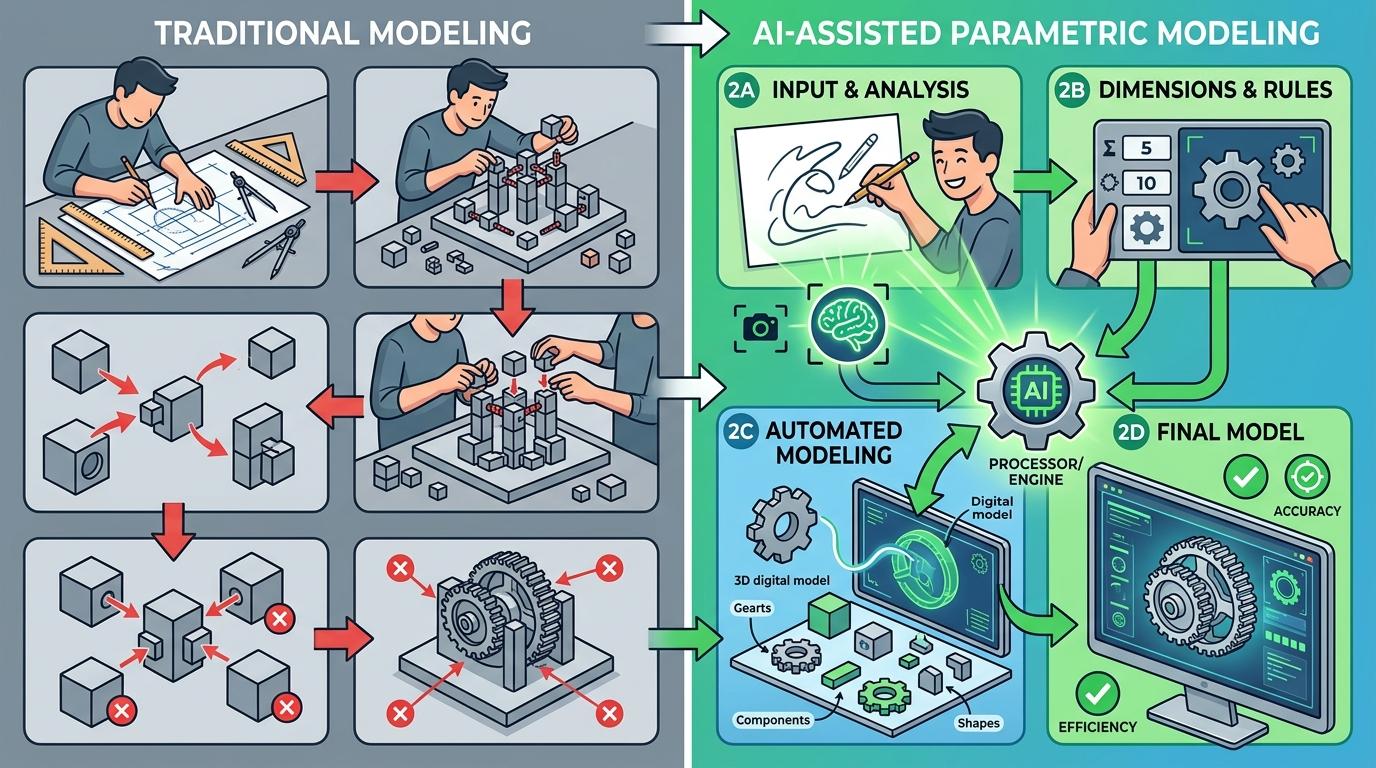

你可以把传统3D建模想象成用积木搭房子——每一块都要亲手挑选、对齐、固定,错一步就得推倒重来。而AI辅助参数化建模,相当于给了你一个能读懂你草稿的搭积木助手。它先通过图像识别“看懂”手绘里的形状逻辑:哪里是圆孔,哪里是齿轮,哪些是需要咬合的结构,再把你输入的尺寸当成“搭建规则”,自动生成符合要求的3D模型。

这次用到的Codex,本质是个能把视觉和文字指令转成代码的AI工具。它输出的不是现成的3D文件,而是一段Python生成器脚本——这是一种能“自动长出模型”的代码,你改个数字,它就能立刻生成对应尺寸的新模型,不用再重新画一遍。比如觉得销钉太松,把脚本里的直径从7.72毫米改成7.8毫米,回车就能得到新的打印文件。

整个过程从“人画每一个细节”变成“人定规则,AI做执行”。那位家长原本要耗在CAD里的时间,全变成了和Oli一起打印、试玩、调整的亲子时间。

很多人以为AI生成3D模型,就是把2D图“拉”成立体——但这次的关键,是它生成的模型从一开始就考虑了“能不能打印”“能不能用”。

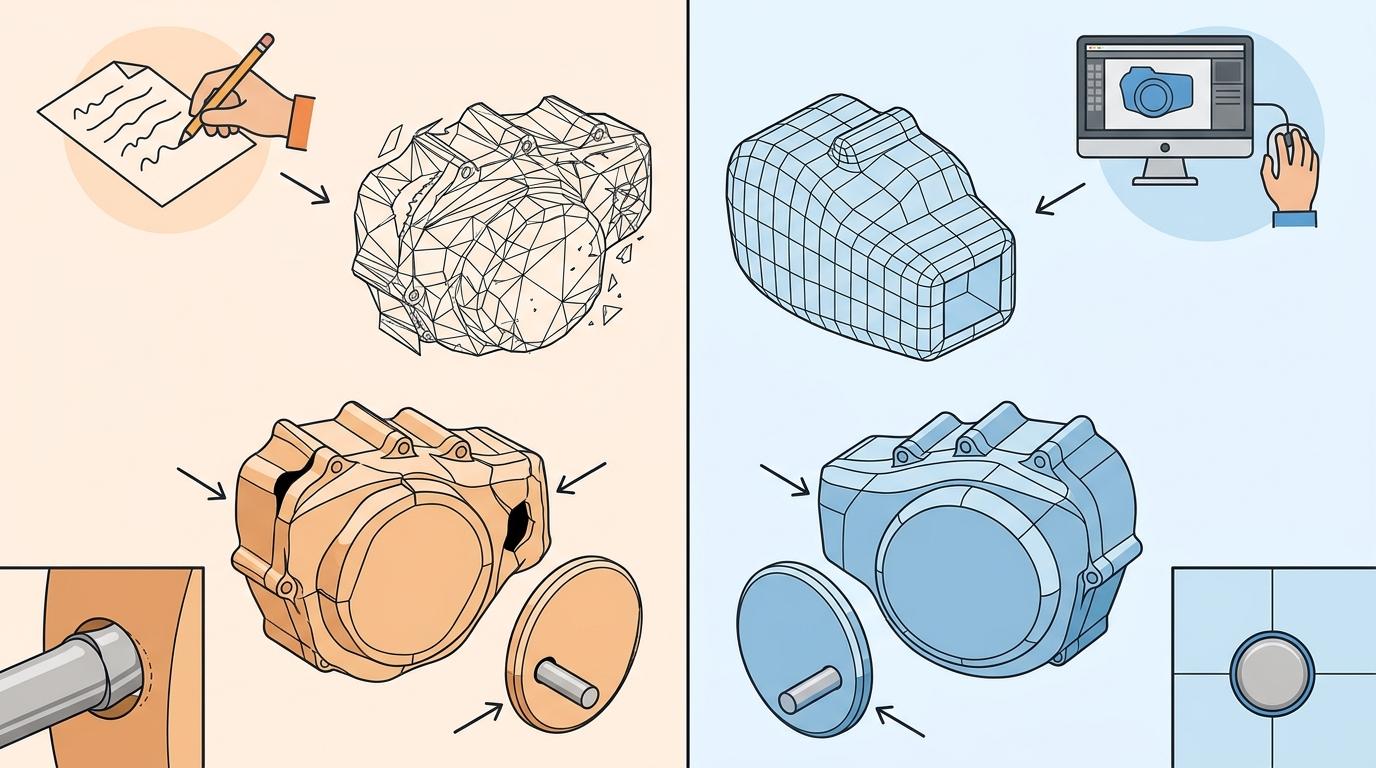

传统手绘转3D,常出现线条歪扭导致模型有破洞、尺寸不对导致零件卡不住的问题。而这套流程里,AI会自动把手绘的不规则线条修正成符合3D打印要求的规整几何,还会根据你给的尺寸自动计算间隙:比如销钉直径7.72毫米,对应的圆孔就设成8.45毫米,刚好能实现“ snugly(紧实不松动)”的手感。

更重要的是,所有模型都以Python生成器的形式存在,而不是固定的3D文件。这意味着你可以像搭乐高一样组合修改:要个6×6的大棋盘?改个参数就行;想让齿轮转得更顺?调一下齿距数值。这种“参数化生成”的逻辑,把模型迭代的时间从几小时压缩到了几分钟——毕竟改代码数字,比重新画模型快多了。

当然它也有局限:AI还没法完全理解手绘里的“隐性需求”,比如你想让某个零件握起来更顺手,还是得靠打印试玩后手动调整参数;而且复杂的机械结构,目前还得靠人先理清逻辑,AI才能帮你实现。

这种技术带来的不只是效率提升,更是玩具设计逻辑的翻转——以前是“工厂做什么,孩子玩什么”,现在是“孩子想玩什么,就能做什么”。

全球3D打印玩具市场已经从2023年的5亿美元,预计增长到2030年的11亿美元,其中AI辅助设计是核心驱动力。Hasbro的“Selfie Series”人偶,让用户扫描自己的脸就能定制专属玩具;Toybox Labs和环球影业合作,让孩子能打印海绵宝宝、小黄人等IP角色的定制版本。就连乐高都计划在2025年推出含3D打印组件的玩具,把定制权交到用户手里。

但这股潮流也藏着隐忧:AI生成的模型很容易被复制,版权边界变得模糊;而且不是所有家庭都有3D打印机,这种“定制自由”目前还只属于一部分人。更重要的是,玩具的核心价值是陪伴——技术能帮我们更快做出玩具,却不能代替人和人一起玩的过程,这也是那位家长最在意的:省下来的建模时间,他全用来陪Oli试玩了。

当Oli拿着自己参与设计的玩具摆弄时,他摸到的不只是塑料零件,更是“我能创造东西”的成就感。AI和3D打印的组合,本质是把“设计玩具”的权力从专业工作室,交回给了每个想玩、想创造的人。

好的技术,是帮人把时间还给生活。 未来的玩具可能不再是货架上的标准化商品,而是每个家庭里,由涂鸦、AI代码和3D打印机共同完成的小惊喜——就像那个冬夜餐桌上的草图,最终变成了孩子手里能转的齿轮。

点击充电,成为大圆镜下一个视频选题!