对抗知识焦虑,从看懂这条开始

App 下载

一篇42年前的论文,串起大脑与AI的记忆密码

诺贝尔物理学奖|人工神经网络|记忆机制|约翰·霍普菲尔德|霍普菲尔德网络|脑科学|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

诺贝尔物理学奖|人工神经网络|记忆机制|约翰·霍普菲尔德|霍普菲尔德网络|脑科学|大语言模型|心理认知|人工智能

当你听到半句熟悉的歌词就能接出下一句,看到模糊的老照片能认出旧友,你可能不会想到,这种「用碎片唤起完整记忆」的能力,早在1982年就被一位物理学家用数学公式复刻了出来。

那年,约翰·霍普菲尔德在《美国国家科学院院刊》发表了一篇仅12页的论文,提出了一个以他名字命名的人工神经网络——霍普菲尔德网络。这个看似简单的模型,不仅让神经科学家玛丽亚·格芬彻底改变了科研方向,更在42年后,成为连接大脑记忆机制与现代AI的核心桥梁。而霍普菲尔德本人,也因这项奠基性工作,与杰弗里·辛顿共同摘得2024年诺贝尔物理学奖。

这篇论文到底藏着怎样的魔力,能横跨半个世纪影响两个学科?

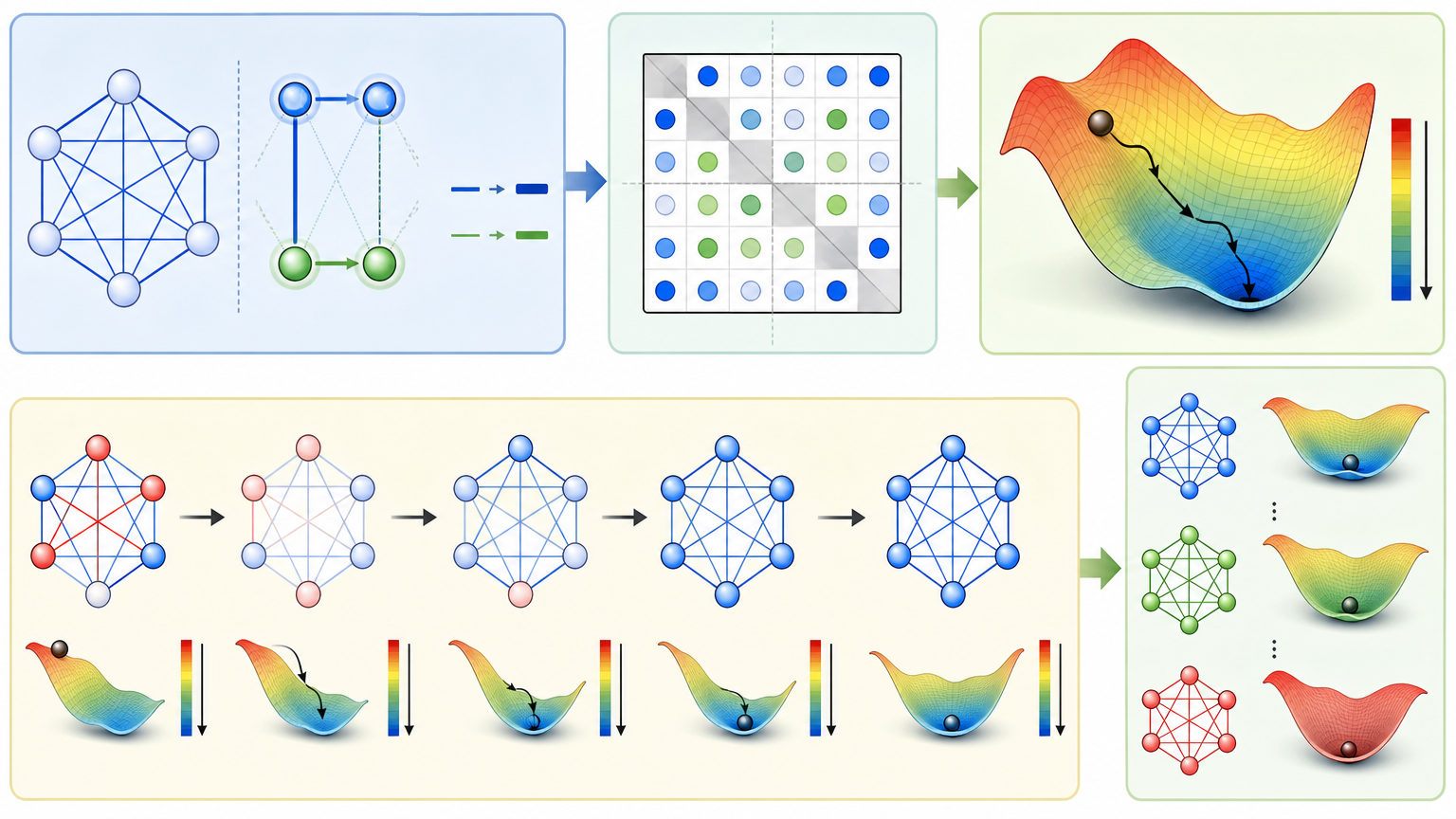

你可以把霍普菲尔德网络想象成一群拉着手的人——每个人代表一个神经元,手的拉力就是神经元间的连接权重。这群人会根据身边人的动作调整自己的姿势,最终集体定格在一个稳定的姿态里,这个姿态就是「吸引子」——网络存储的一段记忆。

但真实的机制比这个类比更精确:霍普菲尔德用海伯学习规则(「同时激活的神经元,连接会加强」)构建对称权重矩阵,给网络定义了一个「能量函数」。就像球总会滚到地势最低的谷底,网络状态会在能量函数的驱动下不断下降,最终停在局部能量最小的「吸引子」上。

这个过程完全复刻了大脑的记忆逻辑:当你看到旧友的半张脸,就像给网络输入了一个不完整的初始状态,网络会自动「补全」信息,收敛到对应完整记忆的吸引子上——这就是我们常说的「联想记忆」。

经典霍普菲尔德网络的存储容量约为神经元数量的0.14倍,虽然不算大,但它第一次用严谨的数学证明了:简单的神经元连接,能涌现出复杂的记忆功能。

霍普菲尔德网络的真正爆发,是在2020年后。研究者们给它换上了连续状态神经元和基于对数和指数的新型能量函数,打造出现代霍普菲尔德网络——它的存储容量直接跃升到指数级,能以神经元维度的指数形式存储模式,几乎一次迭代就能完成记忆检索。

更意外的发现随之而来:现代霍普菲尔德网络的更新规则,和Transformer中的自注意力机制数学形式完全一致。Transformer的「键-值对」对应霍普菲尔德网络的存储模式,「查询向量」对应检索输入,softmax函数计算的权重,就是网络对不同记忆的关注度。

这意味着,如今横扫AI领域的Transformer,本质上就是一个升级版的霍普菲尔德网络——它用自注意力机制实现了大规模的联想记忆检索。而霍普菲尔德当年提出的「吸引子」「能量函数」等概念,正是Transformer能处理海量上下文、实现长文本理解的底层逻辑。

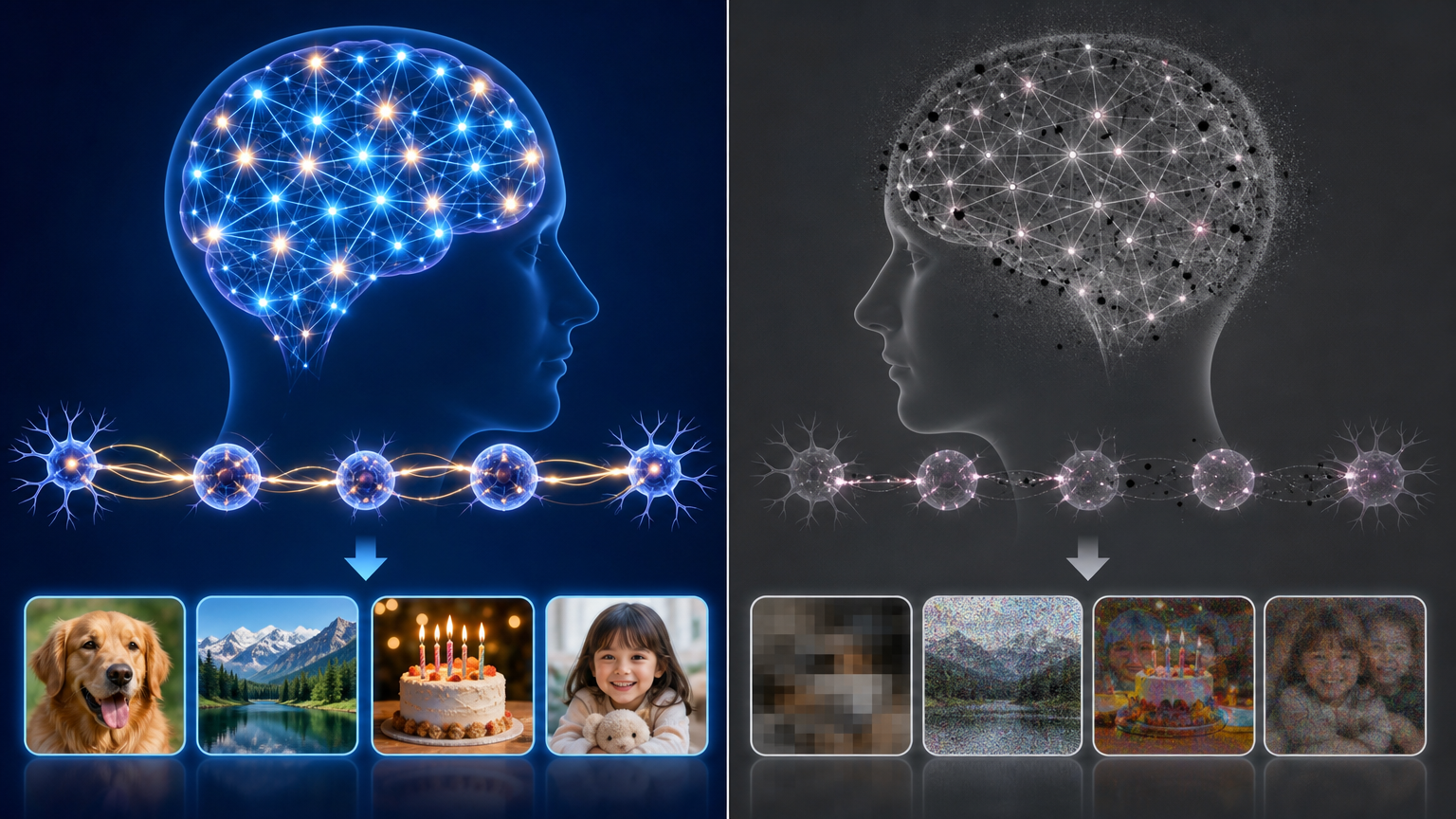

但霍普菲尔德网络也有局限:经典模型对噪声敏感,输入稍有干扰就可能收敛到错误的吸引子;现代模型虽然提升了容量,但计算复杂度也随之上升,在低功耗设备上的应用仍受限制。

除了AI,霍普菲尔德网络正在成为神经科学研究的「虚拟大脑」。研究者通过给网络引入噪声、稀疏化突触权重,就能模拟阿尔茨海默病患者的记忆退化:记忆检索成功率下降、不同记忆出现混淆,甚至完全无法唤起正确的记忆。

更精细的模型还能结合代谢因素,比如模拟脑内胰岛素敏感性降低导致的线粒体功能异常,观察到类似淀粉样斑块形成的网络变化。这些模拟让科学家能在计算机上测试潜在的治疗方案,比如通过调整网络权重、引入外部「辅助神经元」,看是否能帮助受损的「虚拟大脑」恢复记忆功能。

在脑机接口领域,霍普菲尔德网络的启发也显而易见:它的联想记忆机制,为设计能从残缺脑电信号中解码完整意图的接口提供了思路——比如让瘫痪患者仅通过模糊的意念,就能控制假肢完成动作。

当玛丽亚·格芬在普林斯顿大学的课堂上第一次接触霍普菲尔德网络时,她不会想到,这个将物理、数学和神经科学拧在一起的模型,会贯穿她的整个科研生涯,更不会想到它会成为现代AI的核心基石之一。

霍普菲尔德的过人之处,从来不是创造了一个复杂的算法,而是他敢用最简单的公式,去触碰大脑最复杂的功能——记忆。这也正是科学最动人的地方:一个看似微小的洞见,能在不同领域掀起连锁反应,最终串起人类对自身和机器的双重理解。

最好的科研,总在学科的交叉点上生长。