对抗知识焦虑,从看懂这条开始

App 下载

超级智能的“巴别塔”:当AI巨头误将语言作思想

萨姆·奥特曼|OpenAI|达里奥·阿莫迪|Anthropic|马克·扎克伯格|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

萨姆·奥特曼|OpenAI|达里奥·阿莫迪|Anthropic|马克·扎克伯格|大语言模型|人工智能

“超级智能的开发已近在眼前,”马克·扎克伯格宣告,预示着“今天无法想象的新事物将被创造和发现”。Anthropic的CEO达里奥·阿莫迪则给出了更具体的时间表,强大的AI“最早可能在2026年到来,并将在大多数相关领域比诺贝尔奖得主更聪明”,甚至能将人类寿命延长一倍。OpenAI的萨姆·奥特曼则自信地表示:“我们现在有信心知道如何构建AGI(通用人工智能)。”

这些来自科技金字塔顶端的宣言,描绘了一个近乎神话的未来:疾病被治愈,死亡被延迟,科学发现的速度呈指数级增长。然而,就在这片乐观主义的喧嚣之上,另一重声音正变得越来越响亮。包括“AI教父”杰弗里·辛顿、图灵奖得主姚期智在内的超过三千名全球科技领袖,联名签署了一封公开信,紧急呼吁暂停“超级智能”的研发,直到我们能确保其安全可控。他们警告的风险从经济崩溃、公民自由丧失,直至“潜在的人类灭绝”。

一边是近乎乌托邦的承诺,一边是末日般的警示。这场分歧的核心,不仅仅是关于技术发展的速度与风险,更触及一个根本性的科学问题:我们今天引以为傲的大语言模型,其驱动的“智能”,与我们所理解的、能够进行真正思考与发现的智能,究竟是不是一回事?在这场通往“超级智能”的竞赛中,我们是否正在建造一座根基不稳的“巴别塔”,误将流利的语言表达当成了通往智慧的阶梯?

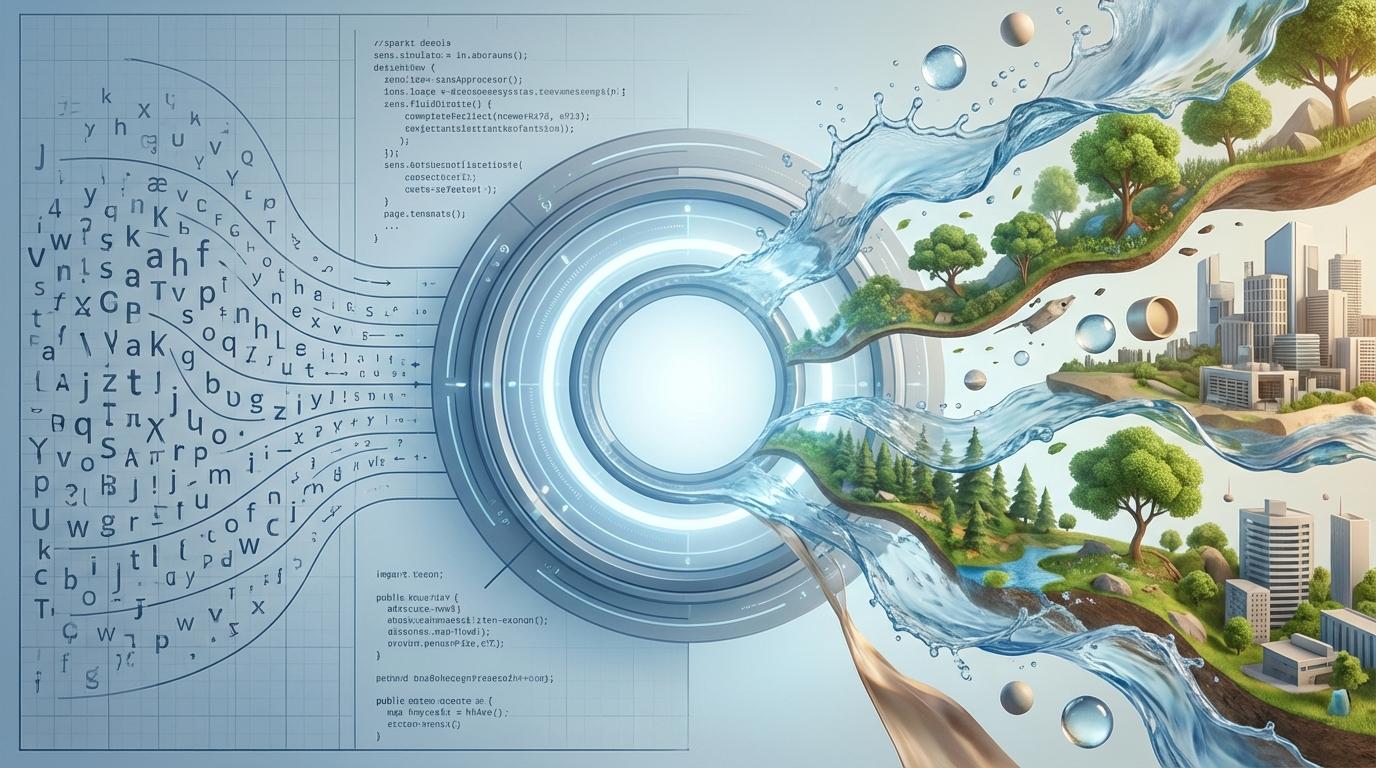

要理解这场争论的本质,我们必须先揭开当前AI明星——大型语言模型(LLM)的面纱。无论是ChatGPT、Claude还是Gemini,它们的核心都是基于海量语言数据训练出的统计模型。它们的根本任务,是在给定一段输入文本后,通过复杂的概率计算,预测出最有可能出现的下一个词。它们是地球上最先进的“文字接龙”大师,是模仿言语的大师,但模仿并非理解。

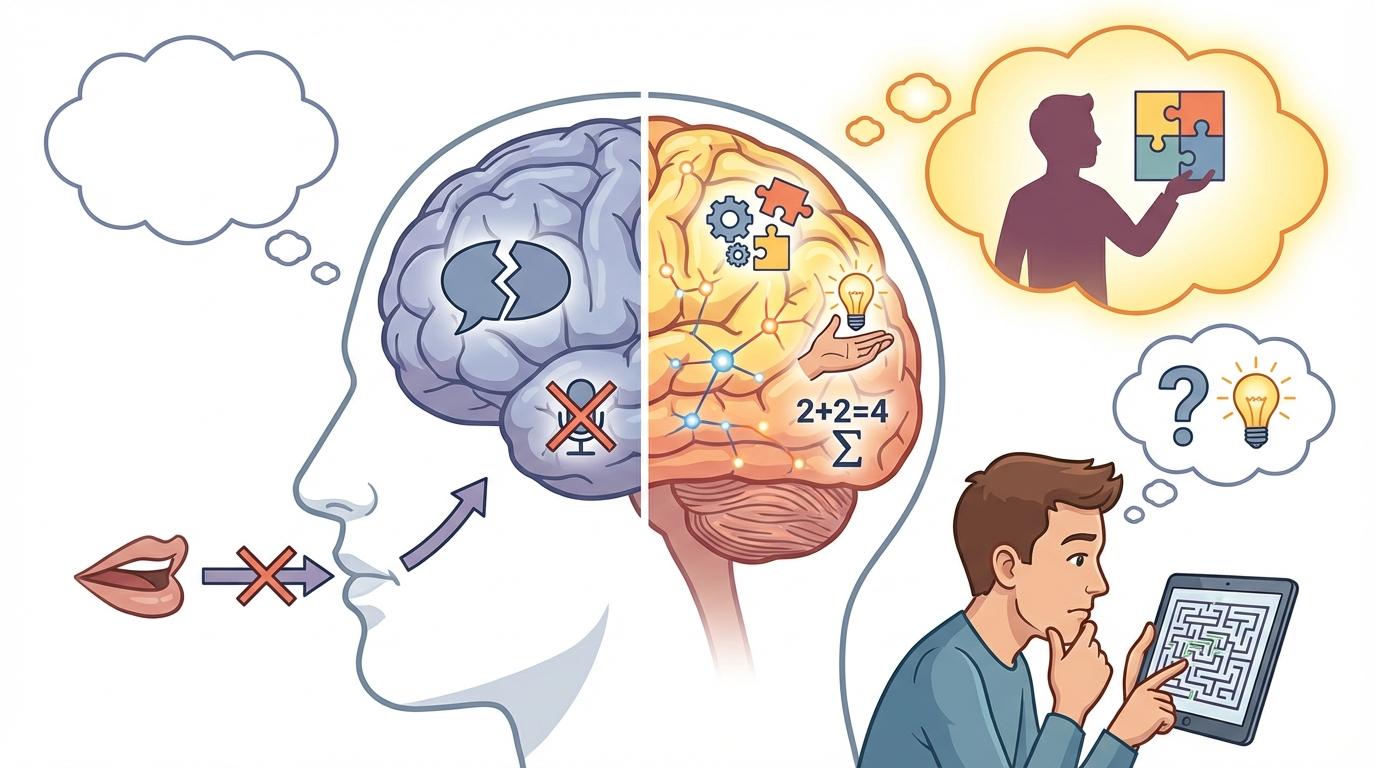

问题在于,我们将这种模仿误解为了思考。根据当代神经科学几十年的研究成果,人类的思维在很大程度上是独立于语言存在的。语言是我们用来沟通思想的精妙工具,一个高效的“认知小工具”,但它不是思想本身。这个区别,正是区分科学事实与科技巨头们充满科幻色彩的愿景的关键。

如果我们剥离语言,思想会消失吗?答案是否定的。

这个结论并非推测,而是建立在坚实的经验证据之上:

失语症的证据:一个更具说服力的例子来自那些因脑损伤或其他疾病而失去语言能力(即失语症)的患者。科学研究明确指出,“存在大量语言能力严重受损的个体,他们仍然表现出完整的思考能力。”他们可以解决数学题,理解非语言指令,甚至进行复杂的因果和逻辑推理。他们心中有话,只是“有口难言”,但这并不妨碍他们内心的世界继续运转和思考。

婴儿的证据:我们每个人都曾亲身验证过这一点。观察一个还不会说话的婴儿,你会看到一个不知疲倦的小科学家。他们通过实验、分析、形成关于物理、生物和心理世界的直觉理论来学习。认知科学家艾莉森·高普尼克指出,这一切都发生在他们掌握语言之前。婴儿显然在思考,他们的认知能力正在蓬勃发展,语言只是后来才加入的工具。

语言是我们用来打包和传输思想的媒介,但思想的产生过程——推理、抽象、概括——是一个更深层、更独立的认知活动。拿走一个人的语言能力,他依然可以思考、感受、坠入爱河;但拿走大语言模型的语言,剩下的便只有一片虚无。

对LLM局限性的认知,并不仅仅来自外部的神经科学家。在人工智能研究界内部,一场深刻的范式转移正在悄然发生。越来越多的顶尖科学家开始公开质疑“暴力缩放”语言模型就能通往AGI的路径。

图灵奖得主、Meta首席AI科学家杨立昆(Yann LeCun)是其中最著名的批评者之一。他尖锐地指出,单纯的LLM缺乏对物理世界的基本理解,没有持久的记忆,也无法进行真正的推理和规划。它们就像被困在文字符号中的“幽灵”,无法将词语(word)与真实的世界(world)联系起来。正如AI评论家加里·马库斯所言,LLM缺乏一个稳定、可更新、可解释的“内部世界模型”。

这种反思正催生着新的技术浪潮。杨立昆等人大力倡导的“世界模型”(World Models)被视为更有希望的路径。其核心思想是,让AI系统通过观察和互动(而不仅仅是阅读文本)来学习世界运行的规律——物理规则、因果关系、时空连续性。这要求AI具备多模态的感知能力,能够处理视觉、声音等信息,从而在“内心”建立一个可以模拟和预测现实世界的动态模型。

从OpenAI的视频生成模型Sora被其官方定义为“世界模拟器”,到谷歌DeepMind和Meta相继发布旨在理解和模拟物理世界的模型,巨头们的行动已经表明,战场的焦点正从单纯的语言领域,扩展到一个更广阔、更复杂的,与真实世界接轨的维度。这本身就是对“语言即智能”假说的一种修正。

让我们做一个思想实验:假设在不远的未来,我们成功构建了一个跨越多个认知领域的AI系统,它在推理、记忆、感知等方面的表现都达到了人类水平。我们会因此迎来科技巨头们承诺的科学发现大爆炸吗?

答案可能是否定的。因为这里存在最后一个,或许也是最难逾越的障碍:创造性飞跃。

科学哲学家托马斯·库恩在其经典著作《科学革命的结构》中指出,重大的科学进步并非来自现有框架内的迭代实验,而是源于“范式转移”——当新的问题和想法出现,旧的科学描述无法再容纳它们时,革命就发生了。爱因斯坦在没有任何经验证据证实之前,就构想出了相对论。

哲学家理查德·罗蒂进一步发展了这个观点。他认为,当科学家和艺术家对现有的“词汇”(即范式)感到不满意时,他们会创造出新的“隐喻”,从而产生对世界的新描述。如果这些新描述被证明是有用的,它们就会成为我们新的“常识”。我们今天的常识,不过是“一堆死去的隐喻”的集合。

以此观之,当前AI系统的核心机制——基于现有数据进行预测和建模——使其成为了一个卓越的“常识储存库”和“死喻机器”。它可以极其高效地在我们已经编码的知识体系内进行重组、混合和再利用。但是,它有内在的动机去“不满意”我们喂给它的数据吗?它能感受到现有范式的局限,并因此产生一种必须创造全新词汇来描述世界的冲动吗?

目前看来,答案是否定的。AI没有理由对我们给它的世界描述感到不满。它被设计用来复制和预测,而不是反叛和颠覆。它可以将我们已有的知识以有趣的方式重新组合,但它永远被困在我们为它设定的词汇表里。

科技巨头们描绘的“超级智能”愿景,建立在一个诱人但危险的简化之上:将语言能力等同于智能。然而,从牙牙学语的婴儿到大脑受损的病人,再到科学史上的每一次伟大飞跃,都在提醒我们,真正的智能远比这更深邃、更复杂。

这场关于AI未来的辩论,最终迫使我们回过头来审视自身。它让我们不得不去定义那些我们曾经想当然的概念:什么是思考?什么是理解?创造力的火花究竟从何而来?

或许,通往真正通用人工智能的道路,并非是建造更大、更耗能的语言模型,而是要先理解构成人类智能的复杂架构——那套由感知、记忆、推理、规划以及与物理世界互动共同组成的精妙系统。在此之前,那些改变世界的颠覆性思想、那些重塑我们世界观的全新隐喻,仍将是人类的专属领域。我们,这些思考着、推理着、并用语言与彼此分享思想的生物,仍将站在改变世界理解的前沿。