对抗知识焦虑,从看懂这条开始

App 下载

机器人能读仪表查隐患,但还不会拿稳水杯

环境感知|自主操作|高阶推理AI|工业巡检|四足机器人|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

环境感知|自主操作|高阶推理AI|工业巡检|四足机器人|AI智能体|人工智能

深夜的化工厂里,四足机器人正沿着管道自主巡逻——它停下来,盯着压力表的指针转了半圈,镜头拉近确认读数,随即在系统里标记了“压力异常”。这不是科幻电影,是2026年工业巡检的日常。搭载了高阶推理AI的它,能看懂复杂仪表、识别泄漏痕迹,甚至会调用视觉工具辅助判断环境。但如果让它捡起客厅里的半罐可乐,它可能会侧着抓握,把剩洒得满地都是。为什么一个能在高危环境里自主工作的机器人,连拿稳杯子这种小事都做不好?这背后藏着当前机器人智能化的核心矛盾。

过去的工业机器人,本质是“会动的代码”——工程师把每一步动作拆解成指令,它只能在预设的路线和规则里重复。一旦环境有变化,比如仪表换了位置、地面多了堆杂物,它就会陷入“死机”式的混乱。而高阶推理AI的出现,相当于给机器人装了个“能理解语言的大脑”。

你可以把它想象成一个刚入职的巡检员:先通过视觉看清楚环境,再用语言理解任务要求,最后规划动作步骤。比如接到“检查所有高温管道”的指令,它会先识别哪些是高温管道,再逐一靠近查看温度读数,最后汇总异常情况。这个过程里,它不需要预设每根管道的坐标,而是靠“理解”任务逻辑来自主完成。

在工业巡检场景中,这种能力已经带来了实际价值:某化工厂用它替代人工巡检后,生产线停机时间减少了1.5%——这背后是每年数百万的成本节省。但这个“聪明的巡检员”,到了日常生活里却像个“低能儿”,核心问题出在数据上。

当前的高阶推理AI,几乎是个“视觉动物”——它的所有认知都来自摄像头拍的图像。互联网上有海量的“怎么读压力表”“怎么识别泄漏”的视觉数据,但“怎么拿稳一杯水”这种需要触觉反馈的知识,几乎找不到公开的大规模数据集。

你拿杯子的时候,手指会感知杯壁的光滑度、重量,自动调整握力;如果杯子里有水,你会下意识地保持水平。但机器人没有这种“体感记忆”,它只能靠视觉判断“我抓住了杯子”,却不知道抓得稳不稳、会不会洒。要让它学会这些,需要收集大量“抓握不同物体时的触觉数据”,而这种数据的采集成本极高:每小时的高质量示范数据,成本可能高达1000到10000美元。

更棘手的是安全问题。欧盟AI法案要求,高风险AI系统必须能“优雅降级”——当感知不确定时,要减速、暂停或请求人类确认。但如果机器人连“抓握力度是否合适”都判断不了,就可能出现把杯子捏碎、或者拿起来就掉的情况。为了规避风险,当前的商用机器人大多关闭了精细操作功能,只保留视觉主导的巡检、识别任务。

要解决这些问题,光靠优化单个机器人的AI还不够,行业正在往两个方向突破:一是多机器人协作,二是多模态数据融合。

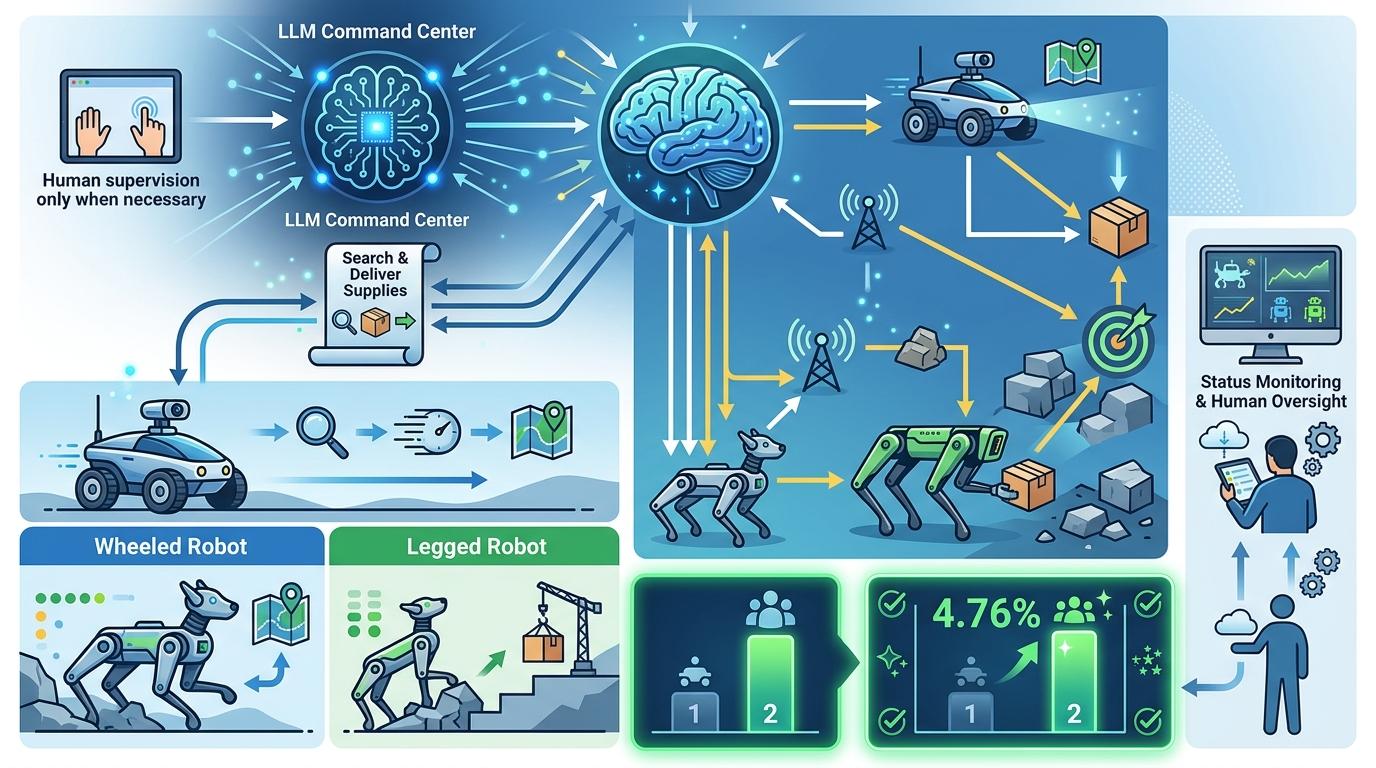

南安普顿大学的研究团队做了个尝试:让轮式、腿式等不同类型的机器人组队,用大语言模型当“指挥中心”。接到“搜索并搬运物资”的指令后,轮式机器人负责快速搜索,腿式机器人负责翻越障碍搬运,人类只在必要时介入监督。在模拟环境中,这种组队方式的任务成功率比单机器人提升了4.76%。

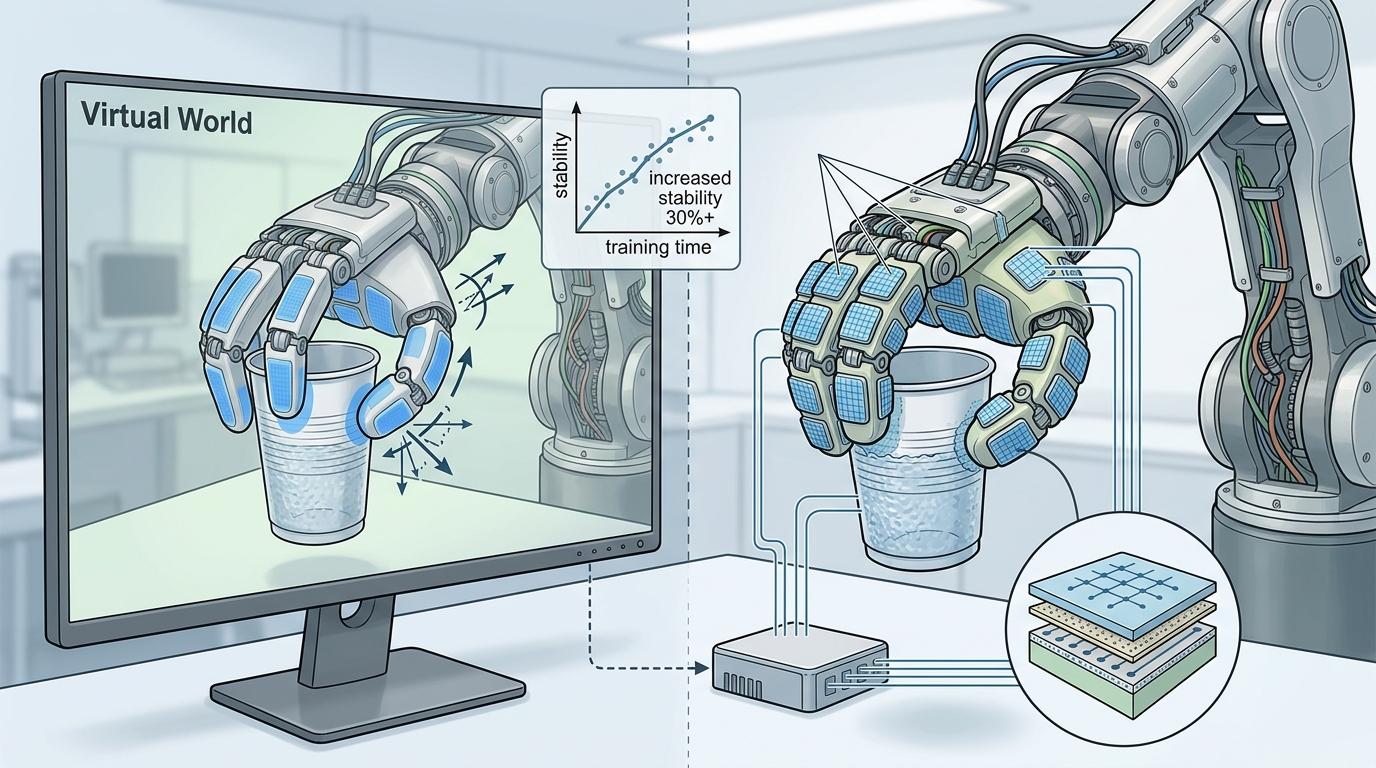

另一个方向是给机器人补上“触觉”。一些团队正在开发低成本的触觉传感器,同时用数字孪生技术在虚拟环境中模拟触觉反馈——先让机器人在虚拟世界里练习拿杯子、拧螺丝,把“体感记忆”练熟了再放到现实中。虽然目前还在实验室阶段,但已经能让机器人抓握物体的稳定性提升30%以上。

当我们谈论机器人的智能化时,总容易陷入“它什么时候能像人一样”的期待里,但从巡检员到拿杯子的差距告诉我们:智能不是单一的能力,而是无数细碎知识的积累。机器人能在高危环境里自主工作,是因为工业场景的规则相对明确、数据足够集中;而拿稳杯子这种“小事”,需要的却是人类与生俱来的、遍布全身的“体感数据库”。

智能的进阶,始于对细节的理解。未来的机器人不会突然变得和人一样,但它会慢慢学会:抓杯子时要保持水平,搬重物时要调整姿势,甚至在不确定的时候,会停下来问人类一句“这样做对吗”。这种不完美的智能,或许才是最贴近现实、也最有价值的。