对抗知识焦虑,从看懂这条开始

App 下载

浏览器跑通大模型推理,靠的是这招内存魔术

内存优化|长上下文推理|KV缓存|TurboQuant算法|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

内存优化|长上下文推理|KV缓存|TurboQuant算法|大语言模型|人工智能

当你在浏览器里输入一句长文本提问,AI瞬间给出精准回答时,可能没意识到——这背后的内存消耗,曾是卡住所有开发者的死结。大模型推理时,用来存储中间计算结果的KV缓存会随上下文长度线性膨胀:70B参数模型处理10万token,光缓存就要占25GB显存,普通GPU根本扛不住。但现在,Google Research的TurboQuant算法把这个数字砍到了原来的1/6,还能让浏览器直接跑通百万token级的长上下文推理。这不是靠堆硬件,而是用数学魔术重新定义了AI推理的内存逻辑。

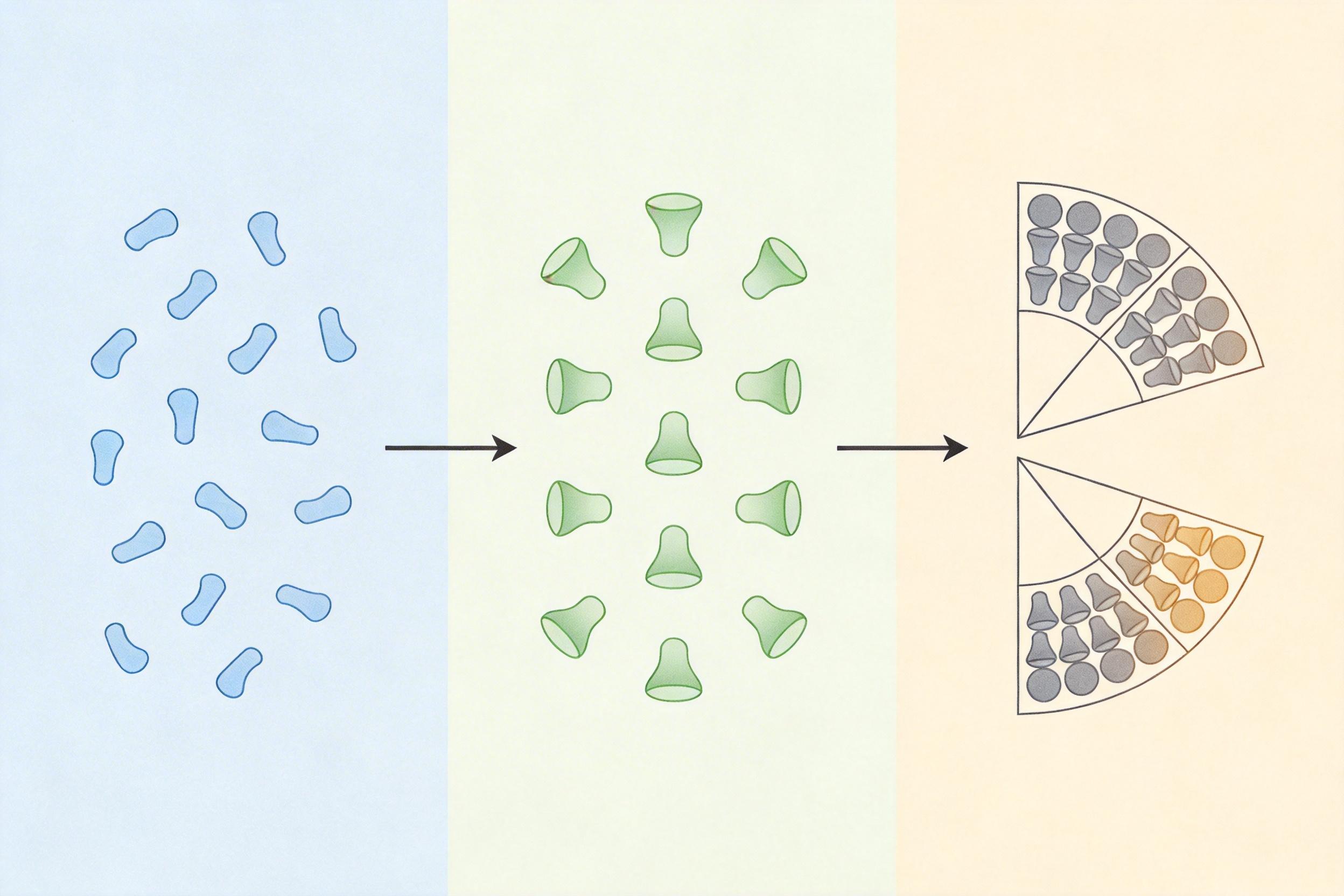

你可以把高维向量想象成一团拧乱的耳机线——每个线圈的位置都不规则,要打包得既紧凑又能还原,几乎不可能。TurboQuant的第一步,就是给这团线来个「随机正交旋转」:相当于把耳机线放进一个高速旋转的盒子,再拿出来时,每个线圈的位置都变成了可预测的均匀分布。

但真实的机制比这更精确:输入的高维向量先乘以随机正交矩阵,让每个坐标都服从已知的Beta分布(高维时近似正态分布),消除了原始数据里的异常值和偏态。接着用PolarQuant极坐标量化,把旋转后的向量两两配对转成半径和角度,再用预先计算好的最优Lloyd-Max码本给角度分桶——这就像给整理好的耳机线按固定尺寸打包,不需要额外的捆扎带(量化参数),彻底省掉了元数据开销。

最后是QJL残差校正:用1bit的符号位修正量化误差,保证内积计算无偏。简单说就是,万一打包时压坏了几根线,用一个小标记记住位置,还原时就能精准修复。整个过程不需要训练数据,不需要模型微调,拿到向量就能直接压缩——这是它和传统量化技术最核心的区别。

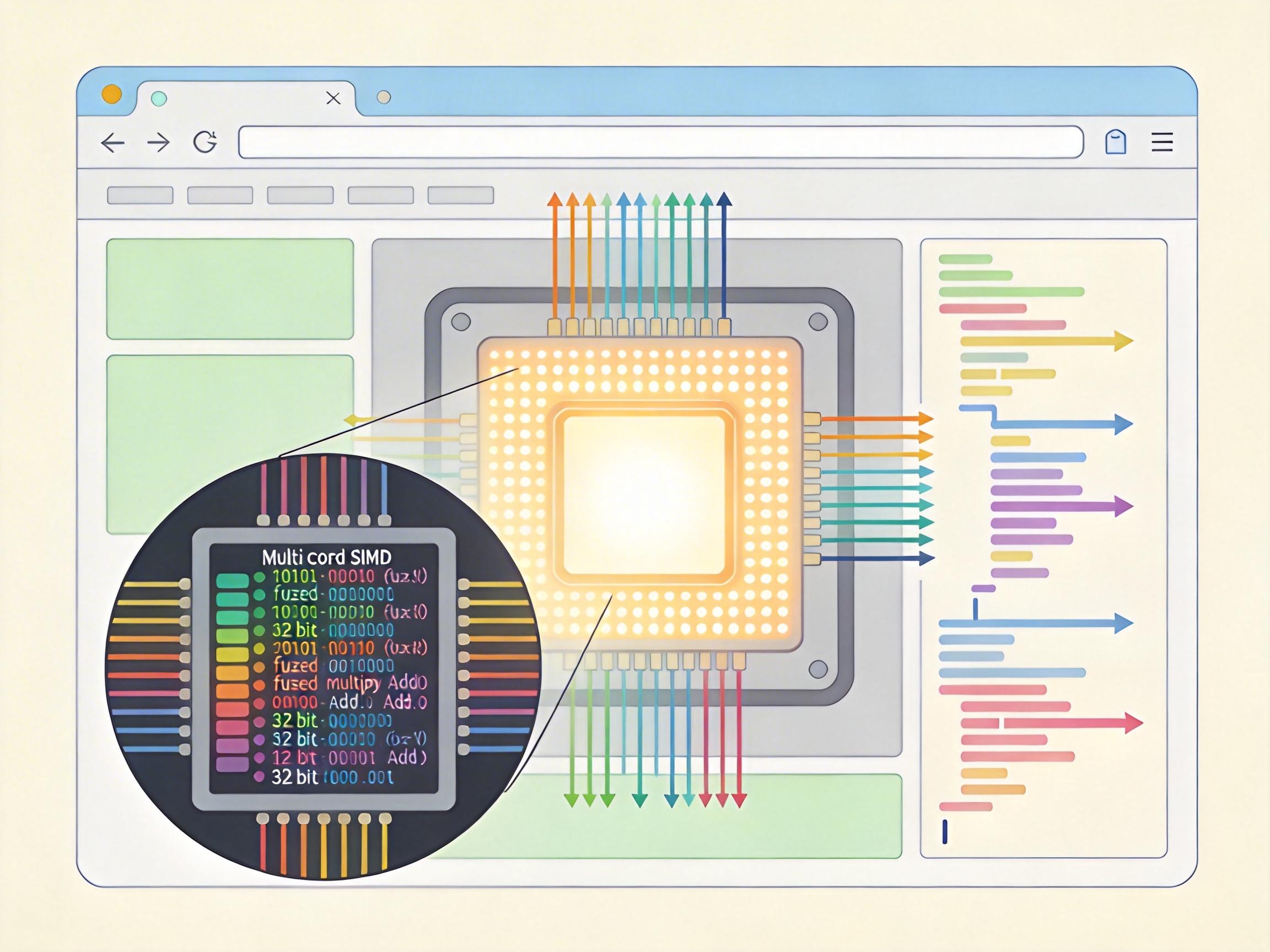

光有算法还不够,要在浏览器里跑通这种级别的计算,得靠WASM和Relaxed SIMD这对黄金搭档。

WASM(WebAssembly)相当于给浏览器装了个「通用计算器」——它能把C、Zig这类底层语言写的代码编译成浏览器能直接执行的二进制文件,速度接近本地原生程序。而Relaxed SIMD(单指令多数据)则是这个计算器的「多核按钮」:一条指令就能同时处理4个32位浮点数,比如用f32x4.relaxed_madd融合乘加指令,一次完成乘法和加法运算,把计算效率拉满。

开发者把TurboQuant的Zig实现编译成带Relaxed SIMD指令的WASM二进制,再用TypeScript封装成简单的API:初始化、编码、解码、点积,四步就能完成从向量压缩到推理的全流程。在Chrome 114+、Safari 18+这些现代浏览器里,它能实现和原生Zig版本完全一致的字节级输出,还能在不解码的情况下直接计算向量点积——这意味着搜索时不需要把压缩包解开,直接用压缩数据算相似度,速度又快了一倍。

当然也有局限:它只解决KV缓存的内存瓶颈,70B以上的模型权重还是得靠权重量化技术;而且浏览器端的计算资源毕竟有限,极端复杂的推理任务还是得靠云端。但对大多数日常场景来说,它已经足够把AI推理从数据中心拉到用户的浏览器里。

TurboQuant发布当天,三星、SK海力士这些内存厂商的股价应声下跌——市场误以为这会减少AI对内存的需求,但事实刚好相反。

它真正改变的,是AI推理的「经济模型」。以前企业要跑长上下文推理,要么租昂贵的云端H100 GPU,要么买几十万的本地显卡;现在用TurboQuant,一台Mac Mini M4 Pro就能支持百万token的文档分析,成本直接砍到原来的1/10。这会让更多企业敢用AI,更多开发者敢做长上下文应用——比如法律文档审阅、百万字小说生成、多轮对话机器人,这些以前只能停留在实验室的场景,现在能真正落地。

更重要的是,它把数据控制权还给了用户。以前用AI得把敏感数据传到云端,现在在浏览器里就能完成推理,数据根本不会离开设备。这对医疗、金融、法律这些对隐私要求极高的行业来说,是跨时代的变化——AI的能力不再和数据隐私对立。

当我们谈论AI的未来时,总习惯盯着更大的模型、更多的参数,却常常忽略了「效率」才是真正的普惠密码。TurboQuant不是让AI变得更强大,而是让AI的强大变得更易得——它不需要你懂复杂的硬件知识,不需要你花几百万买设备,只需要一个现代浏览器,就能把百万token的长上下文推理握在手里。

效率不是为了节省,而是为了让更多人能用。 从云端到浏览器,从数据中心到个人设备,AI正在从少数企业的特权,变成每个人都能触碰的工具。而这一切的起点,不过是一群数学家把向量拧成了更易打包的形状。