对抗知识焦虑,从看懂这条开始

App 下载

AI硬件能耗大减70%,靠的是这层薄膜

能耗优化|AI数据中心|忆阻器|氧化铪薄膜|剑桥大学|先进材料|前沿科技

对抗知识焦虑,从看懂这条开始

App 下载

能耗优化|AI数据中心|忆阻器|氧化铪薄膜|剑桥大学|先进材料|前沿科技

当你刷短视频时,后台的AI正用掉半个家庭一天的用电量——这不是夸张。2026年的数据显示,全球AI数据中心的年耗电量已经逼近一个中等国家的总发电量,而传统芯片里,光是数据在计算单元和存储单元之间来回搬运,就耗掉了84%的电能。

现在,剑桥大学的一群科学家找到了破局的钥匙:一块掺杂了锶和钛的氧化铪薄膜。它做成的忆阻器——一种能像大脑突触那样同时存储和处理信息的元件,把AI硬件的能耗直接砍去了70%,开关电流比传统同类器件低了整整一百万倍。

但这一切,是怎么做到的?

要理解这次突破,得先搞懂传统忆阻器的死穴。你可以把传统忆阻器想象成一个装着导电粉末的玻璃管:要让它导电,就得先通电烧出一条“导电丝”,断电后这条丝可能断裂也可能保留,以此实现“记忆”功能。但问题是,这条丝的生长完全随机——就像你闭着眼在玻璃管里穿线,每次的位置都不一样,不仅需要高电压,还经常“失忆”,根本没法大规模用在AI硬件里。

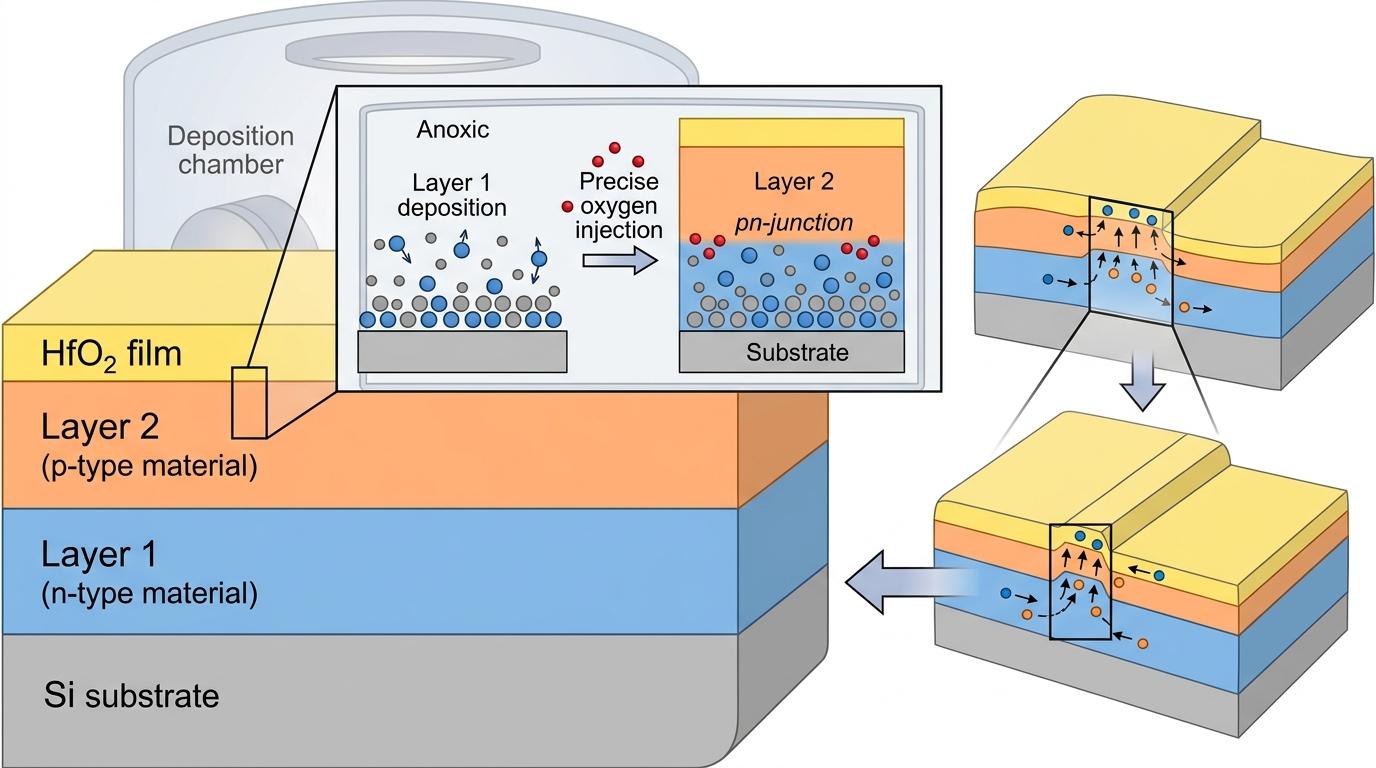

剑桥团队彻底换了思路。他们没有用“烧灯丝”的老办法,而是在氧化铪薄膜里“搭了个门”:通过两步沉积法,先在无氧环境下长出底层薄膜,再精准注入氧气,让薄膜层与层之间形成了一个个微小的p-n结——也就是可以精准控制的电子门。

当电压变化时,这些电子门的“门槛”(能量壁垒)会平稳升降,电阻也就跟着连续变化,完全不需要随机的导电丝。这就像把随机穿线改成了按密码开门,不仅稳定,而且开关一次用的电流,只相当于传统器件的百万分之一。

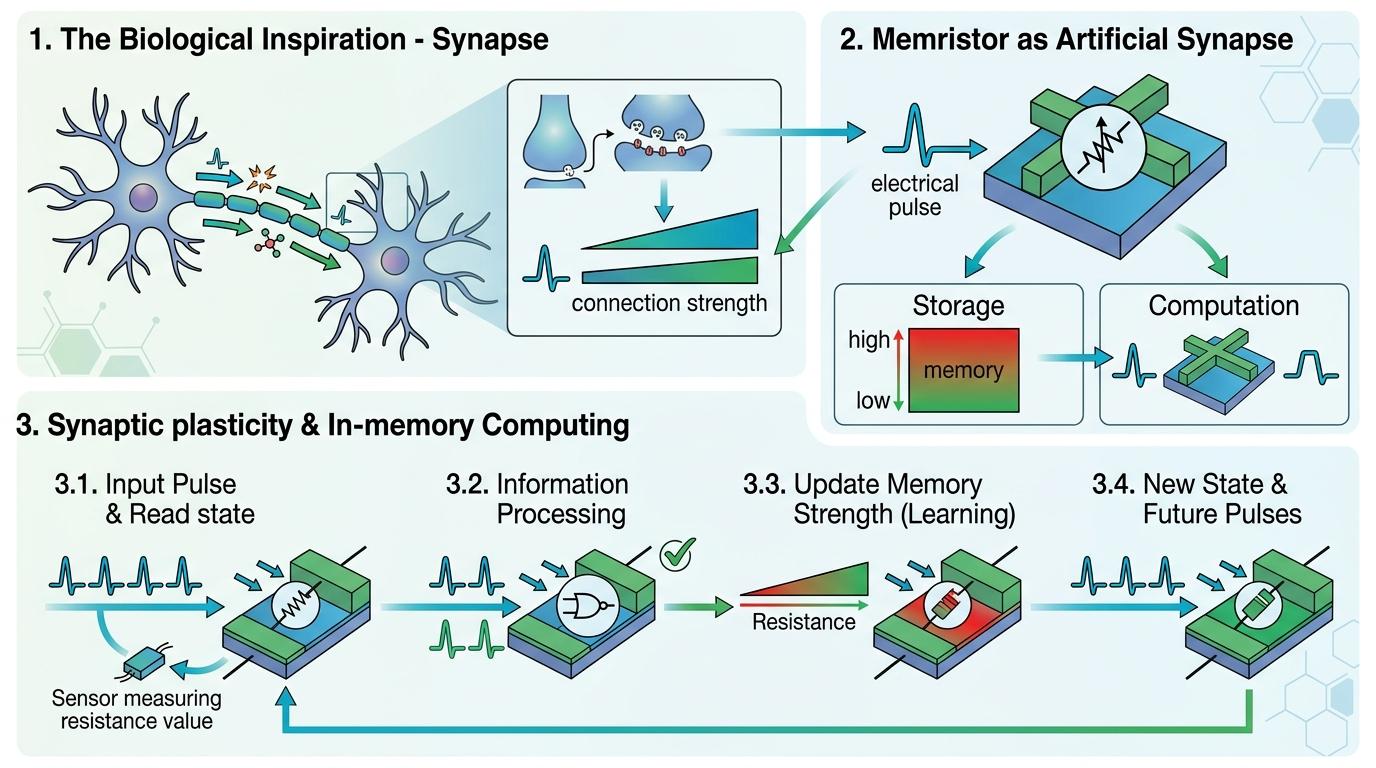

这种新忆阻器最厉害的地方,是它完美模仿了大脑的工作逻辑。人类大脑的神经元和突触,是在同一个地方存储和处理信息的——比如你看到猫的瞬间,负责识别的神经元同时就记住了猫的样子,不需要把“猫的图像数据”从“记忆仓库”搬到“计算车间”。而传统冯·诺依曼架构的AI芯片,恰恰卡在了这种“数据搬运”上。

新忆阻器把存储和计算合二为一:每一个忆阻器就是一个“突触”,它的电阻值就是“记忆的强度”。当电脉冲过来时,它可以直接根据电阻值处理信息,同时更新自己的电阻——就像大脑突触会根据信号的强弱调整连接强度。

实验数据更有说服力:它能稳定切换超过1万次,保持记忆的时间长达一天,还能模拟大脑的“时序依赖可塑性”——也就是根据信号到来的时间调整记忆强度,这是AI实现自主学习的关键。更重要的是,它的单次操作能耗最低只有2.5飞焦耳,相当于一根头发从1毫米高处落下的能量。

更值得关注的是,这不是实验室里的“玩具”:团队已经用它在乳腺癌数据集的分类任务里,通过硬件层面的学习,把准确率提升了3%——这在AI算法已经逼近天花板的今天,是相当可观的突破。

当然,这项技术离真正走进我们的生活,还有一道坎:现在的制备温度需要700℃,而主流半导体工艺的温度上限是450℃。这意味着它暂时没法直接塞进现有的芯片生产线,必须先把“烧制”温度降下来。

但团队已经看到了方向:他们正在尝试用低温原子层沉积法替代现有的两步沉积工艺,目标是把温度降到400℃以下。一旦突破这个瓶颈,它就能像搭积木一样,集成到手机、智能手表这些边缘设备里——到时候,你的智能手表可以连续一周不用充电,还能离线帮你分析健康数据。

从产业角度看,这也是一次及时的破局。目前全球神经形态计算市场正以每年90%的速度增长,Intel、IBM这些巨头已经布局多年,但一直卡在器件稳定性的问题上。剑桥的这项突破,相当于给整个行业提供了一个标准化的“突触模板”,解决了大规模量产的核心难题。

当我们为AI生成的图片和视频惊叹时,很少有人注意到背后的能源代价:一个训练大模型的数据中心,一年的耗电量足够一个普通家庭用三千年。而剑桥团队的这块薄膜,就像给狂奔的AI踩下了一脚“节能刹车”。

计算的终极形态,是像大脑一样高效。 从冯·诺依曼的“存储-计算分离”,到神经形态计算的“存算一体”,人类正在一点点向自然界最完美的计算系统靠拢。或许用不了十年,你手里的手机就会用上这种忆阻器,而你根本不会察觉到它的存在——就像你从来不会为大脑的能耗担心一样。

毕竟,最好的技术,就是让你感觉不到它的存在。