对抗知识焦虑,从看懂这条开始

App 下载

AI能耗危机迫近:堆叠芯片是终极解药吗?

冷却技术|纳德拉|MIT工程师|数据中心能耗|堆叠芯片|半导体技术|AI算力|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

冷却技术|纳德拉|MIT工程师|数据中心能耗|堆叠芯片|半导体技术|AI算力|前沿科技|人工智能

与ChatGPT进行一次对话,背后数据中心产生的热量,可能需要一整瓶水来冷却。这并非危言耸耸听,而是人工智能(AI)指数级发展背后,一个日益严峻的现实。国际能源署(IEA)预测,到2030年,全球数据中心的电力消耗将飙升至近945太瓦时,主要推手正是AI。微软CEO纳德拉甚至直言,公司已没有足够的电力来满足所有GPU的需求。在这场席卷全球的“电力饥渴症”中,我们不禁要问:支撑智能未来的能源,究竟从何而来?

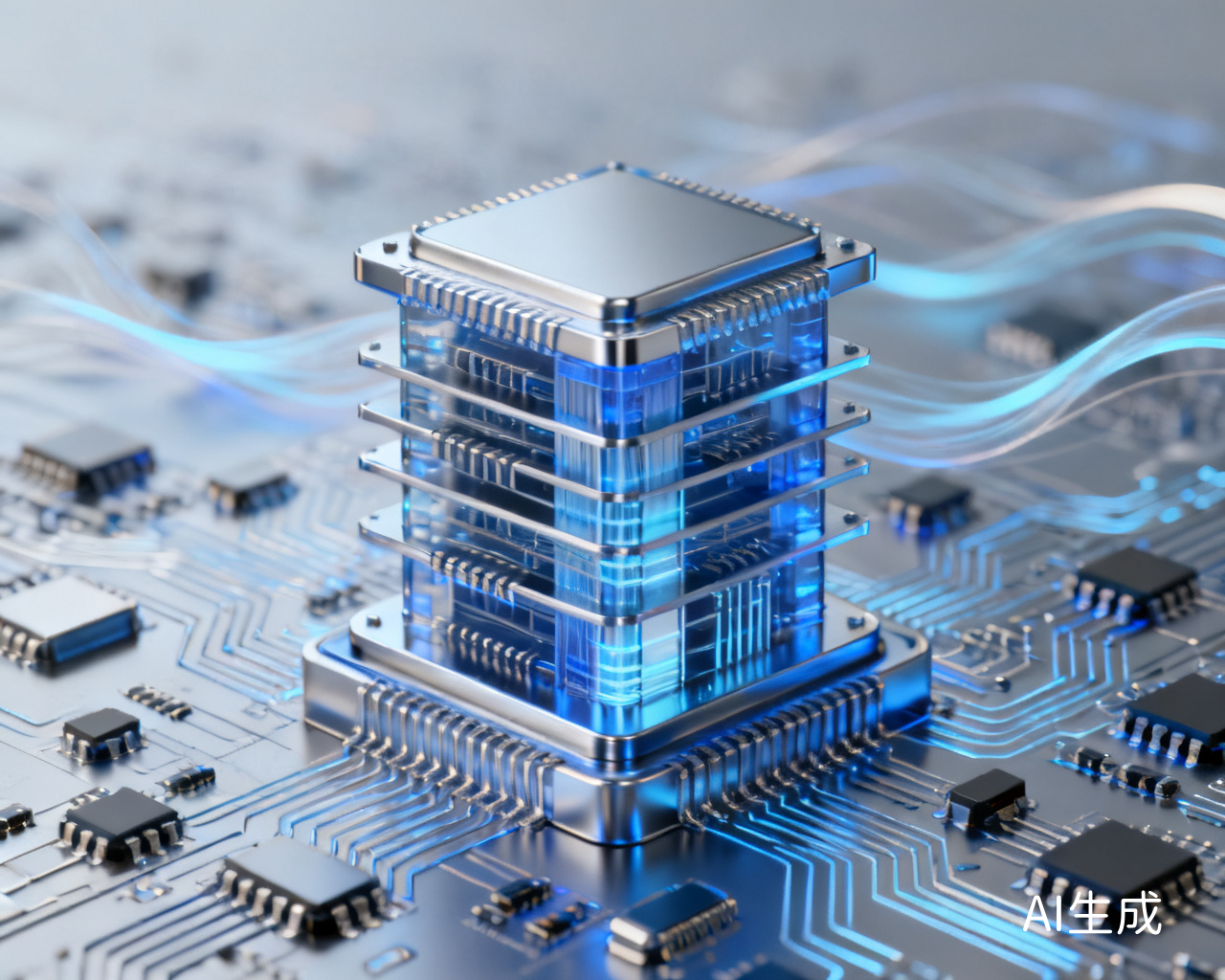

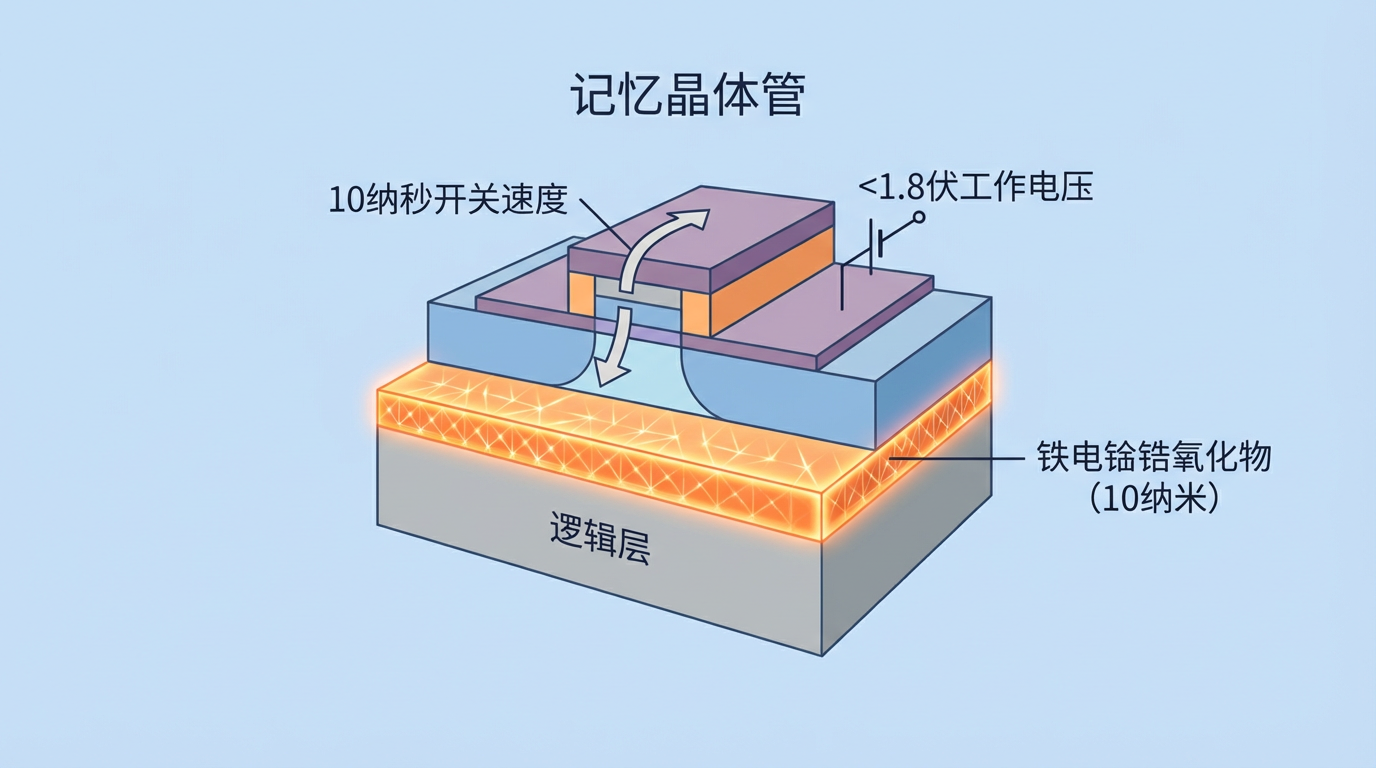

就在业界对AI能耗的忧虑日益加深之际,麻省理工学院(MIT)的工程师们带来了一线希望。他们巧妙地将电路元件像制作三明治一样垂直堆叠起来,创造出一种全新的“堆叠式存算一体”芯片原型。这项于旧金山国际电子器件会议上公布的研究,直击了AI能耗的核心痛点。

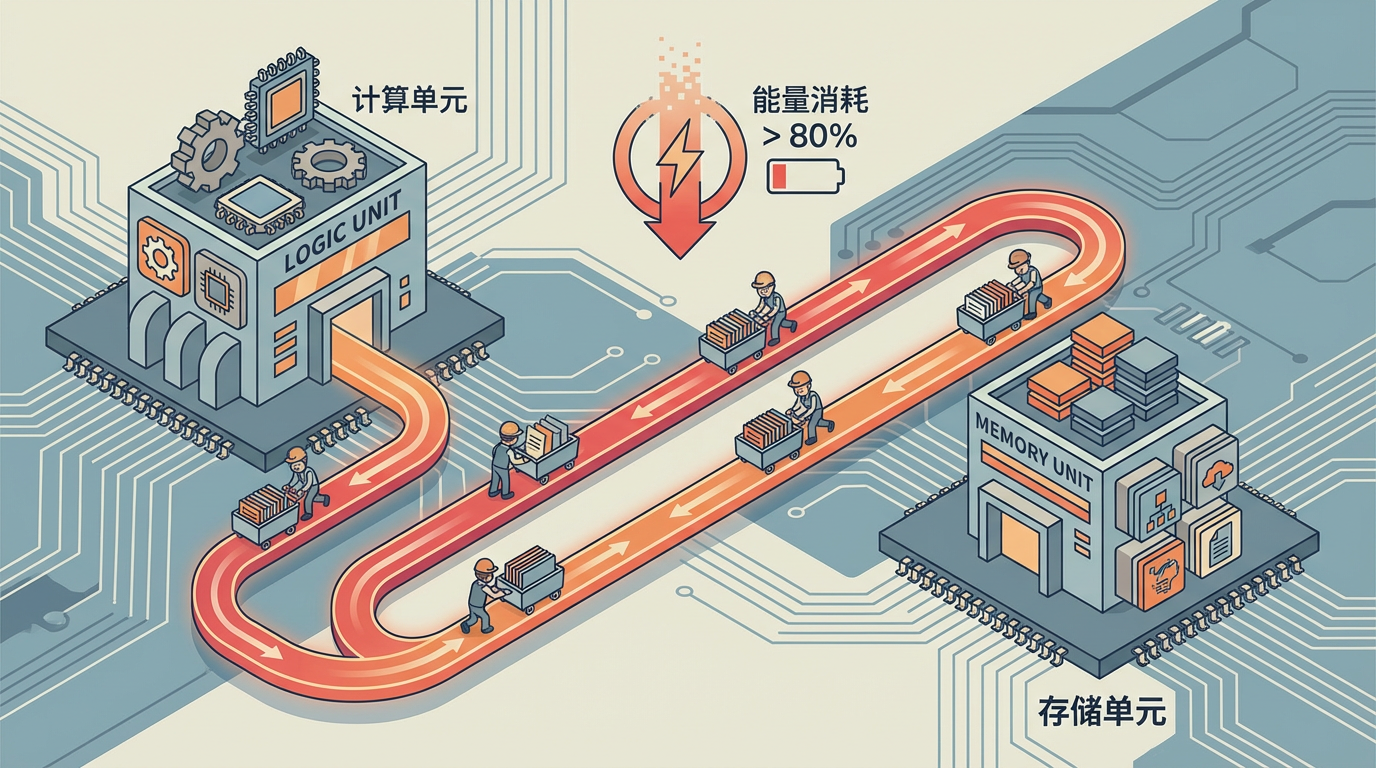

传统芯片中,负责计算的“逻辑单元”和负责存储数据的“存储单元”是分离的。数据在两者之间来回穿梭,就像工人在工厂的仓库和生产线之间疲于奔命,超过80%的能量都消耗在了这趟“通勤”上,而非真正的计算工作。MIT的方案则彻底改变了游戏规则:

“我们必须最大限度地减少未来用于AI和其他数据中心计算的能源,因为它根本不可持续,”该研究的主要作者、MIT博士后研究员Yanjie Shao表示,“我们需要像这样的新技术平台来继续推动进步。”

MIT的突破并非凭空而来,它根植于一场旨在推翻计算机体系结构基石——冯·诺依曼架构的长期革命。自1969年存算一体概念首次被提出,科学家们就梦想着拆除那堵横亘在计算与存储之间的无形之“墙”。

这堵“存储墙”的本质,是数据传输速度远远跟不上处理器的计算速度。现代AI运算对数据带宽的需求高达1PB/s,而最快的存储器也只能提供TB/s级别的带宽,巨大的鸿沟导致了大量的计算资源被闲置,以及惊人的能源浪费。

为了打破这堵墙,业界探索出三条由浅入深的路径:

直到2008年,忆阻器(ReRAM)这种新型存储材料的出现,才让存算一体从理论走向现实。它不仅能存储数据,还能直接执行运算,为这场架构革命注入了关键动力。

随着AI大模型竞赛的白热化,存算一体已从实验室走向产业化的快车道,成为全球科技巨头和初创企业争夺的战略高地。这场竞赛呈现出多元化的技术路径和百花齐放的竞争格局。

这场全球范围内的技术竞赛,不仅关乎商业利益,更可能重塑未来十年全球半导体产业的版图。

尽管前景光明,但堆叠式存算一体芯片要成为AI能耗危机的“终极解药”,仍需翻越多重山丘。

然而,挑战与希望并存。技术的融合正在开辟新的可能性。将存算一体与Chiplet(芯粒技术)、3D封装、乃至光子计算等前沿技术相结合,有望实现系统级的能效飞跃。一颗芯片的功耗或许微不足道,但当全球数百万数据中心都在为此努力时,其汇聚的能量足以点亮一个更绿色、更可持续的智能未来。堆叠式存算一体芯片,或许不是唯一的答案,但它无疑为我们推开了一扇通往未来的希望之门。