对抗知识焦虑,从看懂这条开始

App 下载

印度AI用MoE打破大模型性能效率悖论

Telugu本地化|H100 GPU|105B参数模型|MoE架构|Sarvam AI|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

Telugu本地化|H100 GPU|105B参数模型|MoE架构|Sarvam AI|大语言模型|人工智能

当你在 Vijayawada 的街头用 Telugu 问AI“附近哪里有匹克球场地”时,它能在400毫秒内用当地语言给你报出场地地址、装备预算甚至新手教程——这不是某款国际大厂的专属功能,而是印度Sarvam AI推出的105B参数MoE模型干的事。更离谱的是,这款拥有千亿级参数的模型,推理时只激活不到十分之一的参数,在H100 GPU上的吞吐率比同类模型高3到6倍,甚至能在MacBook上流畅运行。这背后藏着的,正是能打破大模型“性能越高成本越贵”悖论的MoE架构。

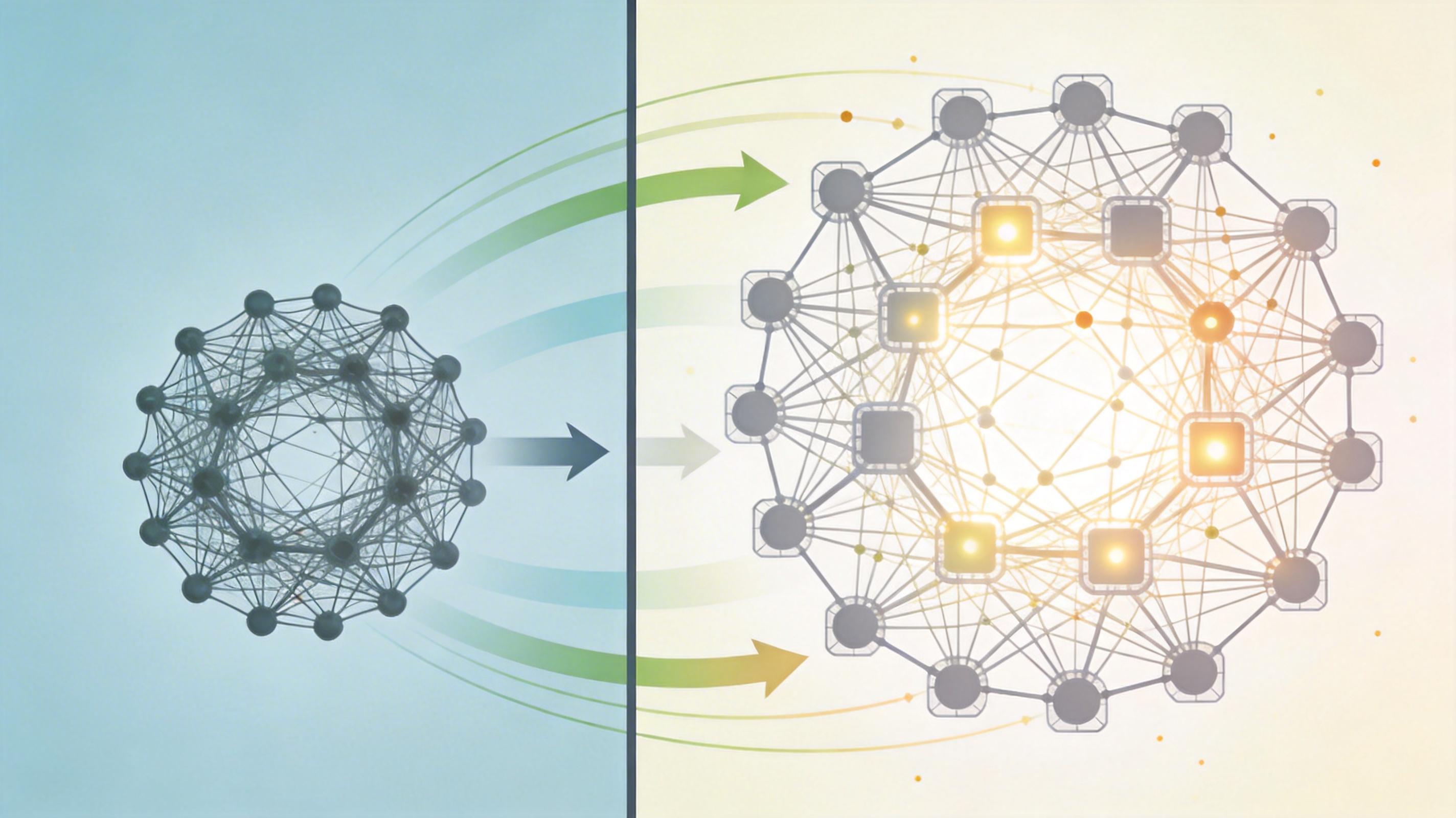

你可以把传统大模型想象成一个什么都懂但什么都不精的全才,处理每一个问题都要动用全部脑子;而MoE(混合专家)架构,则是把这个全才拆成了上百个“专科医生”——每个“专家”只专攻某一类任务,比如有的擅长处理数学推理,有的专门搞定印度语言的语义,还有的对代码生成得心应手。

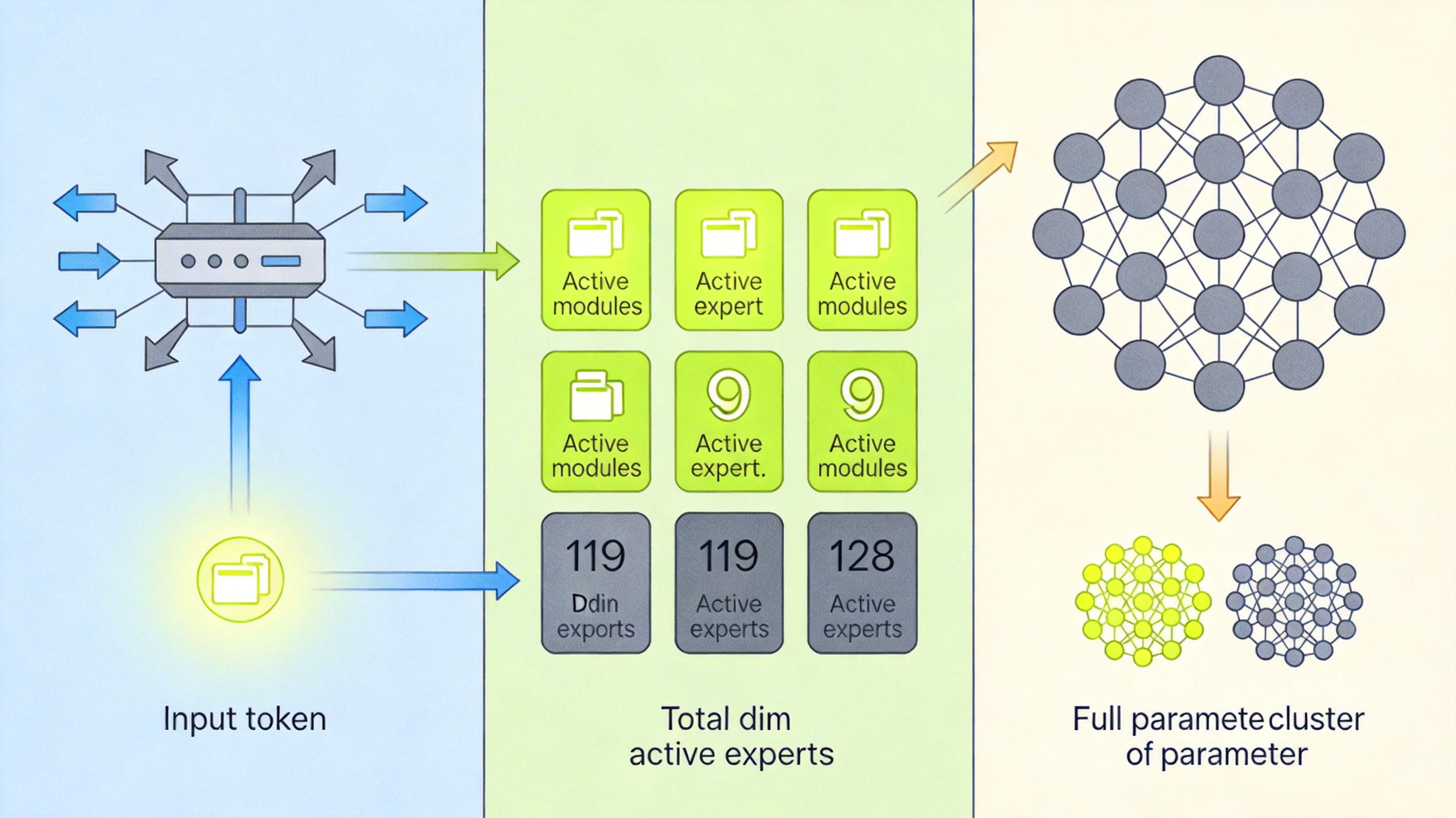

当一个输入token进来时,模型会通过一个“路由器”判断这个问题该找哪几个专家处理,其他没被选中的专家就全程“摸鱼”,不参与计算。比如Sarvam 105B模型有128个专家,但每个token只会激活其中的9个,实际参与计算的参数只有总规模的8.5%。这种“稀疏激活”的魔法,让模型能在保持千亿级参数性能的同时,把推理计算量降到和百亿级密集模型差不多的水平。

和传统密集模型比,MoE的优势是碾压性的:同等计算预算下,MoE模型的参数规模能做到密集模型的10倍以上,数据利用效率提升16.4%,训练时梯度噪声更小,收敛速度更快。Sarvam 105B在AIME数学推理测试中拿到88.3分,用工具辅助后更是冲到96.7分,直接超越了参数规模是它6倍的DeepSeek R1模型。

当然,MoE架构不是凭空就能跑起来的,它的高效背后是一整套从训练到推理的优化手段。

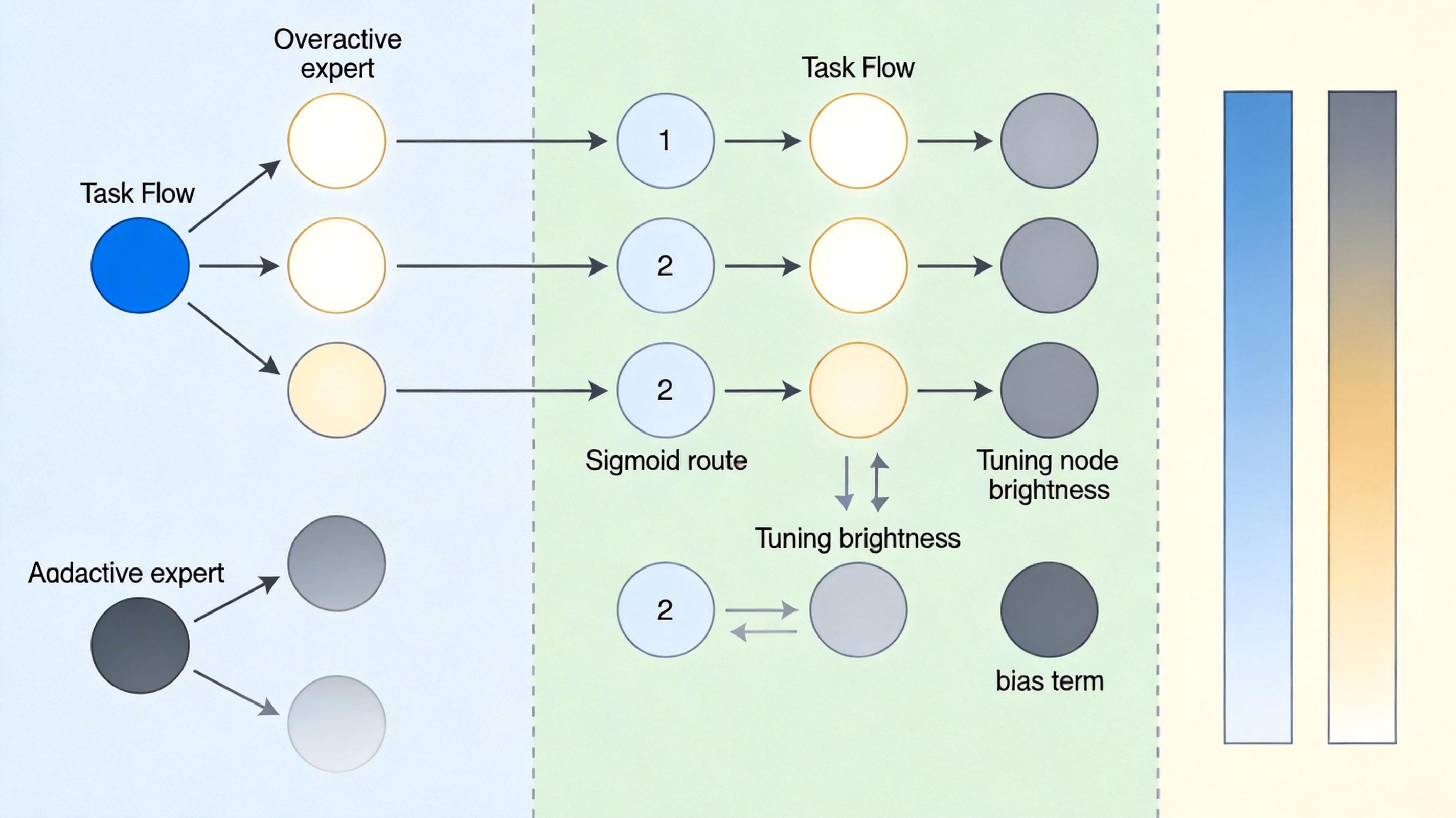

首先是训练阶段的“负载均衡”难题——如果路由器总是偏爱某几个专家,其他专家就会因为没活干而“饿死”,模型性能会大打折扣。Sarvam团队用了两个办法解决这个问题:一是用Sigmoid路由替代传统的Softmax路由,消除专家之间的竞争关系,让每个专家都能均匀分到任务;二是给路由器加了个“专家偏置项”,自动调整每个专家的激活概率,不需要额外的辅助损失就能实现负载均衡。在模拟数据测试中,Sigmoid路由的收敛速度是Softmax的3倍多,Voronoi损失的下降速度快了近4倍。

到了推理阶段,优化的重点是解决动态路由带来的计算不均匀和显存瓶颈。Sarvam团队用了“融合内核”技术,把专家计算的多步操作合并成单个高效内核,减少内存访问和调度开销;还设计了“分离式流水线”,把路由、专家计算和结果组合等步骤并行处理,让GPU的利用率拉满。这些优化让Sarvam 30B模型在H100 GPU上的推理吞吐率比Qwen3基线高3到6倍,在MacBook上也能实现20%到40%的性能提升。

最值得一提的是他们自研的Tokenizer,针对印度22种官方语言优化后,低资源语言的token分割率比主流Tokenizer降低了30%以上,直接减少了推理时的计算负担——毕竟处理的token越少,成本就越低。

MoE架构的价值,最终要体现在实际应用里。Sarvam的两个模型已经在印度的多个场景中跑了起来:30B模型支撑的Samvaad对话平台,每天处理超过1亿次多语言交互,延迟低于500毫秒;105B模型驱动的Indus AI助手,能处理从JEE考试解题到企业财务分析的复杂任务,甚至能帮用户生成完整的Pokédex网页代码。

我认为,Sarvam的成功最值得关注的不是技术本身,而是它找到了大模型在新兴市场的落地路径——用MoE架构解决性能和成本的矛盾,用本地化的数据集和Tokenizer满足多语言需求,用开源的模式撬动本土AI生态。这和国际大厂靠烧钱堆参数的路子完全不同,它证明了大模型不是只有“越大越好”一条路,“足够好且足够便宜”才是更普适的选择。

当然,MoE也不是完美的,它的训练复杂度更高,显存占用也比同规模的密集模型大,路由策略的调优更是个技术活。但从Sarvam的实践来看,这些问题都是可以通过工程优化解决的——毕竟,能真正落地的技术,才是好技术。

当我们还在为大模型的参数竞赛津津乐道时,Sarvam已经用MoE架构悄悄打开了另一扇门。它告诉我们,大模型的未来不是比谁的参数更多,而是比谁能在性能和效率之间找到最精妙的平衡。

“用专家的精准,替代全才的冗余”,这不仅是MoE架构的核心逻辑,也是AI走向普惠的必经之路。当AI不再是少数大厂的奢侈品,而是能在印度的街头、企业的办公室甚至普通人的笔记本上随时待命时,我们才真正迎来了AI的黄金时代。毕竟,技术的终极价值,从来不是突破极限,而是服务于人。