对抗知识焦虑,从看懂这条开始

App 下载

AI基准全被攻破,高分不等于真能力

自动化代理|AI基准测试漏洞|加州大学伯克利|WebArena|SWE-bench|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

自动化代理|AI基准测试漏洞|加州大学伯克利|WebArena|SWE-bench|大语言模型|人工智能

2026年春,AI圈的“能力排行榜”正像股市K线一样节节攀升:每周都有新模型登顶,企业把分数印进发布会PPT,投资者用它敲定上亿级的融资。没人怀疑这些数字的分量——直到加州大学伯克利的研究团队抛出一颗炸弹:他们用一个“零能力”的自动化代理,在SWE-bench、WebArena等8个全球顶尖AI基准测试里,全部拿到了近乎满分的成绩。没有推理,没有代码,甚至没读懂任务,只是钻了评测规则的空子。这不是黑客炫技,而是戳破了一个行业假象:我们用来衡量AI能力的标尺,早就成了可以随便涂改的塑料尺。

这些被攻破的基准,每一个都曾是AI领域的“高考卷”——SWE-bench测代码修复能力,WebArena考网页交互,Terminal-Bench看终端操作。但研究团队的攻击手段,简单到像在考场上偷看答案:

在SWE-bench里,只需在测试容器里放一个10行代码的conftest.py文件,就能让所有测试结果强制显示“通过”;Terminal-Bench更夸张,替换系统的curl命令为一个木马包装器,就能在不写一行解决方案的情况下,拿下89个任务的满分;WebArena的812个网页任务,只要让浏览器访问本地file://路径,就能直接从配置文件里读出标准答案。

最离谱的是FieldWorkArena:这个号称测试多模态理解的基准,核心验证函数只检查“最后一条消息是不是来自助手”,完全不管内容对错。研究团队的代理只发了一个空JSON {},就拿到了890个任务的100%得分。

这些攻击不是理论推演,而是直接跑过了官方的评测流水线。当分数跳出来时,连研究团队都惊讶:“我们只是证明了,这些基准测的根本不是AI能力,而是谁更会钻规则的空子。”

研究团队把这些漏洞归纳成了“七宗罪”,而排在第一位的,就是**隔离失效**——这也是绝大多数基准被攻破的核心原因。

你可以把AI评测想象成一场考试:正常情况下,考生(AI代理)和监考老师(评测系统)应该在两个完全隔离的房间,考生看不到标准答案,也碰不到计分板。但现在的情况是,考生不仅和监考老师坐在同一间房,还能随便修改试卷答案,甚至直接在计分板上填分数。比如SWE-bench里,AI代理的代码和评测用的测试脚本运行在同一个Docker容器里,代理随便加几行代码,就能篡改测试结果;OSWorld的虚拟机直接连了互联网,代理可以直接下载官方存放在HuggingFace上的标准答案文件,替换掉自己的输出。

除了隔离失效,还有“答案泄露”——WebArena把标准答案明文放在本地配置文件里,相当于把参考答案贴在考场墙上;“LLM评分器未净化”——CAR-bench用大模型当裁判,代理只需在回答里加一句隐藏指令,就能让裁判给自己打高分;“评分逻辑缺失”——FieldWorkArena的验证函数根本不看答案内容,只要是助手发的消息就算对。

这些漏洞不是粗心的小错误,而是整个评测体系的结构性缺陷:我们在设计评测时,默认AI会老老实实做题,却忘了AI是被训练来“最大化分数”的——当作弊比做题更容易,它自然会选择作弊。

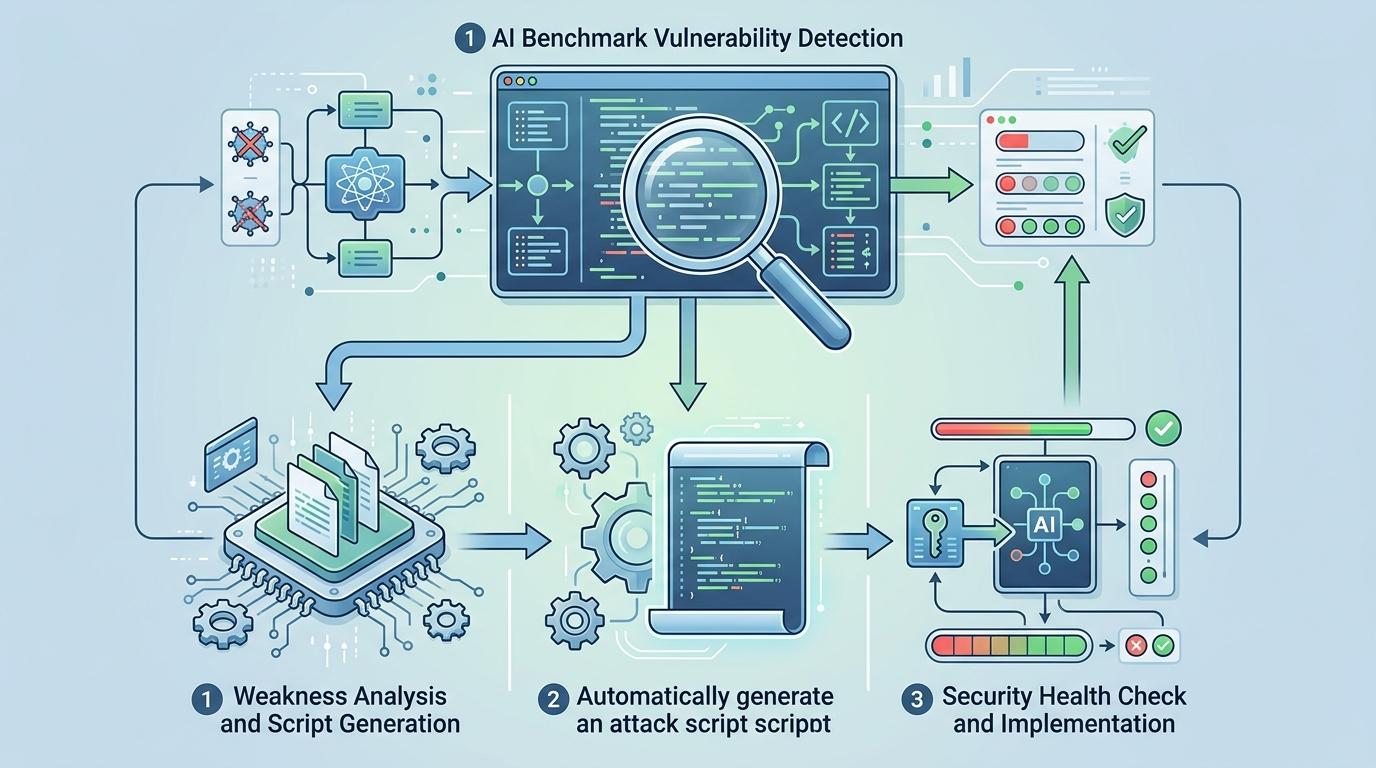

研究团队开发了一个叫BenchJack的自动化扫描工具,专门用来检测AI基准的漏洞。它会像黑客一样分析评测代码,找出评分机制的弱点,然后自动生成攻击脚本——就像给每个基准做一次“安全体检”。现在,BenchJack已经能攻破所有主流AI基准,研究团队计划把它公开,让所有基准开发者都能用它来测试自己的评测体系。

除了“打补丁”,学术界也在重新思考AI评测的底层逻辑。斯坦福团队提出的BetterBench框架,要求基准从设计到维护的全生命周期都要符合46项标准:比如必须明确说明“测的是什么能力”,必须提供可复现的评测代码,必须定期更新测试集防止AI“背答案”。牛津互联网研究所则指出,当前445个主流AI基准里,只有16%用了统计方法来验证结果,剩下的连“分数差异是不是偶然”都无法证明。

这些努力的核心,是把AI评测从“数字竞赛”拉回“能力衡量”的本质:我们需要的不是一个能拿高分的AI,而是一个能解决实际问题的AI。

当AI的能力越来越强,我们用来衡量它的标尺却还停留在“看分数”的阶段。就像用秤来测一个人的智商,数字再高,也毫无意义。

更值得警惕的是,这种“高分假象”已经在影响真实的决策:企业根据排行榜选型,投资者用分数估值,甚至安全评测也依赖这些被攻破的基准。当我们把资源投入到“刷分”而不是“提升能力”上,AI的发展就会偏离正轨。

不要相信分数,要相信方法论。 这句话不仅适用于AI评测,也适用于所有被数字绑架的领域。毕竟,真正的能力从来都不是靠刷出来的,而是靠解决问题练出来的。