对抗知识焦虑,从看懂这条开始

App 下载

24万次重复的GIF,撞破了备份系统的天花板

数据去重|GIF动图|硬链接技术|重复文件存储|社区平台备份|软件工程|前沿科技

对抗知识焦虑,从看懂这条开始

App 下载

数据去重|GIF动图|硬链接技术|重复文件存储|社区平台备份|软件工程|前沿科技

2026年初,某大型社区平台的备份系统濒临崩溃:600GB的用户上传数据,备份时硬生生撑爆了磁盘。技术团队排查后发现了更离谱的数字——432GB的上传文件里,真正独一无二的内容只有26GB,剩下的全是重复文件。其中一张《老友记》里Rachel跳舞的GIF,被用户在私信、帖子、不同权限的板块里反复转发,系统为了安全隔离,给它生成了246173个不同的文件名。单这张1.6MB的动图,就凭空造出了377GB的备份垃圾。所有人都以为找到了解决方案,直到这个方案撞上了一个没人预料到的隐形天花板。

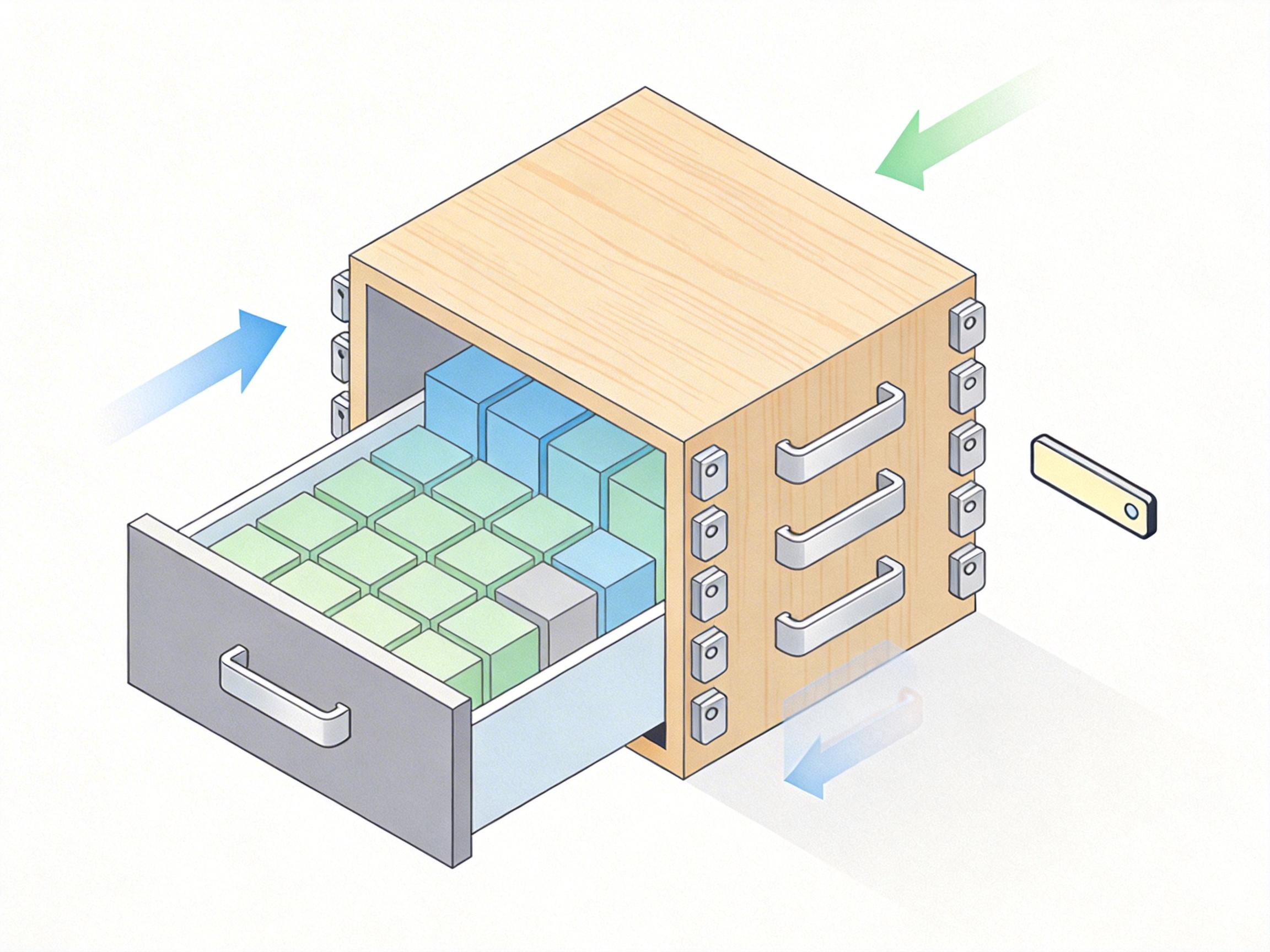

要理解这个方案,得先搞懂硬链接(hardlink)——你可以把它想象成给同一个抽屉贴了24万个不同的标签,每个标签都能打开同一个抽屉,但抽屉本身只有一个。和快捷方式(软链接)不同,硬链接是文件系统层面的直接映射:所有指向同一内容的硬链接,共享同一个数据块和inode(文件系统用来记录文件信息的“身份证”),修改其中任何一个,其他所有链接都会同步变化;删除一个标签,只要还有其他标签存在,抽屉里的东西就不会消失。

技术团队的思路很直接:备份时先按文件内容的哈希值分组,同一组里只下载第一个文件,其他重复文件全部用硬链接代替。这个方案理论上能把备份体积从432GB压缩到26GB,下载次数从24万次降到1次。测试环境里一切顺利,所有用例都通过了——直到有人把它推上了生产环境。

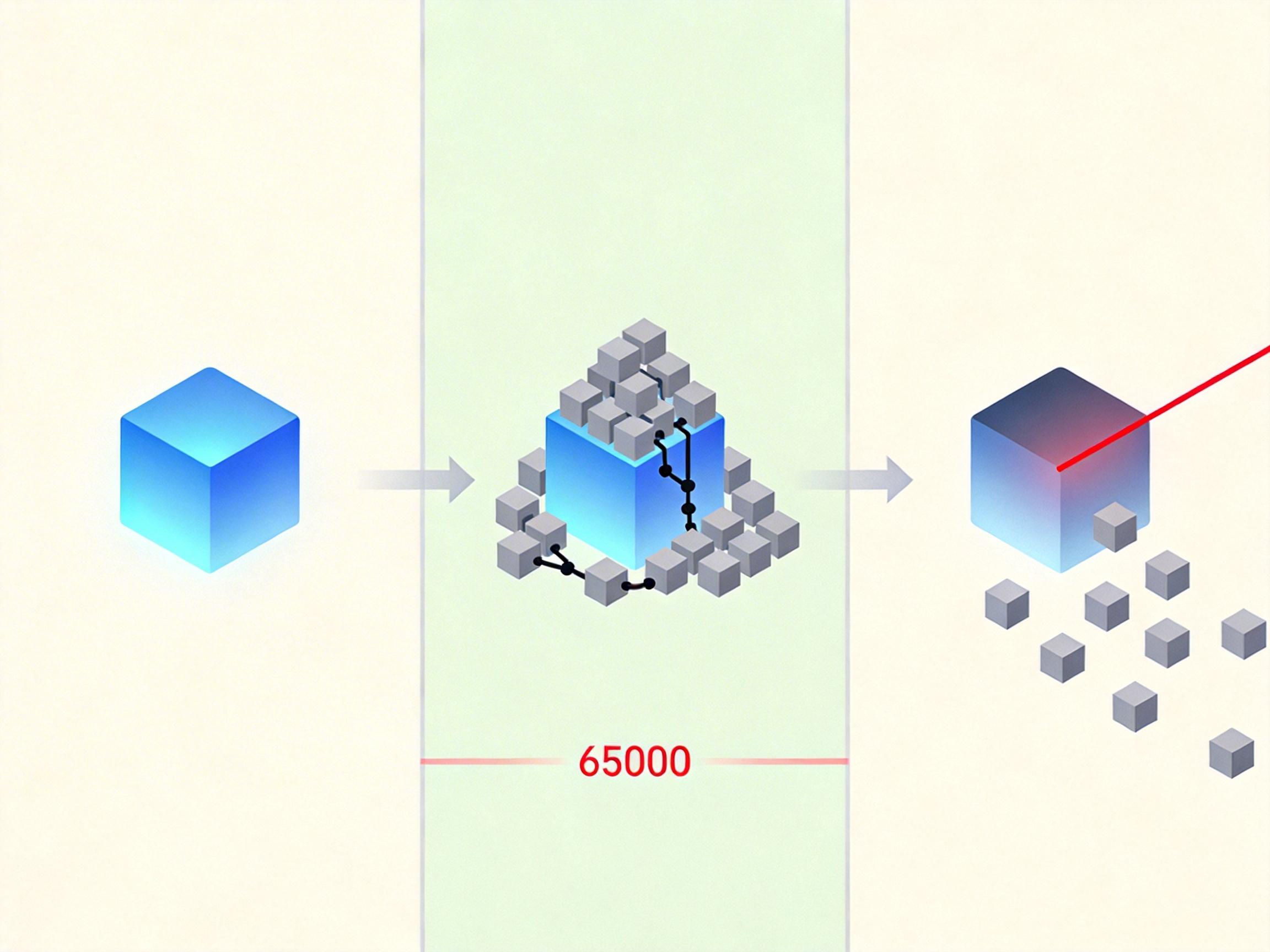

问题出在那个被重复24万次的GIF上。当硬链接数加到第65001个时,系统报错了。

这个报错指向了一个大多数人都不知道的规则:ext4文件系统对单个inode的硬链接数有严格限制——最多65000个。

这个限制不是拍脑袋定的。ext4的inode结构里,记录硬链接数的是一个16位的无符号整数,理论上限是65535,但内核开发者特意把它降到了65000,用来防止某些恶意程序或bug通过创建无限多的硬链接拖垮系统。这个设计初衷是为了安全,却在大规模备份场景下成了致命瓶颈。

当硬链接数触碰到65000的上限时,备份脚本只能退而求其次:不再创建硬链接,而是重新下载整个文件。结果就是,原本只需要1次的下载,变成了4次——每用满65000个硬链接,就复制一份原文件,再用新的文件作为“主文件”继续创建硬链接。虽然还是比24万次下载好得多,但显然不是最优解。

更麻烦的是,不同文件系统的硬链接上限天差地别:XFS支持数十亿个,BTRFS只有255个,ZFS干脆用快照机制替代了硬链接。如果备份系统只盯着ext4的规则做优化,换个文件系统照样出问题。

技术团队最终的解决方案,是放弃预判文件系统的限制,转而让系统自己“感知”边界:当创建硬链接触发<a class="wiki-keyword" data-keyword="Errno::EMLINK" href="#">Errno::EMLINK</a>错误时,就自动复制一份已下载的文件,用这个副本作为新的主文件,继续为后续的重复文件创建硬链接。

这个方案的聪明之处在于,它不依赖任何特定文件系统的规则,而是把判断权完全交给底层系统——不管你是ext4的65000,还是XFS的数十亿,系统说不行了,就立刻切换策略。这种“ graceful degradation(优雅降级)”的思路,成了整个优化的关键:虽然没能实现16倍的完美压缩,但至少保证了备份不会失败,同时还能节省90%以上的存储空间和带宽。

这件事也暴露了一个容易被忽略的问题:很多系统优化只盯着“最优解”,却忘了给极端情况留后路。在这个案例里,如果备份脚本没有设置“创建失败就下载”的 fallback,当硬链接数触顶时,整个备份就会直接崩溃。而那个24万次重复的GIF,就是那个考验系统韧性的“极端试金石”。

当我们谈论技术优化时,总习惯盯着“效率提升了多少”“成本降低了多少”,却常常忘记,任何技术都不是孤立存在的——它要和底层的硬件、文件系统、甚至用户的使用习惯博弈。那个24万次重复的GIF,本质上是用户行为、系统安全设计和文件系统规则三者碰撞出的极端产物。

最优解的背面,永远是对边界的敬畏。

在数据量爆炸的今天,我们会遇到越来越多这样的“极端案例”:可能是一张被转发百万次的图片,可能是一个被复制上亿次的表情包,也可能是一个被无数AI模型反复调用的数据集。真正可靠的系统,从来不是在实验室里跑出来的,而是在一次又一次的边界碰撞中,学会了如何给自己留一条后路。