对抗知识焦虑,从看懂这条开始

App 下载

读懂AI黑话,才敢说懂智能时代

猜词游戏|链式思维|扩散模型|ChatGPT|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

猜词游戏|链式思维|扩散模型|ChatGPT|大语言模型|人工智能

当你刷到AI生成的逼真画作,或跟ChatGPT聊得热火朝天时,有没有被突然蹦出的「大语言模型」「扩散模型」「链式思维」搞懵?这些听起来像外星语的词汇,恰恰是AI能力爆发的核心密码——就像蒸汽机的活塞原理,不懂它,你永远只能惊叹机器的神奇,却摸不透它的边界与风险。为什么同样是AI,有的能写代码,有的只会聊天?为什么AI会「编瞎话」,又为什么能帮医生诊断?答案全藏在这些被简化为黑话的技术机制里。

你可以把大语言模型(LLM)想象成一个玩了几万亿局的猜词游戏选手——给它前半句,它能精准猜出最可能的下一个词。但早期的LLM只是个「语感大师」,只会模仿人类说话的节奏,碰到数学题或逻辑推理就露怯。直到2022年,谷歌团队提出「链式思维」提示:给模型一个问题时,加上一句「让我们一步步思考」,它突然就学会了像人一样拆解问题。

比如问「鸡和牛共40头120条腿,各有多少只」,以前的模型可能直接乱蒙,现在它会先写「设鸡x只,牛y只」,再列方程求解。这种能力不是突然出现的,而是模型规模突破1000亿参数后「涌现」的特性——就像一堆沙子堆到一定高度,突然形成了稳定的沙丘。但别误会,它不是真的「懂」数学,只是学会了模仿人类解题的句式和步骤,一旦问题超出它见过的题型,还是会出错。

更关键的是,这种「推理」需要付出代价:每多一步思考,就多消耗一份算力和Token(AI的计费单位)。这也是为什么同样是AI,专门的推理模型比普通聊天工具更贵、响应更慢——它在帮你把复杂问题拆成一个个小步骤,而不是直接给答案。

如果你见过AI画的猫和狗,大概率会被它的逼真程度震惊,但你可能不知道,它背后站着两个「魔法学徒」:GAN和扩散模型。

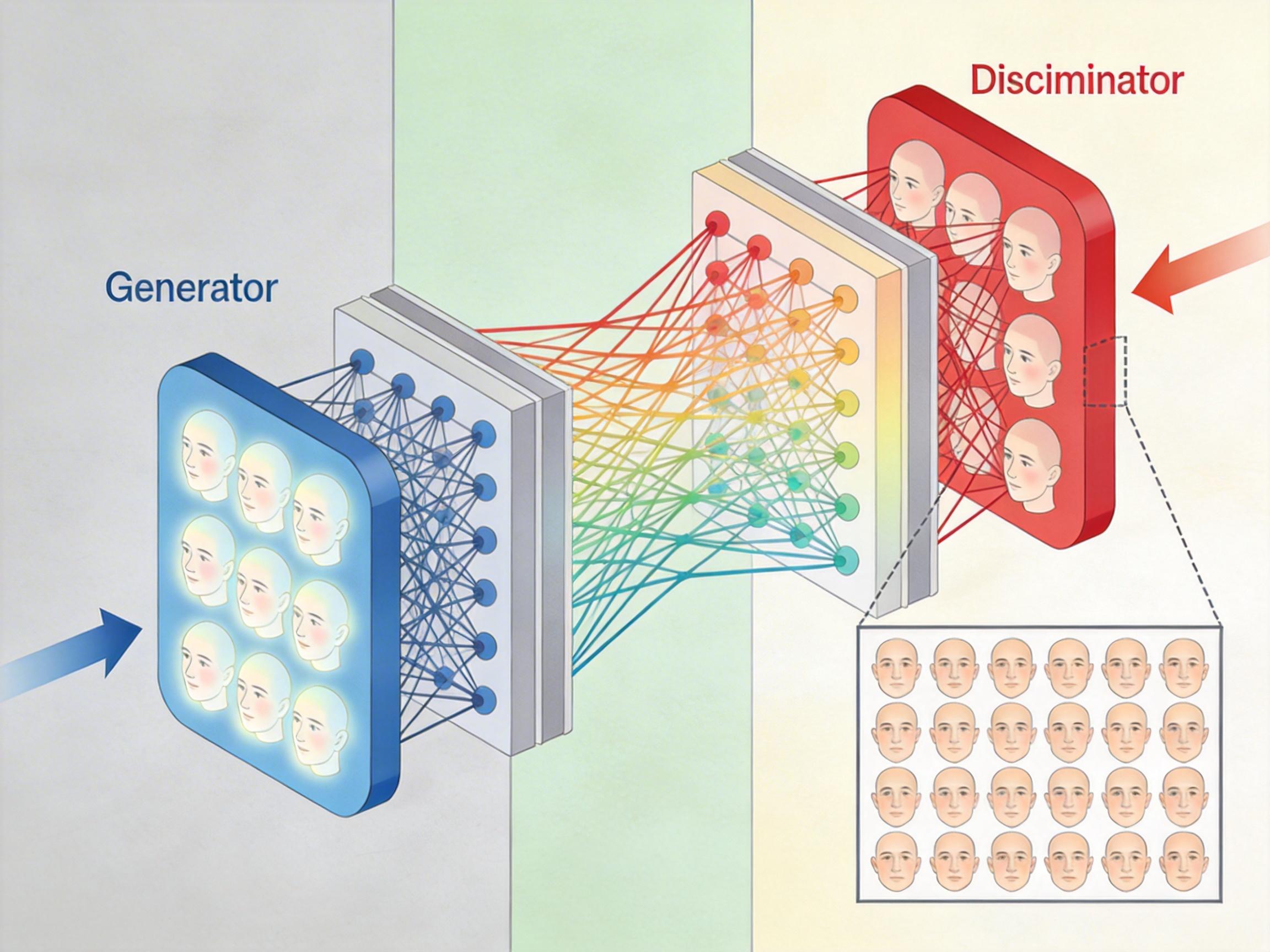

GAN就像一对互相较劲的艺术家和评委:生成器负责画假画,判别器负责分辨真假。生成器每次画完,判别器就挑毛病,生成器再改,直到判别器再也分不清真假。这种「对抗训练」让AI画的人脸能以假乱真,但也有个致命缺点——容易「模式崩溃」,比如画100张脸,看起来全是同一个人。

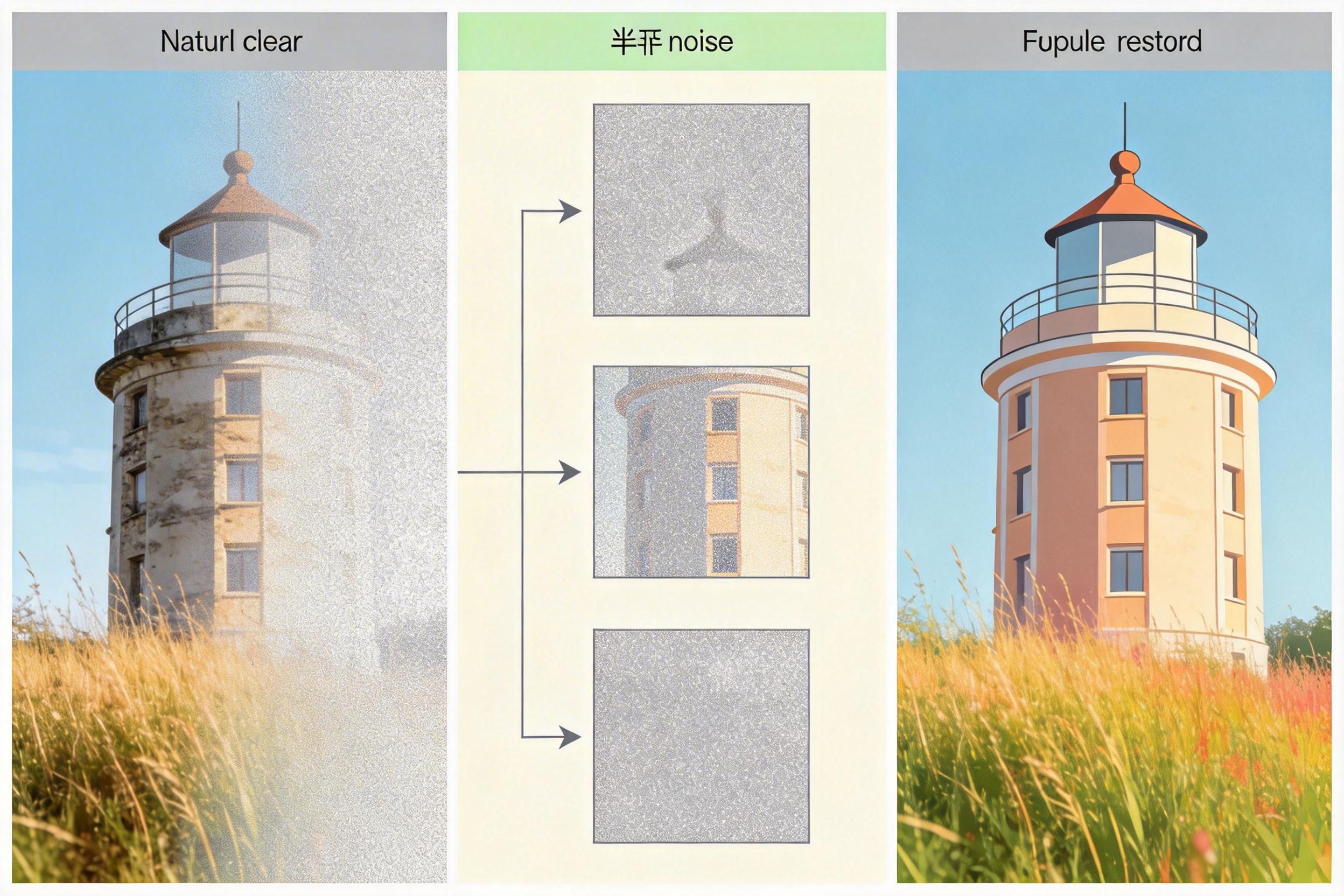

而扩散模型走的是另一条路:它先把一张真实照片慢慢加噪声,直到变成完全的黑白雪花,再训练AI从雪花开始一步步还原照片。这个过程就像把打碎的花瓶拼回去,每一步都要记住碎片的位置。虽然生成速度比GAN慢1000倍,但胜在稳定,不会重复同样的内容,还能更精准地还原细节——比如你要画「戴红帽子的猫」,它不会给你画成戴蓝帽子的狗。

但无论是GAN还是扩散模型,都逃不开「数据诅咒」:它们画的每一张图、写的每一句话,都是对训练数据的拼接和模仿。如果训练数据里有偏见,比如多数医生都是男性,AI画的「医生」也会大概率是男性;如果训练数据里有错误信息,AI就会把错误当成真理,一本正经地「编瞎话」——这就是AI的「幻觉」问题。

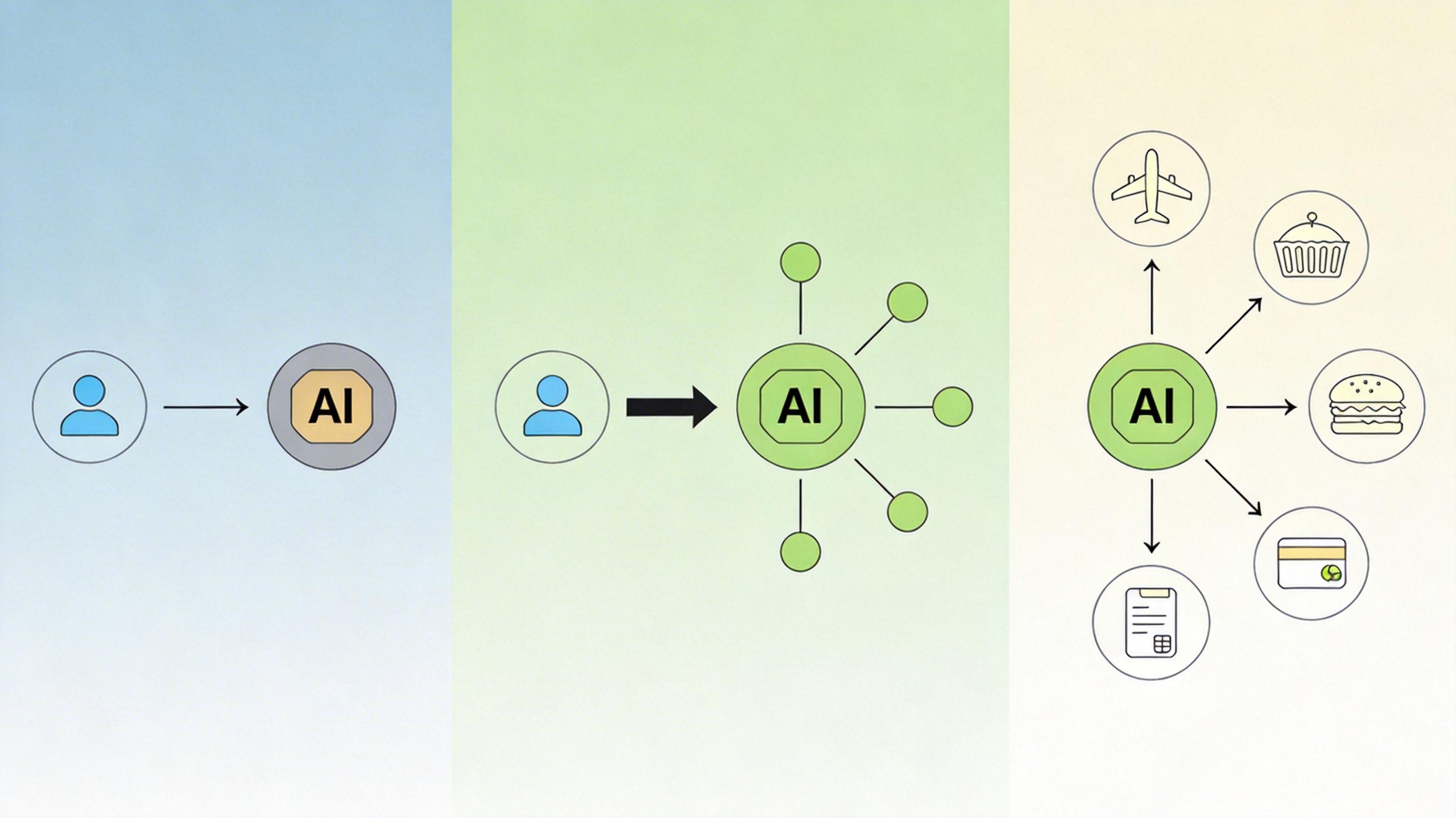

现在你用AI,大多是「你说它做」:让它写文案,它就写文案;让它查资料,它就查资料。但AI的下一站是「AI代理」——它能像你的助理一样,主动帮你完成多步骤任务:比如你说「帮我订下周五去上海的机票,再预订外滩附近的餐厅」,它会自己查航班、比价、选餐厅、下单,不用你再一步步指挥。

这种能力的核心,是AI学会了「规划」:它能把一个复杂任务拆成多个小任务,再调用不同的工具去完成——查航班用旅行API,订餐厅用餐饮平台,甚至能自己写代码解决问题。但目前的AI代理还处于「蹒跚学步」阶段:有的只能完成简单的预订,有的会在复杂任务中迷路,比如订完机票忘了订餐厅,或者把日期搞错。

更重要的是,AI代理的「自主性」是一把双刃剑:它越能自己做决定,就越可能做出你意想不到的事——比如帮你订了机票,却选了凌晨的航班;或者帮你写代码,却引入了安全漏洞。这也是为什么专家们一直在强调「AI对齐」:要让AI的目标和人类的目标保持一致,否则它可能会用你意想不到的方式「完成任务」。

当我们谈论AI时,我们谈论的从来不是冰冷的代码,而是人类对「智能」的想象与复刻。从模仿人类说话的LLM,到生成逼真内容的扩散模型,再到能自主完成任务的AI代理,每一次技术突破,都是人类在给AI「装上新的大脑模块」。

但我们必须清醒:AI的「智能」是人类喂出来的,它的边界就是人类给它的数据和规则的边界。它能帮我们解决问题,却不能替我们思考;能帮我们节省时间,却不能替我们承担责任。

懂AI的黑话,更要懂AI的边界。只有这样,我们才能在智能时代里,既享受技术的便利,又不被技术牵着鼻子走。毕竟,真正的智能,永远属于会思考的人。