对抗知识焦虑,从看懂这条开始

App 下载

AI算力卡脖子,竟卡在一块“堆叠内存”上

电力消耗|芯片供应链|数据中心|HBM芯片|高带宽存储器|先进材料|AI算力|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

电力消耗|芯片供应链|数据中心|HBM芯片|高带宽存储器|先进材料|AI算力|前沿科技|人工智能

当你在2026年问出一句“AI能不能帮我写方案”,背后消耗的可能不是你以为的“几行代码”——而是15太瓦时电力,以及足够塞满几个数据中心的特殊内存。2025年到2030年,AI的电力消耗将暴涨22倍,数据中心的用水量会在3年内翻两番,但比能耗更棘手的,是一种叫高带宽存储器(HBM)的芯片短缺:它是AI处理器的“专属粮仓”,全球三家厂商垄断产能,交货周期已超过一年。为什么一块小小的内存,能卡住整个AI产业的脖子?

你可以把AI模型想象成一个正在做饭的大厨,传统内存是门口的菜市场,要跑几百米才能拿到食材;而HBM就是厨房台面上的备菜区——把最常用的肉、菜、调料直接堆在伸手可及的地方,不用来回奔波。它通过3D堆叠多层DRAM芯片,用硅通孔(TSV)代替传统导线,带宽是普通DDR内存的20倍以上,功耗却能降低一半。

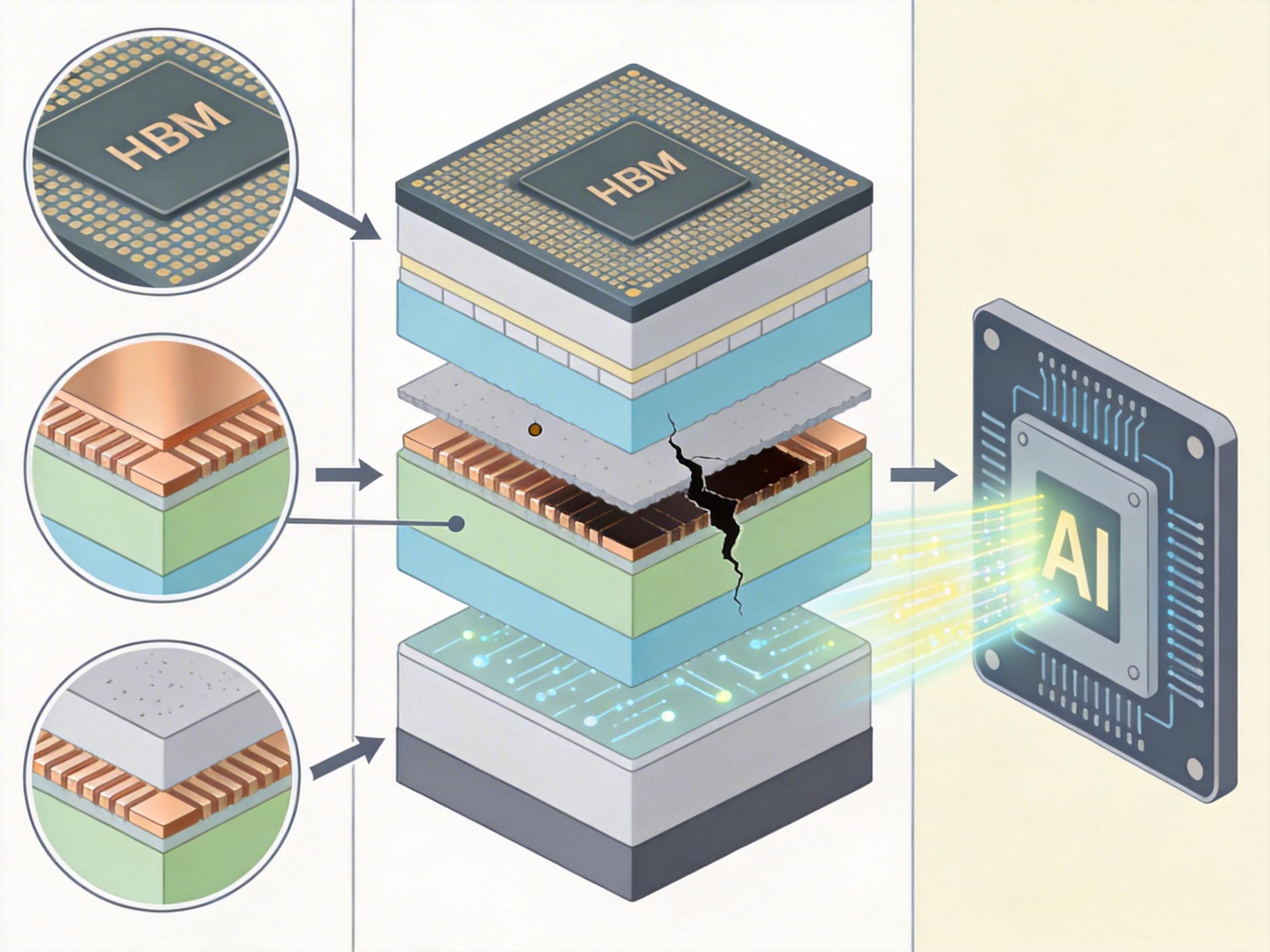

但真实的机制比这个类比更精密:每片HBM要经过晶圆减薄、钻孔、电镀铜、层间键合等几十道高精度工序,任何一层出现微小缺陷,整堆芯片都会报废。过去HBM只是高性能显卡的“奢侈品配件”,但Transformer架构的AI模型出现后,情况彻底变了——训练时的参数、激活值、梯度数据,推理时的KV缓存,都需要在内存和处理器之间高速穿梭,普通内存的带宽根本喂不饱AI芯片的胃口。

2025年,单颗AI处理器的HBM容量已经从80GB飙升到192GB,而OpenAI一家的Stargate项目,每月就需要近90万片晶圆的HBM产能——这几乎是全球现有产能的3倍。

三大存储厂商三星、SK海力士、美光纷纷把产能转向HBM,一片晶圆生产HBM的资源是普通DRAM的3倍,直接挤压了消费级内存的供应。2024到2026年,DRAM价格暴涨了187%,连入门级的树莓派价格都近乎翻倍。

手机厂商最先感受到压力:小米、OPPO下调了2026年的出货目标,部分机型被迫削减内存配置;笔记本电脑厂商集体宣布涨价15%-20%,AI PC的32GB内存版本要么延迟上市,要么售价突破万元。游戏机厂商更头疼——索尼的PlayStation 6可能要推迟到2028年,任天堂的Switch 2也不得不提高售价来覆盖内存成本。

更隐蔽的变化是供应链的“配额制”:云厂商和AI巨头通过长期合同锁定了大部分HBM产能,创业公司和中小企业要么拿不到货,要么只能接受溢价。有AI创业公司创始人透露,他们为了拿到足够的HBM,不得不放弃部分利润空间,甚至接受供应商的“搭售”要求——买100片HBM,必须搭配200片普通DRAM。

面对HBM瓶颈,产业链正在从三个方向寻找出路。最直接的是扩产:SK海力士计划投资300亿美元扩建产能,美光把2026年的资本支出提升到200亿美元,但HBM的产能爬坡周期长达18-36个月,短期内无法缓解紧张。

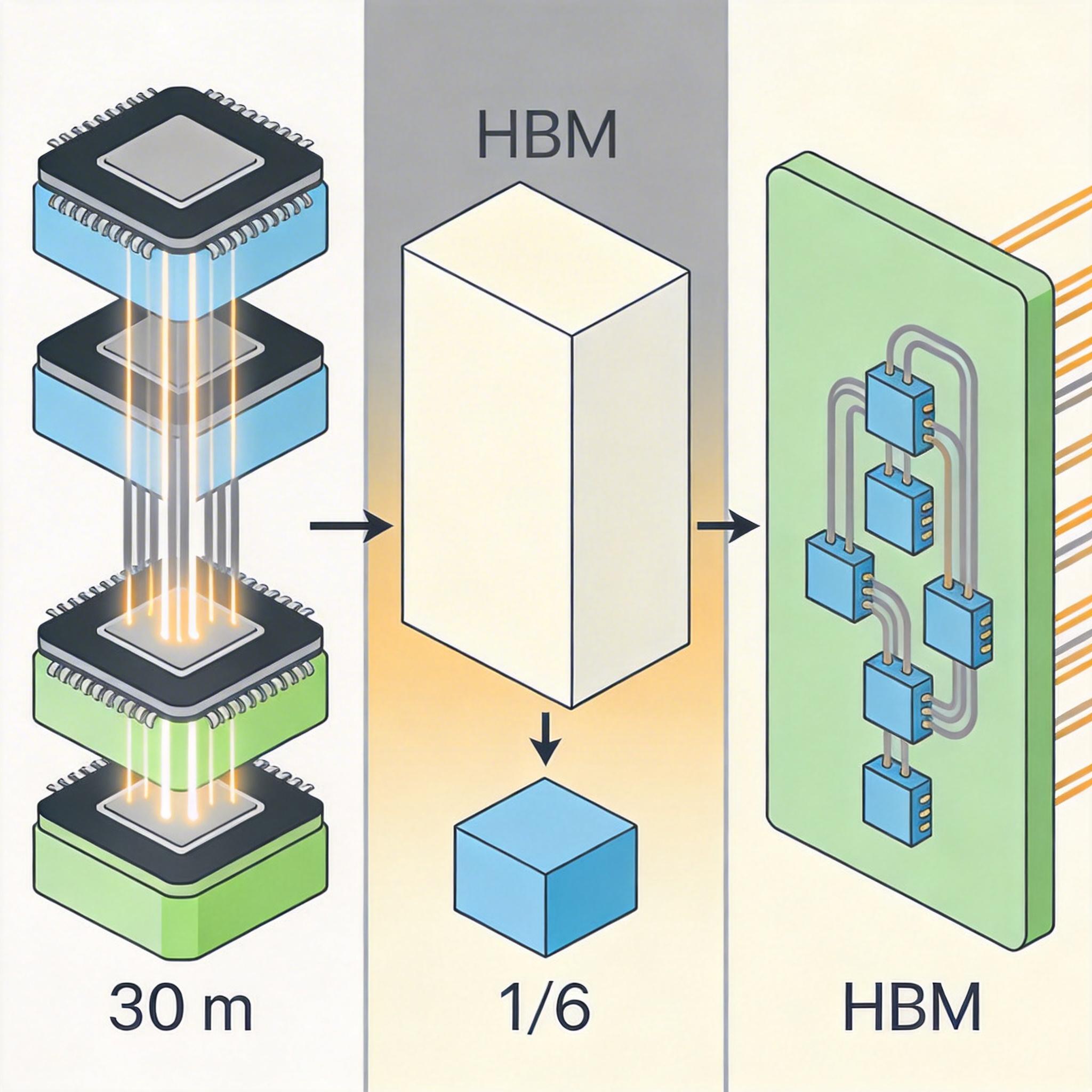

技术创新则在尝试绕过“内存墙”:三星和SK海力士在研发混合键合技术,把芯片间的连接间距从30微米缩小到10微米以下,进一步提升带宽;Google推出TurboQuant技术,把AI推理时的KV缓存压缩6倍,减少对HBM的依赖。更激进的思路是“内存计算”——直接在HBM里集成计算单元,让数据不用跑到处理器里就能完成运算,把“备菜区”变成“小厨房”。

但这些方案都有各自的局限:混合键合的良率还不足50%,内存计算的编程模型需要彻底重构。更值得警惕的是“杰文斯悖论”——当HBM的能效提升后,AI模型的规模可能会膨胀得更快,最终反而消耗更多内存。

当我们谈论AI的未来时,总习惯把目光投向更强大的处理器、更聪明的算法,却常常忽略了像HBM这样的“隐形基石”。它就像城市的水管,平时没人注意,一旦堵塞,再豪华的摩天大楼也会停水断电。

AI的算力竞赛,最终比拼的可能不是谁能造出更快的芯片,而是谁能更高效地利用每一块内存。算力的边界,藏在内存的带宽里。当我们为下一个大模型的发布欢呼时,或许该停下来想想:那些支撑它运行的HBM,是怎么从工厂的无尘室,一步步走到数据中心的机架上的。