20 天前

20 天前

当你在Mac上敲完一段代码提问,看着加载圈转了5秒才跳出第一个字时,大概不会想到——这个延迟的根源,不是芯片不够强,而是数据在CPU和GPU之间跑错了路。2026年3月,Ollama宣布接入苹果MLX框架后,M5 Max上Qwen3.5-35B模型的首token生成速度直接快了3倍,每秒能输出134个token。这不是芯片突然超频,而是一套被藏了3年的内存逻辑,终于被用到了刀刃上。为什么换个框架就能让老Mac的AI速度翻倍?这得从苹果芯片最被低估的设计说起。

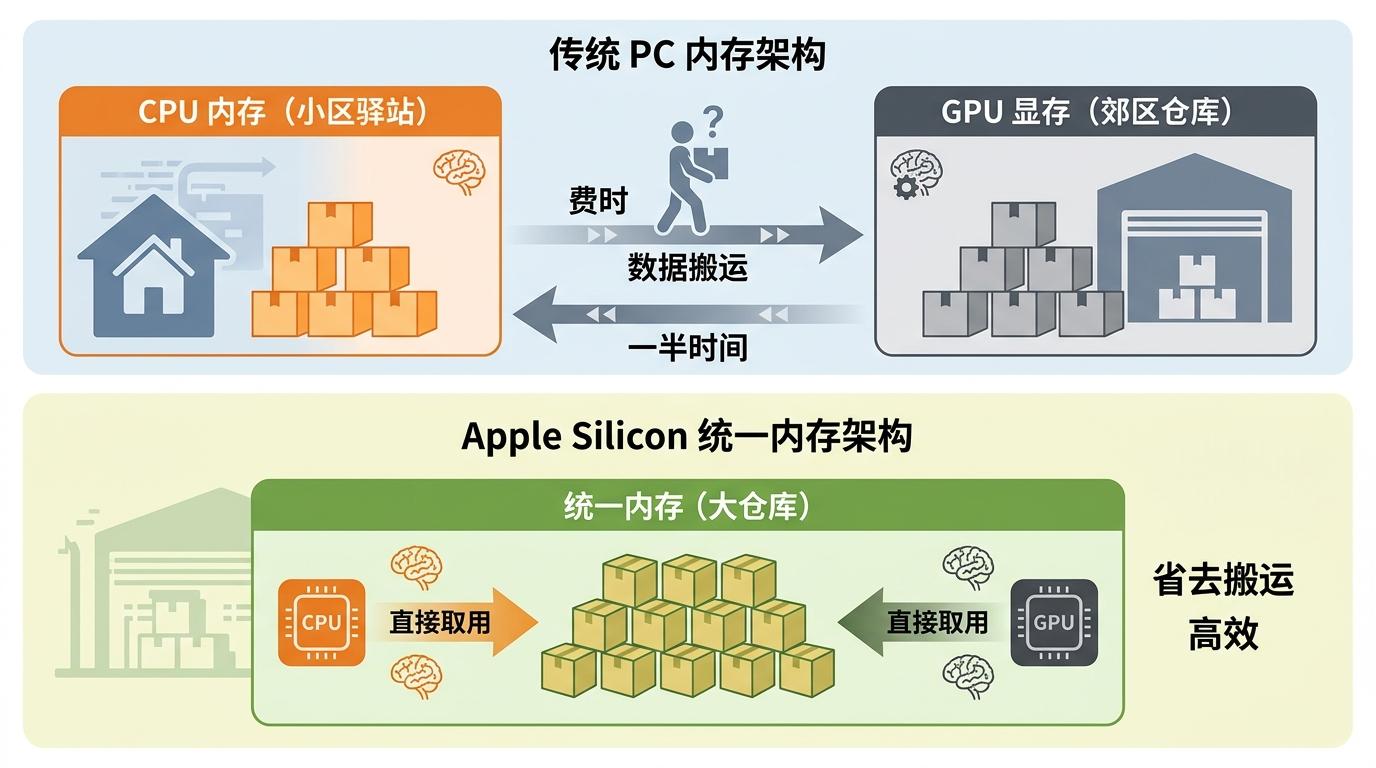

你可以把传统PC的内存结构想象成两套独立的快递站——CPU的内存是小区驿站,GPU的显存是郊区仓库,每次AI计算都要把数据从驿站搬到仓库,算完再搬回来,光赶路就耗掉一半时间。而Apple Silicon的统一内存架构,是把两个快递站合并成一个大仓库,CPU和GPU随时能取到同一份数据,彻底省掉了搬运的功夫。

MLX就是为这套仓库逻辑量身定做的框架。它的数组天生就存放在共享内存里,不需要开发者手动写代码拷贝数据,CPU算到一半的任务,能直接扔给GPU接着算。对比之前Ollama用的传统框架,光是省掉数据拷贝这一步,就能让大模型的预填充速度提升2倍以上。

但真实的机制比这更精确:MLX还加入了「延迟计算」——就像快递站攒够一批件再送,它会把多个计算任务打包成一个整体,一次性交给GPU处理,进一步减少了硬件切换的开销。在M5 Max上,这种打包处理让35B模型的预填充速度冲到了1851 tokens/s,相当于一秒钟能读完3篇短文。

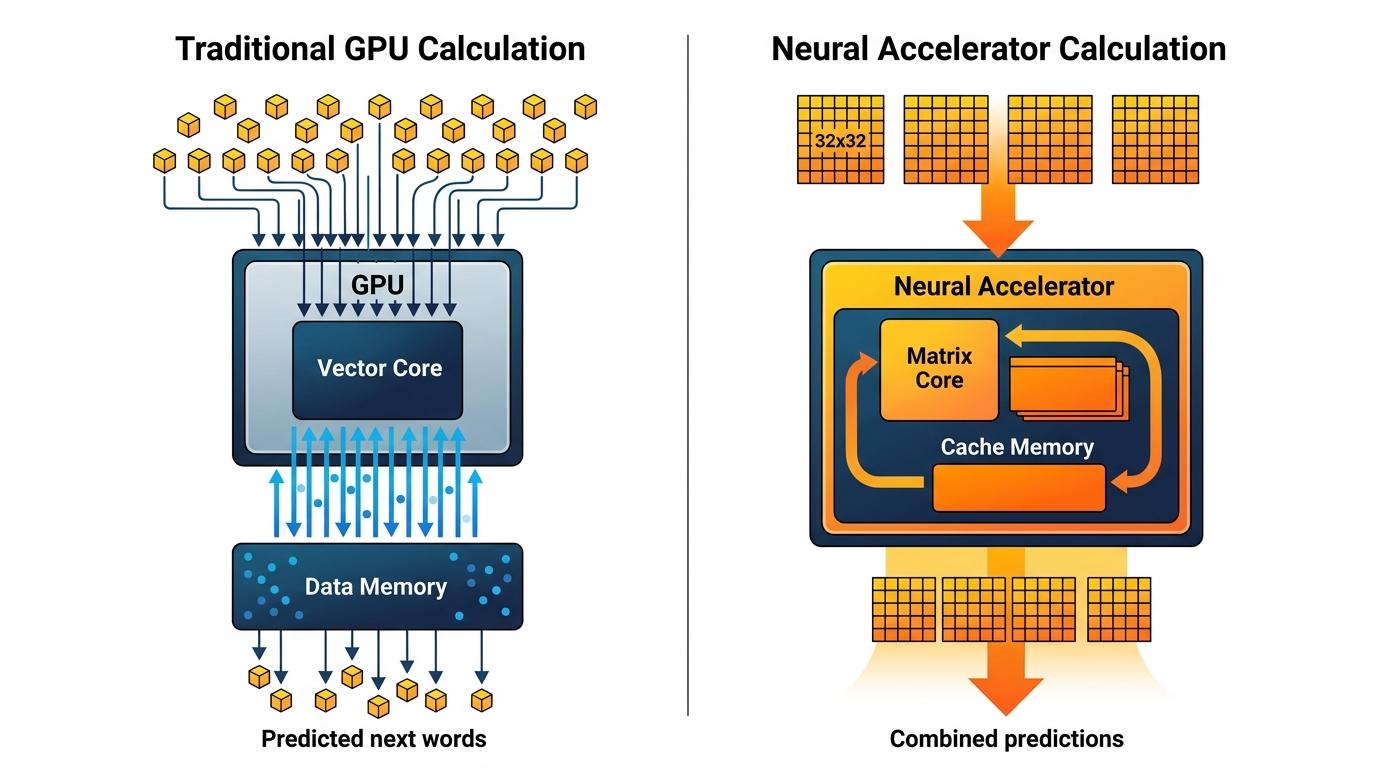

如果说统一内存解决了数据的「路」的问题,那M5系列芯片里的神经加速器,就是给AI最核心的工作——矩阵乘法,修了一条专用高速路。

大语言模型生成文本的本质,就是做无数次矩阵乘法:把每个字的向量和模型里的权重矩阵相乘,算出下一个字的概率。传统GPU用向量核心做乘法,就像用铁锹挖土方,一锹一锹慢且费力;而神经加速器是用挖掘机,直接把32×32的矩阵块整个塞进硬件里计算,还能把中间结果存在核心内部的缓存里,不用反复去内存里取数据。

MLX框架能直接调用这些神经加速器的接口,不需要经过任何中间层。测试显示,在M5上跑Qwen3.5-35B模型时,神经加速器让解码阶段的速度提升了20%——别小看这20%,当你和AI聊半小时天,它能帮你省下近10分钟的等待时间。

更关键的是,MLX支持NVIDIA的NVFP4量化格式。你可以把量化理解成给照片压缩:普通压缩会模糊细节,但NVFP4只压缩那些不影响画质的像素点,既能把模型体积缩小一半,又能保持和云端一样的回答质量。这意味着你在Mac上跑的模型,和企业服务器上的模型能输出完全相同的结果。

你可能有过这种体验:和AI聊到第三轮,它突然卡了一下——这是因为它要重新计算前两轮的对话上下文。而Ollama接入MLX后,升级了一套「智能缓存」系统,彻底解决了这个问题。

这套缓存就像你手机里的聊天记录:它会把对话里重复的前缀(比如你每次提问都加的「请用代码解释」)存在缓存里,下次再聊类似的话题,直接调用缓存里的结果,不用重新计算。MLX的统一内存让缓存能被CPU和GPU同时访问,不需要再做一次拷贝,进一步加快了响应速度。

在多分支对话场景下,比如你让AI写代码,然后又让它改三种不同的版本,这套缓存系统能让每个版本的生成速度提升30%以上。但它也有局限:如果你的对话上下文超过了缓存的窗口大小,还是得重新计算——不过MLX已经在测试「旋转缓存」技术,能把缓存的有效长度延长一倍,同时不增加内存占用。

当我们在谈论本地AI的速度时,其实是在谈论「控制权」——把AI从云端拉回本地,不仅是为了快,更是为了让数据留在自己手里。MLX和Ollama的结合,没有用什么黑科技,只是把Apple Silicon藏了3年的设计潜力,真正释放了出来。

未来的本地AI,不会是比谁的芯片参数更高,而是比谁能更聪明地利用现有的硬件。内存不只是仓库,更是AI的记忆库。当你的Mac能在3秒内响应你的代码提问,当你不用再担心聊天记录被上传云端,你会发现,真正好用的AI,从来都不是那些飘在云端的巨兽,而是藏在你电脑里、懂你的「小助手」。

点击充电,成为大圆镜下一个视频选题!