对抗知识焦虑,从看懂这条开始

App 下载

AI集成之争:别让手册代替了连接器

标准化连接协议|开发者社区|AI服务集成|Skills机制|Model Context Protocol|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

标准化连接协议|开发者社区|AI服务集成|Skills机制|Model Context Protocol|AI产业应用|人工智能

当你打开AI助手,想让它直接调取你的日历安排、同步笔记数据时,却被要求先安装三个CLI工具、配置两份密钥、再读一遍Markdown操作手册——这种糟心的体验,正在成为不少重度AI用户的日常。2026年春,一场关于AI服务集成标准的争论在开发者社区炸开:一边是被喊着“已死”的Model Context Protocol(MCP,AI与外部系统的标准化连接协议),一边是被捧为“新宠”的Skills(以文档形式给AI传授课操作知识的机制)。有人说Skills是效率革命,有人却警告:这是在开倒车。

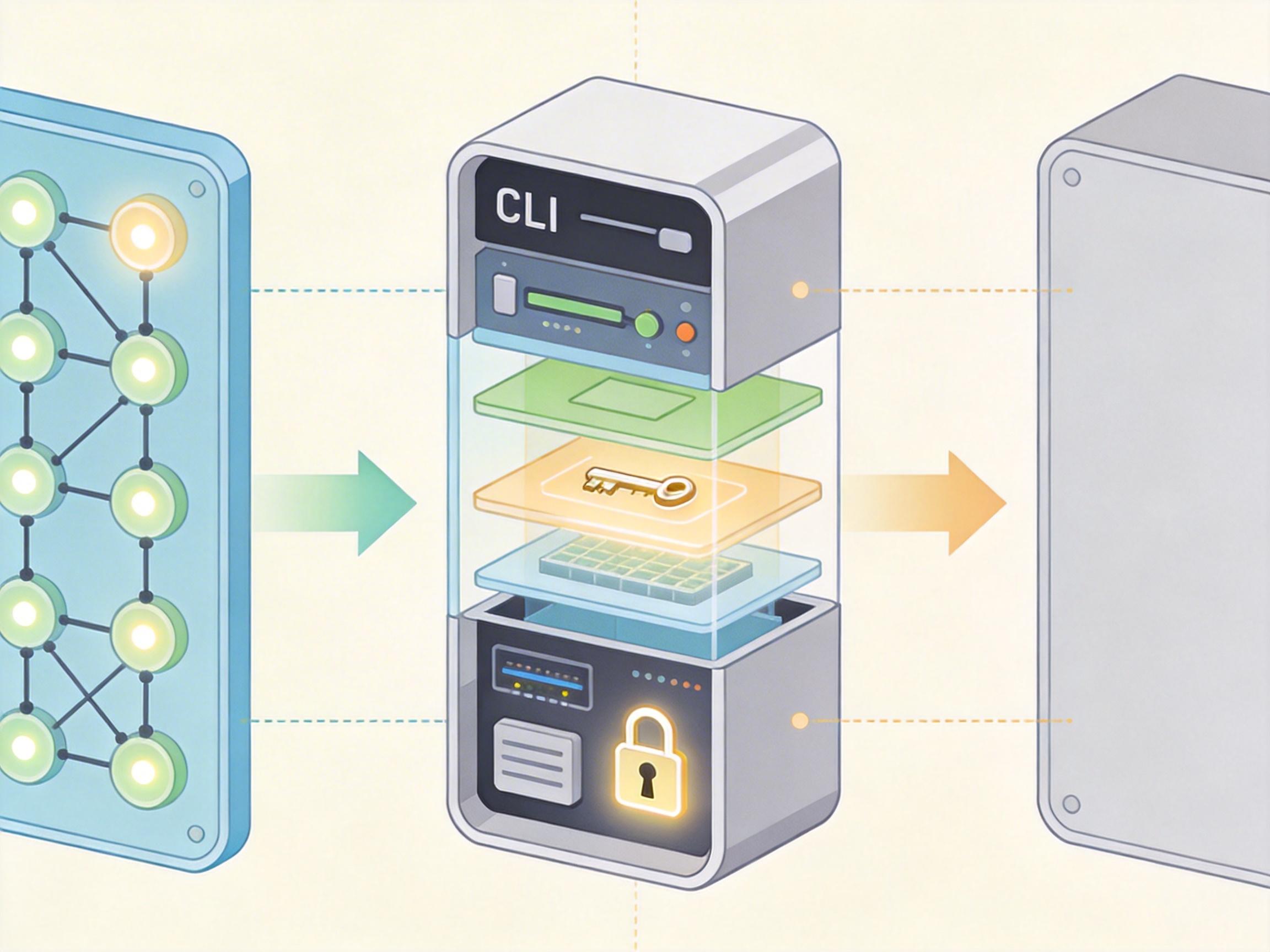

你可以把MCP想象成家里的USB-C接口——不管是手机、耳机还是硬盘,只要接口对得上,就能直接连接,不用管背后的电路逻辑。它是一套标准化协议,AI助手只需告诉它“我要调取DEVONthink的笔记”,MCP服务器就会自动完成身份验证、数据传输、格式转换这些脏活累活,全程不需要AI理解技术细节,更不需要用户安装任何本地工具。

而Skills更像一本纸质操作手册,它会写清楚“你要先打开XX软件,输入XX命令,再点击XX按钮”,但它本身没法帮你完成任何实际操作——要调取日历,你得先自己装好日历的CLI工具,配置好密钥,AI只能照着手册念步骤。

这是两种完全不同的逻辑:MCP解决的是“AI能做什么”,给AI提供连接外部世界的管道;Skills解决的是“AI该怎么做”,给AI传授具体的操作经验。

Skills的崛起不是没有道理。它轻量、灵活,适合快速传递团队内部的操作规范——比如怎么写符合要求的commit信息,怎么处理特定格式的PDF。但当它被当成“万能解决方案”用于服务集成时,问题就暴露了。

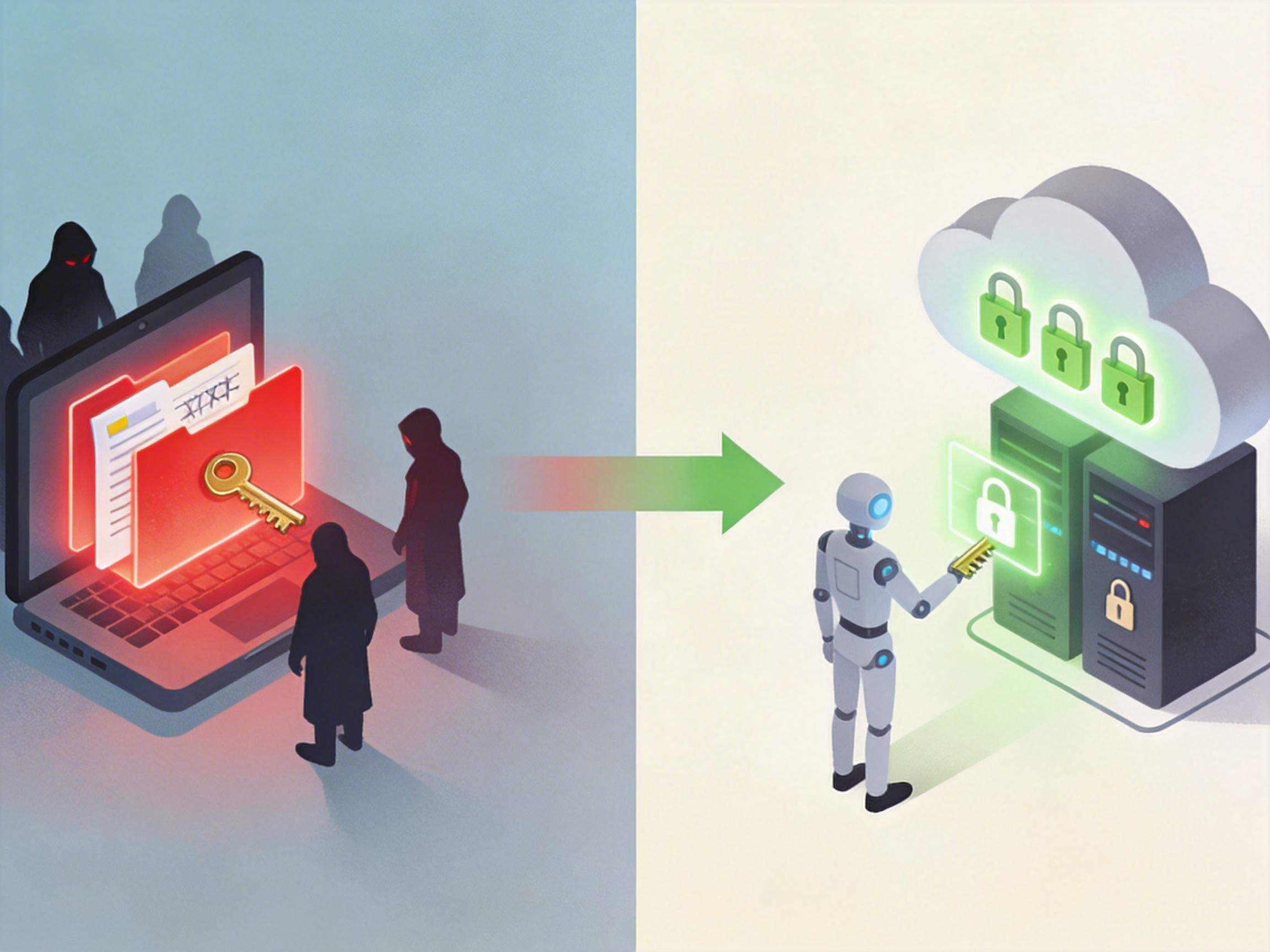

首先是部署的复杂性:每集成一个服务,用户就得安装对应的CLI工具,配置环境变量和密钥。如果换一台设备或者换个AI平台,所有步骤得重来一遍——ChatGPT没法运行CLI,Claude网页版也不行,只有少数带完整计算环境的AI工具才能支持。

更棘手的是安全风险:Skills依赖本地环境执行命令,密钥往往以明文形式存在.env文件里,一旦设备泄露,所有关联服务都可能被攻破。而MCP的优势恰恰在这里:它采用OAuth等标准化认证,密钥由服务器统一管理,AI只能调用授权后的接口,不会接触到原始凭证。

有开发者做过统计,使用MCP集成企业服务,平均能减少70%的部署时间,数据泄露风险降低60%。但Skills的支持者也反驳:很多简单集成根本不需要MCP这么重的架构,就是“杀鸡用牛刀”。

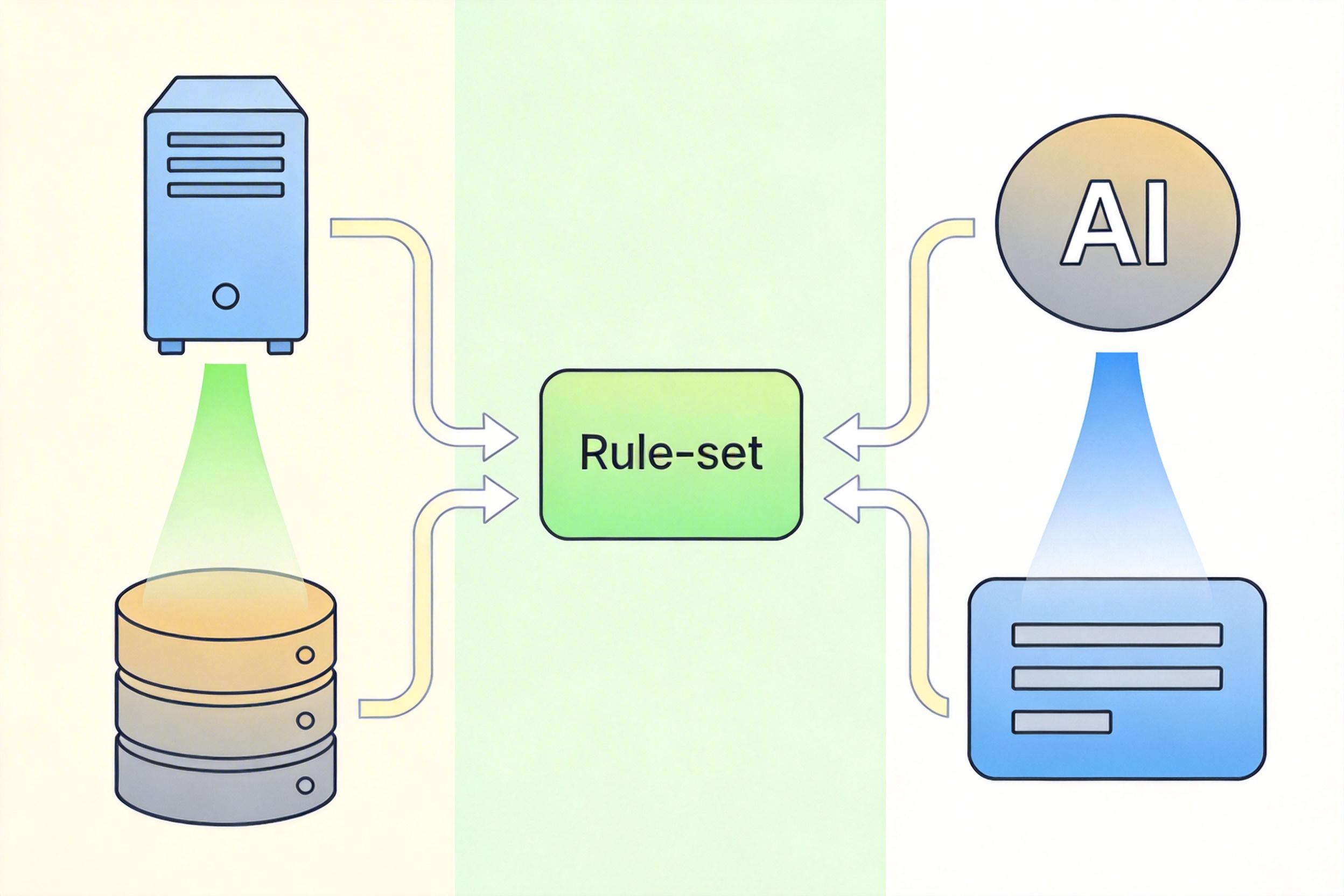

这场争论的本质,从来不是“谁取代谁”,而是“如何让AI更高效地与世界互动”。业界已经开始探索两者结合的路径:用MCP做底层的“连接器”,负责安全、标准化的服务调用;用Skills做上层的“操作指南”,负责传递业务经验和流程规范。

比如在处理客户反馈时,MCP服务器负责从CRM系统调取最新的用户数据,Skills则告诉AI“这类反馈应该优先标记为高优先级,按照XX模板回复”。AI不需要知道怎么连接CRM,也不需要记复杂的回复规则,只需要专注于理解用户意图。

当然,挑战依然存在:MCP的服务器开发和维护成本较高,需要专业团队支持;Skills的版本管理和安全审核也需要更完善的机制。有统计显示,目前约36%的Skills存在安全漏洞,其中13%是可能导致凭证泄露的高危问题。

当我们讨论AI集成的未来时,其实是在讨论“如何让技术服务于人”——不是让用户去适应复杂的技术流程,而是让技术去适配用户的使用习惯。MCP和Skills的共存,恰恰是AI生态成熟的标志:没有万能的解决方案,只有适合的组合。

连接器搭管道,手册传经验,AI才会真正好用。未来的AI助手,应该是既能安全高效地连接各种服务,又能灵活适配不同场景的操作逻辑——它不需要用户成为技术专家,只需要用户提出需求,剩下的交给技术去完成。