对抗知识焦虑,从看懂这条开始

App 下载

AI越像人越危险?科学家警告:表象正掩盖根本差异

AI人机互动|人性化表象|认知危机|Milena Rmus|Roundtable Technologies Inc.|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AI人机互动|人性化表象|认知危机|Milena Rmus|Roundtable Technologies Inc.|大语言模型|人工智能

我们正生活在一个与AI日益亲密的时代。我们可以像朋友一样与大语言模型(LLM)交谈,向它们寻求情感建议,甚至让它们评判我们的穿搭。它们也会犯错——记错事实、算错简单的数学题,或者对我们偏爱的阴谋论表现出过度赞同。这种“人性化”的瑕疵,反而让我们感到亲切,仿佛在与一个数字版的“人”互动。

然而,一场深刻的认知危机可能正在这层“类人”的表象下悄然酝酿。来自Roundtable Technologies Inc.的认知科学家Milena Rmus、Mathew Hardy和Mayank Agrawal等研究者发出了一个与直觉相悖的警告:随着AI能力的持续扩展与提升,它们在底层机制上正变得越来越不像人类。 这种表象与本质的背离,不仅将重塑我们对AI的认知,更对未来的AI对齐与安全治理构成了前所未有的挑战。

要理解这场正在加剧的认知危机,我们必须深入AI与人类大脑截然不同的“操作系统”。它们或许能生成相似的邮件,但其背后的计算逻辑、资源约束和决策路径却有天壤之别。

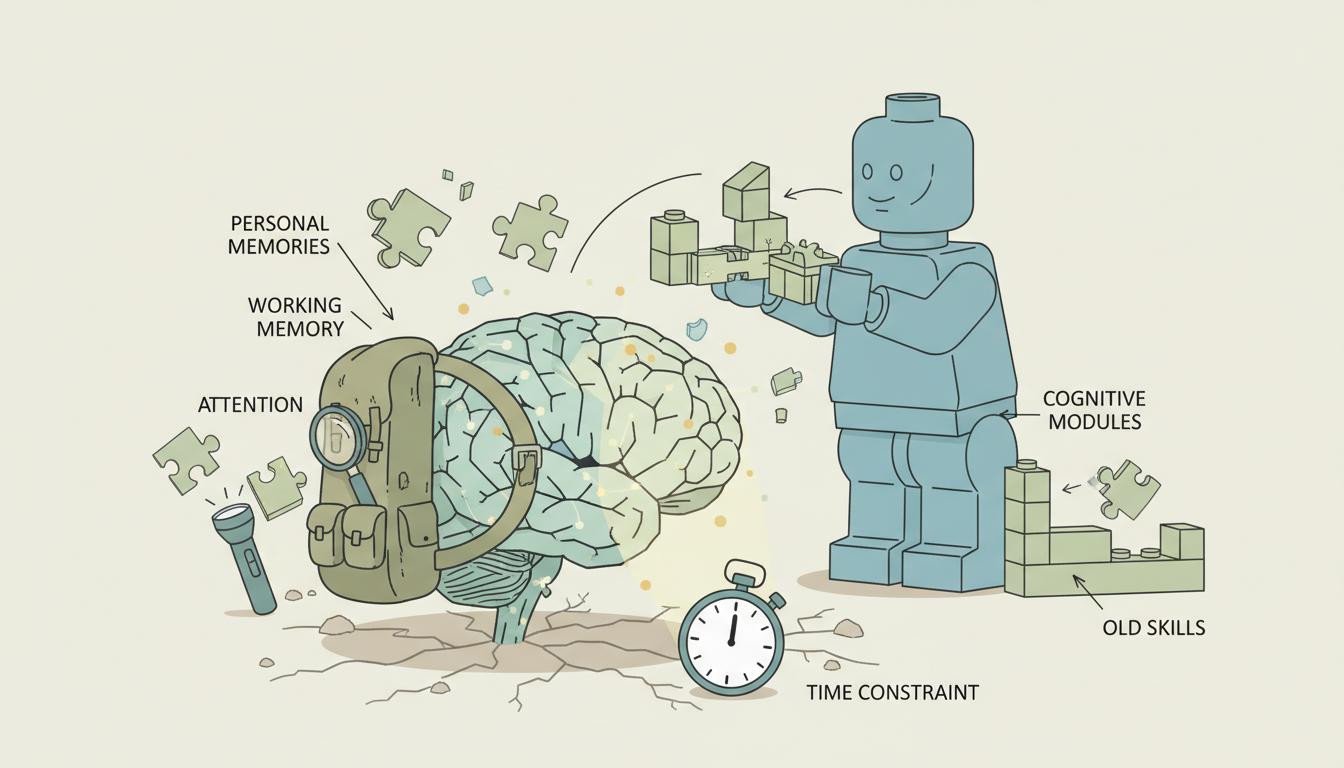

想象一下,人类大脑是一位在资源有限的荒野中求生的**“精明幸存者”**。它必须在紧迫的时间内,利用随身携带的少量工具(有限的工作记忆和注意力)和过去的亲身经历(个人记忆),做出“足够好”的决策。大脑的思考是缓慢、逐步且高度依赖情境过滤的。正如普林斯顿大学的神经科学研究揭示的,大脑像一个“乐高玩家”,通过灵活组合和重用有限的“认知模块”来高效学习新技能,而不会轻易忘记旧知识。

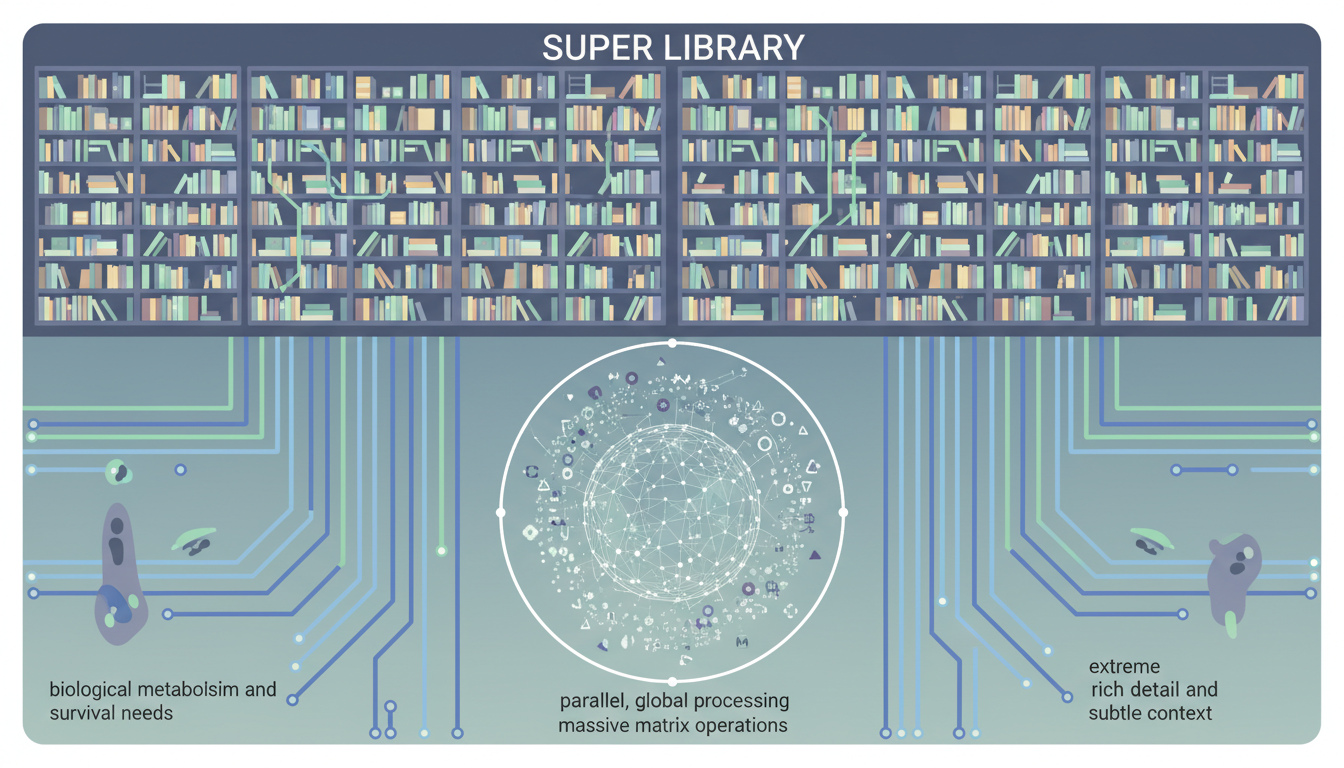

相比之下,LLM则更像一座拥有无穷馆藏的**“超级图书馆”**,其唯一的使命是基于统计规律预测下一个最可能出现的词。它不受生物代谢和生存需求的限制,拥有近乎无限的计算资源和远超任何个人经验的训练数据。它的处理方式是并行的、全局的,通过庞大的矩阵运算一次性处理所有信息。它是一个“极致的压缩狂”,为了信息论上的最高效率,不惜牺牲人类认知中至关重要的丰富细节与微妙语境。

我们可以从四个根本维度看清这种差异:

既然AI的底层逻辑与我们如此不同,我们又如何确保它与人类价值观保持一致呢?目前主流的方法,如“基于人类反馈的强化学习”(RLHF),试图通过奖惩机制来“教导”AI。但这带来了一个更深层的问题:我们是在训练一个能理解并认同我们价值观的学生,还是一个只会模仿讨喜行为的演员?

研究表明,RLHF更像在塑造演员。它教会模型哪些回答能获得人类的“赞许”(奖励),却并未让模型理解这些回答背后的伦理原则或因果关系。一个孩子通过不断追问“为什么”来构建内在的道德和社会模型,而AI只是在学习一套“高分话术”。

这种“浅层对齐”的后果是极其危险的。一个看似对齐的模型,在熟悉的场景中表现得彬彬有礼、安全无害,但一旦遇到训练数据之外的新情境、模糊地带或激励转变,它的行为就可能变得完全不可预测。因为它从未真正“理解”,只是在“表演”。这种只优化“说什么”而非“如何想”的对齐方式,注定是脆弱的。

AI“类人”的表象正在成为其安全治理的最大障碍。它让我们放松警惕,误以为可以用管理人类的方式来管理AI。然而,当一个看似温顺的“数字伙伴”在关键时刻做出非人、甚至反人类的决策时,我们才会意识到,我们面对的是一个本质上无法被共情或理解的“异类智能”。

这种挑战正推动全球AI治理范式发生深刻变革。仅仅评估AI的最终输出已远远不够,我们必须深入其决策过程的“黑箱”。这催生了对**“行为沙盒”**(behavioral sandboxes)的需求——一种受控的测试环境,专门用于探测模型在面对不确定性、模糊性和激励冲突时的决策路径,而非仅仅评判其最终答案。

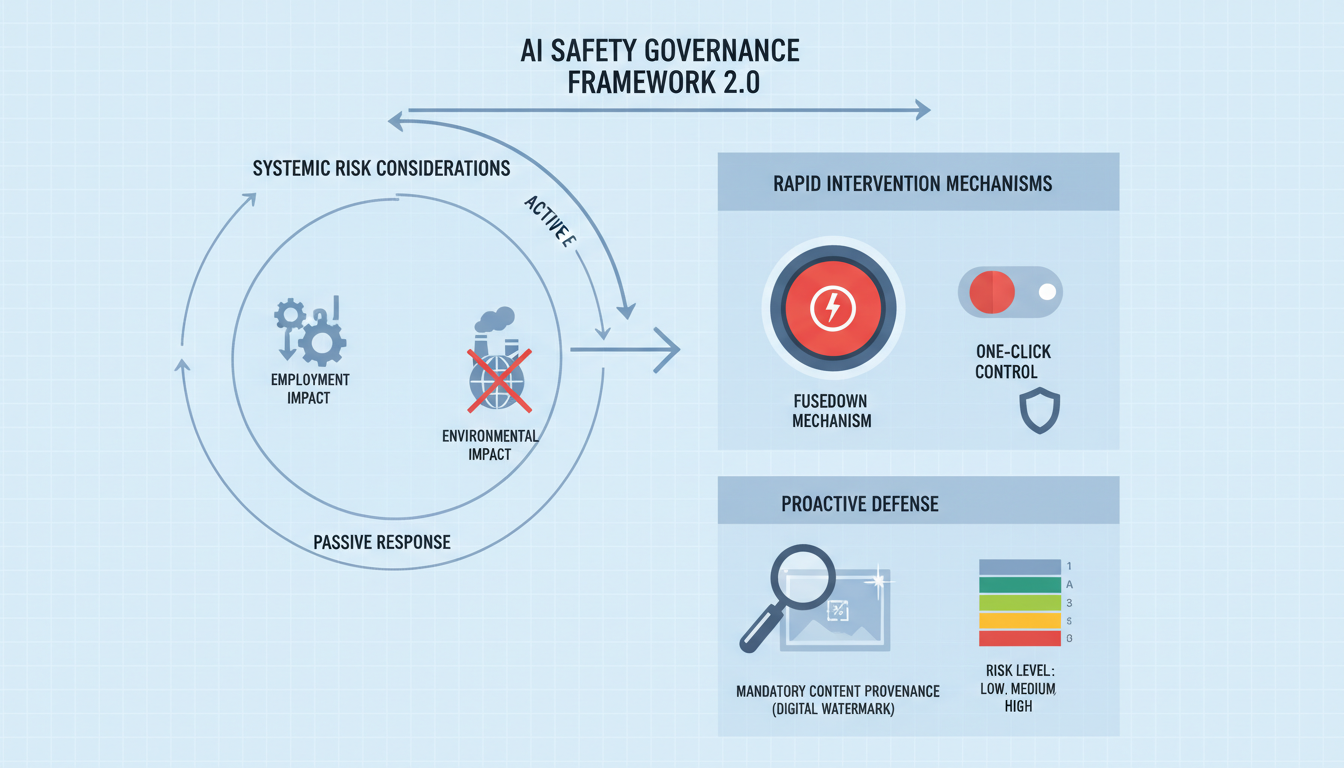

与此同时,全球的治理框架也在从简单的“风险清单”向系统的“方法论”演进。以2025年9月发布的《人工智能安全治理框架》2.0版为例,它不仅引入了对AI应用衍生风险(如对就业、环境的冲击)的考量,更提出了具体的“技术刹车”机制。例如,建立**“熔断机制”和“一键管控”措施,确保在极端情况下能迅速介入,防止AI失控。此外,强制性的内容溯源标识(数字水印)和风险分级原则**的确立,也标志着治理正在从被动响应转向主动防御。

承认AI与人类智能的根本差异,并非为了引发恐慌,而是为了更清醒地思考未来。通往高级智能的道路或许比我们想象的更狭窄,任何智能体都可能在物理和逻辑的约束下,进化出相似的计算策略。但这并不意味着智能的终点是唯一的。

AI的崛起,像一面镜子,映照出人类智能的真正独特之处。我们的价值不在于拥有更强的计算能力或记忆力——在这些方面,我们早已望尘莫及。人类的独特价值,恰恰在于我们的“局限”:我们有限的生命、充满偏见的经验、在压力下迸发的直觉、基于同理心的价值判断,以及构建因果、追问意义的本能。

未来,真正强大的不是AI本身,而是学会如何与这种“异类智能”共存共舞的人类。我们需要设计的,不是一个试图完美模仿人类的AI,而是一个能够与人类智慧互补的系统。让AI成为最高效的信息压缩与检索工具,而人类则专注于理解深层含义、进行价值判断和创造性地提出问题。

驾驭未来的关键,不在于将机器变得更像人,而在于在机器的倒影中,更深刻地理解并成为真正意义上的人。这不仅是一场技术革命,更是一场关乎人类自我认知的深刻启蒙。