对抗知识焦虑,从看懂这条开始

App 下载

加密的耳语:AI时代的隐私幽灵与信任危机

技术信任危机|隐私保护|耳语泄露漏洞|微软安全研究员|AI安全治理|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

技术信任危机|隐私保护|耳语泄露漏洞|微软安全研究员|AI安全治理|人工智能

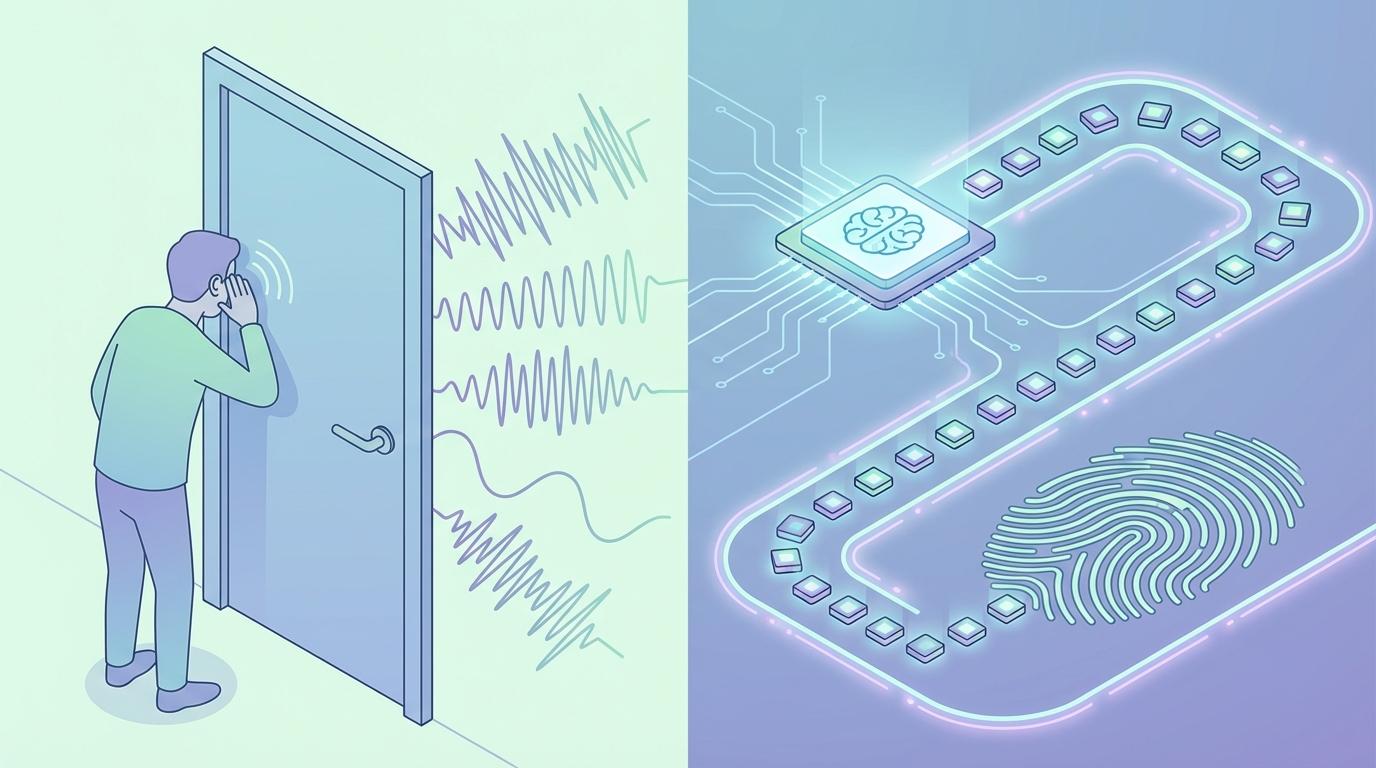

在我们与人工智能(AI)对话的数字密室里,我们分享秘密、寻求建议、袒露脆弱。我们相信,那层名为“加密”的坚固屏障,能守护这些私密的耳语。然而,就在2025年11月,微软的安全研究员们揭示了一个令人不安的真相:即使门窗紧锁,一个幽灵般的窃听者,也能通过倾听我们谈话的“节奏”,猜出我们内心深处的秘密。

这个被命名为 “耳语泄露”(Whisper Leak) 的漏洞,如同一道闪电,划破了生成式AI时代看似安全的夜空。它宣告了一个核心挑战的到来:在智能奔涌的浪潮中,我们如何在享受技术便利的同时,捍卫数字灵魂的最后一道防线?隐私安全与技术治理的博弈,已然展开。

“Whisper Leak”并非传统意义上的黑客攻击,它不需要暴力破解坚不可摧的TLS加密协议。它的高明之处在于,它是一种侧信道攻击——一种更为狡猾的窥探方式。

想象一下,你虽然听不到房间里的对话内容,但通过门外传来的声音节奏、停顿和语速,依然能大致判断出里面是在激烈争吵,还是在温情倾诉。微软的研究人员正是利用了类似的原理。生成式AI为了提供流畅的“实时对话感”,通常会采用 “流式传输”(token-by-token)的方式,逐字逐句地生成回应。这一过程在网络中留下了独特的“指纹”:

攻击者通过监控这些加密流量的元数据,就像一位经验丰富的密码学家分析电报的滴答声,能够以惊人的超过98%的准确率,推断出用户正在讨论的主题——无论是关于金融交易、政治异见,还是敏感的医疗咨询。你的对话内容本身依然是加密的,但你谈论“什么”的秘密,却已暴露无遗。包括ChatGPT、Gemini、Microsoft Copilot在内的主流AI应用,都受到了这一架构性缺陷的影响。

“耳语泄露”的发现,迫使AI服务商们直面一个棘手的两难选择。修复漏洞的技术路径是清晰的,但并非没有代价:

这些措施无疑会增加数据传输的延迟和带宽成本。这意味着,更安全的AI,可能会变得更“迟钝”、更昂贵。这种在用户体验、运营成本和隐私安全之间的权衡,成为了AI巨头们的一场内部博弈。

结果是分裂的。微软和OpenAI等公司迅速响应并部署了修复方案,通过增加随机混淆字段等方式,成功将攻击有效性降低到不再构成实际风险的水平。然而,并非所有厂商都积极跟进。一些公司以各种理由拒绝修复,甚至对研究结果置若罔闻。这暴露了行业自律的脆弱性,当安全成为一种“成本”而非“必需”时,用户的隐私便可能被置于天平的另一端。

“耳语泄露”只是冰山一角。2025年初,一系列重大数据泄露事件集中爆发,揭示了生成式AI生态系统远比我们想象的更为脆弱。

这些事件共同描绘了一幅令人警醒的图景:从底层的云服务配置,到中间的开源协议,再到上层的应用安全,生成式AI的每一个环节都可能成为攻击者的突破口。数据泄露不再仅仅是对话被窃听,而是整个数字身份和知识资产的系统性风险。

面对日益严峻的安全挑战,全球范围内的技术治理却呈现出碎片化的态势。各国基于不同的国情和价值观,走上了不同的监管道路:

这种监管的“三国演义”意味着,AI企业在全球运营面临着复杂的合规迷宫,而用户数据的保护标准也因地理位置而异。一个统一、协调的全球AI治理框架,仍然遥远。

我们正处在一个十字路口。一方面,生成式AI正以前所未有的深度和广度融入我们的生活与工作,成为创造力的放大器和效率的倍增器。另一方面,其安全基础的脆弱性,正不断侵蚀着我们对数字世界的信任。

这场关于隐私、安全与治理的博弈,远未结束。它要求我们重新思考:

最终,这场博弈的核心,关乎我们希望构建一个怎样的智能未来。是任由技术野蛮生长,让我们在便利的幻觉中交出隐私的权杖?还是主动塑造规则,让AI成为真正值得信赖、增进人类福祉的伙伴?

“耳语泄露”的幽灵仍在数字世界的上空盘旋,它提醒我们,每一次与AI的对话,都是对未来信任形态的一次投票。而答案,掌握在我们每一个人手中。