对抗知识焦虑,从看懂这条开始

App 下载

AI多智能体再聪明,也跳不出40年前的理论牢笼

共识难题|FLP不可能性定理|分布式系统|多智能体AI项目|计算科学|AI智能体|数理基础|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

共识难题|FLP不可能性定理|分布式系统|多智能体AI项目|计算科学|AI智能体|数理基础|人工智能

2025年底,Gartner的一份调研数据让AI圈倒吸一口冷气:近30%的多智能体AI项目在概念验证阶段就宣告失败,核心原因既不是模型不够聪明,也不是数据不够多——而是智能体之间根本无法好好配合。有人把希望寄托在下一代大模型上,认为更聪明的AI自然能解决协调问题。但分布式系统领域的研究者却摇了摇头:这些人怕是忘了,早在1985年,就有三个美国人用数学证明了一件事:只要是分布式系统,就永远存在无法彻底解决的共识难题。这不是AI能力的问题,是数学的铁律。

先看FLP不可能性定理——这是分布式系统领域的“第一铁律”。1985年,费舍尔、林奇和帕特森三位学者证明:在完全异步的分布式系统中,只要有一个节点可能崩溃,就不存在能保证所有节点在有限时间内达成一致的确定性算法。

把它翻译成大白话就是:如果让一群AI智能体分头干活,只要其中一个可能“罢工”(比如卡住、崩溃、或者忽略消息),就永远没法保证它们能在规定时间内对同一个方案达成共识。你要么接受可能永远达不成一致,要么接受偶尔会产出错误的结果——安全性和活跃性,鱼和熊掌不可兼得。

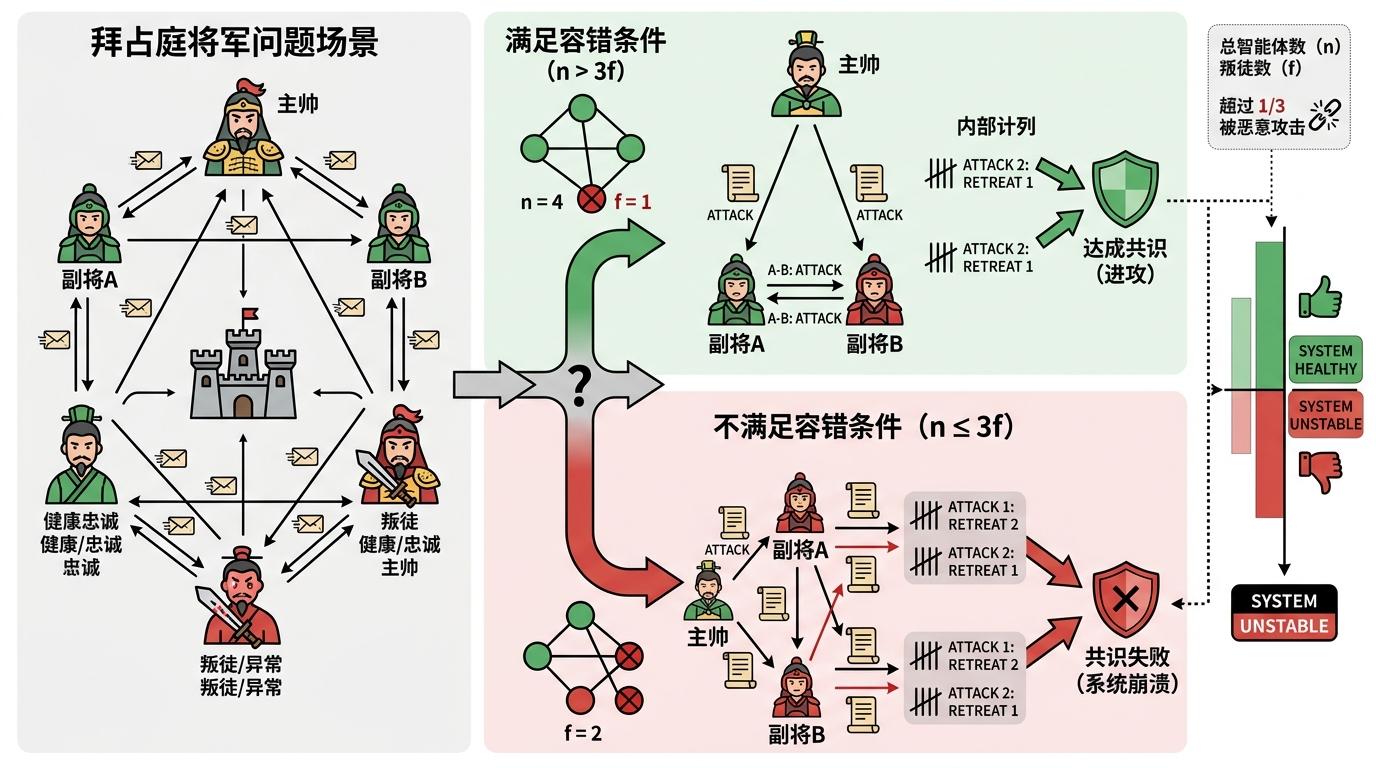

再看拜占庭将军问题。这个1982年提出的问题假设:一群将军围攻城堡,其中可能有叛徒会发送虚假消息,误导其他将军。要让忠诚的将军们达成一致,必须满足一个硬条件:总将军数n必须大于3倍叛徒数f。也就是说,只要超过1/3的智能体“误解”了任务(或者被恶意攻击),整个系统就彻底无法达成共识。

这两个定理不是技术限制,是数学上的死局。哪怕未来的AI能通过图灵测试,能自己写代码,只要它还是在分布式系统里和其他智能体协作,就逃不出这两道高墙。

既然理论上做不到完美,工程师们只能在现实里找平衡。他们想出了各种“补丁”,本质都是用概率换确定性。

比如,针对FLP定理的异步问题,人们给系统加了“超时机制”——如果一个智能体太久没响应,就默认它崩溃了。但这只是一种假设,万一那个智能体只是因为网络延迟没来得及回复呢?这就可能导致“误判”,反而引发新的协调问题。

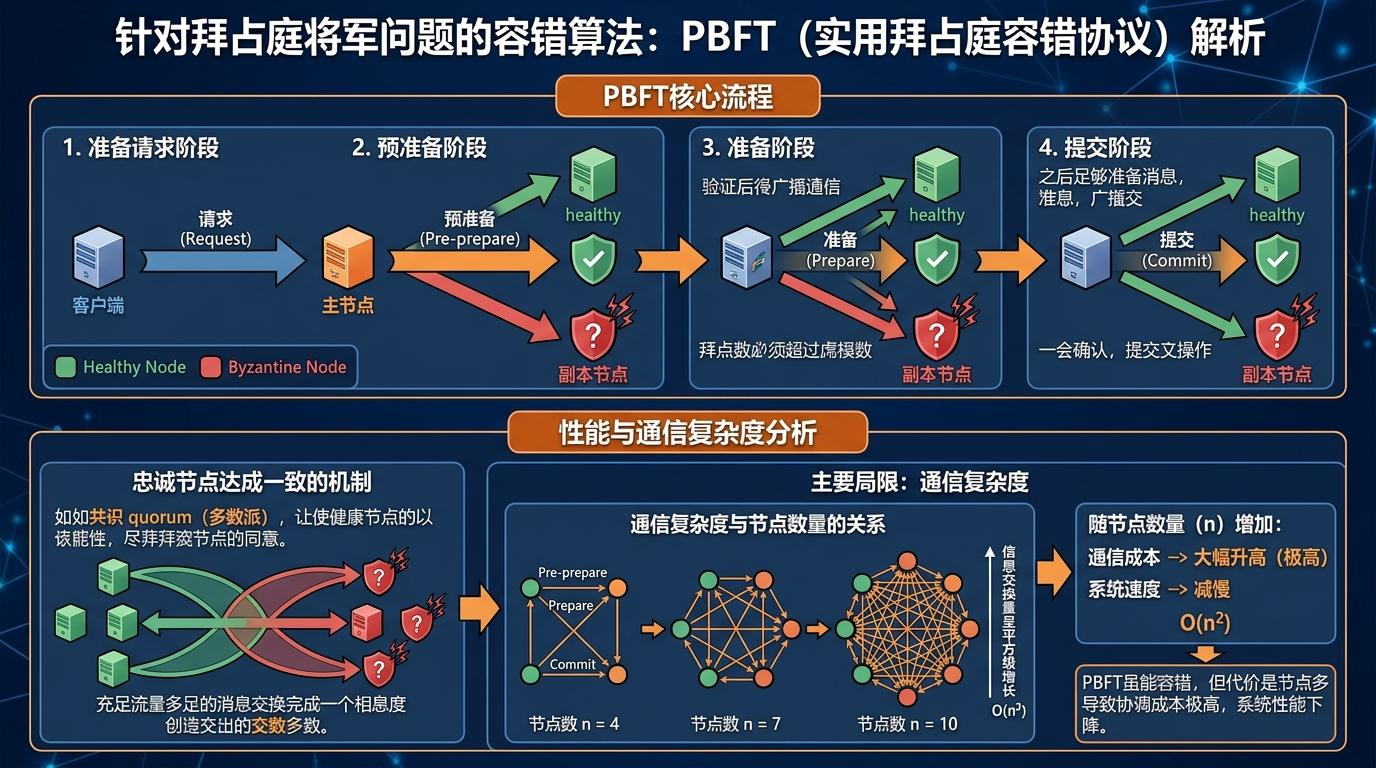

针对拜占庭将军问题,人们设计了各种容错算法,比如PBFT实用拜占庭容错协议。它通过多轮投票让忠诚的节点达成一致,但代价是通信复杂度会随着节点数增加呈平方级增长——节点越多,协调成本越高,系统越慢。

还有人尝试用“监督者智能体”来监控其他智能体的行为,一旦发现错误就及时纠正。比如2026年的SupervisorAgent框架,能把Token消耗降低30%,同时提升任务成功率。但这种方法也有代价:监督者本身也会消耗资源,而且它也可能出错——毕竟它也是一个AI。

这些方法确实能让系统“看起来”正常工作,但本质上都是在“赌概率”:赌崩溃的节点足够少,赌误解任务的智能体不超过1/3,赌监督者能及时发现错误。一旦运气不好,系统还是会崩溃。

除了技术补丁,人们还在治理层面想办法——核心是“协调透明度”。简单说,就是让智能体之间的协作过程变得可追踪、可审计、可干预。

比如,给每个智能体的决策过程加上“责任归属机制”,谁做了什么决定、基于什么信息、和谁做了沟通,都记录在案。一旦出了问题,就能顺着日志找到是哪个环节出了错。在Python编程任务中,这种机制能把准确率提升36个百分点。

还有人提出“治理即服务”框架,在多智能体系统外面加一层独立的治理层,用规则实时监控智能体的行为。比如,如果一个智能体试图访问它不该碰的数据,治理层就会直接阻断;如果它多次违规,就降低它的信任分数,限制它的权限。

这些方法不能解决理论上的共识难题,但能让系统的行为更可预测。就像交通规则不能杜绝车祸,但能让车祸的概率大大降低,而且出了事故能找到责任人。

不过,透明度也有代价。记录所有交互过程会消耗大量的存储和计算资源,而且过度监控也会限制智能体的自主性——毕竟,太听话的AI,可能就失去了它的优势。

当我们谈论多智能体AI的未来时,总习惯把目光放在模型参数、训练数据、算法创新上,却常常忘了它的本质是一个分布式系统。而分布式系统的命运,早在40年前就被数学定理写死了。

我们永远无法让一群智能体完美协作,就像我们永远无法让一群人完美协作一样。但这并不意味着多智能体AI没有前途——就像人类社会虽然充满矛盾,却依然能创造出伟大的文明。

真正的出路,不是等待更聪明的AI来“解决”协调问题,而是接受它的不完美,用技术补丁和治理机制把风险控制在可接受的范围内。毕竟,在这个世界上,完美从来不是目标,可控才是。

金句:AI再聪明,也逃不过数学的铁律。