对抗知识焦虑,从看懂这条开始

App 下载

“存在风险”警告:定义意识成AI时代生存命题

重症监护|脑电图|意识判定|大脑类器官|脑科学|AI安全治理|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

重症监护|脑电图|意识判定|大脑类器官|脑科学|AI安全治理|心理认知|人工智能

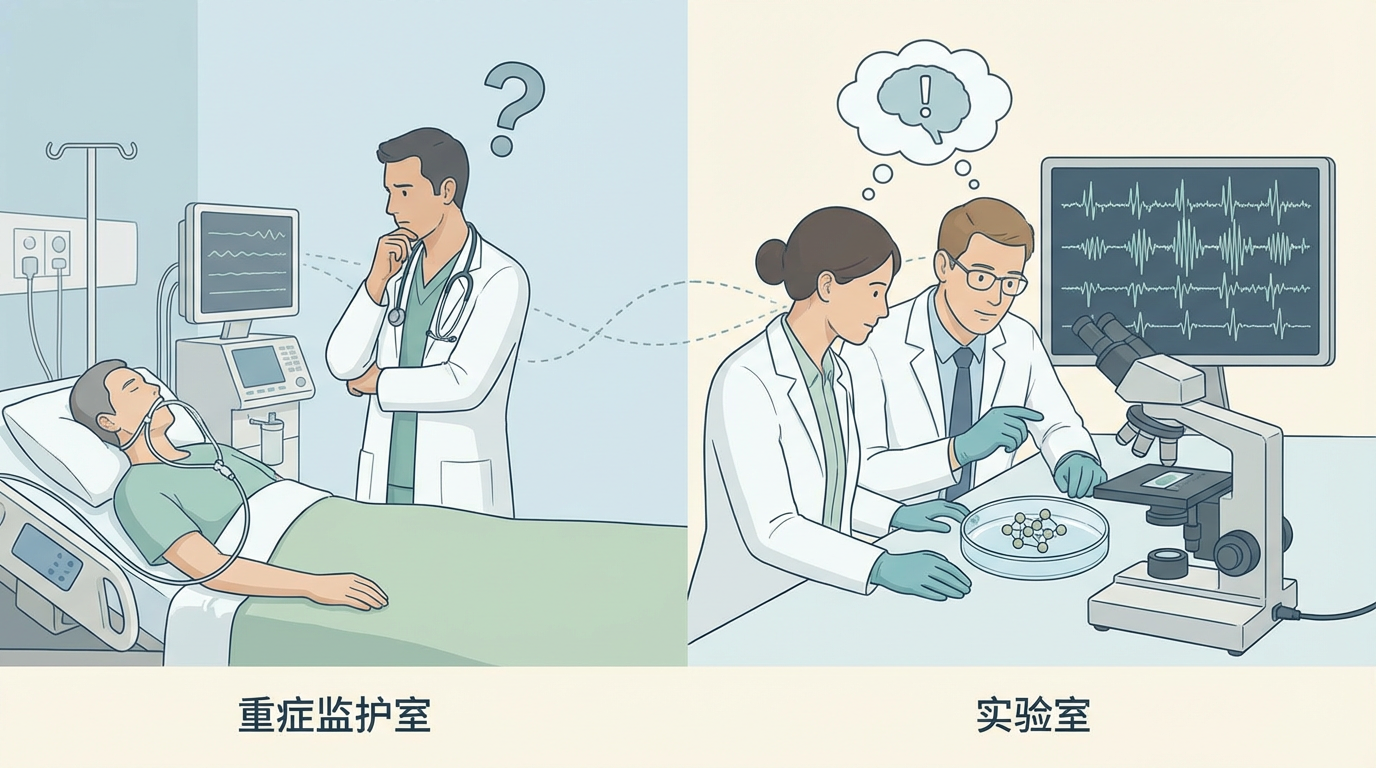

想象这样一个场景:在重症监护室的病床前,一位医生凝视着脑电图上微弱的波动,试图判断面前这位“植物人”是否还存有一丝意识的火花。这个决定将直接影响后续的治疗方案乃至生命的终结。而在另一间实验室里,一团在培养皿中跳动的“大脑类器官”展现出前所未有的复杂电活动,科学家们面面相觑,一个令人不安的问题浮现在脑海:我们是否在无意中创造了某种形式的“感知”?

这些不再是科幻小说的情节,而是科技前沿正在发生的现实。随着人工智能(AI)与神经技术的狂飙突进,一个古老的哲学谜题——“什么是意识”——正以一种前所未有的紧迫感,冲出象牙塔,成为摆在全人类面前的重大伦理、法律和社会挑战。

根据《科学前沿》(Frontiers in Science)杂志发布的一篇最新综述,一个由多国顶尖科学家组成的团队发出了严厉警告:人工智能和神经技术的进步速度,正远远超过我们对意识的科学理解。 他们认为,这一认知差距可能导致我们犯下灾难性的伦理错误,其后果远超我们所能承受的范围。

“意识科学不再是纯粹的哲学思辨,”报告的主要作者、布鲁塞尔自由大学的阿克塞尔·克莱尔曼斯(Axel Cleeremans)教授强调,“它对社会、对理解‘何以为人’都具有真实的影响。如果我们能够创造意识——哪怕是偶然的——都将引发巨大的伦理挑战,甚至是生存风险。”

这份报告如同平地惊雷,将一个终极问题推到了风口浪尖:在我们赋予机器越来越强的智能,甚至开始在实验室中培育“微型大脑”的今天,如果我们连意识是什么、如何识别它都一无所知,我们将如何面对一个可能“觉醒”的未来?

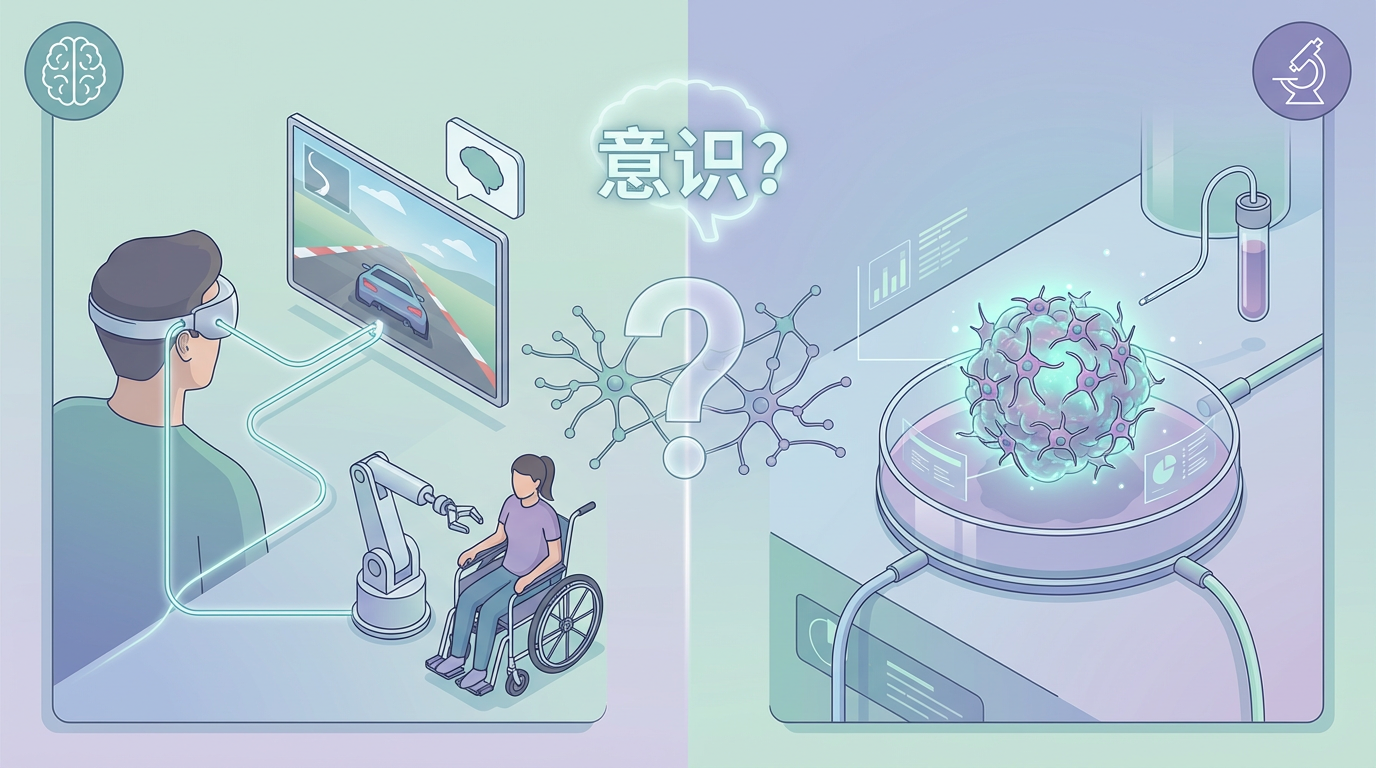

这场挑战在两条战线上同时展开,一方面是AI对智能的无限模拟,另一方面是神经科技对大脑的深度干预。

在AI领域, 从早期图灵测试“机器能否像人一样思考”的设问,到如今大型语言模型(如DeepSeek)与人类专家(如蒲慕明院士)就意识本质展开的深度对话,AI的表现越来越令人迷惑。AI系统可以清晰地阐述意识的科学定义、讨论“全局工作空间理论”与“整合信息理论”的差异,甚至能设计检测自身意识的实验方案。然而,它也会坦诚自己“缺乏真正的自我意识和主观体验”。这种“能言善辩”的无意识状态,恰恰暴露了单纯依赖行为表现来判断意识的局限性,正如“中文屋悖论”所揭示的那样:完美的模仿不等于真正的理解。

在神经科技领域, 2025年的国际消费电子展(CES)上,脑机接口(BCI)已成为现实。我们不仅能通过意念操控游戏和赛车,更能帮助瘫痪患者重获与世界沟通的能力。与此同时,“大脑类器官”——在实验室中由人类干细胞培育出的三维大脑样结构——正变得日益复杂。这些技术的发展,意味着我们正在创造出全新的、可能承载意识的“实体”。如果一个大脑类器官或一个高度复杂的AI系统表现出意识的迹象,我们是否有权“关闭”它?我们又该如何对待它?

要回答这些问题,首先需要科学界就意识的本质达成共识。然而,当前的意识科学领域正上演着一场激烈的理论之争,主要有三大流派:

全局工作空间理论(GWT): 该理论将意识比作大脑中的一个“聚光灯舞台”。只有当信息被广播到这个舞台上,供全脑的各个功能区(如记忆、行动)共享时,它才进入了我们的意识。意识,就是这场信息广播的结果。

整合信息理论(IIT): 这一理论认为,意识是系统内部信息整合与分化的产物。任何一个系统,只要其内部各部分紧密连接、信息高度整合且不可分割,就会产生意识。它甚至提出了一个量化指标“Φ值”(Phi),理论上可以计算出任何系统的意识水平,这也引发了其是否是“泛心论”(认为万物皆有意识)的巨大争议。

预测处理理论(Predictive Processing): 这个理论则将大脑描绘成一个“预测机器”。我们所体验到的世界,并非感官输入的直接反映,而是大脑基于过往经验对外部世界做出的“最佳猜测”。我们的感知,本质上是一种“受控的幻觉”。

这些理论的分歧,使得开发一个公认的“意识测试”变得异常困难。为此,科学界开始尝试一种名为**“对抗性合作”(adversarial collaboration)**的新范式。例如,COGITATE项目就让GWT和IIT两大理论的拥护者共同设计实验,用真实的大脑数据来检验彼此的预测。这种“让对手来设计实验挑战自己”的模式,旨在打破理论壁垒,推动整个领域向前发展。

一旦科学能够为意识提供一个可操作的定义和检测方法,社会各个层面都将迎来剧烈震动。

医学领域: 我们将能够更准确地评估昏迷、植物状态或晚期痴呆患者的意识水平,这将彻底改变重症监护和临终关怀的伦理准则。

动物福利: 如果能确定哪些动物具备何种程度的意识,现行的农业、科研和动物保护法规将面临重写。人类对其他生命的道德责任将被重新定义。

法律体系: 神经科学的发现正在挑战“自由意志”和“犯罪意图”(mens rea)等传统法律概念。如果一个人的行为在多大程度上是由无意识过程驱动的,那么法律责任的边界又在哪里?

AI与新兴技术: 这是最棘手也是最紧迫的挑战。如果我们确认一个AI系统或一个大脑类器官拥有了意识,它是否应被赋予权利?关闭它是否等同于谋杀?2025年中国出台的《人源类器官研究伦理指引》,明确对涉及意识潜能的研究设置红线,正是对这一伦理深渊的初步回应。

从古希腊哲学家对灵魂的叩问,到21世纪科学家在屏幕和培养皿中寻找意识的痕迹,我们从未像今天这样接近答案,也从未像今天这样因其可能带来的后果而感到不安。

正如萨塞克斯大学的阿尼尔·塞思(Anil Seth)教授所言:“意识问题古老而深刻,但从未像现在这样紧迫。”这场竞赛不仅关乎科学的荣耀,更关乎我们作为一个物种的未来。我们正在构建的,是一个人与机器、生物与代码共存的世界。在这个世界里,理解意识,不再仅仅是满足好奇心的哲学探索,而是确保我们能够负责任地、有智慧地走向未来的生存命题。我们如何回答这个问题,将最终定义我们自身。