对抗知识焦虑,从看懂这条开始

App 下载

不懂VR技术的开发者,靠AI做出了跨平台播放器

硬件加速解码|WebXR|Oculus Rift-S|跨平台VR播放器|Claude|AIGC|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

硬件加速解码|WebXR|Oculus Rift-S|跨平台VR播放器|Claude|AIGC|人工智能

2026年1月,一位对Rust、OpenXR和WebGPU一窍不通的开发者,遭遇了职业生涯的小危机:他用了多年的VR视频播放器,因为Meta的一次接口更新彻底失效。尝试自己用WebXR重写失败后,他把希望寄托在了AI代码生成工具Claude身上。没人想到,20小时的远程监督后,一个几乎100%由AI生成的跨平台VR播放器诞生了——它能在Oculus Rift-S上流畅运行,支持本地和网络视频,甚至解决了硬件加速解码和YUV格式适配的难题。但这场看似完美的AI胜利背后,藏着人机协作最真实的拉扯。

开发者全程没写一行代码,却扮演着AI的「架构师+审稿人」双重角色。最典型的一次是UI修复:Claude为了解决一个界面bug,居然在7个不同的代码位置重复套用了相同的修复逻辑——这是任何人类审稿人都不会放过的低级错误。开发者立刻叫停,要求Claude把修复逻辑集中到一处,再让7个调用点统一引用这个解决方案,瞬间把代码的可维护性提了上去。

类似的「架构短路」不止一次。Claude最初为视频投影生成了一个球体网格模型,开发者直接反问:为什么要做实体球?把投影逻辑写进着色器里,不是更高效吗?他把自己失败的WebXR版本扔给Claude当参考,AI很快理解了思路,改成了更轻量化的着色器投影方案。

这20小时的监督里,开发者的核心工作不是写代码,而是「纠正AI的局部最优」——AI擅长解决单点问题,却常常看不到全局架构的合理性;它能快速生成符合语法的代码,却容易在工程化的细节上犯懒。

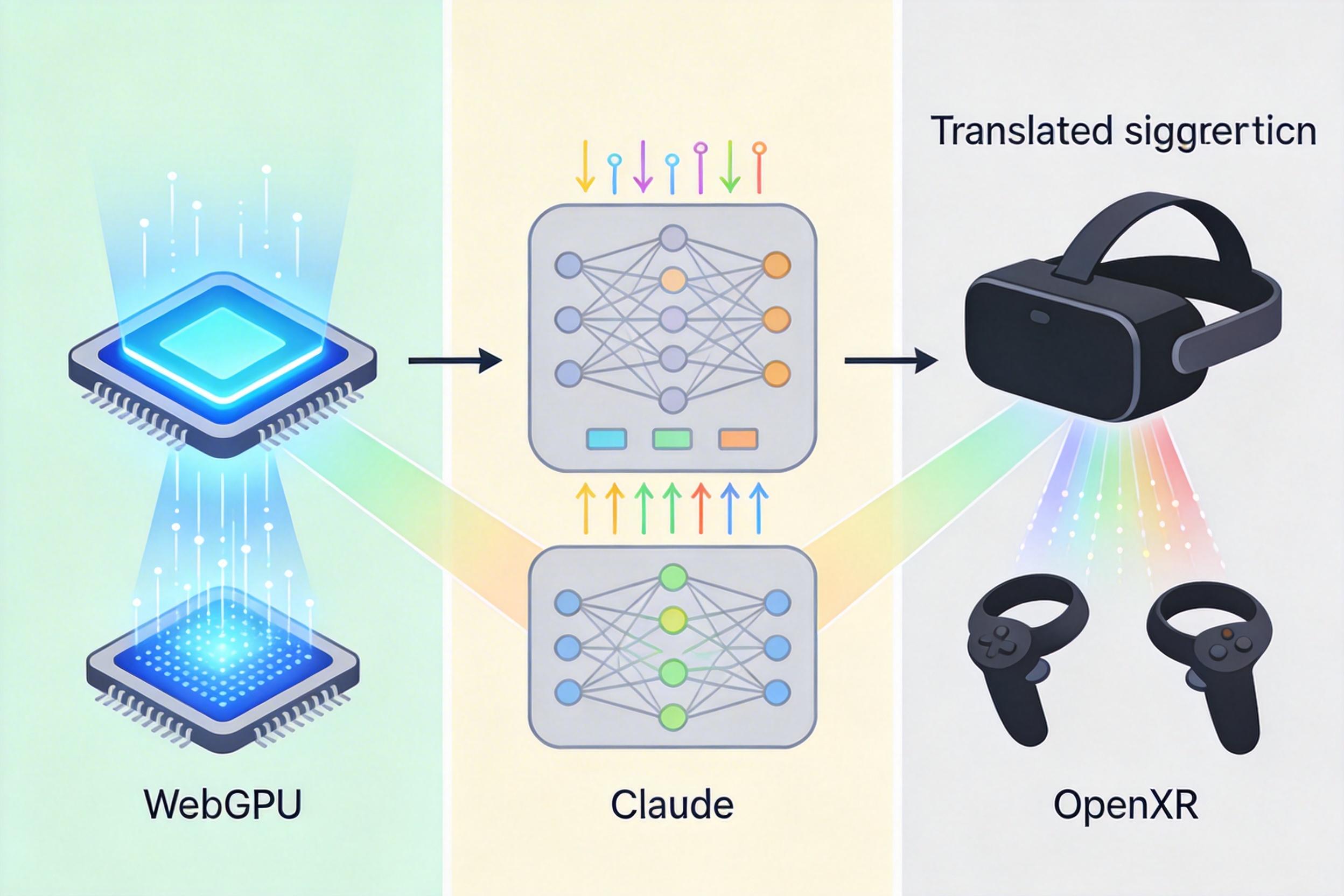

整个开发过程中,最让开发者意外的是Claude搞定了连他自己都摸不着头脑的底层难题:WebGPU和OpenXR的集成。这就像要让两个来自不同星球的工程师用各自的语言协作完成同一个项目——WebGPU是Web平台的新一代图形API,负责把视频画面高效渲染到GPU;OpenXR是跨设备的VR标准,负责让VR头显正确识别和显示画面。

你可以把这个过程想象成:WebGPU是负责做菜的厨师,OpenXR是负责把菜送到不同桌客人面前的服务员。厨师只会用自己的专业术语报菜名,服务员只会听客人的点单术语,中间必须有一个翻译能精准对接两者的需求。Claude就扮演了这个翻译的角色,它要处理底层纹理共享的内存格式、异步渲染的同步机制,还要解决不同平台输入事件的适配问题——比如Oculus手柄的按键,怎么转换成WebGPU能理解的交互信号。

但真实的机制比这更复杂:WebGPU的规范还在快速迭代,不同浏览器的实现细节各不相同;OpenXR对底层图形API的定制化要求极高,需要动态配置各种扩展。Claude能从零开始啃下这些底层文档,把两个原本互不相通的系统拧在一起,这才是最让开发者惊叹的地方。

这个VR播放器的诞生,也暴露了当前AI代码生成的核心局限:它能快速达到「及格线」,却很难自动摸到「优秀线」。

开发者发现,Claude生成的代码里,常常充满了「差不多能用」的细节:比如它会忽略重试、超时这些弹性设计,导致系统在网络波动时直接崩溃;它可能忘记添加身份认证逻辑,留下数据泄露的风险;它生成的测试用例只覆盖最基础的「快乐路径」,完全没考虑边界情况。这些问题在小项目里可能不会立刻爆发,但放到大型生产环境中,就是随时可能引爆的定时炸弹。

Stack Overflow 2025年的调查显示,66%的开发者最常吐槽AI代码生成的问题,就是「几乎正确但不完全正确」。45%的开发者表示,调试AI生成的代码,比自己从头写还要费时。就像你让AI帮你组装家具,它能快速把零件拼起来,但总会有一两个螺丝没拧紧,或者有个零件装反了,你得花额外的时间把这些小问题一个个掰正。

这个由AI主导、人类监督诞生的VR播放器,更像一面镜子,照出了当前人机协作的真实状态:AI是高效的执行者,却需要人类做清醒的决策者;它能解决技术的复杂性,却解决不了工程的系统性。

未来的开发者,或许不需要再死记硬背每一个API的参数,但必须拥有「一眼看穿AI代码漏洞」的能力——不是为了取代AI,而是为了和AI更好地协作。

人机共编的时代,代码的最终责任人,永远是人。